【AI词典】RLHF强化学习 - 基于人类反馈的强化学习方法

定义

RLHF(Reinforcement Learning from Human Feedback,基于人类反馈的强化学习)是一种将人类偏好信号作为核心优化目标的先进机器学习方法。它通过收集人类对模型输出的评价或比较数据,训练一个奖励模型来模拟人类偏好,进而指导生成模型(如大语言模型)的强化学习训练过程,旨在使模型行为更安全、更符合人类价值观和意图。

RLHF强化学习的工作原理

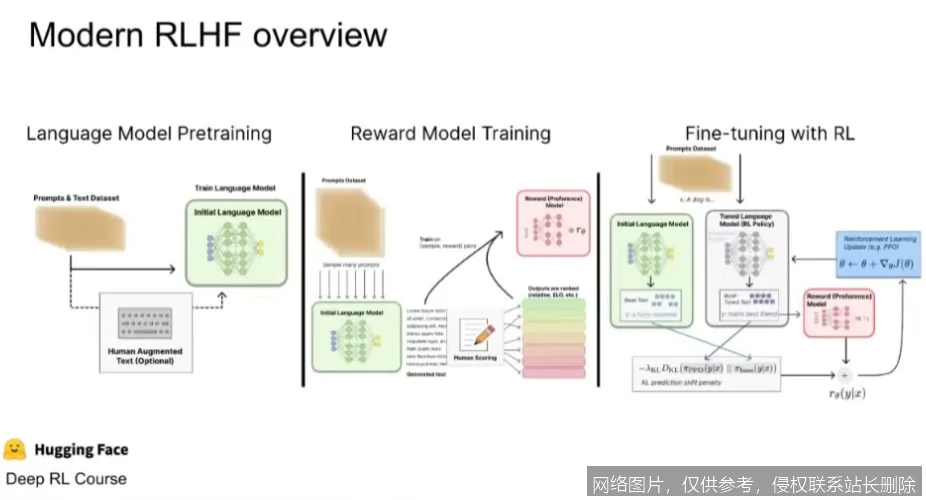

RLHF的工作流程可以类比为训练一位聪明的学徒。整个过程通常分为三个关键步骤:

首先,监督微调:使用高质量的问答或指令数据对预训练好的基础模型进行初步调教,让其初步理解指令格式并生成相关回应。这好比让学徒先学习基本的行业规范和对话模式。

其次,奖励模型训练:这是RLHF的核心。我们不再直接编写复杂的奖励规则,而是请人类训练师对同一个问题的多个模型回复进行质量排序或评分。这些人类偏好数据被用于训练一个独立的“奖励模型”,使其学会像人类一样判断回复的好坏。这个奖励模型就成为了后续强化学习中的“评判官”。

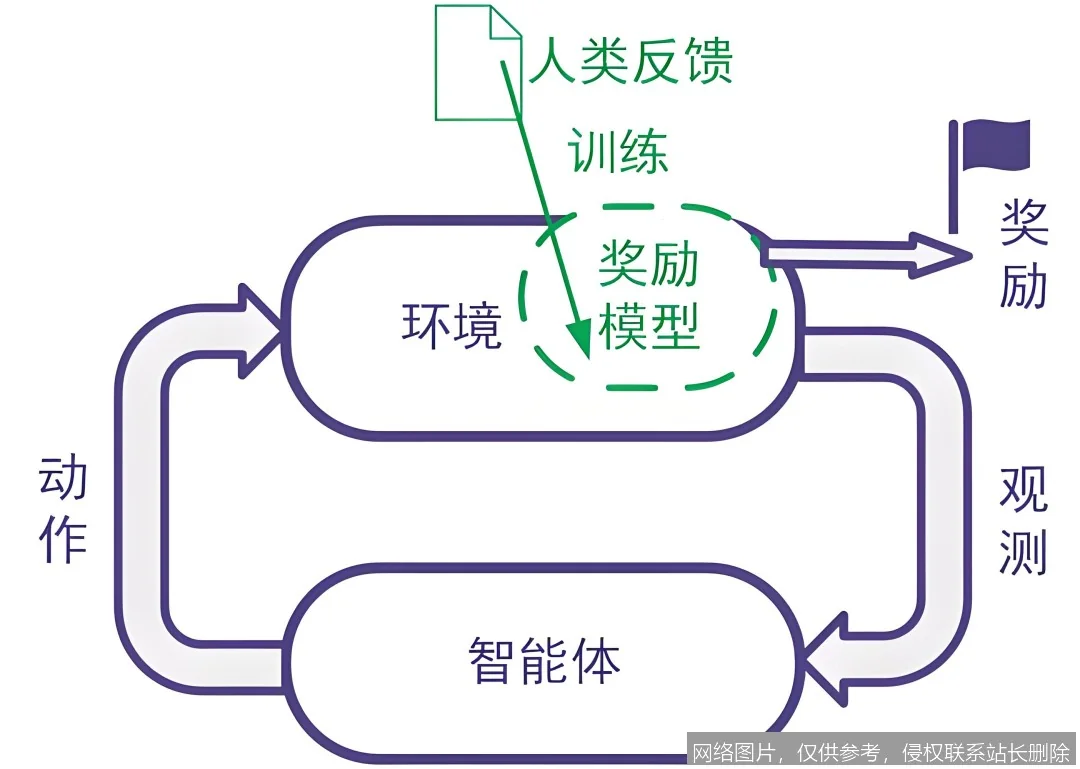

最后,强化学习优化:将微调后的模型作为“智能体”,将奖励模型作为“环境”的反馈源。模型尝试生成各种回复,奖励模型为其打分(提供奖励信号)。通过近端策略优化等强化学习算法,模型不断调整自身参数,以最大化从奖励模型获得的累积奖励,从而持续产出更受人类青睐的回复。整个过程形成了一个“模型生成-人类(或奖励模型)评价-模型改进”的闭环。

RLHF强化学习的应用场景

- 大型语言模型的对齐与安全:这是RLHF最著名的应用。通过RLHF,可以使ChatGPT、Claude等对话AI的输出更加有帮助、诚实且无害,减少生成带有偏见、有害或胡言乱语内容的风险,实现模型与人类意图的对齐。

- 内容生成与创意辅助:在文案写作、代码生成、艺术设计提示词优化等领域,RLHF可用于根据人类对生成结果的偏好(如更流畅、更创意、更符合风格),持续优化生成模型,使其产出更贴合用户个性化需求的内容。

- 复杂决策与机器人控制:在难以用明确规则定义奖励的任务中(如让机器人完成家务),RLHF可以通过人类对任务完成度的直观评价来训练奖励模型,从而引导智能体学习更符合人类期望的复杂操作策略。

相关术语

强化学习、

近端策略优化、

奖励模型、

人工智能对齐、

监督微调、

大语言模型

延伸阅读

若想深入了解RLHF,建议从OpenAI发表的《Training language models to follow instructions with human feedback》这篇开创性论文入手。同时,可以关注其演进技术,如直接偏好优化,这是一种旨在简化RLHF流程、降低实现成本的新方法。对于希望动手实践的开发者,Hugging Face等开源平台提供了相关的库和教程,是极佳的学习起点。