视频扩散是什么:2026 原理、应用与实战全面解析

一句话定义

视频扩散(Video Diffusion)是一种基于概率去噪的生成式 AI 模型,通过逐步从随机噪声中还原像素,实现高质量、高连贯性的动态影像合成。

技术原理:从混沌到秩序的时空演化

要理解视频扩散是什么,我们首先需要拆解其背后的核心引擎——扩散模型(Diffusion Models)。如果说传统的生成对抗网络(GANs)像是一位画家与一位鉴赏家在博弈中不断精进画技,那么扩散模型则更像是一位拥有“时间倒流”超能力的修复师。它的工作逻辑并非直接凭空创造,而是学习如何逆转一个破坏过程。

1. 核心工作机制:前向加噪与反向去噪

视频扩散模型的训练过程分为两个截然不同的阶段,这两个阶段共同构成了其生成能力的基石。

第一阶段:前向扩散过程(Forward Diffusion Process)。

想象你有一段清晰流畅的视频片段。在这个阶段,模型会模拟一个物理上的“熵增”过程。系统会在视频的每一帧上逐步添加高斯噪声(Gaussian Noise)。起初,画面只是变得略微模糊;随着步骤的增加,雪花点越来越多;到了最后一步,原本清晰的视频完全变成了一团毫无意义的随机噪声矩阵。这个过程是确定的、可计算的,不需要模型去学习,它的目的是构建一个从“有序数据”到“无序噪声”的标准路径。

第二阶段:反向去噪过程(Reverse Denoising Process)。

这是模型真正展现智能的时刻,也是推理(Inference)阶段的核心。模型的任务是学习如何“逆时间而行”。给定一团纯随机噪声,模型需要预测并移除其中的噪声成分,一步步将其还原为清晰的视频。这并非简单的图像锐化,而是一个复杂的概率推断过程。模型在每一个时间步(Time Step)都要回答一个问题:“如果当前的图像是这样的噪声状态,那么它在上一刻稍微清晰一点的状态应该是什么样?”通过成千上万次的迭代,随机噪声逐渐凝聚成物体的轮廓、纹理,最终形成连贯的动作。

在视频生成的语境下,这个过程的难度呈指数级上升。因为模型不仅要保证单帧画面的清晰度(空间一致性),还要保证帧与帧之间物体运动的自然流畅(时间一致性)。如果处理不好,生成的视频中人物可能会突然变形、背景会闪烁跳动,这种现象被称为“时序抖动”。

2. 关键技术组件:时空融合的架构艺术

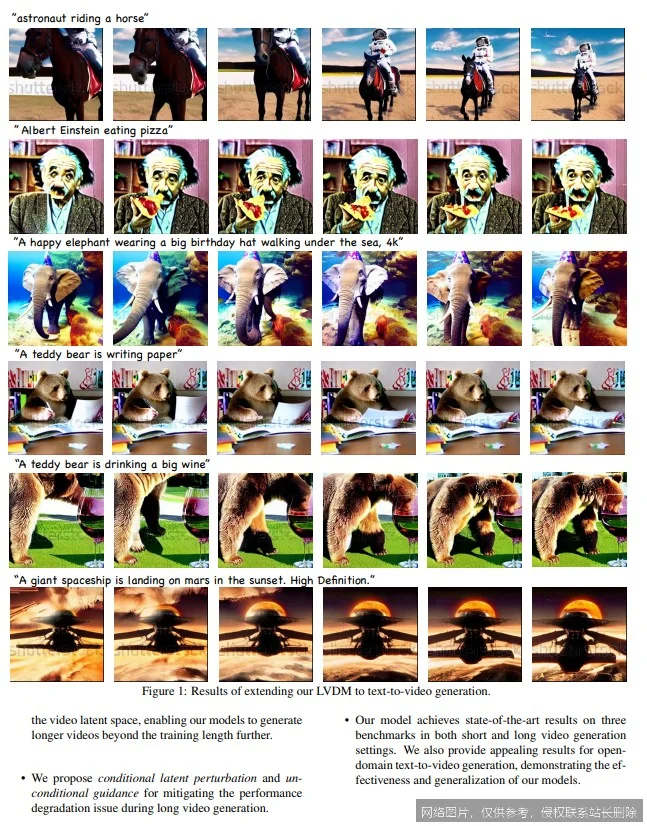

为了实现上述机制,现代视频扩散模型(如 Sora、Runway Gen-2、Stable Video Diffusion)通常采用高度复杂的神经网络架构。以下是几个至关重要的技术组件:

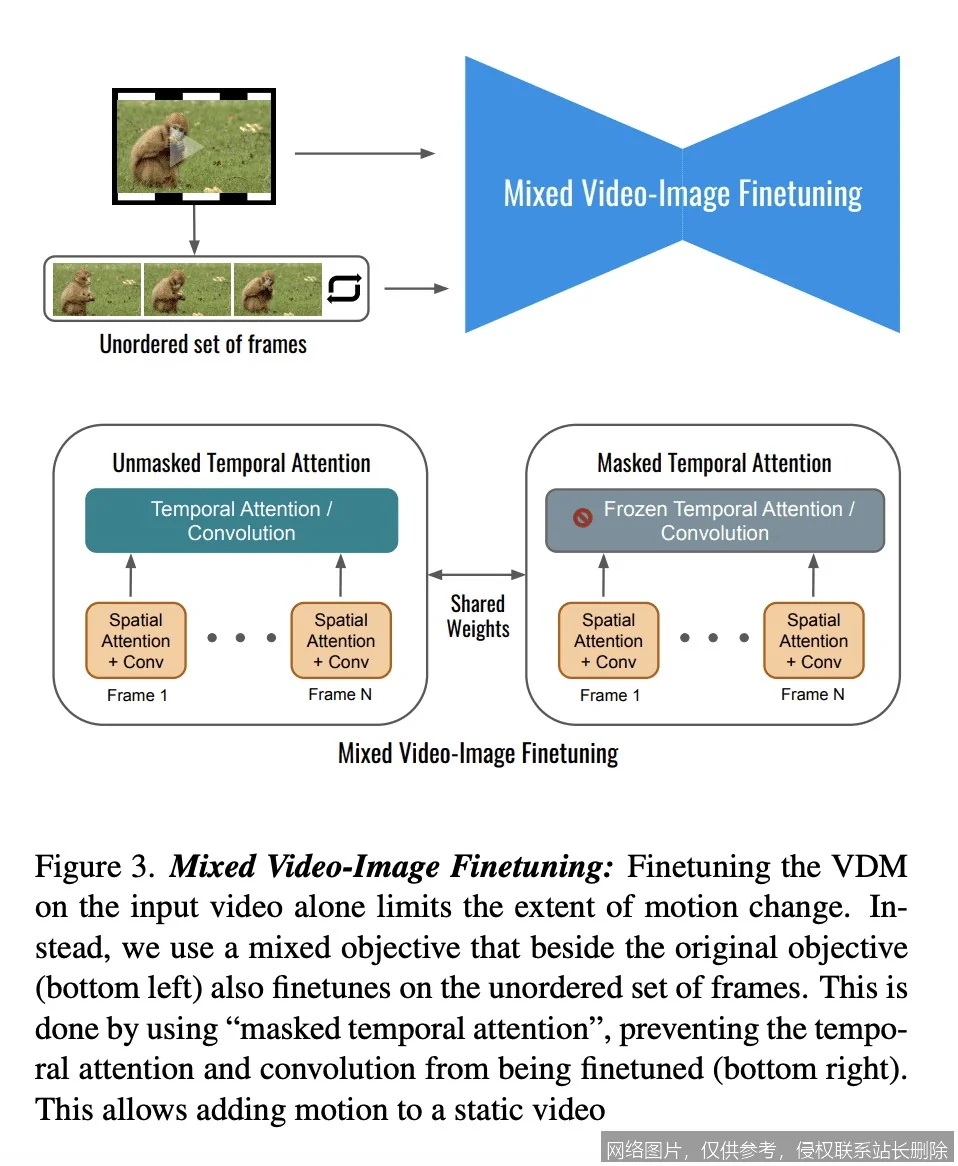

- 3D U-Net 与时空注意力机制(Spatio-Temporal Attention):

传统的图像扩散模型使用 2D 卷积来处理空间信息(宽和高)。而视频增加了“时间”这一维度。视频扩散模型将输入视为一个三维张量(宽×高×时间帧数)。核心的创新在于引入了 3D 卷积或分解的时空注意力机制。这种机制允许模型在计算某一点的像素值时,不仅参考同一帧内的周围像素(空间上下文),还能参考前后帧中对应位置的像素(时间上下文)。这就好比导演在拍摄时,不仅关注当前镜头的构图,还要确保演员的动作与上一秒和下一秒无缝衔接。 - 变分自编码器(VAE, Variational Autoencoder)的潜空间压缩:

直接在原始像素空间(Pixel Space)进行扩散计算极其消耗算力,尤其是对于高分辨率、长时长的视频。因此,主流方案采用了“潜空间扩散”(Latent Diffusion)策略。首先,利用训练好的 VAE 编码器将原始视频压缩到一个低维度的“潜空间”(Latent Space)。在这个压缩后的空间里,视频的数据量大幅减少,但保留了核心的语义和结构信息。扩散过程在这个紧凑的潜空间中进行去噪,最后再通过 VAE 解码器还原为可视化的像素视频。这种方法极大地降低了计算门槛,使得生成高清视频成为可能。 - 文本 - 视频对齐模块(Text-Video Alignment):

为了让用户能通过文字提示词(Prompt)控制视频内容,模型集成了强大的语言编码器(如 CLIP 或 T5)。这些编码器将用户的自然语言描述转化为向量嵌入(Embeddings),并通过交叉注意力机制(Cross-Attention)注入到去噪网络中。这确保了生成的视频内容严格遵循文本指令,例如“一只穿着宇航服的猫在月球上跳跃”,模型能准确识别“猫”、“宇航服”、“月球”以及“跳跃”这一动态特征。

3. 与传统方法的对比:范式转移

在视频扩散出现之前,视频生成主要依赖两类技术:基于递归神经网络(RNN/LSTM)的逐帧预测,以及基于生成对抗网络(GANs)的方法。

| 特性 | 传统 RNN/LSTM 方法 | 视频 GANs | 视频扩散模型 (Video Diffusion) |

|---|---|---|---|

| 生成逻辑 | 根据前一帧预测下一帧,误差会随时间累积 | 生成器与判别器博弈,直接输出结果 | 从全局噪声逐步去噪,整体优化 |

| 长时序一致性 | 差,容易出现画面崩塌或模糊 | 中等,难以生成长视频 | 优,能捕捉长距离的时间依赖关系 |

| 训练稳定性 | 较稳定,但收敛慢 | 极不稳定,易发生模式崩溃(Mode Collapse) | 非常稳定,目标函数明确 |

| 多样性 | 倾向于生成平均化的模糊结果 | 多样性有限,容易重复 | 极高,能覆盖复杂的数据分布 |

类比来看,传统方法像是在走钢丝,每一步都依赖上一步的平衡,一旦出错就难以挽回;而视频扩散则像是在雕刻,先从一块粗糙的石料(噪声)开始,通过全局的审视和精细的打磨,最终呈现出完美的雕塑。这种“全局视角”使得视频扩散在处理复杂运动和大尺度场景变化时具有压倒性优势。

核心概念:构建视频生成的知识图谱

深入理解视频扩散是什么,需要掌握一系列相互关联的专业术语。这些概念构成了该领域的知识骨架,澄清常见的误解对于正确应用该技术至关重要。

1. 关键术语解析

- 潜空间(Latent Space):

这是一个抽象的数学空间,原始的高维视频数据在这里被压缩为低维向量。可以将其理解为视频的"DNA"或“压缩包”。在潜空间中,语义相似的视频(如不同角度的跑步动作)距离更近。扩散模型在此空间操作,效率远高于像素空间。 - 采样器(Sampler/Scheduler):

决定了模型如何从噪声走向清晰的具体算法策略。常见的如 DDIM、DPM-Solver、Euler Ancestral 等。不同的采样器在生成速度和质量之间有不同的权衡。有的采样器只需几步就能生成视频(速度快但细节略少),有的则需要几十步(速度慢但细节丰富)。 - Classifier-Free Guidance (CFG Scale):

这是一个控制参数,用于调节生成结果对文本提示词的遵循程度。数值越高,视频越严格贴合提示词,但可能导致画面过于生硬或色彩饱和度过高;数值越低,创意性越强,但可能偏离主题。它是平衡“创造力”与“控制力”的关键旋钮。 - 帧插值(Frame Interpolation)与时序超分(Temporal Super-Resolution):

由于显存限制,许多模型先生成低帧率或低分辨率的视频,然后通过专门的扩散头进行扩充。帧插值用于让动作更丝滑(如从 8fps 提升到 24fps),时序超分则用于增加时长或提升清晰度,同时保持时间连贯性。

2. 概念关系图谱

视频扩散生态系统并非孤立存在,它是由多个模块协同工作的结果:

[文本提示/图像输入] --> (多模态编码器) --> [条件向量]

↓

[随机噪声] + [条件向量] --> (3D U-Net 去噪网络) --> [潜空间视频序列]

↓

(VAE 解码器) --> [最终像素视频]

在这个链条中,条件向量是指挥棒,3D U-Net是执行者,VAE是翻译官。任何一环的缺失或薄弱都会导致生成失败。

3. 常见误解澄清

误解一:“视频扩散就是让图片动起来。”

澄清:虽然“图生视频”(Image-to-Video)是重要应用场景,但视频扩散的本质是从头合成时空数据。它不仅仅是给静态图添加光流(Optical Flow),而是重新构建了物体在三维空间中的运动轨迹、光影变化和物理交互。它能创造出从未存在过的动作和场景,而不仅仅是动画化现有图片。

误解二:“生成的视频越长越好。”

澄清:目前的技术瓶颈恰恰在于长视频的一致性。随着帧数增加,累积误差会导致主体身份漂移(Identity Drift,如人物衣服颜色改变)或逻辑崩坏。当前的 SOTA(State-of-the-Art)模型通常在几秒到十几秒内表现最佳,超长视频往往需要通过分段生成再融合的技术手段实现,而非一次性生成。

误解三:“视频扩散完全理解物理世界。”

澄清:模型并不具备真正的物理常识,它只是从海量数据中学习到了“看起来符合物理规律”的统计相关性。因此,在面对训练数据中罕见的复杂物理交互(如流体与刚体的复杂碰撞、非刚性物体的极端形变)时,仍可能出现违反重力或穿透物体等幻觉现象。

实际应用:从创意原型到产业落地

理解了原理与概念后,我们来看看视频扩散是什么在实际世界中引发的变革。这项技术正在重塑内容创作、娱乐、教育乃至工业设计的流程。

1. 典型应用场景

- 影视预演与故事板制作(Pre-visualization):

在传统电影制作中,绘制分镜和制作动态故事板耗时耗力。导演现在可以使用视频扩散模型,输入剧本描述或草图,几分钟内生成高质量的动态预览。这不仅加快了决策流程,还让创作者能快速尝试不同的镜头语言和光影风格,极大地降低了试错成本。 - 广告与营销素材自动化:

电商平台和广告代理商可以利用该技术批量生成个性化的视频广告。例如,根据商品图片自动生成展示其功能、使用场景的短视频,甚至针对不同用户群体定制不同的背景风格和模特动作,实现“千人千面”的视频营销。 - 游戏资产生成与动态纹理:

游戏开发者可以利用视频扩散生成无缝循环的背景视频(如流动的河水、燃烧的火堆、飘动的云彩),作为动态纹理贴图。此外,还可以用于生成 NPC 的动作库或过场动画的草稿,大幅缩减美术资源的制作周期。 - 科学模拟与数据可视化:

在气象预测、流体动力学等领域,视频扩散模型可以被微调以生成符合物理方程的模拟视频。相比于传统的数值模拟,基于 AI 的生成速度更快,能够实时呈现复杂的演变过程,辅助科研人员直观分析数据。

2. 代表性产品与项目案例

- Sora (OpenAI):

目前的行业标杆。Sora 展示了惊人的长时序一致性和对复杂物理世界的理解能力。它能够生成长达一分钟的高清视频,支持复杂的摄像机运镜和多角色互动。其核心技术据信采用了 Transformer 架构替代传统的 U-Net,将视频视为一种特殊的“语言令牌”(Patches as Tokens),实现了 масштабируемость(可扩展性)的巨大飞跃。 - Runway Gen-2 / Gen-3 Alpha:

面向创作者的工具先驱。Runway 提供了丰富的控制工具,如“运动笔刷”(Motion Brush),允许用户指定图片中特定区域的运动方向和幅度。这种细粒度的控制能力使其成为专业视频编辑工作流中的重要插件。 - Stable Video Diffusion (Stability AI):

开源社区的代表作。基于 Stable Diffusion 图像模型微调而来,允许用户在本地部署或在私有云上运行。虽然其在长视频一致性上略逊于闭源巨头,但其开放权重和可定制性激发了大量社区创新,如针对特定动漫风格或真人写实的微调模型(LoRA)。 - Pika Labs:

以其简洁的交互界面和对动画风格的出色支持而闻名。Pika 特别擅长处理卡通、3D 渲染风格的视频生成,并提供了修改视频局部区域(Inpainting)和扩展画布(Outpainting)的功能。

3. 使用门槛和条件

尽管前景广阔,但要真正驾驭视频扩散技术,仍面临一定的门槛:

- 算力需求:

训练视频扩散模型需要数千张高端 GPU(如 H100/A100)集群支持数月之久。对于普通用户,即使只是推理(生成)高清视频,也需要显存较大的显卡(建议 16GB VRAM 以上)或使用云端算力服务。 - Prompt 工程能力:

生成高质量视频极度依赖提示词的质量。用户不仅需要描述画面内容,还需精确控制镜头语言(如"pan right", "zoom in")、光照氛围、运动速度等专业术语。缺乏相关知识的用户往往难以得到预期结果。 - 后期处理的必要性:

目前的生成结果很少能直接投入使用。通常伴随着分辨率不足、帧率过低、手部细节错误或短暂的闪烁问题。因此,成熟的落地流程必须结合传统的视频后期软件(如 After Effects, DaVinci Resolve)进行修复、超分和调色。

延伸阅读:通往未来的进阶之路

视频扩散技术正处于爆发式增长的前夜。为了帮助读者进一步探索视频扩散是什么及其未来演进,以下提供了相关的概念推荐、学习路径及资源指引。

1. 相关概念推荐

- 世界模型(World Models):

这是视频扩散的终极进化方向。不仅仅是生成视频,而是让 AI 在内部构建一个可预测、可交互的物理世界模拟器。Yann LeCun 等专家认为,这是通往通用人工智能(AGI)的关键路径。 - 神经辐射场(NeRF)与 3D 高斯泼溅(3D Gaussian Splatting):

这些是 3D 重建技术。将视频扩散与 3D 技术结合,可以实现从单段视频生成可自由漫游的 3D 场景,打破二维视频的视角限制,实现真正的“四维生成”(3D 空间 +1D 时间)。 - 可控生成(Controllable Generation):

研究如何通过骨骼绑定(Pose Control)、深度图(Depth Map)、边缘检测(Canny Edge)等条件信号,精确控制视频中人物的动作和场景结构,是实现工业化应用的关键。

2. 进阶学习路径

对于希望深入研究该领域的学习者,建议遵循以下路径:

- 数学基础:复习概率论(特别是高斯分布、马尔可夫链)、线性代数和微积分。理解随机微分方程(SDE)的基本概念。

- 深度学习基础:熟练掌握 PyTorch 框架,深入理解 CNN、Transformer 架构、Attention 机制以及 VAE 的原理。

- 论文研读:从经典的《Denoising Diffusion Probabilistic Models》(DDPM) 开始,过渡到《High-Resolution Image Synthesis with Latent Diffusion Models》(LDM),最后精读视频领域的《Video Diffusion Models》、《Make-A-Video》以及最新的 Sora 技术报告(如有公开)。

- 代码实战:克隆 Hugging Face 上的 Stable Video Diffusion 仓库,尝试在本地运行推理,进而尝试使用 LoRA 技术对模型进行微调,观察不同参数对生成结果的影响。

3. 推荐资源和文献

- 核心论文:

- Ho, J., et al. (2020). "Denoising Diffusion Probabilistic Models." NeurIPS.

- Rombach, R., et al. (2022). "High-Resolution Image Synthesis with Latent Diffusion Models." CVPR.

- Blattmann, A., et al. (2023). "Stable Video Diffusion: Scaling Latent Video Diffusion Models to Large Datasets."

- 在线社区与平台:

- Hugging Face:获取开源模型权重、Datasets 和 Demo 的首选地。

- Papers With Code:追踪最新论文及其对应的代码实现,查看排行榜(SOTA)。

- Civitai:专注于扩散模型社区模型、LoRA 和提示词分享的平台,适合寻找灵感。

- 视频教程:

- YouTube 频道:"Two Minute Papers"(快速了解前沿进展)、"Sebastian Lague"(深入的技术可视化解释)。

- Coursera/Udacity:搜索关于 Generative AI 和 Deep Learning 的专项课程。

视频扩散技术的出现,标志着我们进入了一个“想象力即生产力”的新时代。从最初的模糊噪点到如今逼真的动态影像,这项技术不仅改变了我们创作视频的方式,更深刻地影响了我们感知和构建数字世界的方式。随着算法的迭代和算力的提升,未来的视频扩散将更加智能、可控且普及,成为每个人手中强大的创作引擎。

已是最新文章