【AI词典】对比学习 - 通过对比样本学习表征的自监督方法

对比学习的定义

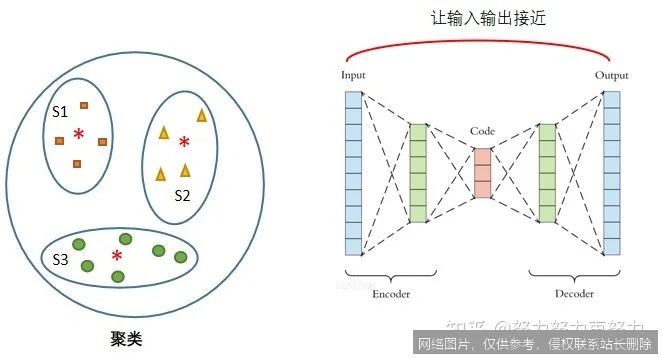

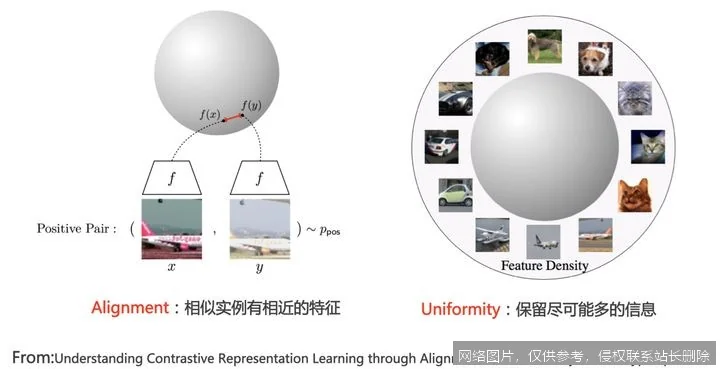

对比学习是一种自监督学习方法,其核心思想是通过在数据中构造相似与不相似的样本对,并训练模型学习到一种表征空间,使得相似样本的表征彼此靠近,而不相似样本的表征彼此远离。

对比学习的工作原理

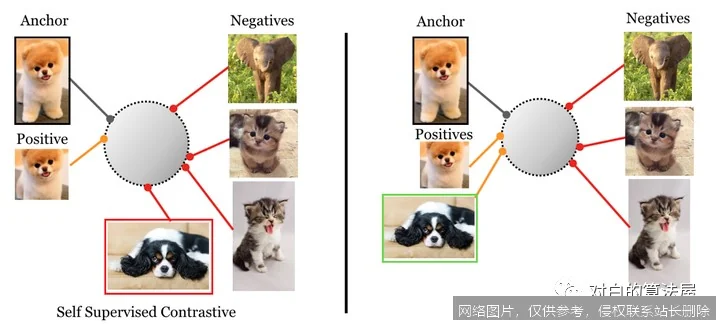

想象一下教一个孩子认识“猫”。你不需要直接告诉他猫的定义,而是给他看很多猫的图片(正样本对),同时也给他看狗、汽车、树木的图片(负样本)。在这个过程中,孩子的大脑会自动发现:所有猫的图片,无论姿势、颜色如何,彼此之间都更相似;而它们与狗或汽车的图片则截然不同。对比学习正是模拟了这一过程。

在技术实现上,首先会对原始数据(如图片)进行两次随机但不同的“数据增强”(如裁剪、变色、加噪),生成两个略有差异的“视图”,它们构成一个正样本对。同一批次中的其他样本则自然成为负样本。模型(通常是一个神经网络编码器)的目标是最大化正样本对在表征空间中的相似度(如余弦相似度),同时最小化与所有负样本的相似度。通过这种“拉近”与“推远”的对比操作,模型学会了忽略无关的噪声和变化,捕捉数据中最本质、最稳定的特征。

对比学习的应用场景

- 计算机视觉:这是对比学习取得突破性成功的领域。模型在无需人工标注的海量图像上进行预训练,学习到高质量的通用视觉表征。这些预训练模型只需少量标注数据微调,就能出色地完成图像分类、物体检测、图像分割等下游任务,极大降低了对标注数据的依赖。

- 自然语言处理:在文本领域,通过对比学习可以训练出更好的句子或段落表征模型。例如,将同一段话的不同释义或相邻段落作为正样本,将无关文本作为负样本进行训练。得到的模型可以显著提升语义相似度计算、文本检索、智能问答等任务的性能。

- 语音与多模态学习:在语音识别中,同一句话的不同录音片段可作为正样本。在多模态学习中,对比学习大放异彩,例如将一张图片与其对应的文字描述作为正样本对进行训练,使模型能够学习到视觉与语言概念之间的对齐关系,这是图文检索、跨模态生成等应用的基础。

相关术语

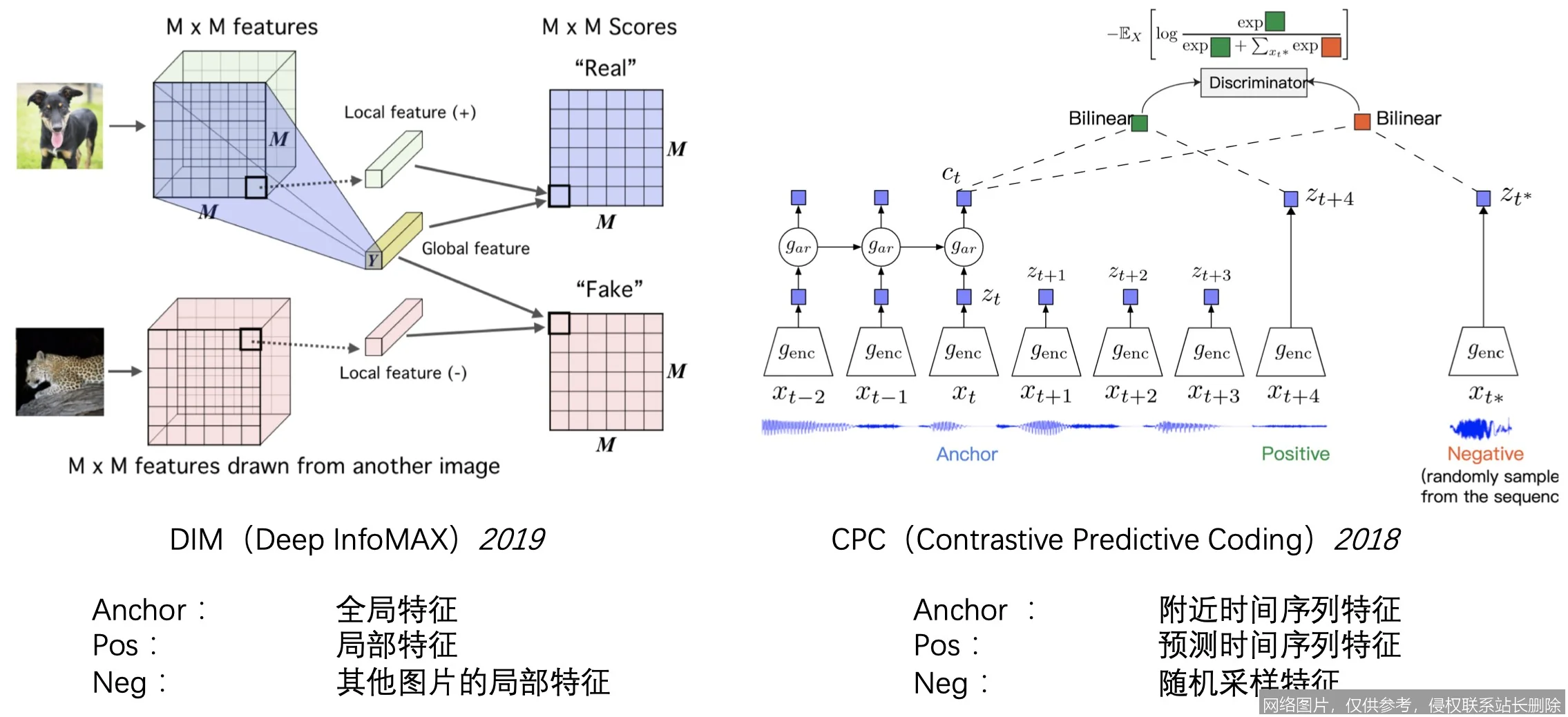

与对比学习紧密相关的概念包括:自监督学习(其所属的范式)、表征学习(其追求的目标)、度量学习(其背后的数学思想)、数据增强(其构造正样本的关键技术)以及SimCLR和MoCo(其著名的算法框架)。

延伸阅读

若想深入了解,可以查阅2018年至2020年间发表的一系列开创性论文,如《A Simple Framework for Contrastive Learning of Visual Representations》(SimCLR)和《Momentum Contrast for Unsupervised Visual Representation Learning》(MoCo)。这些论文清晰地阐述了对比学习从理论到实践的演进,并提供了可复现的代码库,是深入理解该领域的最佳起点。