【AI词典】迁移学习 - 利用已有知识解决新问题的机器学习方法

AI词典2026-04-20 21:36:00

迁移学习的定义

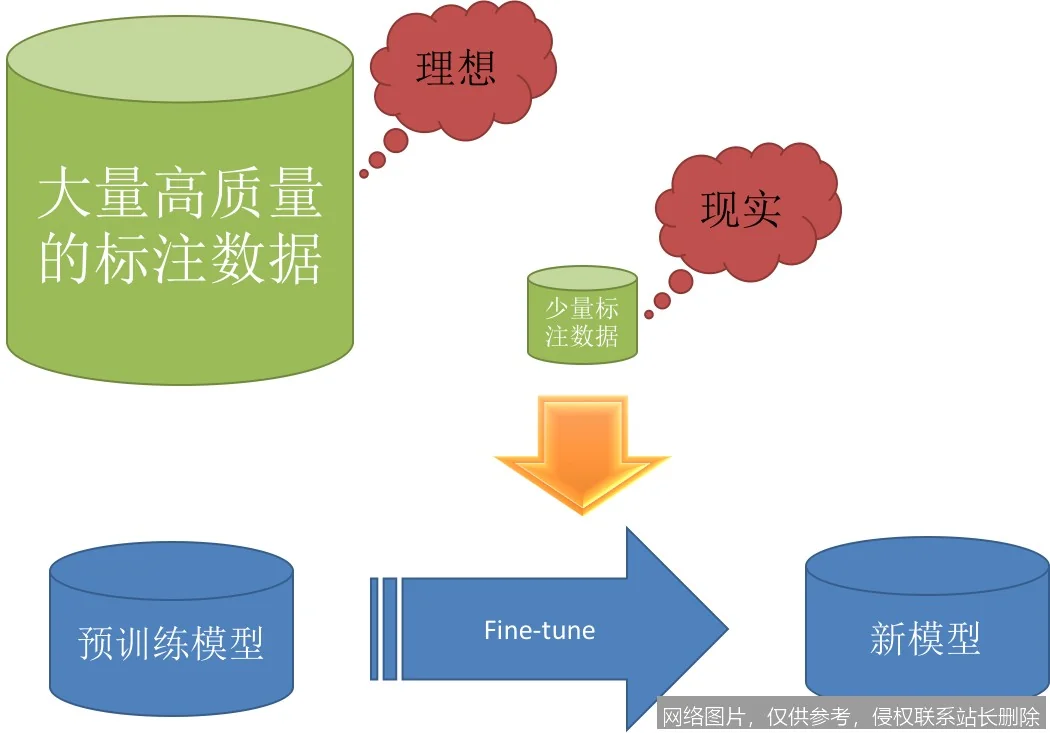

迁移学习是一种机器学习范式,其核心思想是将从一个任务(源领域)中学到的知识或模型,迁移并应用于另一个相关但不同的任务(目标领域),从而提升新任务的学习效率和性能。它打破了传统机器学习中每个任务都需要从零开始训练模型的局限,是实现“举一反三”智能的关键技术。

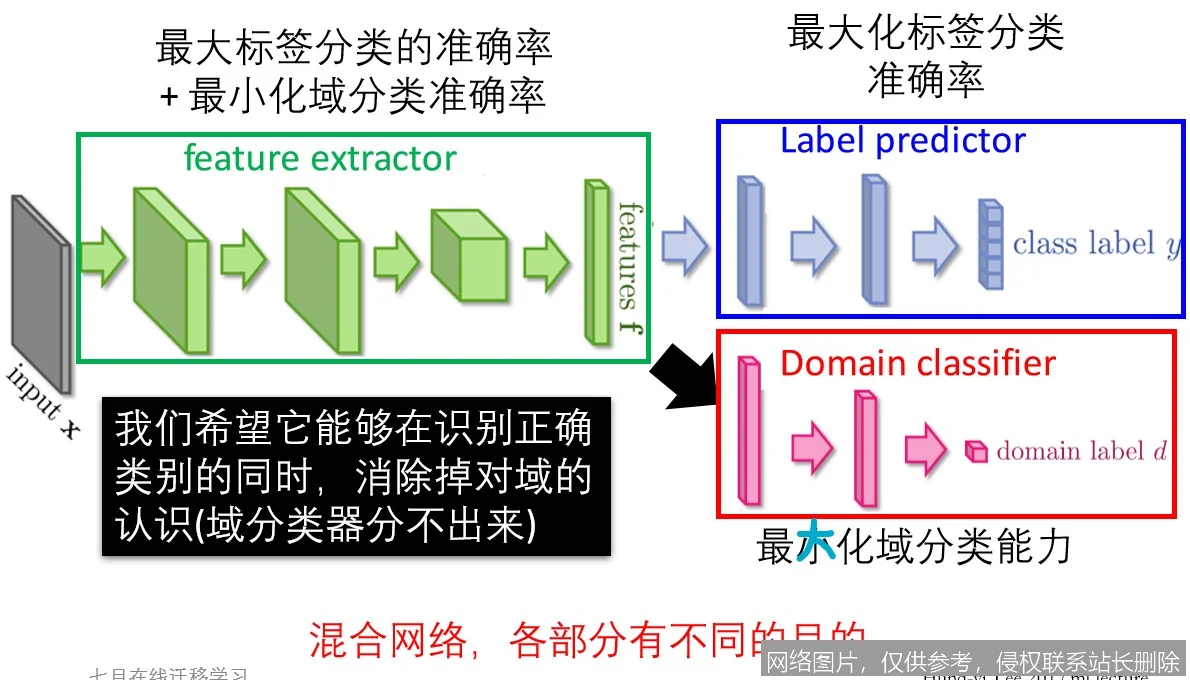

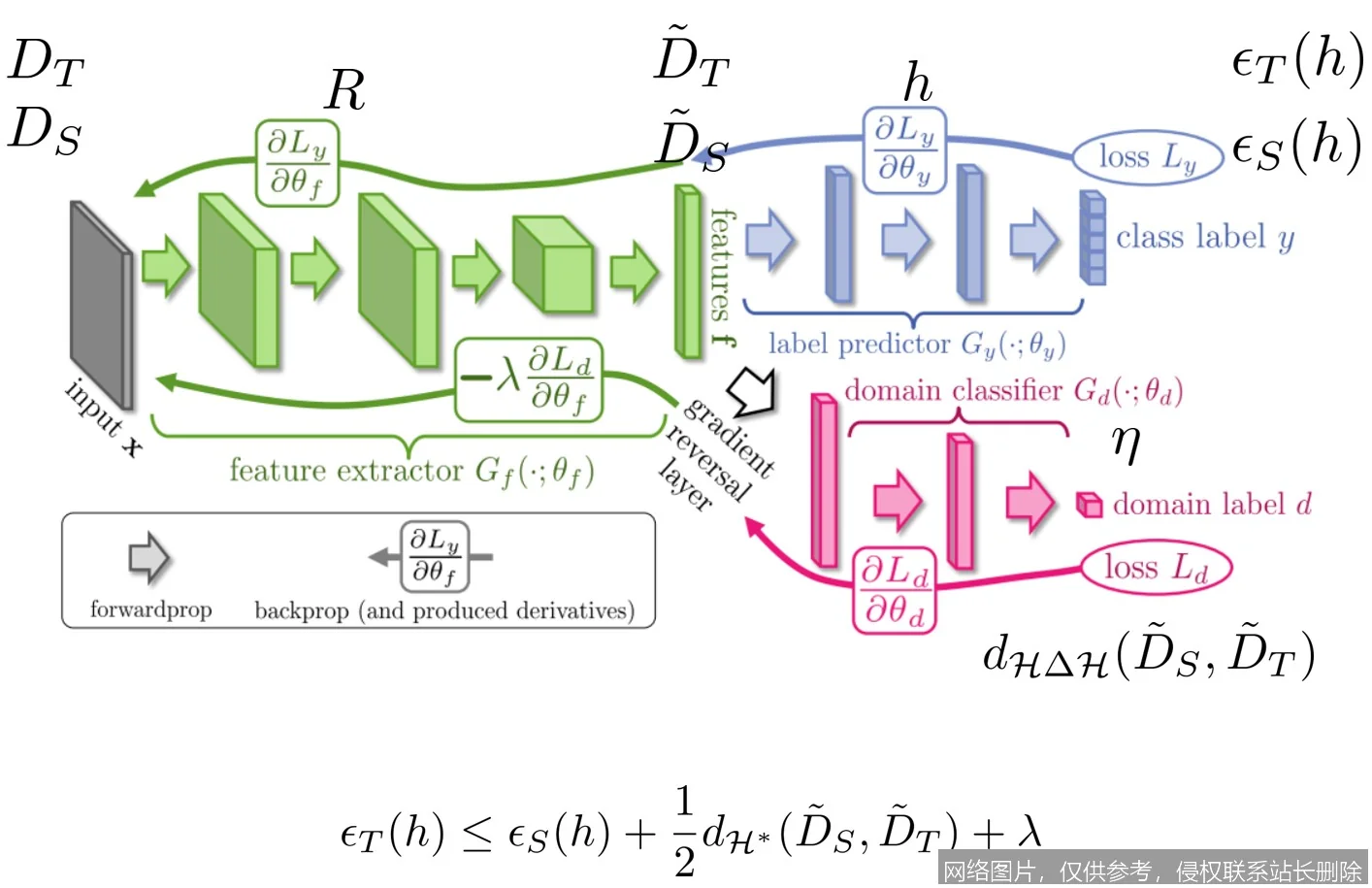

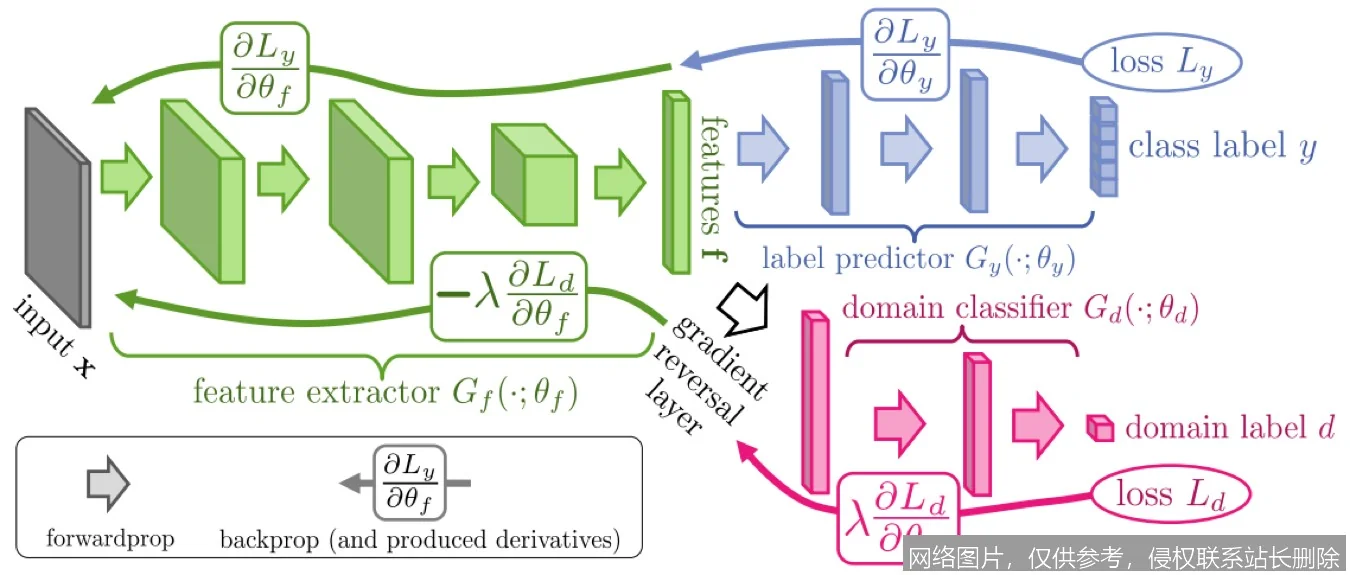

迁移学习的工作原理

可以将其类比为人类的学习过程。例如,一个学会了骑自行车的人,在学习骑电动车时,会自然地将掌握平衡、控制方向等通用技能迁移过来,只需重点学习油门、刹车等新特性,从而更快上手。在技术层面,迁移学习通常通过以下方式实现:

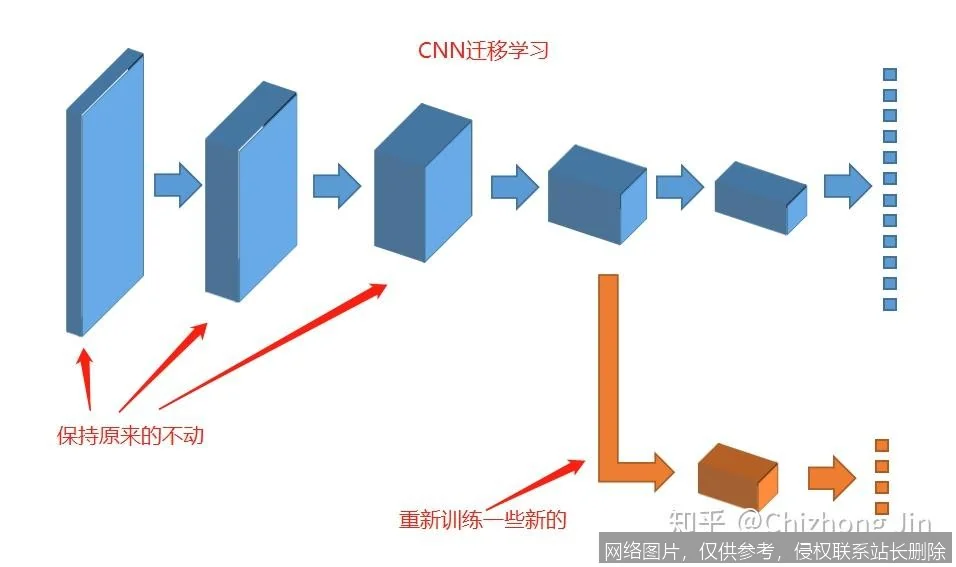

首先,在源领域(如包含数百万张通用图像的ImageNet数据集)上预训练一个深度神经网络模型,该模型已学会提取图像的基础特征(如边缘、纹理、形状)。然后,针对目标领域(如特定的医学影像数据集),保留该模型底层通用的特征提取能力(即“知识”),仅替换并重新训练顶层的分类器,使其适应新的类别(如区分肺炎与正常肺部)。这种方式极大地减少了对目标领域数据量和计算资源的需求。

迁移学习的应用场景

- 计算机视觉:这是迁移学习最成功的领域之一。利用在大型图像库上预训练的模型(如ResNet、VGG),开发者可以快速构建针对特定场景的模型,例如识别特定品牌的商品、检测生产线上的瑕疵品,或分析医学影像辅助诊断,显著缩短开发周期并提升准确率。

- 自然语言处理:基于海量文本预训练的大型语言模型(如BERT、GPT系列)是迁移学习的典范。这些模型掌握了语言的通用语法、语义知识,只需通过少量示例进行微调,就能高效适配到情感分析、智能客服、文本摘要等下游任务中。

- 跨模态学习:迁移学习的理念也适用于不同数据模态之间。例如,将从视觉数据中学到的关于物体结构和场景的知识,迁移到机器人控制或自动驾驶的决策系统中,帮助智能体更好地理解周围环境并做出反应。

相关术语

理解迁移学习,可关联以下概念:领域自适应、预训练模型、微调、多任务学习、元学习以及深度学习。

延伸阅读

若想深入了解,可关注学者Sinno Jialin Pan和Qiang Yang关于迁移学习的奠基性综述论文《A Survey on Transfer Learning》。在实践中,可以尝试使用PyTorch或TensorFlow框架,加载Hugging Face或TensorFlow Hub上的预训练模型,在自己的数据集上进行微调实验,这是掌握迁移学习最直接的途径。