【AI词典】强化学习 - 通过试错与环境交互的学习方法

AI词典2026-04-21 01:48:00

强化学习:定义

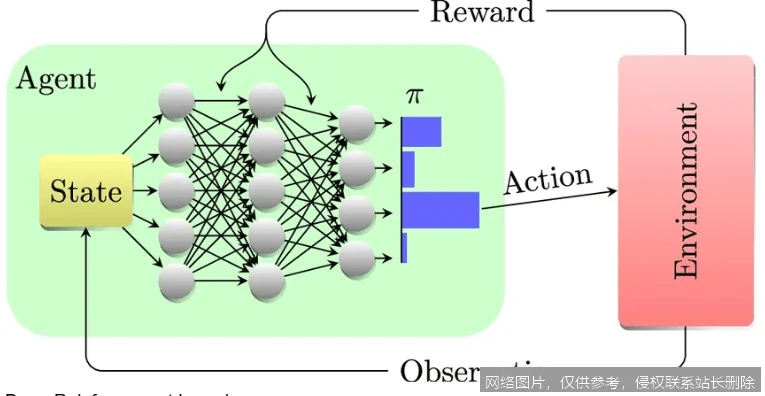

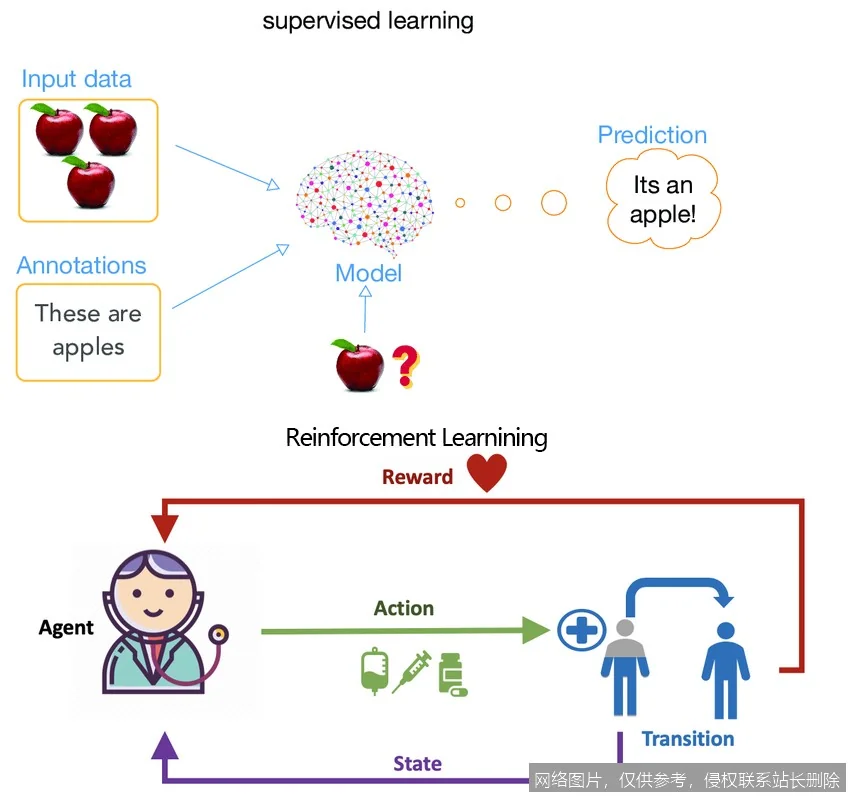

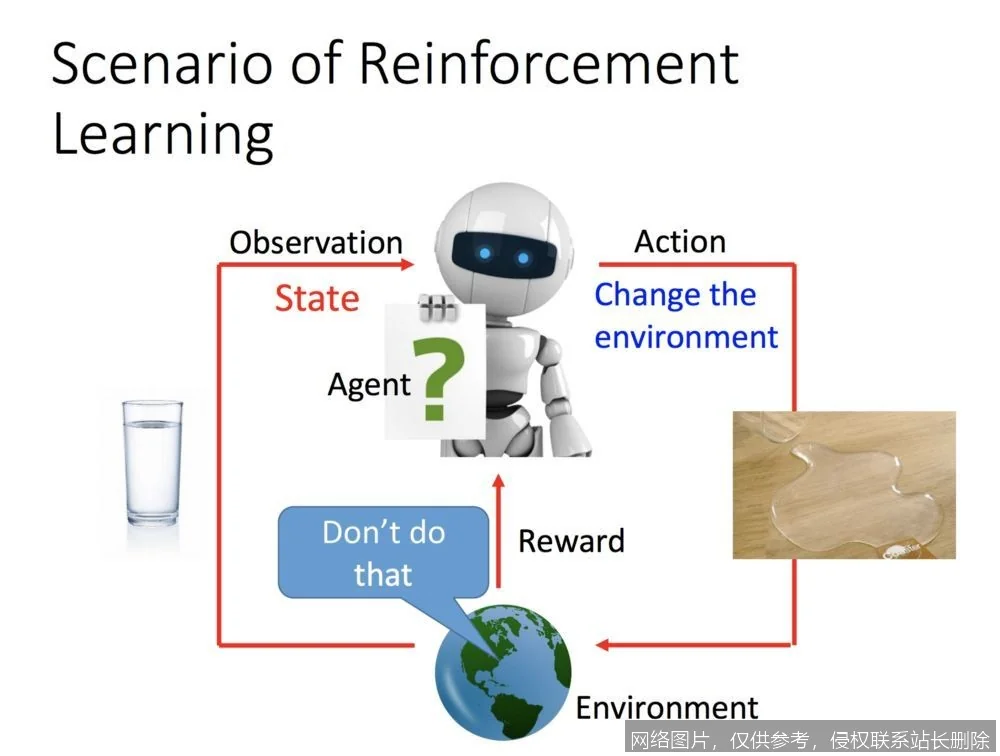

强化学习是机器学习的一个核心分支,其核心思想是让一个智能体通过与环境进行持续交互,并根据其行动所获得的奖励或惩罚信号,以试错的方式自主学习最优决策策略。它模拟了生物通过“奖励”和“惩罚”来学习行为模式的过程,目标是在长期内最大化累积奖励。

强化学习的工作原理

我们可以用一个训练宠物狗学习“坐下”的类比来通俗地理解强化学习。在这个框架中:

智能体就是宠物狗。环境是狗所处的物理空间和主人的指令。状态是狗在某一时刻所感知到的情况(如听到“坐下”口令)。动作是狗可能做出的反应(如坐下、趴下或无视)。当狗执行了“坐下”这个动作后,主人会立刻给予零食作为奖励;如果它跑开,则可能得不到奖励甚至被轻微训斥(惩罚或负奖励)。

通过反复尝试,狗会逐渐明白,在“听到坐下口令”这个状态下,执行“坐下”这个动作能带来最大的长期好处(更多零食)。强化学习的算法,如Q-learning、深度Q网络等,就是通过数学方式(如价值函数、策略梯度)来形式化这一学习过程,帮助智能体在复杂环境中计算出最优的“状态-动作”映射关系。

强化学习的应用场景

- 游戏与仿真:强化学习在游戏AI领域取得了里程碑式的成就,例如AlphaGo击败人类围棋冠军,以及AI在《星际争霸II》、《Dota 2》等复杂游戏中达到顶级水平。这些智能体从零开始,通过与游戏环境进行数百万次对弈来学习制胜策略。

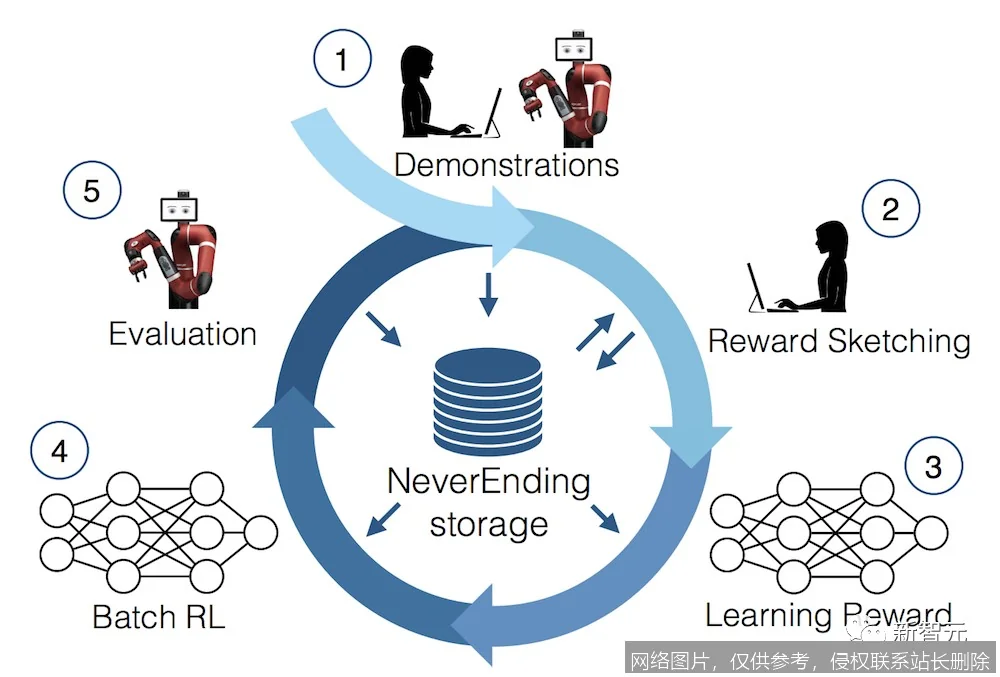

- 机器人控制:让机器人学习行走、抓取物体或执行复杂任务。机器人(智能体)通过传感器感知环境(状态),尝试不同的电机动作,并根据是否成功完成任务(如平稳行走、抓取成功)获得奖励,从而自主学会精细的运动控制。

- 资源管理与优化:在工业自动化、数据中心能耗管理和金融交易中,强化学习可用于动态决策。例如,智能体可以学习如何根据实时流量调整数据中心冷却系统的参数以最小化能耗,或如何管理投资组合以在风险约束下最大化长期收益。

相关术语

要深入理解强化学习,可以关联以下概念:机器学习、深度学习、马尔可夫决策过程、Q-learning、策略梯度、智能体、奖励函数、探索与利用。

延伸阅读

若希望系统学习,推荐Richard S. Sutton和Andrew G. Barto合著的经典教材《强化学习(第二版)》(Reinforcement Learning: An Introduction)。对于实践入门,OpenAI的Gym和DeepMind的OpenSpiel等开源平台提供了丰富的环境,便于动手实现和测试各类强化学习算法。