【AI词典】多模态模型 - 能处理多种类型信息的AI模型

AI词典2026-04-21 04:36:00

多模态模型:定义

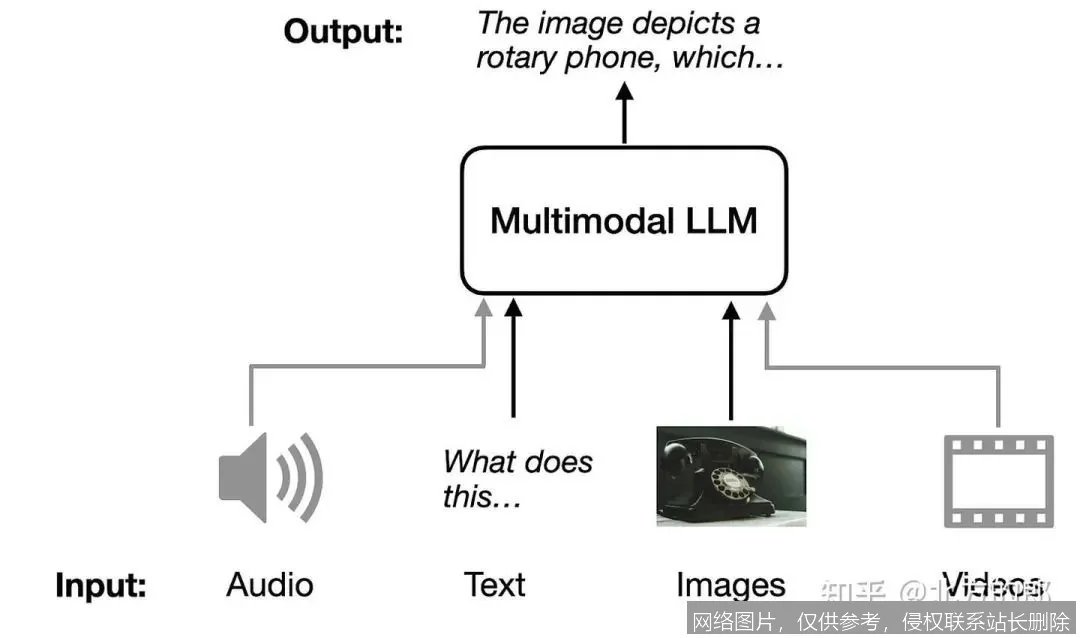

多模态模型是一种能够同时处理、理解和关联多种不同类型信息(如文本、图像、音频、视频)的人工智能模型,旨在通过整合不同模态的数据来获得比单一模态模型更全面、更准确的认知。

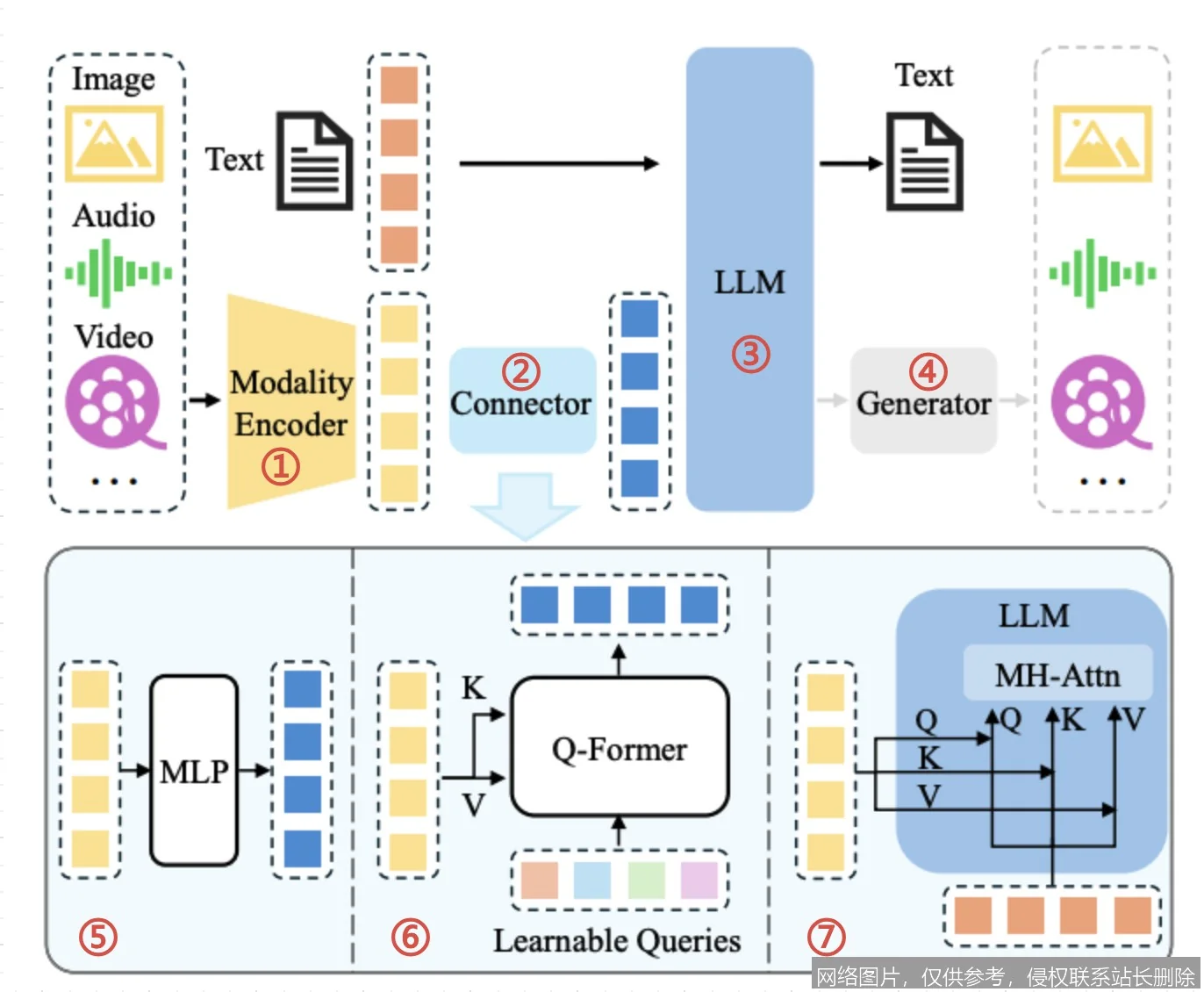

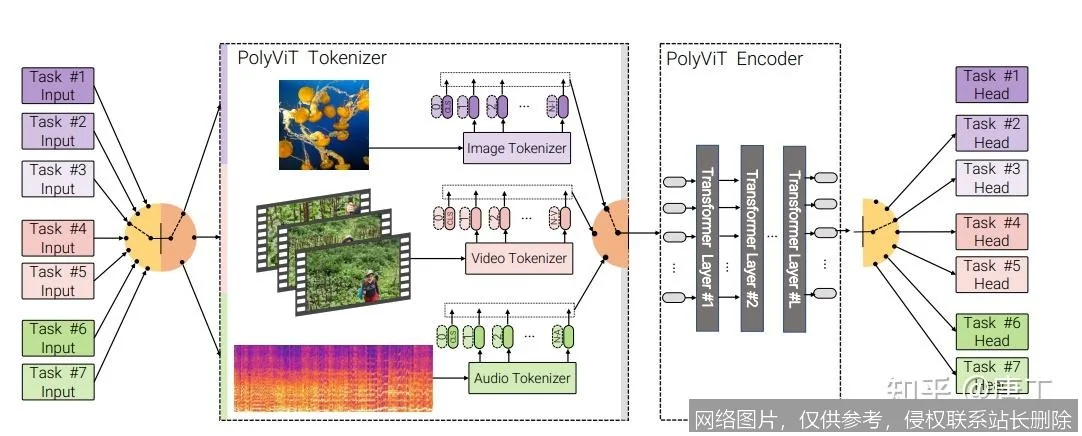

多模态模型的工作原理

多模态模型的核心原理是“对齐”与“融合”。首先,模型通过各自的编码器(如视觉编码器、文本编码器)将不同模态的原始输入(例如一张图片和一段描述文字)转换为计算机能理解的、统一的向量表示。这个过程可以类比为将中文、英文、手语都翻译成一种通用的“思想语言”。随后,模型在共享的语义空间中对这些向量进行深度对齐与融合,学习它们之间的内在关联(例如,将“苹果”的文本向量与苹果图片的视觉向量在语义空间中对齐)。最终,模型基于这种融合后的、富含多维度信息的表示进行推理、生成或决策。

多模态模型的应用场景

- 智能内容创作与编辑:用户可以用自然语言指令直接编辑图片或视频(如“把背景换成雪山,并添加一只飞翔的鹰”),或根据一段文字描述自动生成匹配的图片、视频,极大提升了创意工作的效率。

- 具身智能与机器人:机器人通过摄像头(视觉)、麦克风(听觉)和各类传感器(触觉等)综合感知环境,结合语言指令理解任务目标,从而规划出安全、合理的物理动作,实现更自然的人机交互和复杂任务执行。

- 高级分析与辅助决策:在医疗领域,模型可同时分析患者的医学影像(CT/MRI)、电子病历文本和病理报告音频,提供更综合的诊断参考;在自动驾驶中,系统融合摄像头画面、激光雷达点云和地图导航信息,实现对路况的360度理解。

相关术语

理解多模态模型,可关联以下概念:大语言模型、Transformer架构、对比学习、跨模态检索、具身人工智能。

延伸阅读

若想深入了解,建议从OpenAI发布的CLIP(连接文本与图像)、DALL-E(文生图)等经典多模态模型论文入手,同时关注如“视觉-语言预训练”等前沿研究方向,这些资料能系统揭示模型如何实现跨模态的语义对齐与生成。