【AI词典】知识蒸馏 - 模型压缩与知识迁移技术

知识蒸馏:定义

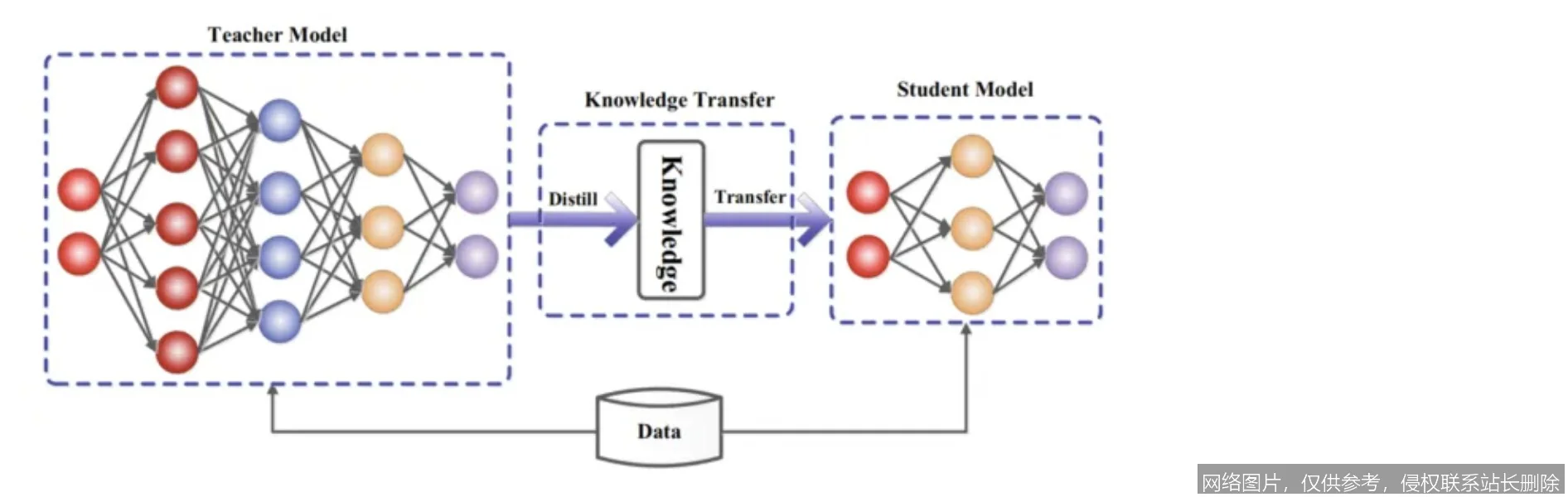

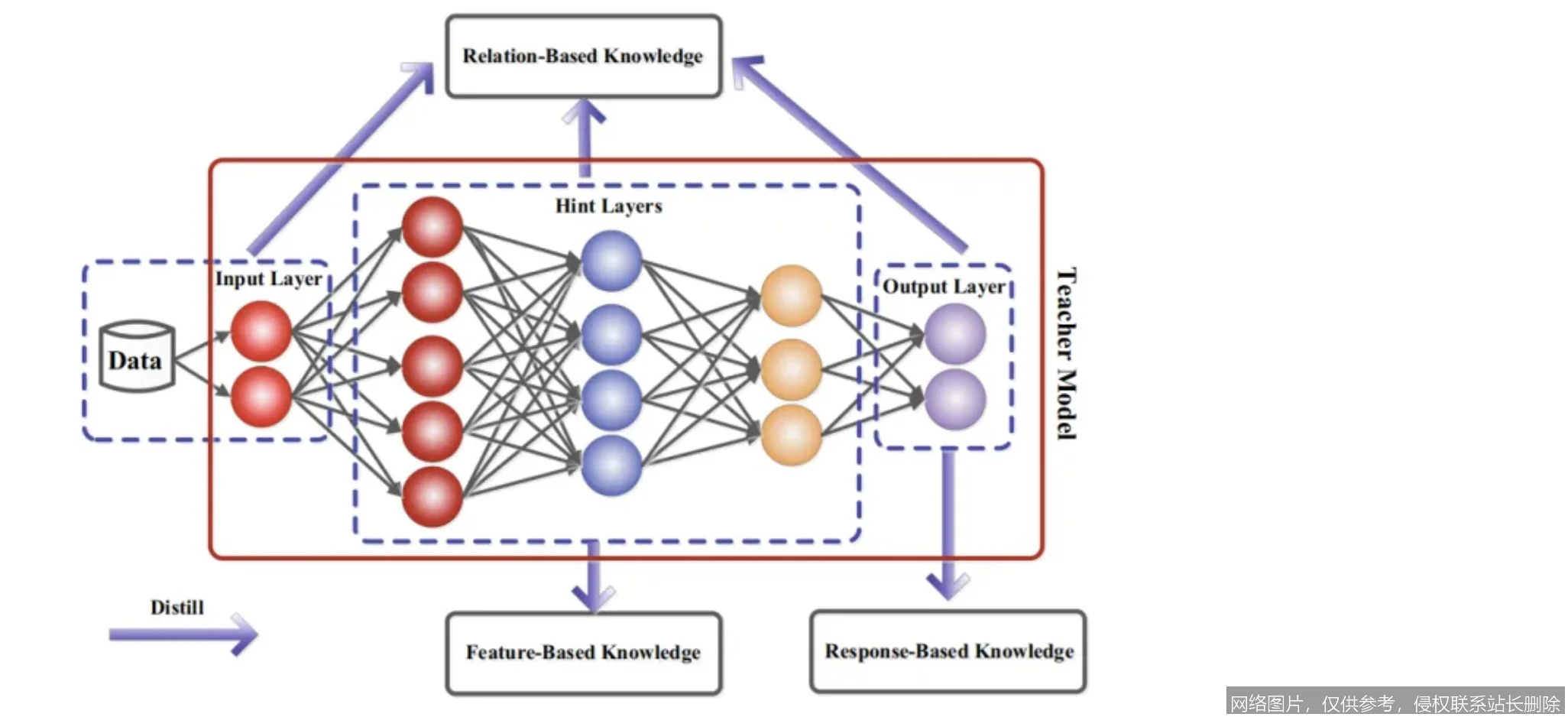

知识蒸馏是一种模型压缩与知识迁移技术,其核心思想是让一个体积小、结构简单的“学生模型”模仿一个庞大而复杂的“教师模型”的行为,从而在保持接近原模型性能的同时,大幅降低模型的计算开销和部署成本。

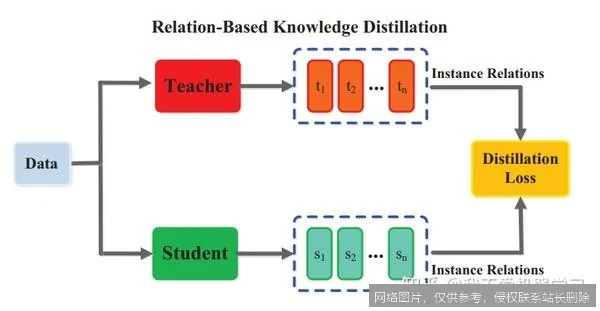

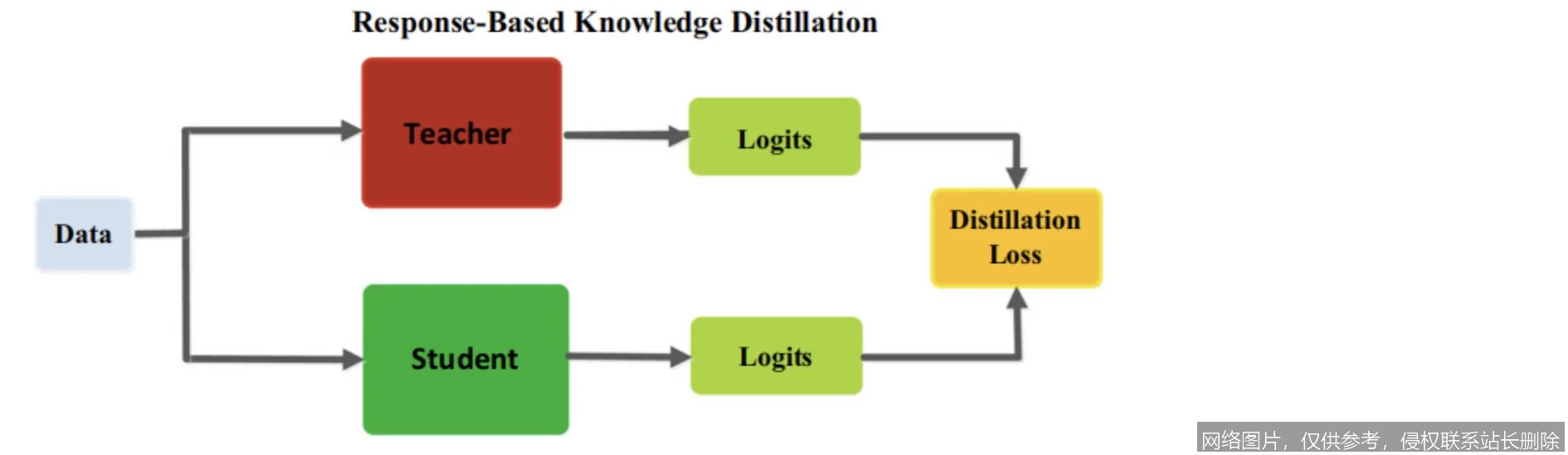

知识蒸馏的工作原理

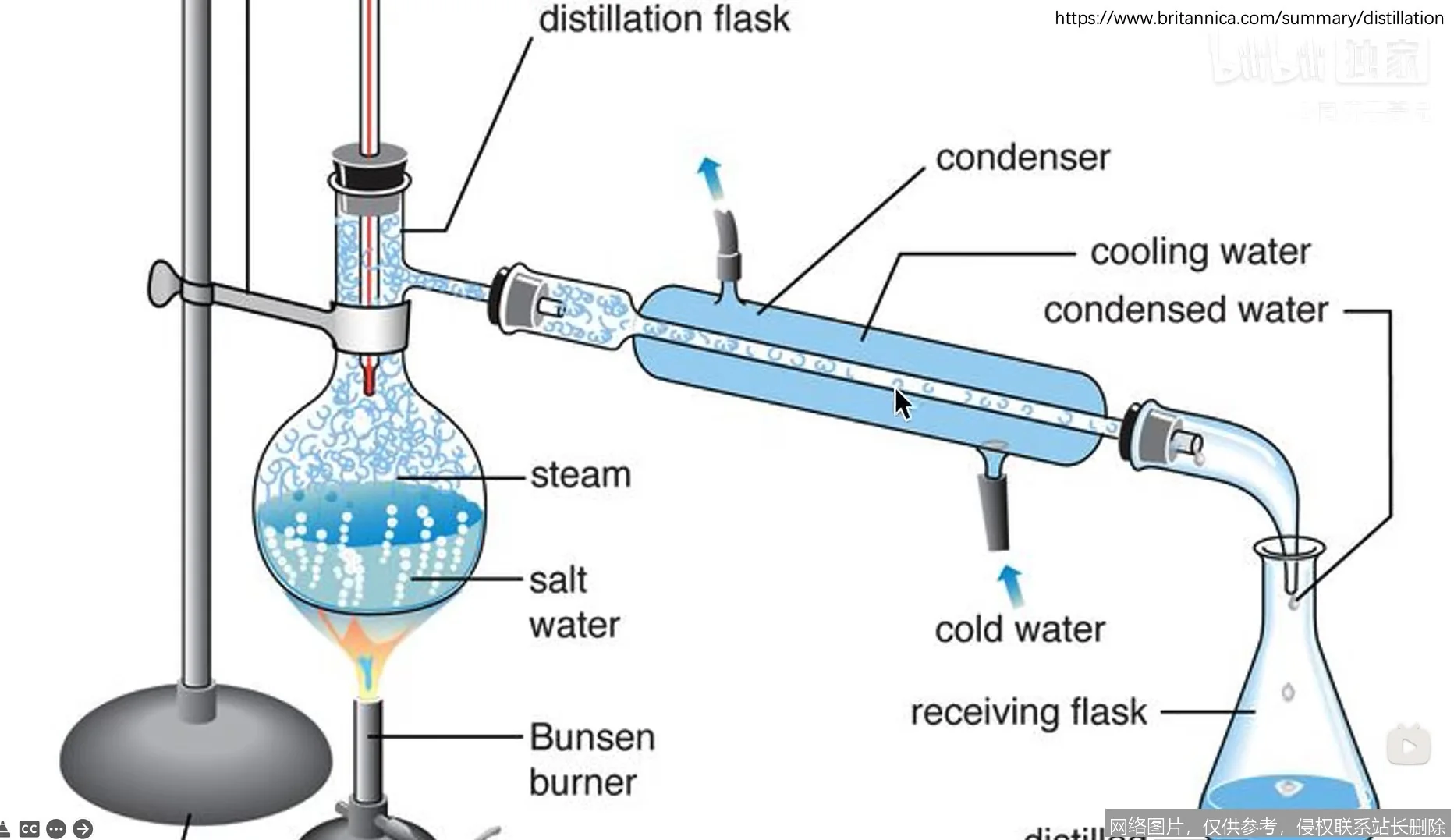

我们可以用一个生动的类比来理解知识蒸馏的原理:想象一位学识渊博的教授(教师模型)在教导一名学生(学生模型)。如果只告诉学生最终的标准答案(即模型的“硬标签”,如“这是一只猫”),学生学到的信息有限。但教授在教学中,往往会传递更丰富的“软知识”——例如,“这有95%的概率是猫,4%的概率是狐狸,1%的概率是狗”。这种概率分布被称为“软标签”或“软目标”,它蕴含了类别间的相似性关系(猫和狐狸在某些特征上更接近)。

在技术实现上,知识蒸馏通常分为两个阶段:首先,教师模型在训练集上进行训练,并输出包含丰富信息的软标签(通过一个较高的“温度”参数产生更平滑的概率分布)。然后,学生模型不再仅仅学习原始数据的硬标签,而是同时学习教师模型输出的软标签以及真实标签。其损失函数由两部分构成:一部分是学生预测与真实标签的交叉熵损失(学生向标准答案学习),另一部分是学生预测的软标签与教师软标签的KL散度损失(学生向教师的“思考方式”学习)。通过这种“师生传承”机制,学生模型能够继承教师模型泛化能力强的优点,甚至在某些情况下实现“青出于蓝”。

知识蒸馏的应用场景

- 移动端与边缘设备部署:将大型自然语言处理模型或计算机视觉模型通过知识蒸馏压缩为轻量级版本,使其能够在手机、嵌入式设备或物联网终端上实时运行,应用于智能语音助手、实时图像识别等场景。

- 工业级模型服务优化:在推荐系统、广告点击率预估等在线服务中,用蒸馏后的小模型替代原始大模型,能够显著降低服务器计算负载和响应延迟,从而节约成本并提升用户体验。

- 集成模型的知识提取:将多个模型(集成模型)的集体智慧蒸馏到一个单一模型中,既保留了集成模型的强大性能,又避免了推理时调用多个模型的计算负担。

相关术语

与知识蒸馏紧密相关的概念包括:模型压缩、教师-学生架构、神经网络剪枝、量化感知训练以及终身学习。其中,知识蒸馏与剪枝、量化同属模型压缩的主流技术路径。

延伸阅读

若想深入了解知识蒸馏,建议从该技术的开创性论文《Distilling the Knowledge in a Neural Network》入手。此外,可以关注其后续变体,如基于注意力机制的蒸馏、自蒸馏等,这些研究进一步拓展了知识迁移的形式与效率。在实践中,主流深度学习框架(如PyTorch, TensorFlow)也提供了实现知识蒸馏流程的相关工具和示例。

已是最新文章

相关推荐

- 【AI词典】知识蒸馏 - 模型压缩与知识迁移技术

- 【AI词典】剪枝Pruning - 精简神经网络模型的方法

- 【AI词典】量化 - 降低模型精度以提升效率

- 【AI词典】参数量 - 机器学习模型中的可调整变量总数

- AIGC:颠覆内容创作的智能革命,未来已来

- Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

- 【AI词典】上下文窗口 - 模型单次处理的最大文本长度

- 【AI词典】幻觉Hallucination - 生成模型输出不实或虚构内容的现象

- 【AI词典】Multi-Agent多智能体 - 多个自主智能体协同工作的系统

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体