Fine-tuning 微调全面解析:从核心原理到 2026 大模型实战应用

一句话定义

Fine-tuning(微调)是指在预训练大模型基础上,利用特定领域数据继续训练,使其从“通才”进化为适应具体任务的“专才”的关键技术。

技术原理:从通用智能到领域专家的进化之路

在人工智能的宏大叙事中,大语言模型(LLM)的诞生标志着我们拥有了具备海量知识的“通才”。然而,让一个读过互联网几乎所有文本的模型去精准诊断医疗报告、撰写符合公司规范的代码或模仿特定作家的文风,往往力不从心。这就引出了本文的核心主角——Fine-tuning(微调)。如果把预训练(Pre-training)比作让一个人读完图书馆里所有的书,获得广博的常识和语言能力,那么微调就是送这个人去医学院、法学院或编程训练营,进行高强度的专业技能特训。

核心工作机制:权重的精细雕刻

从技术底层来看,深度学习模型的本质是一个拥有数千亿甚至万亿参数的复杂函数网络。这些参数(Weights)决定了模型如何处理输入信息并生成输出。预训练阶段,模型通过自监督学习(Self-supervised Learning),在海量无标注数据上调整这些参数,目的是让模型学会预测下一个词,从而掌握语言的语法、逻辑和世界知识。此时,模型的参数分布是“泛化”的,旨在覆盖尽可能多的场景。

微调的过程,本质上是在不破坏模型已有通用能力的前提下,对这部分庞大的参数矩阵进行“精细雕刻”。当我们引入特定领域的标注数据集(Supervised Fine-Tuning, SFT 数据)时,模型会再次启动反向传播算法(Backpropagation)。这一次,损失函数(Loss Function)不再仅仅关注“下一个词是什么”,而是关注“在这个特定语境下,正确的回答应该是什么”。

想象一下,预训练好的模型参数空间是一个巨大的地形图,其中充满了各种山谷和山峰。预训练让模型停在了一个相对平坦、能兼顾多种任务的“高原”上。微调则是利用特定任务的数据作为引力,引导模型在这个高维空间中移动,滑向一个针对该任务误差最小的“深谷”。在这个过程中,模型并没有重新学习语言基础,而是调整了神经连接的权重,使得在面对特定类型的输入时,能够激活特定的神经元路径,从而输出更符合预期的结果。

关键技术组件:高效微调的革命

随着模型规模的指数级增长,全量微调(Full Fine-tuning)——即更新模型所有参数——变得极其昂贵且难以实施。这不仅需要巨大的显存(GPU Memory)来存储优化器状态和梯度,还容易导致“灾难性遗忘”(Catastrophic Forgetting),即模型在学会新任务的同时,忘记了原有的通用知识。为了解决这一痛点,参数高效微调(Parameter-Efficient Fine-Tuning, PEFT)应运而生,成为当前主流的技术范式。

其中最具代表性的技术是 LoRA(Low-Rank Adaptation,低秩自适应)。LoRA 的核心思想极具巧思:它假设模型在适应新任务时,权重的变化其实具有“低秩”特性。换句话说,不需要改动整个巨大的参数矩阵,只需要在原有的冻结参数旁边,挂上两个非常小的低秩矩阵(Adapter)。在训练过程中,大模型的原始参数被完全冻结(不更新),只训练这两个小矩阵。推理时,将小矩阵的权重合并回原模型即可。

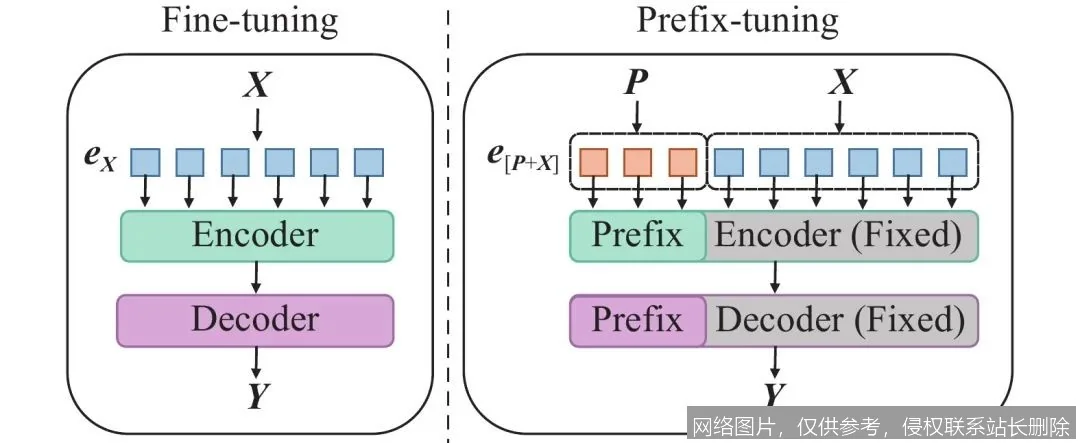

这种机制带来了惊人的效率提升:显存占用可减少数倍,训练速度大幅加快,且不同任务的微调权重可以像插件一样随时热插拔。除了 LoRA,还有 Prompt Tuning(仅优化输入端的提示向量)和 Prefix Tuning 等技术,它们共同构成了现代微调技术的工具箱,使得在消费级显卡上微调百亿参数模型成为可能。

与传统方法的对比:为何微调优于提示工程?

在微调技术普及之前,开发者主要依赖 Prompt Engineering(提示工程) 和 In-Context Learning(上下文学习) 来引导模型。这种方法像是在考试前给考生一张写满解题思路的小抄(Prompt),虽然灵活,但存在明显局限:首先,上下文窗口(Context Window)有限,无法放入大量示例;其次,对于复杂的逻辑推理或高度专业的领域知识,单纯的提示往往难以让模型稳定输出高质量结果,模型容易“胡言乱语”。

相比之下,微调是真正改变了模型的“大脑结构”。它将知识内化到了参数之中,而非仅仅停留在输入层面。微调后的模型具有以下显著优势:

- 稳定性更强:面对同样的问题,微调模型的回答一致性远高于仅靠提示的基座模型。

- 格式可控:可以轻松教会模型输出特定的 JSON 格式、SQL 语句或特定的文档结构,这是提示工程难以完美做到的。

- 知识注入:可以将企业内部的非公开知识库通过微调“刻”入模型,使其成为真正的企业专家,而无需在每次提问时检索大量文档。

- 延迟更低:由于不需要在 Prompt 中携带长长的示例文本,微调模型的输入令牌数更少,推理速度更快,成本更低。

简而言之,提示工程是“临时抱佛脚”,而微调则是“脱胎换骨”。前者适用于探索性任务和简单指令,后者则是构建生产级、高可靠 AI 应用的必经之路。

核心概念:构建微调知识图谱

要深入掌握微调技术,必须厘清一系列关键术语及其相互关系。这些概念构成了微调生态系统的基石,理解它们有助于避免常见的认知误区。

关键术语解析

1. Base Model(基座模型)

指经过大规模预训练,但未针对任何特定任务进行指令对齐的原始模型。基座模型擅长续写文本,但往往不懂得如何回答问题或遵循指令。它是微调的起点,如同未经雕琢的璞玉。

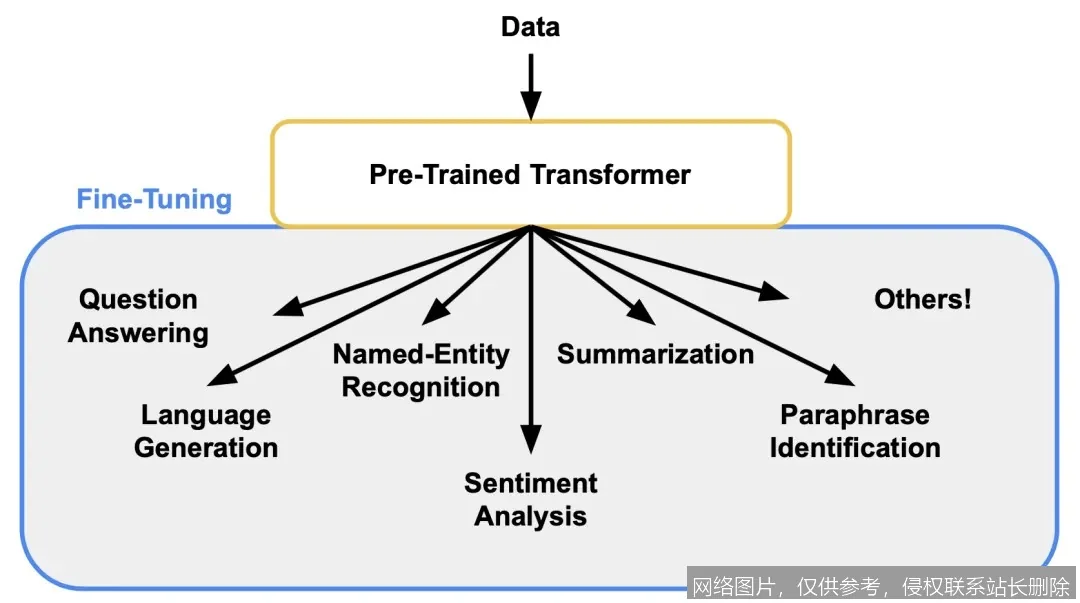

2. Instruction Tuning(指令微调)

这是一种特殊的微调形式,目的是让模型学会听懂人类的指令(如“请总结这篇文章”、“写一首诗”)。通过使用包含“指令 - 输入 - 输出”三元组的数据集进行训练,模型从“文本补全机器”转变为“智能助手”。著名的 Alpaca、Vicuna 等都是指令微调的产物。

3. RLHF (Reinforcement Learning from Human Feedback,基于人类反馈的强化学习)

这是在监督微调(SFT)之后的高级阶段。由于人类偏好是主观的(例如更喜欢简洁、礼貌或有创意的回答),单纯依靠标注数据难以完美对齐。RLHF 通过让人类对模型的多个输出进行打分,训练一个奖励模型(Reward Model),再利用强化学习算法(如 PPO)优化策略模型,使其输出更符合人类价值观。ChatGPT 之所以如此强大,RLHF 功不可没。

4. Catastrophic Forgetting(灾难性遗忘)

这是微调过程中最大的风险之一。指模型在学习新任务数据时,过度拟合新分布,导致原本在预训练阶段学到的通用能力(如常识推理、多语言能力)急剧下降。现代 PEFT 技术和混合数据训练策略(在新数据中混入少量通用数据)是缓解这一问题的主要手段。

5. Checkpoint(检查点)

在训练过程中定期保存的模型状态快照。由于微调过程可能存在过拟合或发散,保留多个检查点允许开发者回滚到最佳性能的时刻,是实验迭代中的重要安全网。

概念关系图谱

微调的完整流程可以看作是一个层层递进的金字塔结构:

- 底层:Pre-training(预训练) → 产出 Base Model。

- 中层:SFT(监督微调) → 利用高质量标注数据,产出 Instruction Model,解决“听得懂”的问题。

- 高层:RLHF/DPO(对齐优化) → 利用人类偏好数据,产出 Aligned Chat Model,解决“答得好”的问题。

在这个链条中,PEFT/LoRA 是贯穿中高层的技术加速引擎,而 Dataset Curation(数据策展) 则是决定最终效果的上限因素。许多初学者误以为只要有了好算法就能成功,实则“数据质量决定模型智商”,脏数据只会训练出“人工智障”。

常见误解澄清

误解一:“微调可以让模型学会它完全不知道的新知识。”

澄清:微调主要作用是激发和重组模型已有的知识,或者学习新的映射关系(格式、风格、特定领域术语)。如果某个事实完全不在基座模型的知识范围内(例如昨天刚发生的新闻,且基座训练截止于去年),单纯微调很难让其凭空“创造”出准确事实,这时通常需要结合 RAG(检索增强生成) 技术。

误解二:“数据越多越好。”

澄清:在微调领域,数据的质量远重于数量。几千条精心清洗、逻辑严密的高质量指令数据,往往胜过几十万条噪声数据。过量且低质的数据会导致严重的过拟合,使模型变成只会死记硬背的“复读机”。

误解三:“微调是一次性的工作。”

澄清:模型的生命周期是动态的。随着业务场景的变化、用户反馈的积累以及基座模型的迭代,微调是一个持续迭代(Continuous Fine-tuning)的过程,需要建立数据飞轮,不断用新的真实交互数据反哺模型。

实际应用:从实验室到 2026 年的产业落地

微调技术早已走出学术论文,成为各行各业构建垂直领域 AI 应用的核心引擎。从客服机器人到代码辅助,从法律分析到医疗诊断,微调正在重塑生产力。

典型应用场景

1. 垂直领域客服与销售

通用大模型虽然博学,但不懂企业的具体产品政策、退换货流程或独特的沟通话术。通过微调,企业可以将内部知识库、历史优秀客服对话记录转化为训练数据,打造出既懂业务又懂情感的专属客服。这类模型不仅能准确回答复杂问题,还能模仿金牌销售的语言风格,显著提升转化率。

2. 代码生成与私有化部署

GitHub Copilot 等工具的背后离不开微调。对于大型企业,代码安全和规范至关重要。通过在企业内部代码库上进行微调,模型可以学习到公司特有的架构模式、命名规范和安全禁忌,生成的代码不仅可用,而且合规。此外,结合量化技术和 LoRA,这些代码模型可以被部署在本地服务器,确保核心资产不出域。

3. 医疗与法律文书处理

在医疗和法律领域,准确性就是生命。通用模型容易产生幻觉(Hallucination)。通过利用专业教材、判例库和专家标注数据进行深度微调,模型可以学会严谨的推理逻辑,输出符合行业标准的诊断建议或合同条款,并能够以结构化格式(如 HL7 标准)输出,直接对接医院信息系统。

4. 个性化内容创作与游戏 NPC

在游戏和元宇宙场景中,每个 NPC(非玩家角色)都需要独特的性格、口癖和背景故事。利用微调技术,开发者可以为成千上万个角色训练轻量级的 LoRA 适配器,使它们拥有截然不同的灵魂,提供千人千面的互动体验,而无需维护数千个独立的大模型。

代表性产品与项目案例

Llama Factory:这是一个开源的一站式大模型微调平台,支持包括 Llama 3、Qwen、Yi 等主流模型。它极大地降低了微调门槛,提供了可视化的界面和丰富的预设配置,让研究者只需几行命令即可完成从数据预处理到模型评估的全流程,是目前社区最活跃的微调工具之一。

Hugging Face Adapters:作为全球最大的 AI 社区,Hugging Face 推动了“模型即插件”的理念。用户上传自己微调好的 LoRA 权重,其他人可以直接下载并加载到基座模型上使用。这种共享生态加速了垂直模型的爆发式增长。

Microsoft Phi 系列:微软推出的 Phi 系列小模型证明了“数据质量 > 模型规模”。通过使用教科书级别的高质量合成数据进行微调,参数量仅为几十亿的小模型,在逻辑推理和代码能力上竟能媲美千亿参数的巨无霸。这为端侧设备(手机、PC)运行高性能 AI 指明了方向。

使用门槛与 2026 年实战展望

当前,微调的门槛已大幅降低。借助云服务商(如 AWS SageMaker, Azure ML)和开源框架,拥有一张高端消费级显卡(如 RTX 4090)即可开始 7B-14B 参数模型的微调实验。然而,真正的挑战在于数据工程能力和评估体系的构建。

展望 2026 年,微调技术将呈现以下实战趋势:

- 自动化微调(Auto-FineTuning):AI 将自动筛选最佳训练数据、搜索最优超参数组合,甚至自动判断何时停止训练以防止过拟合,实现“一键微调”。

- 多模态深度融合:微调将不再局限于文本,而是同时处理图像、音频和视频。未来的模型将通过微调学会“看图说话”、“听音辨意”,在工业质检、视频监控等领域大展身手。

- 端侧个性化:随着手机和 PC NPU 算力的提升,每个人的设备上都将运行一个经过个人数据微调的私人模型。它记得你的习惯、偏好和工作流,成为真正的数字分身,且数据永远留在本地,隐私得到极致保护。

- 动态持续学习:模型将具备在线学习能力,能够在不重新全量训练的情况下,实时吸收新知识,适应环境变化,彻底解决灾难性遗忘问题。

延伸阅读:通往专家之路

微调是大模型时代的一项基本功,但要精通此道,还需要构建更广阔的知识体系。以下是为不同阶段学习者准备的进阶指南。

相关概念推荐

在掌握微调后,建议进一步探索以下紧密相关的领域:

- RAG (Retrieval-Augmented Generation,检索增强生成):解决模型知识滞后和幻觉问题的另一大支柱,常与微调结合使用(RAG+Fine-tuning)。

- Prompt Engineering (提示工程):虽然微调强大,但优秀的提示词设计依然是低成本激发模型潜力的首选,两者相辅相成。

- Model Quantization (模型量化):将模型精度从 FP16 降至 INT8 或 INT4,是微调和部署落地的关键配套技术,能显著降低硬件成本。

- LLM Ops:大模型的运维体系,涵盖从数据管理、微调训练、监控评估到版本迭代的完整生命周期管理。

进阶学习路径

第一阶段:理论基础

深入理解 Transformer 架构、注意力机制(Attention Mechanism)以及反向传播算法。推荐阅读《Attention Is All You Need》论文及吴恩达(Andrew Ng)关于深度学习的课程。

第二阶段:动手实践

选择一个开源基座模型(如 Llama 3 或 Qwen),使用 Hugging Face Transformers 库和 PEFT 库,在公开数据集(如 Alpaca Data)上完成第一次 LoRA 微调。尝试调整学习率、Batch Size 等超参数,观察对结果的影响。

第三阶段:数据工程与评估

学习如何清洗、构造高质量的指令数据集。掌握自动化评估指标(如 BLEU, ROUGE)以及基于大模型的评估方法(LLM-as-a-Judge)。理解如何设计实验来验证微调是否真的提升了业务指标。

第四阶段:前沿探索

关注 DPO(Direct Preference Optimization)、ORPO 等最新的对齐算法,研究多模态微调技术,并尝试在资源受限的边缘设备上部署微调模型。

推荐资源与文献

经典论文:

- "LoRA: Low-Rank Adaptation of Large Language Models" (Hu et al., 2021) - PEFT 领域的奠基之作。

- "Scaling Laws for Neural Language Models" (Kaplan et al., 2020) - 理解模型规模与数据关系的必读文献。

- "Direct Preference Optimization: Your Language Model is Secretly a Reward Model" (Rafailov et al., 2023) - 替代 RLHF 的高效对齐新范式。

实战工具与平台:

- Hugging Face: 全球最大模型社区,提供海量预训练模型、数据集和 Demo 空间。

- Llama Factory: 极简主义的高效微调框架,适合快速上手。

- DeepSpeed / Megatron-LM: 微软和英伟达推出的分布式训练框架,适合超大规模模型的微调。

在线课程与社区:

- DeepLearning.AI 的 "Fine-Tuning Large Language Models" 专项课程。

- Hugging Face 官方提供的免费 NLP Course。

- PaperWithCode 网站,追踪最新的微调算法及其代码实现。

微调不仅是技术的调整,更是思维的转变。它让我们意识到,通用人工智能的未来不在于单一的全能模型,而在于“基座 + 微调”的生态繁荣。通过掌握这项技术,你将拥有将通用智能转化为具体生产力的钥匙,开启属于你自己的 AI 创新之旅。

已是最新文章

相关推荐

- Fine-tuning 微调全面解析:从核心原理到 2026 大模型实战应用

- 【AI词典】Fine-tuning微调 - 预训练模型的针对性优化

- 【AI词典】Embedding - 将数据映射为低维向量的技术

- 【AI词典】Token - 文本处理的基本语义单元

- 【AI词典】BERT - 谷歌预训练语言理解模型

- 【AI词典】GPT - 生成式预训练Transformer模型

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型