【AI词典】视觉语言模型VLM - 能同时理解图像与文本的AI模型

AI词典2026-04-21 16:00:00

视觉语言模型VLM:定义

视觉语言模型(Visual Language Model, VLM)是一种能够同时处理和理解图像与文本信息,并建立两者间深度关联的人工智能模型。它突破了传统单模态模型的局限,实现了跨模态的语义对齐与推理。

视觉语言模型VLM的工作原理

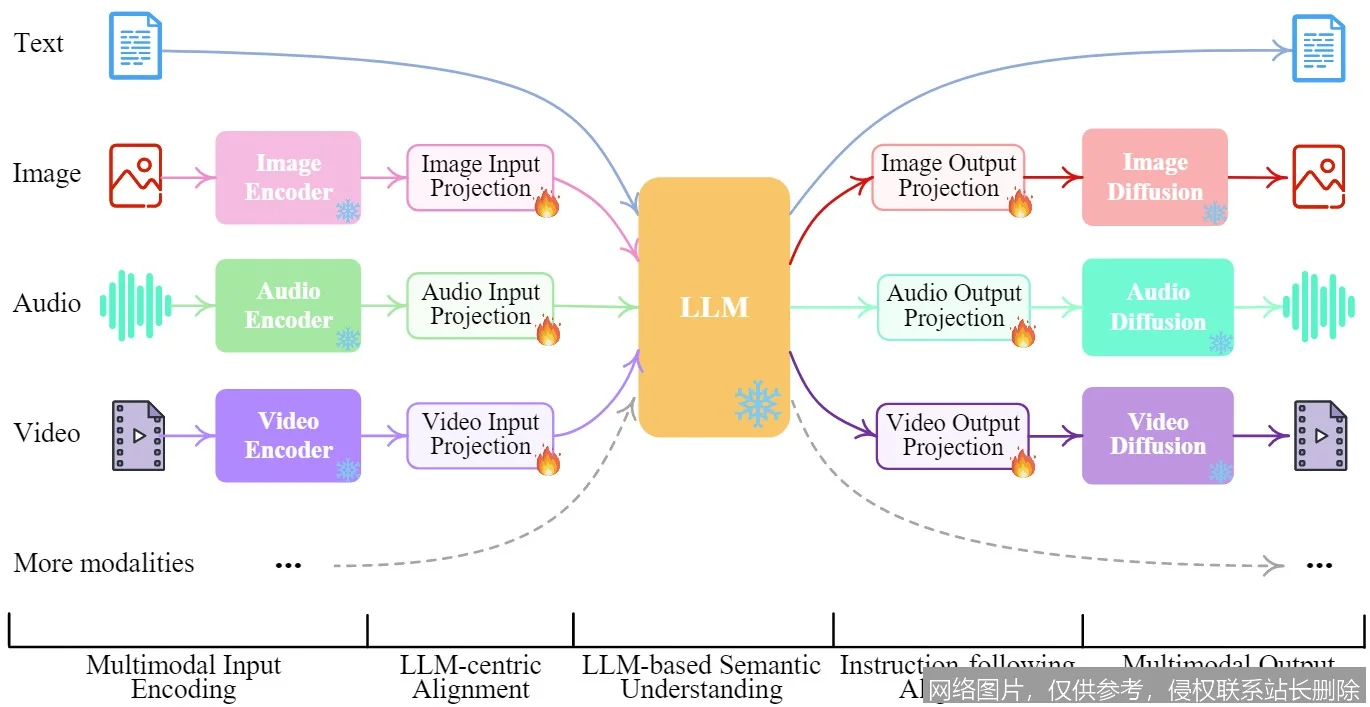

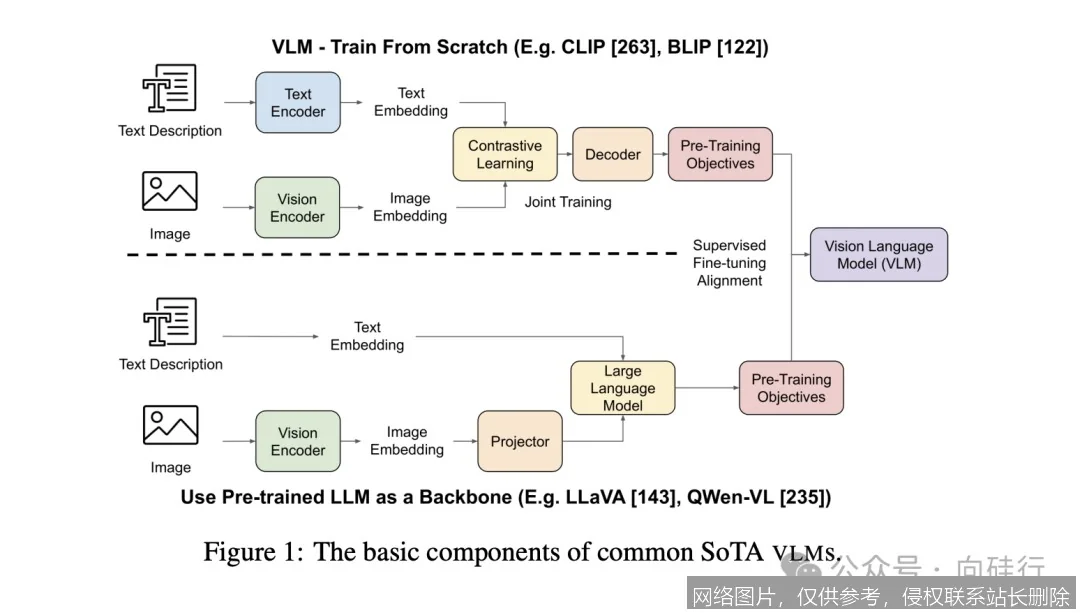

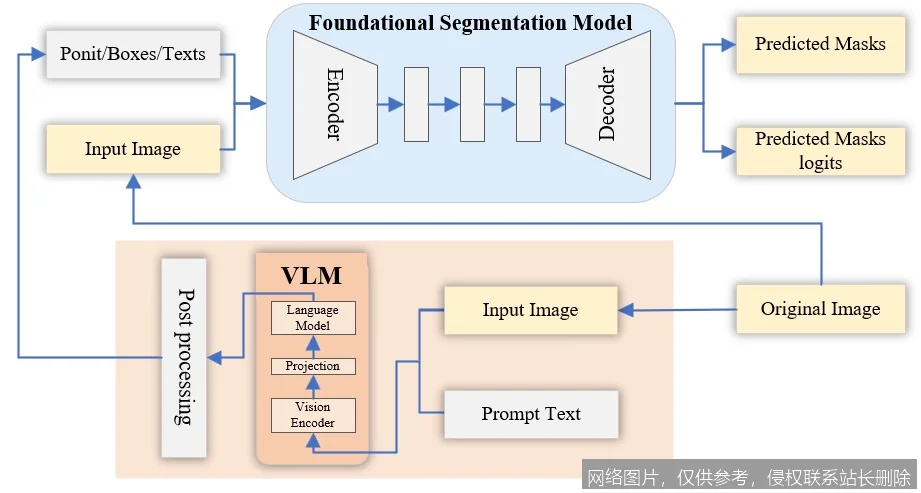

VLM的工作原理可类比为一个精通“看图说话”和“听描述画画”的双语专家。其核心流程分为三步:首先,模型通过视觉编码器(如ViT)将输入图像“翻译”成一系列机器可读的视觉特征向量;同时,通过文本编码器处理文本信息。其次,这些来自不同模态的特征被映射到一个共享的语义空间,在此空间中,描述同一事物的图像特征和文本特征会彼此靠近。最后,一个强大的解码器(通常基于Transformer架构)基于对齐后的多模态信息进行理解、推理并生成响应,例如回答关于图片的问题或用文字描述图片内容。

视觉语言模型VLM的应用场景

- 智能视觉问答与交互:用户可直接上传图片并向模型提问,例如“图中这个人手里拿的是什么工具?”或“请根据这张图表总结趋势”。VLM能理解图像细节并结合常识给出准确回答,广泛应用于教育辅助、盲人导航、电商客服等领域。

- 多模态内容生成与编辑:VLM可根据一段文字描述生成或编辑对应图像,也能为给定图像生成标题、营销文案或详细报告。这大幅提升了创意设计、广告制作、自媒体内容生产的效率。

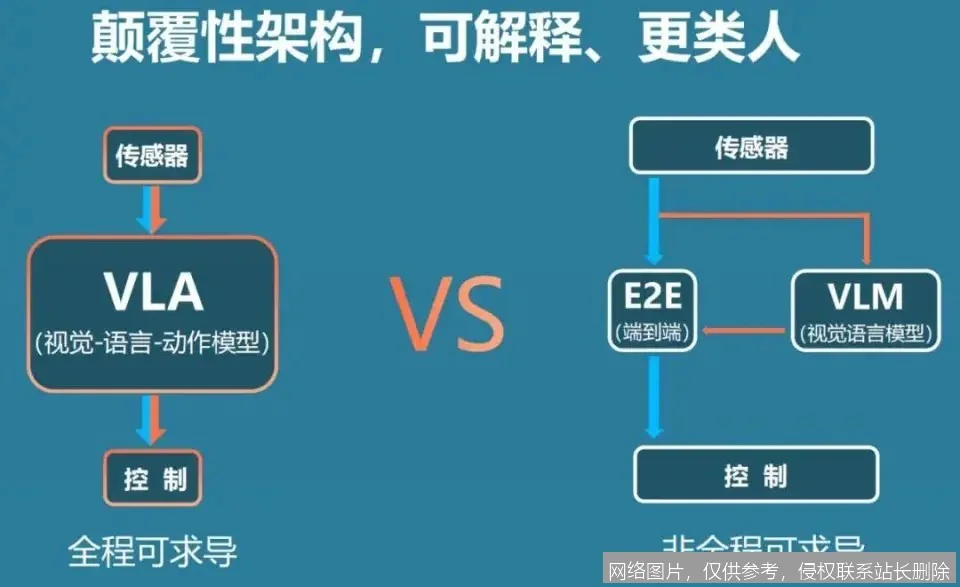

- 复杂环境感知与决策:在自动驾驶、机器人、工业质检等场景中,VLM能综合分析摄像头捕捉的视觉场景和传感器文本日志,理解“前方施工标志”与“绕行指令”间的关联,做出更安全、更符合上下文环境的决策。

相关术语

与视觉语言模型VLM密切相关的概念包括:多模态学习、Transformer架构、对比学习、图像描述生成以及大语言模型。

延伸阅读

若想深入了解VLM,建议从经典的模型架构论文入手,例如OpenAI的CLIP和Google的Flamingo。同时,关注多模态学习领域的顶级会议(如NeurIPS, ICML, CVPR)的最新研究,可以掌握该领域的前沿动态与发展趋势。