【AI词典】剪枝Pruning - 精简神经网络模型的方法

AI词典2026-04-20 18:48:00

剪枝Pruning:神经网络模型的“精简术”

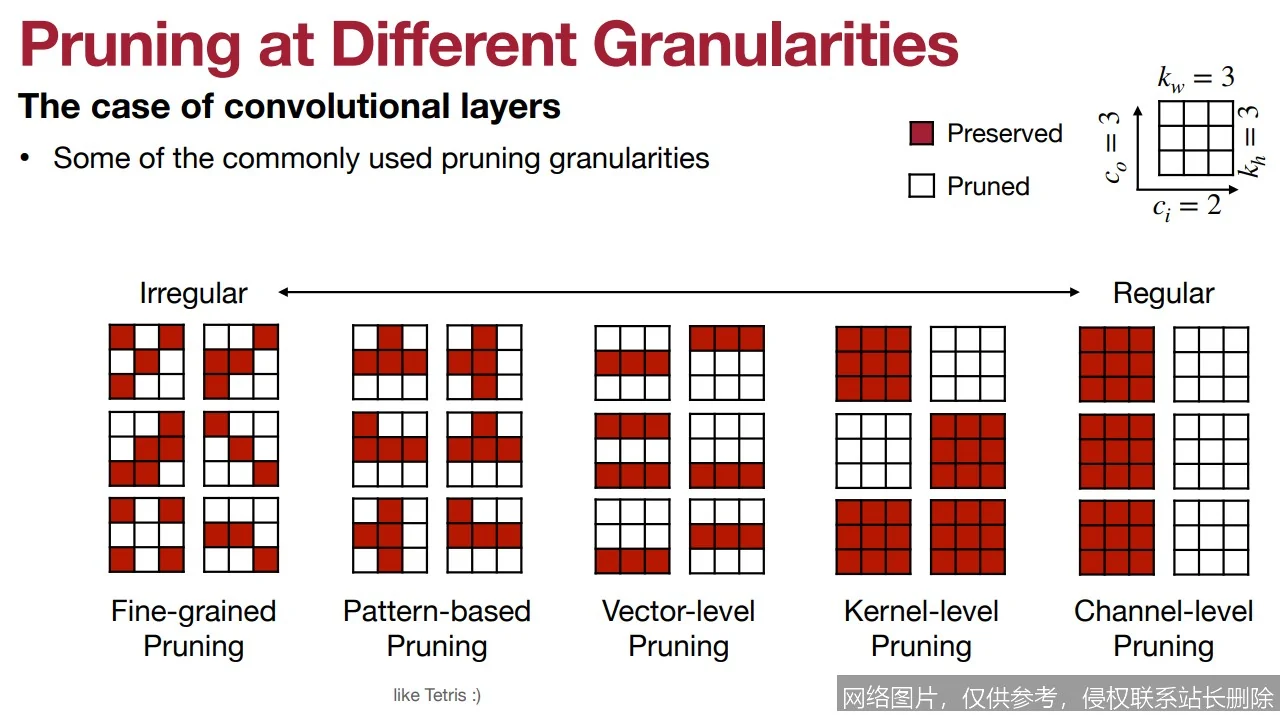

剪枝(Pruning)是神经网络模型压缩的一种核心技术,旨在识别并移除网络中冗余或不重要的连接(权重)、神经元乃至整个层,从而在保持模型性能基本不变的前提下,显著减小模型规模、降低计算复杂度和能耗。

原理:如何实现模型的“瘦身”?

可以将一个训练好的神经网络想象成一棵枝繁叶茂的大树。虽然枝叶众多,但并非所有枝条都对开花结果(模型输出)至关重要。有些枝条(连接权重)可能非常细小,贡献微乎其微;有些叶子(神经元)可能长期处于休眠状态。剪枝的过程,就是系统性地评估这棵“树”的每个部分的重要性,然后修剪掉那些贡献度低的枝叶。

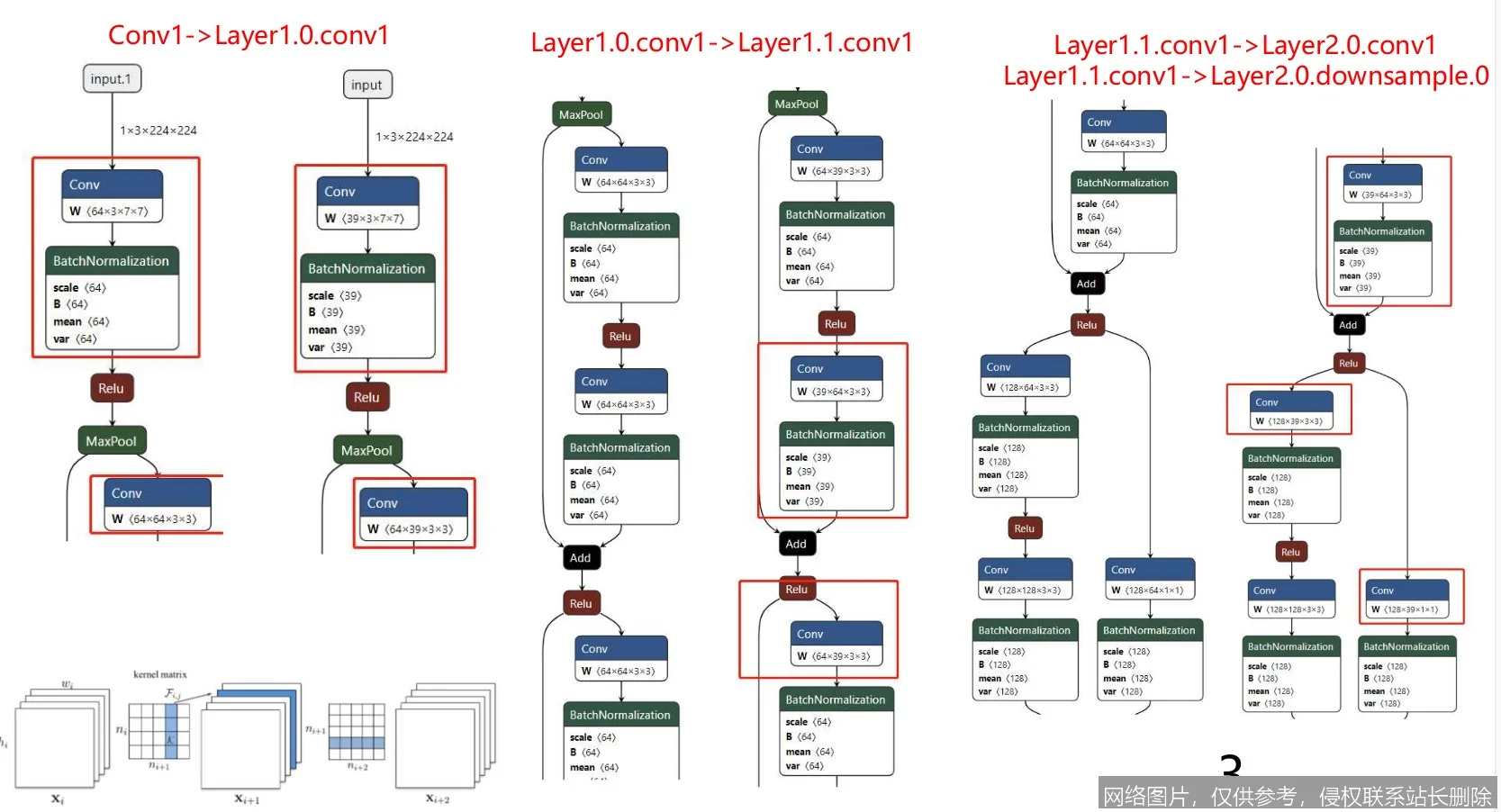

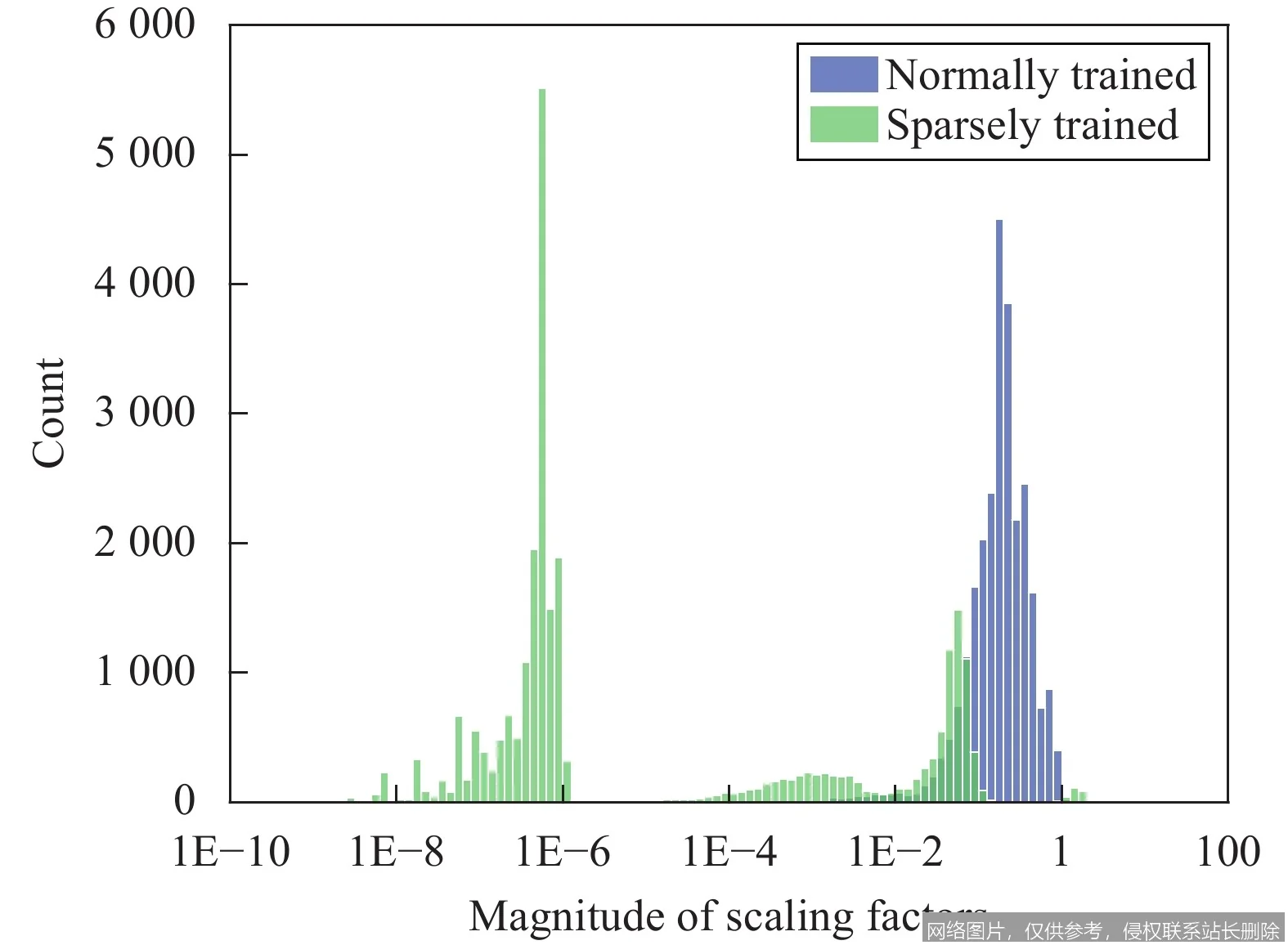

其工作流程通常分为三步:首先,训练一个大型的、过参数化的原始网络;其次,根据预设的准则(如权重绝对值大小、神经元激活稀疏度等)评估网络参数的重要性,并移除低于阈值者;最后,对修剪后的“稀疏”网络进行微调,以恢复因剪枝可能损失的精度。这个过程可以迭代进行,逐步达到理想的精简度。

应用场景:何处需要模型精简?

- 移动端与边缘设备部署:在智能手机、物联网设备或自动驾驶汽车上,计算资源、内存和电量都受限。通过剪枝大幅压缩后的模型,能够实现高效的本地化实时推理,减少对云端的依赖和通信延迟。

- 降低服务器推理成本:对于大型互联网服务(如搜索引擎、内容推荐、实时翻译),即使模型精度轻微下降0.1%,其带来的计算资源节省和响应速度提升,也能转化为巨大的运营成本节约和更好的用户体验。

- 加速模型研究与迭代:研究人员可以使用剪枝技术,快速从一个大型通用模型中“雕刻”出更小巧、更专注于特定任务的子网络,这比从头训练一个小模型更高效,有助于探索网络架构的本质。

相关术语

与剪枝紧密相关的概念包括:模型压缩、量化、知识蒸馏、稀疏神经网络、网络架构搜索以及正则化。

延伸阅读

若想深入了解,可查阅深度学习经典教材中关于模型优化的章节,或研读Song Han等人的论文《Learning both Weights and Connections for Efficient Neural Networks》,该文献是深度学习模型剪枝领域的奠基性工作之一。此外,关注主流深度学习框架(如PyTorch、TensorFlow)中提供的模型优化工具库也是很好的实践途径。

下一篇

已是最新文章

相关推荐

- 【AI词典】剪枝Pruning - 精简神经网络模型的方法

- 【AI词典】量化 - 降低模型精度以提升效率

- 【AI词典】参数量 - 机器学习模型中的可调整变量总数

- AIGC:颠覆内容创作的智能革命,未来已来

- Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

- 【AI词典】上下文窗口 - 模型单次处理的最大文本长度

- 【AI词典】幻觉Hallucination - 生成模型输出不实或虚构内容的现象

- 【AI词典】Multi-Agent多智能体 - 多个自主智能体协同工作的系统

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体

- 【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术