【AI词典】参数量 - 机器学习模型中的可调整变量总数

AI词典2026-04-20 16:00:00

定义

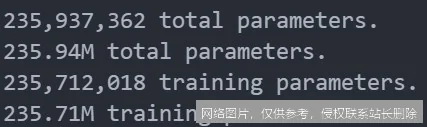

参数量(Parameters)是构成机器学习模型核心架构的可调整变量总数,它直接决定了模型从数据中学习和存储知识的能力与容量。

原理

可以将一个机器学习模型想象成一个极其复杂的数学函数。这个函数内部有无数个“旋钮”,每个“旋钮”就是一个参数。在训练过程中,算法通过海量数据不断微调这些“旋钮”的角度,目标是找到一组特定的参数组合,使得模型能最准确地完成预测或分类任务。例如,在一个简单的线性模型 y = wx + b 中,权重 w 和偏置 b 就是它的两个参数。而在深度神经网络中,这些参数则体现为神经元之间连接的权重和偏置,其数量可能达到数百万、数十亿甚至万亿级别。

应用场景

- 大语言模型(LLM)规模衡量:参数量是评估大语言模型(如GPT、PaLM系列)规模与复杂度的核心指标。更高的参数量通常意味着模型拥有更强的语言理解、生成和推理潜力,但也对计算资源和数据提出了更高要求。

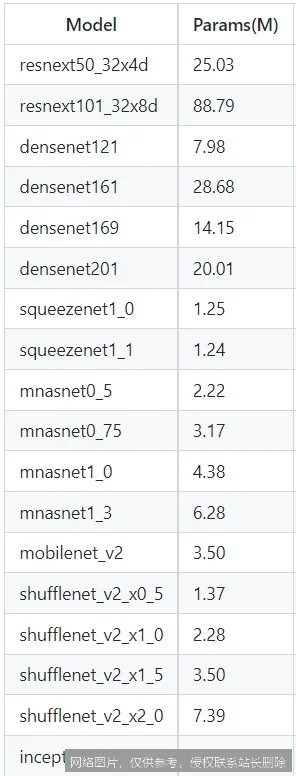

- 计算机视觉模型设计:在图像识别、目标检测等任务中,卷积神经网络(CNN)的参数量直接影响其捕捉图像特征(如边缘、纹理)的精细程度。工程师需要在参数量(模型性能)与计算效率之间进行权衡,设计适合移动端或服务器端的模型。

- 模型压缩与优化:在将模型部署到手机、嵌入式设备等资源受限的环境中时,工程师常通过剪枝、量化等技术减少模型的参数量,在基本保持性能的同时,显著降低模型体积和推理能耗。

相关术语

模型规模(Model Scale)、

计算量(FLOPs)、

过拟合(Overfitting)、

神经网络权重(Weights)、

模型训练(Model Training)

延伸阅读

若想深入理解参数量与模型能力的关系,可以探索“缩放定律”(Scaling Laws),它系统性地研究了模型性能如何随参数量、数据量和计算量增长而变化。同时,了解Transformer架构如何组织其海量参数,是理解现代大模型为何强大的关键。

相关推荐

- 【AI词典】量化 - 降低模型精度以提升效率

- 【AI词典】参数量 - 机器学习模型中的可调整变量总数

- AIGC:颠覆内容创作的智能革命,未来已来

- Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

- 【AI词典】上下文窗口 - 模型单次处理的最大文本长度

- 【AI词典】幻觉Hallucination - 生成模型输出不实或虚构内容的现象

- 【AI词典】Multi-Agent多智能体 - 多个自主智能体协同工作的系统

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体

- 【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术

- 【AI词典】Chain-of-Thought思维链 - 分步推理的提示方法