【AI词典】量化 - 降低模型精度以提升效率

量化(Quantization)的定义

量化(Quantization)是一种通过降低神经网络模型中数值的表示精度(如从32位浮点数转换为8位整数),来压缩模型体积、提升计算与推理效率的核心模型优化技术。其核心目标是在尽可能保持模型性能的前提下,实现模型在资源受限环境(如移动设备、边缘计算芯片)中的高效部署。

量化是如何工作的?

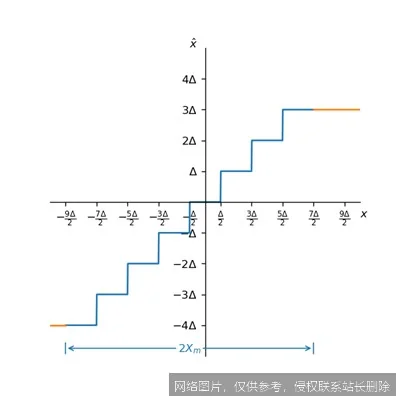

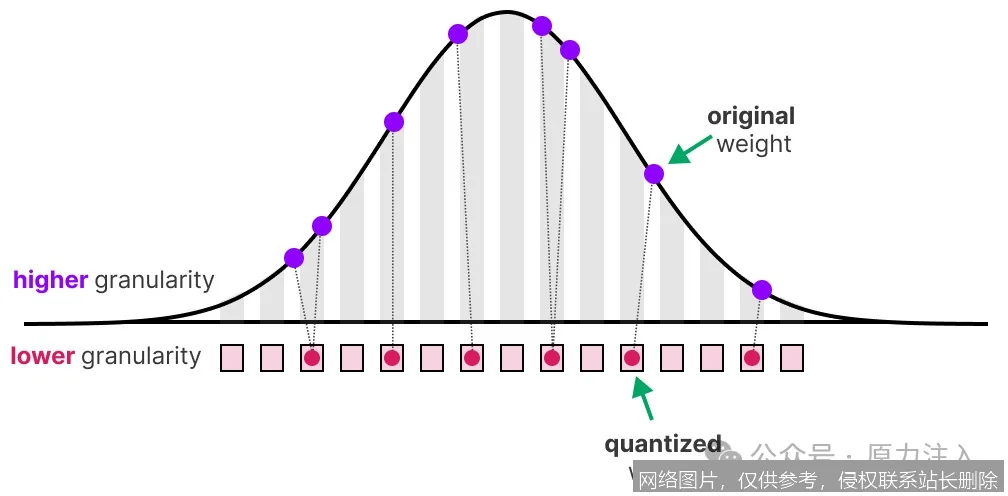

可以将量化过程想象为将一张高清彩色照片转换为文件体积更小的网络表情包。原始神经网络模型中的权重和激活值通常使用高精度的浮点数(如FP32)存储和计算,这好比照片保留了丰富的色彩和细节。量化则将这些连续的浮点数值,映射到一个有限的、离散的整数集合(如INT8)上,类似于将千万种颜色缩减为256色。这个过程主要包含两个关键步骤:

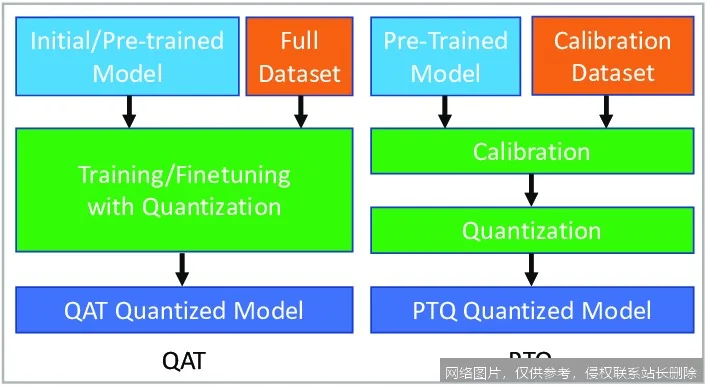

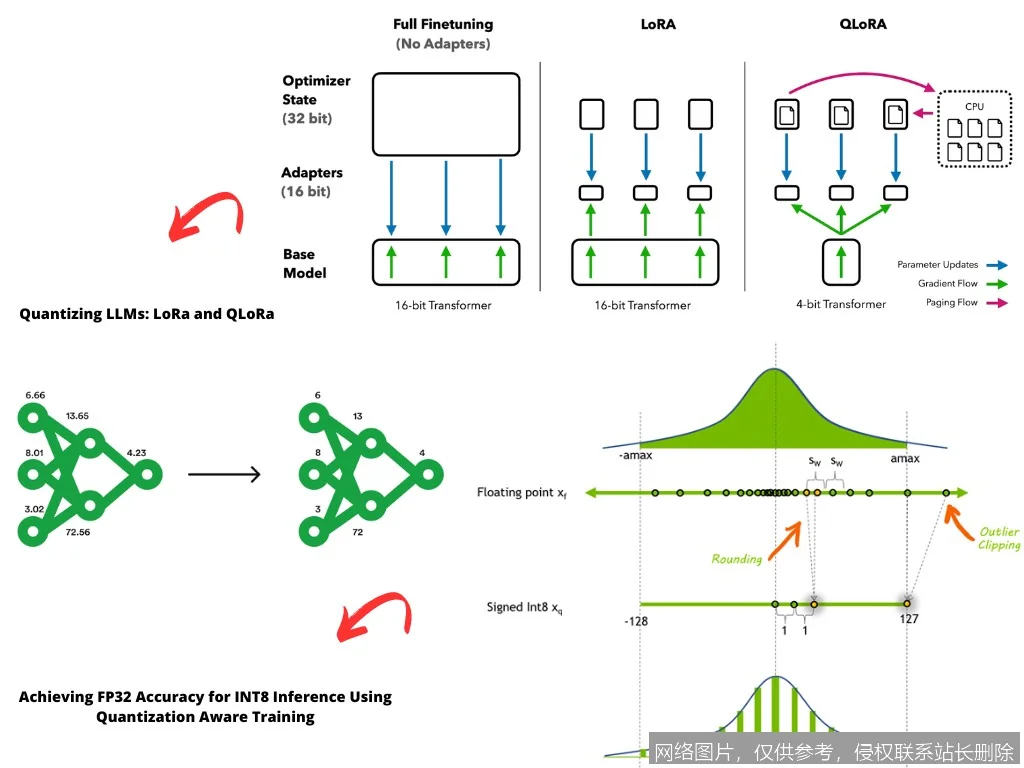

首先,确定浮点数范围的“缩放因子”和“零点偏移”,建立一个从浮点数到整数的线性映射公式。然后,根据此公式将所有浮点参数转换为低精度整数。在推理时,计算主要在整数域进行,大幅减少了内存带宽需求和计算开销。为了弥补精度损失带来的性能下降,通常会采用“训练后量化”或更精细的“量化感知训练”等技术。

量化的主要应用场景

- 移动端与边缘AI部署:这是量化技术最主要的应用领域。通过将大型模型量化,可以使其在智能手机、物联网设备、自动驾驶车载芯片等算力和内存受限的终端上实时运行,实现人脸解锁、语音助手、实时图像处理等功能,同时保护用户数据隐私。

- 大规模模型云端服务:对于提供AI服务的云厂商,对部署的模型进行量化能显著降低服务器GPU内存占用,从而在单张显卡上同时运行更多模型实例,提升服务吞吐量并降低单位计算成本,最终使API调用更快速、更经济。

- 加速研究与迭代:研究人员和开发者可以利用量化技术,在个人电脑或小型工作站上快速验证大型模型(如大语言模型)的推理效果,缩短实验周期。量化后的模型也更容易分享和传播。

相关术语

与量化紧密相关的概念包括:剪枝(移除模型中不重要的连接)、知识蒸馏(用大模型指导小模型训练)、神经架构搜索(自动设计高效网络结构)、低秩分解以及 混合精度训练。

延伸阅读

若想深入了解量化,建议从谷歌发布的《Quantization and Training of Neural Networks for Efficient Integer-Arithmetic-Only Inference》论文入手,这是该领域的奠基性工作之一。同时,可以查阅主流深度学习框架(如TensorFlow的TensorFlow Lite、PyTorch的Torch.ao.quantization)的官方文档和教程,通过实践掌握后训练量化与量化感知训练的具体实现。

相关推荐

- 【AI词典】剪枝Pruning - 精简神经网络模型的方法

- 【AI词典】量化 - 降低模型精度以提升效率

- 【AI词典】参数量 - 机器学习模型中的可调整变量总数

- AIGC:颠覆内容创作的智能革命,未来已来

- Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

- 【AI词典】上下文窗口 - 模型单次处理的最大文本长度

- 【AI词典】幻觉Hallucination - 生成模型输出不实或虚构内容的现象

- 【AI词典】Multi-Agent多智能体 - 多个自主智能体协同工作的系统

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体

- 【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术