【AI词典】Tokenizer分词器 - 将文本拆分为基本单元的工具

Tokenizer分词器:定义

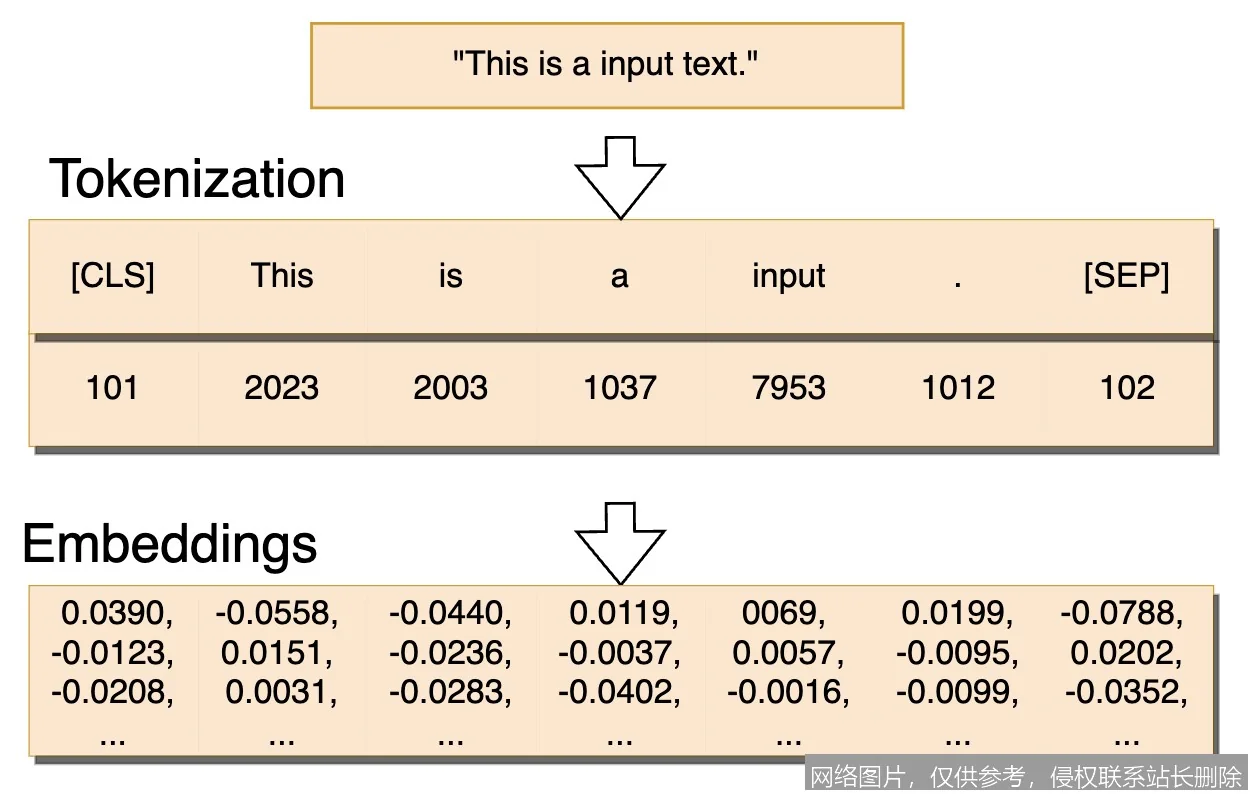

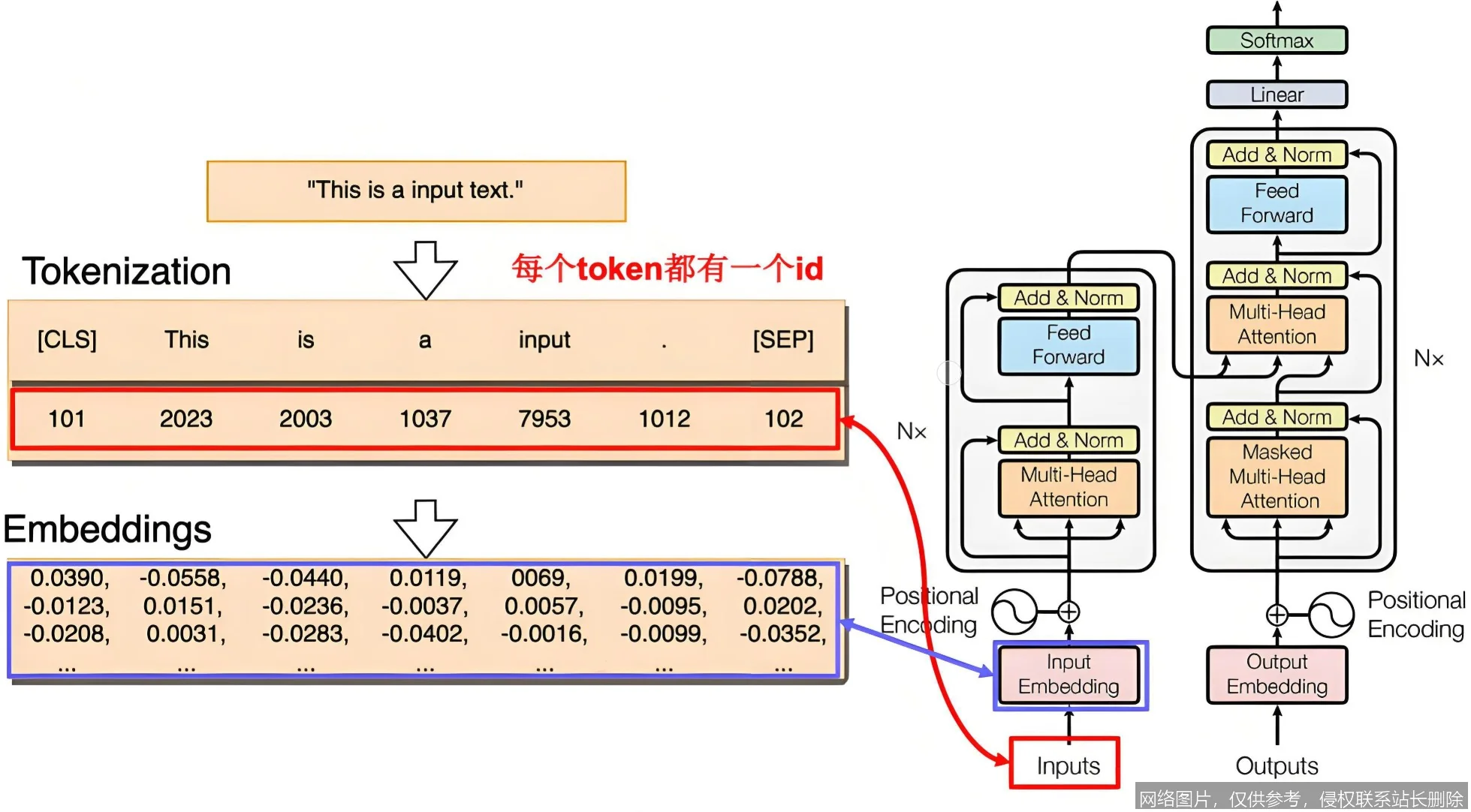

Tokenizer分词器是自然语言处理(NLP)中的基础组件,其核心功能是将连续的文本序列拆解成更小的、有语义的基本处理单元,这些单元被称为“词元”(Token)。它是文本数据进入任何AI模型(如大语言模型)进行理解、训练或生成前,必不可少的第一步预处理工序。

Tokenizer分词器的工作原理

你可以将Tokenizer想象成一个精通多国语言、且拥有多种切割工具的“文本工匠”。它处理文本并非简单地按空格切割,而是依据预设的规则和算法,在字符、子词或单词级别进行划分。主要方法包括:

1. 基于空格/标点的分词:最简单的方式,适用于英语等以空格分隔单词的语言,但无法处理“don't”这类缩写或中文无空格的情况。

2. 基于词典的分词:(常用于中文)拥有一个庞大的词库,通过最大匹配等算法,将句子与词库匹配来切分词语,例如将“人工智能”视为一个整体词元,而非三个独立的字。

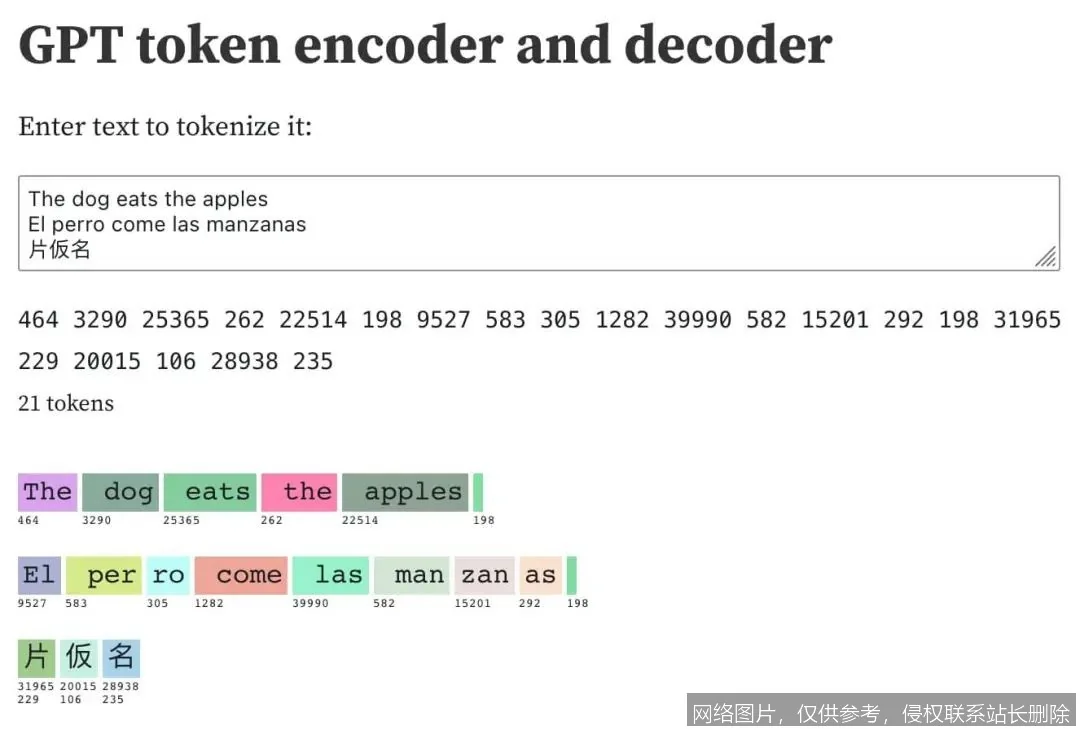

3. 子词分词(现代主流):这是当前大语言模型(如GPT、BERT)最常用的策略。它通过统计学习,将单词拆分为更常见的子词或字符。例如,“unhappiness”可能被拆分为“un”、“happi”、“ness”三个子词。这种方法能优雅地处理未登录词(生僻词)和词形变化,平衡词表大小与语义粒度。

Tokenizer分词器的应用场景

- 大语言模型训练与推理:无论是ChatGPT还是文心一言,在“阅读”用户输入和“撰写”回复时,都必须通过Tokenizer将文本转化为模型能处理的数字ID序列(Token ID)。模型的上下文长度限制,实际就是Token数量的限制。

- 搜索引擎与信息检索:搜索引擎对用户查询和网页内容进行分词,提取关键词元,从而建立倒排索引,实现快速匹配和相关性排序。

- 代码分析与处理:在AI编程助手(如GitHub Copilot)中,专门的代码Tokenizer会将源代码(如Python、JavaScript)按照语法规则分解为关键字、运算符、变量名等词元,便于模型学习代码结构和逻辑。

相关术语

理解Tokenizer分词器,需要关联以下核心概念:词元(Token)、词表(Vocabulary)、字节对编码(BPE)、WordPiece、SentencePiece、注意力机制(Attention Mechanism)、嵌入(Embedding)。

延伸阅读

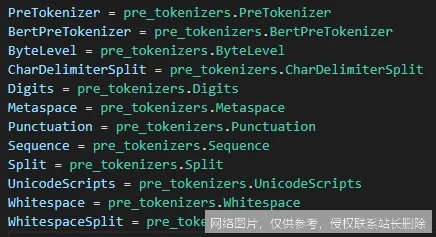

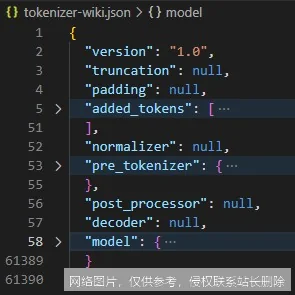

若想深入了解现代Tokenizer的技术细节,建议研究Google发布的BERT模型所使用的WordPiece算法,以及OpenAI GPT系列模型采用的字节对编码(BPE)变体。同时,可以实际操作Hugging Face Transformers库中的Tokenizer工具,直观体验不同分词策略对同一文本的处理结果差异。