【AI词典】Dropout正则化 - 防止过拟合的神经网络训练技术

AI词典2026-04-23 16:00:00

Dropout正则化:定义

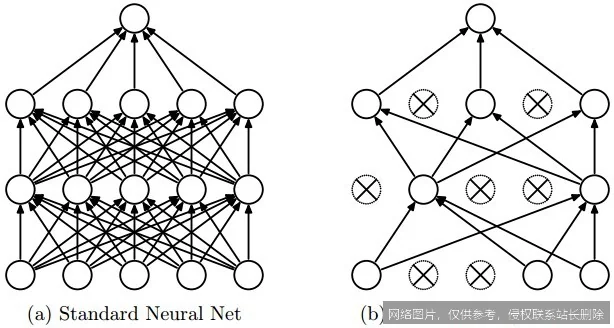

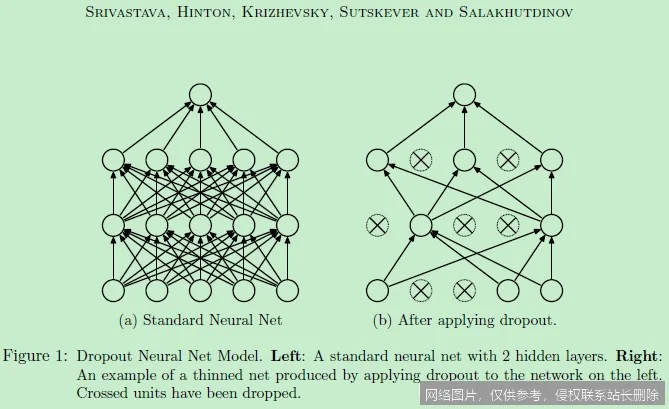

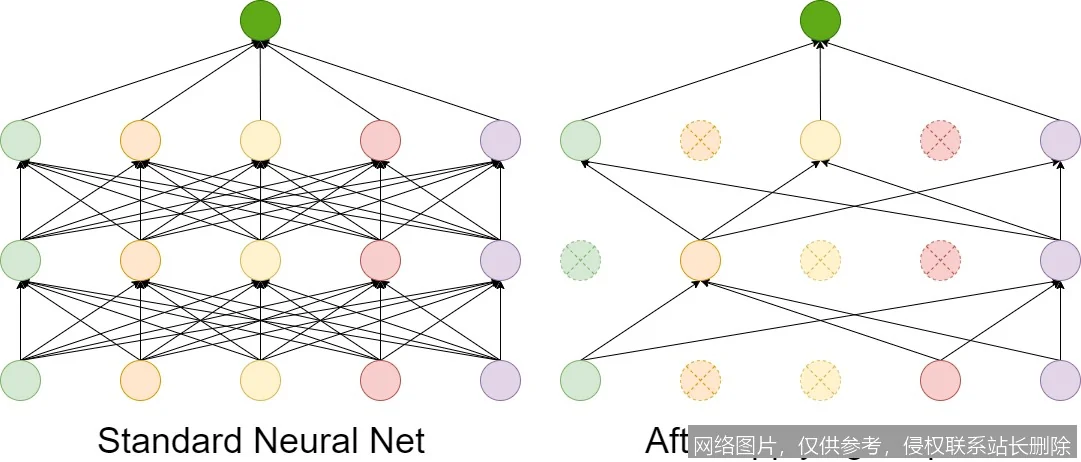

Dropout正则化是一种在神经网络训练过程中,通过随机“丢弃”一部分神经元及其连接来防止模型过拟合的技术。其核心思想是在每次训练迭代中,强制网络不依赖于任何少数特定的神经元,从而提升模型的泛化能力。

Dropout正则化:工作原理

可以将Dropout的工作原理类比于一个团队协作项目。假设一个项目通常由10位固定专家完成,长期下来,团队可能会形成依赖,一旦某位关键专家缺席,项目就会停滞。为了打破这种依赖,训练时我们改为:每次会议都随机只邀请其中一部分专家(例如每次只来7位),迫使剩余专家必须学会协作并补位。经过大量这样的随机会议后,整个团队会变得更具弹性,每位成员都能独当一面,且团队不依赖于任何特定个人。最终正式汇报(即模型测试或部署)时,则会邀请所有专家出席,发挥集体智慧。

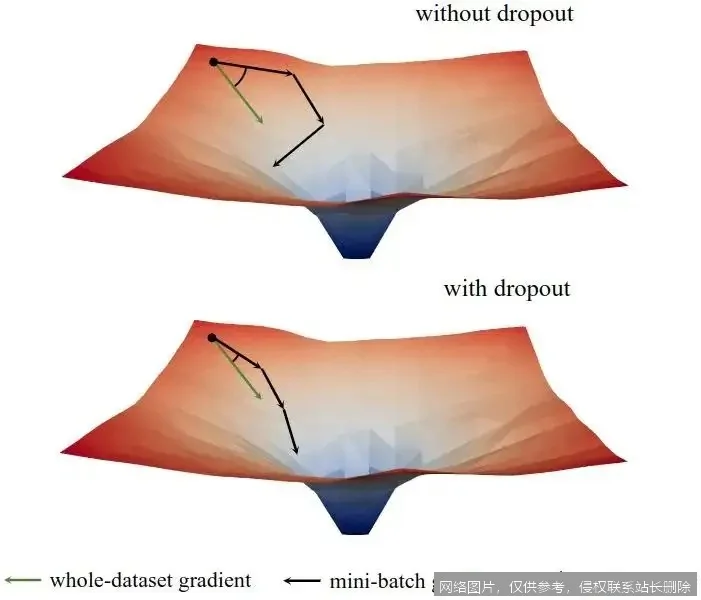

在技术实现上,Dropout层会在每个训练批次前,以预设的概率(如0.5)随机将上一层神经元的输出置为零,这些被“关闭”的神经元不参与本次前向传播和反向传播。这个过程在每次迭代中都是随机的,从而使得网络权重分布更加均匀,避免某些神经元之间形成复杂的共适应关系,有效抑制了过拟合。

Dropout正则化的应用场景

- 复杂图像分类任务:在训练深度卷积神经网络(如用于医学影像分析或自动驾驶视觉感知的网络)时,Dropout常被插入在全连接层之后,以防止网络对训练集中的特定噪声或局部特征产生过度记忆,提升模型对新图像的识别鲁棒性。

- 自然语言处理模型:在循环神经网络(RNN)或Transformer的某些层中应用Dropout,可以防止模型对特定词序或搭配产生过拟合,改善其在文本分类、机器翻译等任务上的泛化性能。

- 训练大规模全连接网络:当网络参数量巨大而训练数据相对有限时,过拟合风险极高。在隐藏层广泛使用Dropout,相当于同时训练了大量共享权重的“子网络”的集合,是一种高效且低成本的模型平均方法。

相关术语

与Dropout正则化紧密相关的概念包括:过拟合、正则化、L1/L2正则化、批量归一化、早停法以及集成学习。

延伸阅读

若想深入了解Dropout,建议阅读其开创性论文《Dropout: A Simple Way to Prevent Neural Networks from Overfitting》(Nitish Srivastava等,2014)。此外,可以对比研究其变体,如DropConnect(随机丢弃权重连接而非神经元输出)和Spatial Dropout(在卷积网络中按通道随机丢弃),以理解不同场景下的正则化策略选择。