【AI词典】自注意力机制 - 序列建模中的核心计算组件

AI词典2026-04-23 03:12:00

自注意力机制:定义

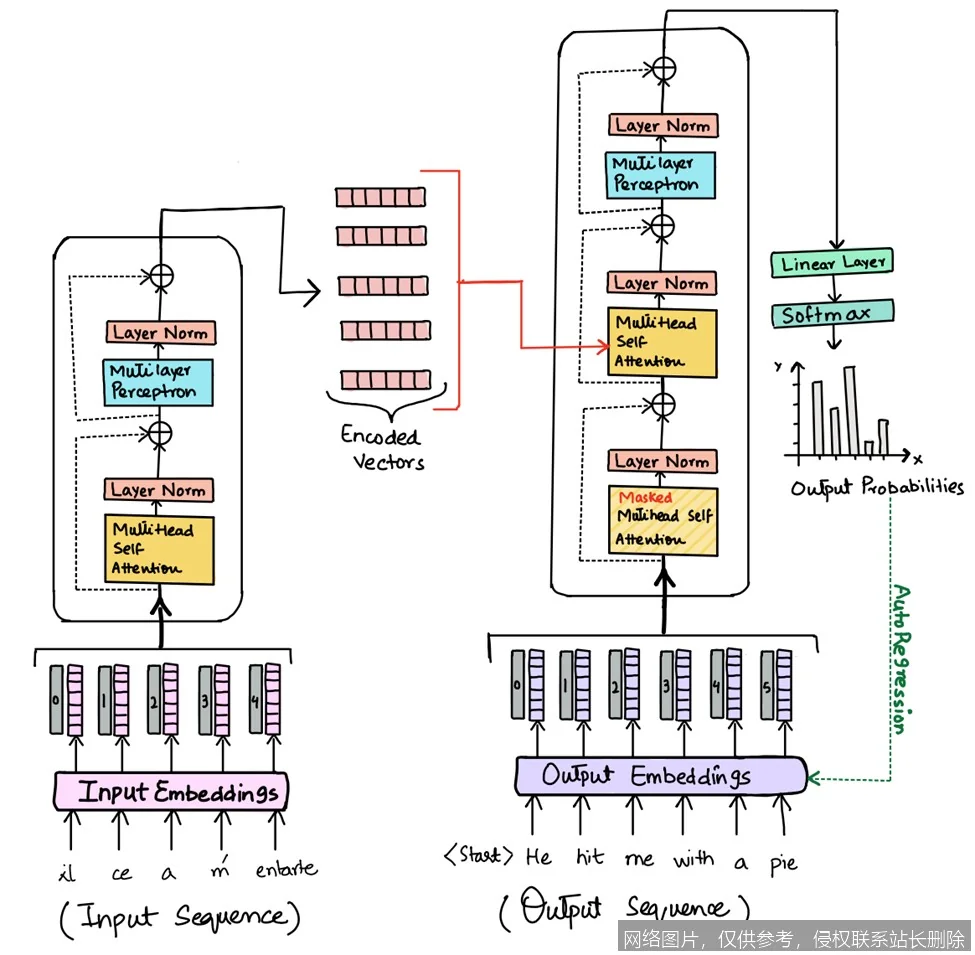

自注意力机制(Self-Attention Mechanism)是Transformer架构的核心计算组件,它允许序列中的每个元素(如单词或图像块)动态地权衡并聚合来自序列内所有其他元素的信息,从而捕捉长距离的上下文依赖关系。

自注意力机制的工作原理

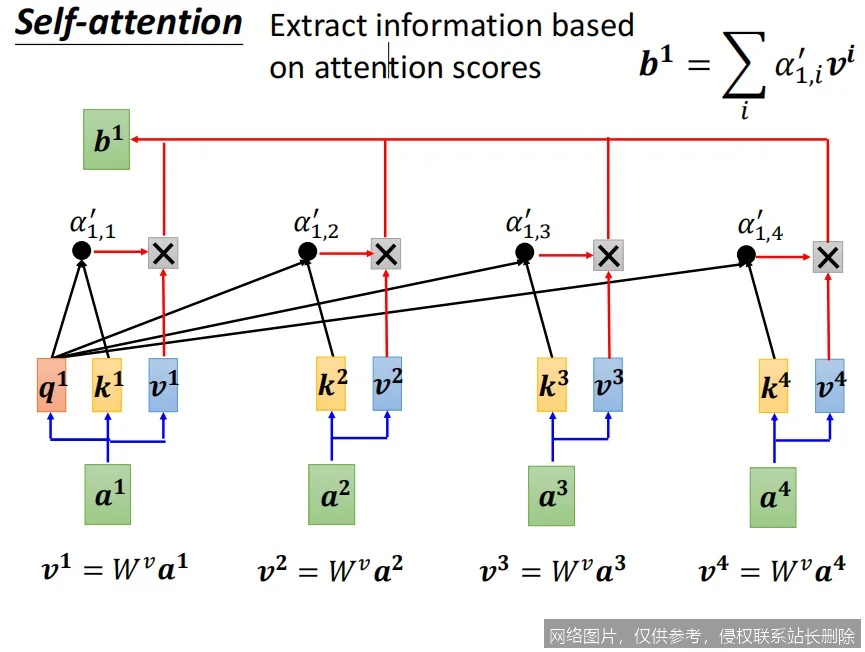

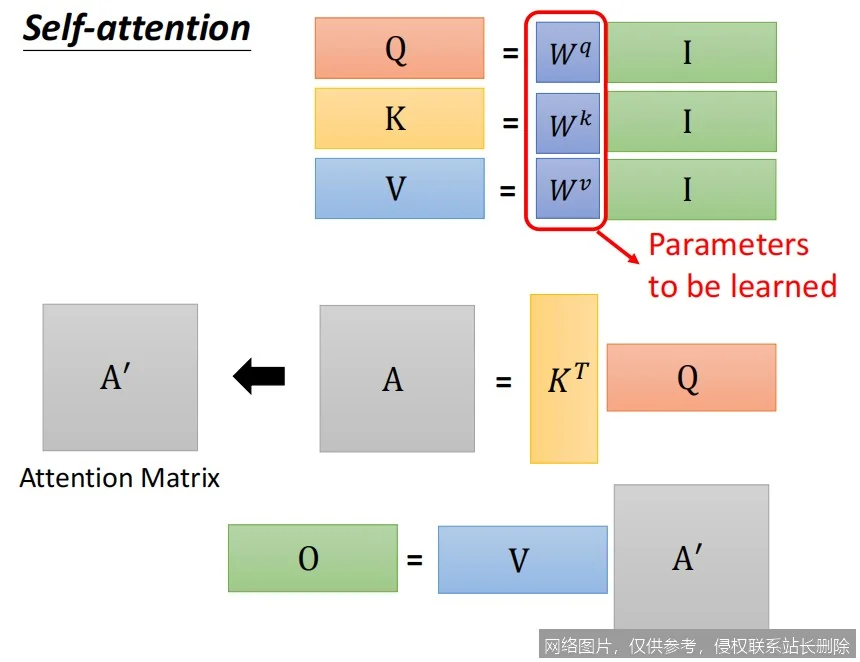

理解自注意力机制,可以将其想象成一场“圆桌会议”。序列中的每个元素(例如一个单词)都扮演着三重角色:它既是“发言者”(查询,Query),也是“听众”(键,Key),同时还是“信息提供者”(值,Value)。

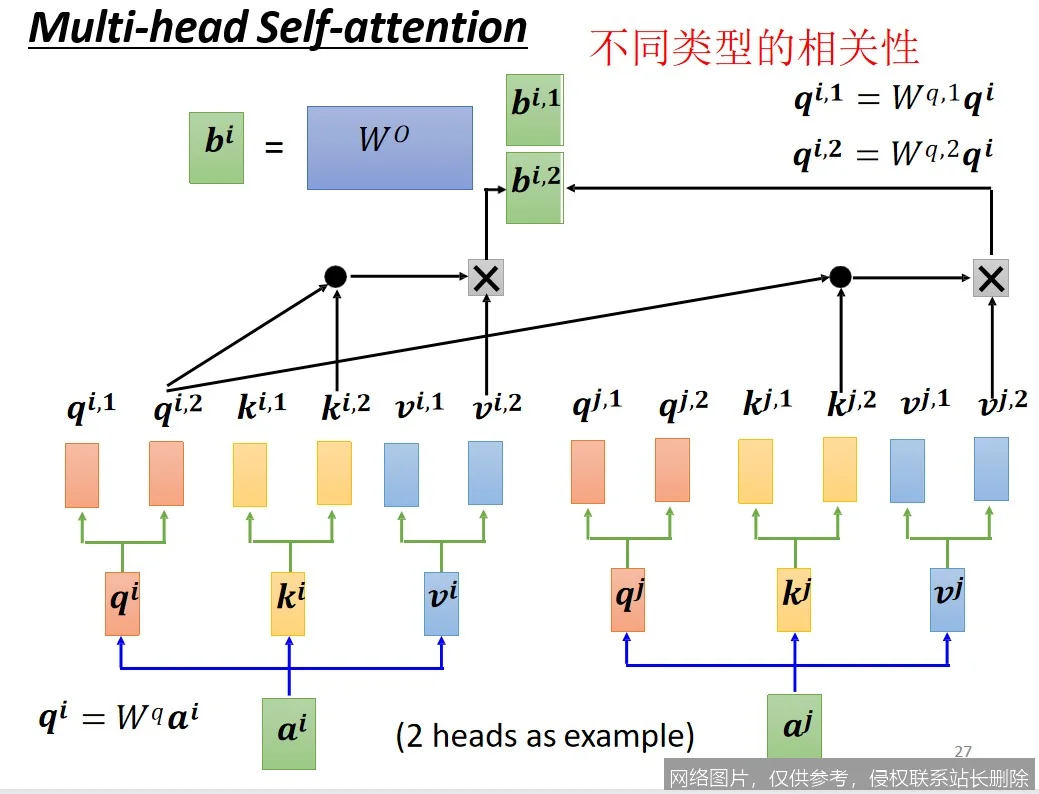

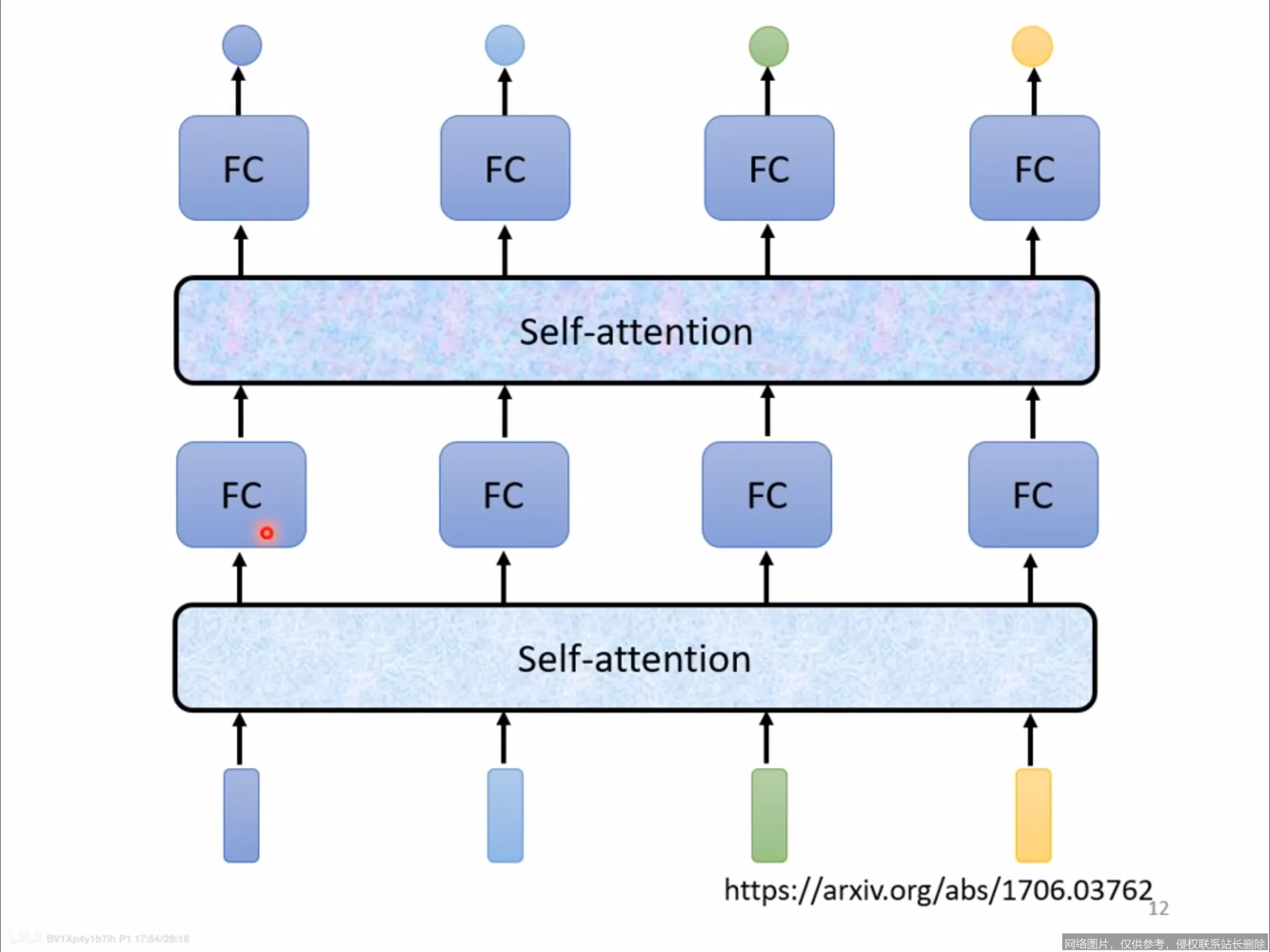

具体计算分为三步:首先,每个元素的“发言内容”(Query)会与序列中所有元素的“身份标签”(Key)进行匹配打分,计算出一个注意力权重,这决定了在本次“会议”中,该元素应该“听取”其他每个元素多少信息。其次,将这些权重进行归一化处理,确保分配的总“注意力”为1。最后,用这些权重对所有元素的“信息干货”(Value)进行加权求和,生成该元素新的、融合了全局上下文的表示。这个过程并行地对序列中所有元素同时进行,高效地建模了元素间的复杂关系。

自注意力机制的应用场景

- 机器翻译与文本生成:在翻译或生成文本时,模型通过自注意力机制决定当前生成的词应该重点关注原文或已生成文本中的哪些部分。例如,翻译动词时,模型能自动关联到远处的主语,确保语法和语义的一致性。

- 大型语言模型(LLM):以GPT系列和BERT为代表的模型,其基石便是自注意力机制。它使模型能够理解超长文本中词与词、句与句之间的复杂关联,从而具备强大的阅读理解、摘要和问答能力。

- 计算机视觉:在视觉Transformer(ViT)中,图像被分割成多个图像块(Patch)。自注意力机制让模型能够分析图像中任意两个区域之间的关系,例如识别出一个物体的不同部分(如猫的耳朵和尾巴)是相互关联的,从而提升图像分类、目标检测等任务的性能。

相关术语

理解自注意力机制,可关联以下概念:Transformer模型、多头注意力、缩放点积注意力、位置编码、循环神经网络、上下文向量。

延伸阅读

若想深入了解,建议从谷歌2017年的开创性论文《Attention Is All You Need》入手,这是自注意力机制和Transformer的奠基之作。此外,可以查阅关于BERT、GPT模型架构的解读文章,以及可视化自注意力权重的教程,直观感受模型“关注”的过程。