【AI词典】词嵌入 - 将词语映射为向量的技术

AI词典2026-04-23 00:24:00

词嵌入(Word Embedding):定义

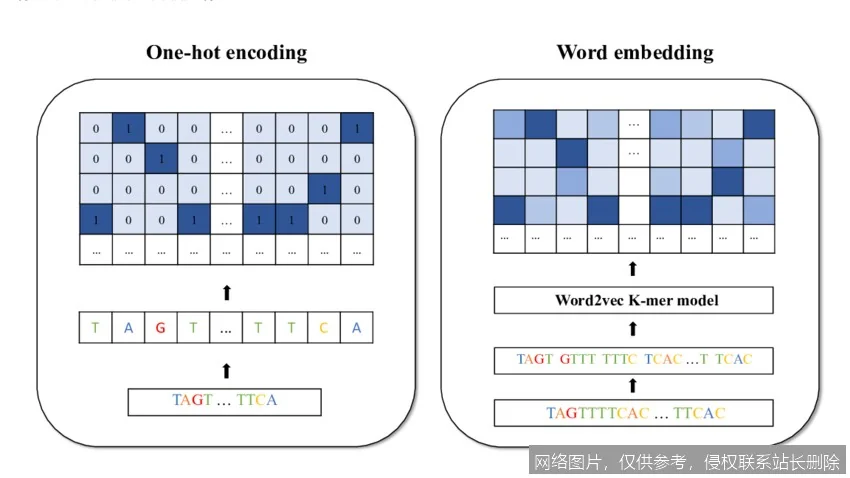

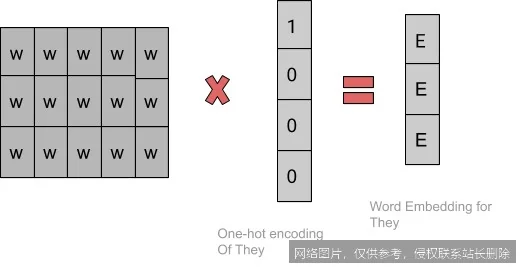

词嵌入(Word Embedding)是一种将自然语言中的词语或短语映射为低维、稠密实数向量的核心技术,旨在让计算机能够通过向量运算理解和处理词语的语义与语法关系。

词嵌入的工作原理

其核心思想源于分布假说:“上下文相似的词,其语义也相似。” 技术实现上,模型(如经典的Word2Vec)通过分析海量文本中每个词语的上下文环境(即周围的词)来学习向量表示。这个过程可以类比为:我们通过观察一个人的朋友圈来了解这个人的特征。如果一个词经常与“足球”、“比赛”、“进球”同时出现,模型就会学习到这个词(例如“梅西”)的向量表示,使其在向量空间中更靠近这些相关概念的向量。

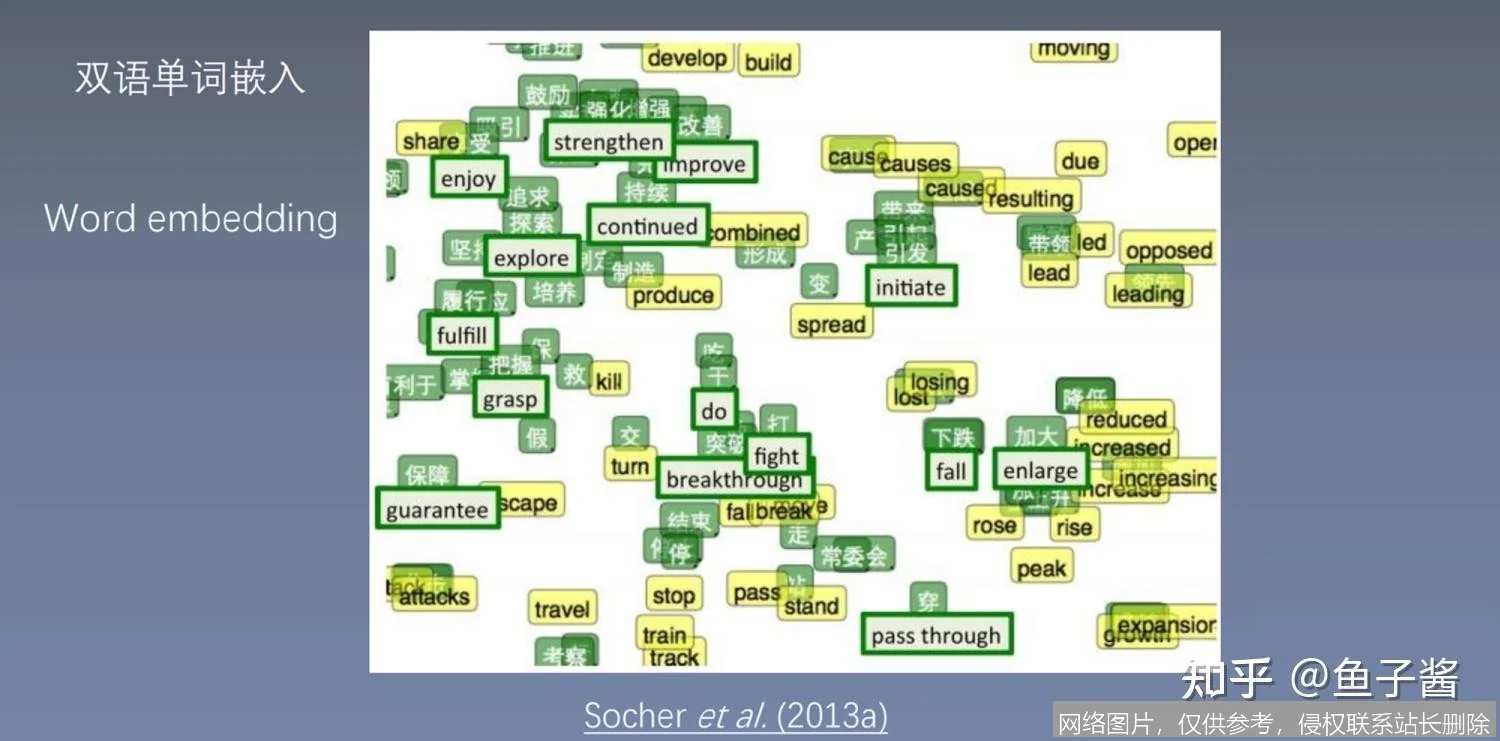

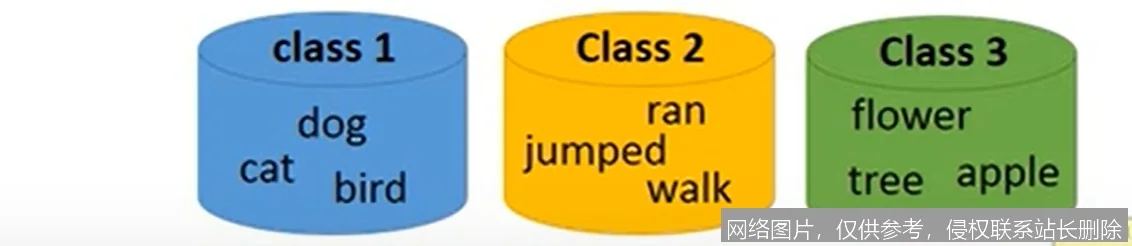

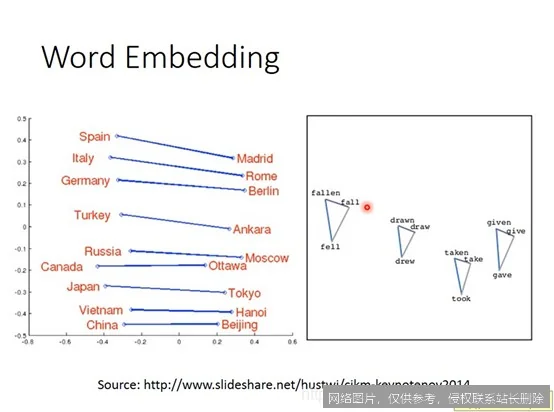

最终,所有词语的向量被安置在一个高维的几何空间(向量空间)中。在这个空间里,语义相近的词(如“国王”与“王后”)距离更近;词语之间甚至能进行数学运算,例如经典的“国王 - 男人 + 女人 ≈ 女王”,这直观地展现了词嵌入捕捉抽象语义关系的能力。

词嵌入的应用场景

- 搜索引擎与智能推荐:通过将查询词和文档内容转化为向量,计算其相似度,从而返回语义相关而非仅仅是关键词匹配的结果,提升搜索质量和推荐精准度。

- 自然语言处理任务的基础:作为文本的“数字化”表示,词嵌入向量是众多下游AI任务的输入基石,广泛应用于情感分析、机器翻译、文本分类和智能聊天机器人中,显著提升模型对语言的理解水平。

- 语义分析与知识发现:在金融、法律、生物医学等领域,利用词嵌入技术可以挖掘海量文献中概念之间的潜在关联,辅助研究人员发现新的知识联系或进行趋势分析。

相关术语

理解词嵌入,可以关联以下概念:其典型模型代表 Word2Vec 和 GloVe;作为更广泛的 表示学习 在NLP领域的体现;其思想被后续的 上下文词向量(如ELMo)和基于 Transformer 的 预训练语言模型(如BERT)所发展和超越。

延伸阅读

若想深入了解,建议从Word2Vec的原论文《Efficient Estimation of Word Representations in Vector Space》入手。同时,斯坦福大学的CS224n(自然语言处理与深度学习)课程中有对词嵌入技术非常系统且生动的讲解。在实践中,使用Gensim或TensorFlow等开源库动手训练一个简单的词嵌入模型,是巩固理解的最佳途径。