【AI词典】位置编码 - 为序列数据添加位置信息的向量表示方法

AI词典2026-04-23 01:48:00

位置编码:定义

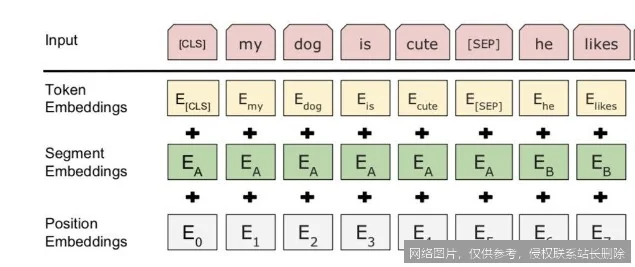

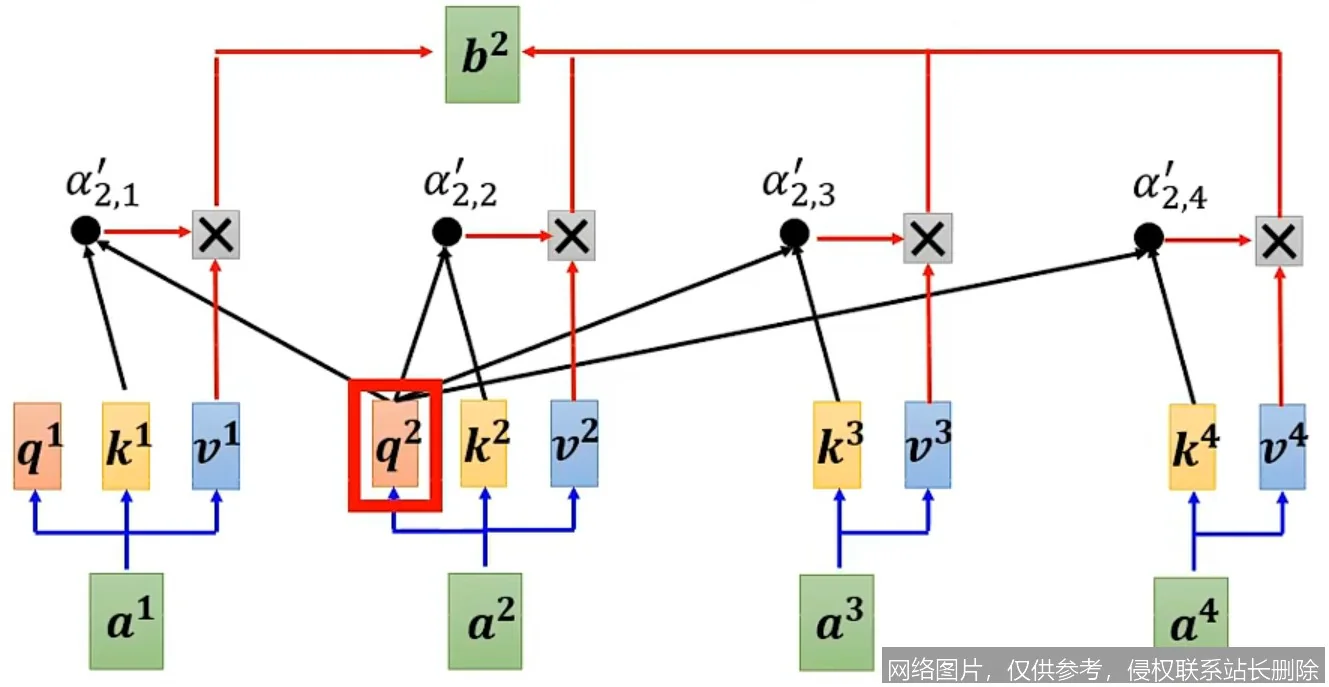

位置编码是一种为序列数据中的每个元素(如单词或图像块)添加位置信息的向量表示方法,旨在帮助模型理解序列中元素的顺序关系。在Transformer等自注意力架构中,由于模型本身不具备感知序列顺序的能力,位置编码成为将“顺序”这一关键信息注入模型的核心技术。

位置编码的工作原理

想象一下阅读一本没有页码的书,你很难判断事件发生的先后。位置编码就如同为这本书的每一行精确地标注了页码和行号。其核心思想是生成一组与输入词向量维度相同的向量,这些向量包含了元素在序列中的绝对或相对位置信息,然后将其与原始的词向量相加,从而使融合后的向量同时携带了“内容”和“位置”两种信息。

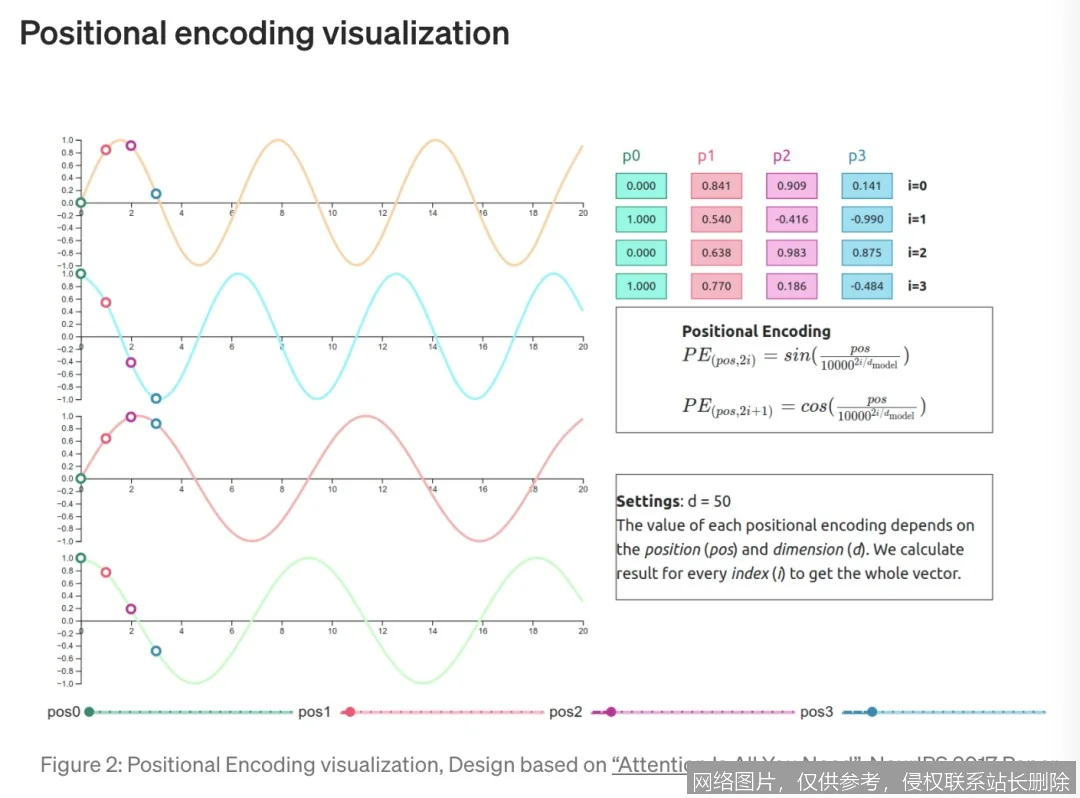

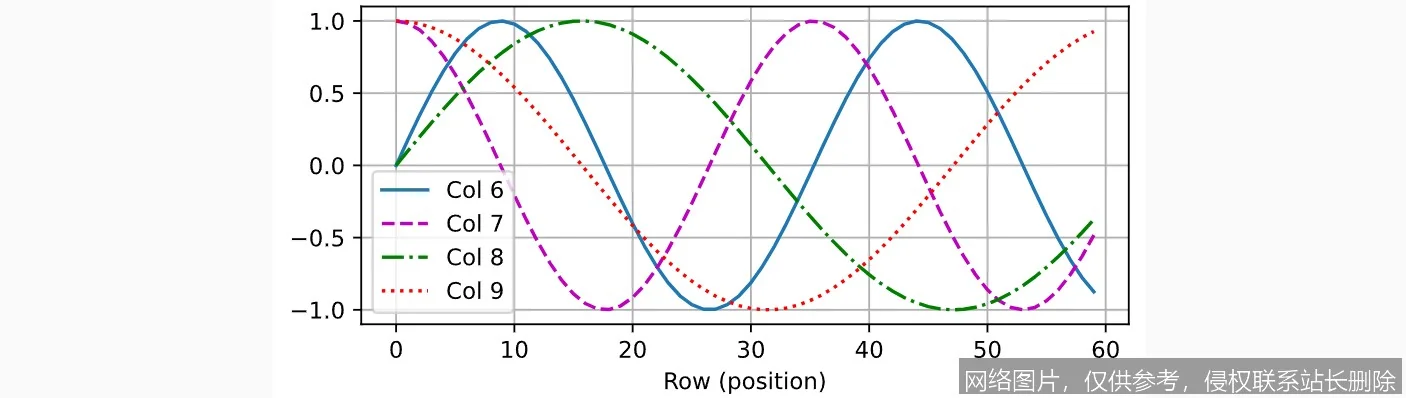

最经典的方法是使用正弦和余弦函数生成固定模式的向量。对于序列中第pos个位置,编码向量在不同维度上交替使用不同频率的正弦和余弦波。这种设计使得模型能够轻松学习到位置之间的相对距离(例如,位置5和位置7的编码关系,与位置20和位置22的编码关系模式相似),并具备一定的外推能力。

位置编码的应用场景

- 机器翻译与文本生成:在翻译“猫追老鼠”和“老鼠追猫”时,词序决定了完全不同的语义。位置编码确保Transformer模型能够准确理解词语的顺序,从而生成语法正确、语义通顺的句子。

- 语音识别与合成:语音信号是严格按时间顺序排列的序列。位置编码帮助模型处理音频片段的时间顺序,将声音信号准确转化为文字,或将文字转化为具有正确时序的语音波形。

- 图像处理与分析:在视觉Transformer中,图像被切割成多个小块(Patch)输入模型。位置编码为这些图像块提供其在原始图像中的空间位置(二维坐标),使模型能够理解图像的全局结构和局部相邻关系,从而完成图像分类、目标检测等任务。

相关术语

理解位置编码,通常需要关联以下概念:Transformer模型、自注意力机制、词嵌入、相对位置编码、绝对位置编码。

延伸阅读

若想深入了解,建议从原始论文《Attention Is All You Need》中关于位置编码的章节开始。此外,可以进一步研究其变体,如可学习的绝对位置编码、以及更复杂的相对位置编码方法(如T5模型和DeBERTa模型采用的方案),它们在不同场景下解决了固定正弦编码的局限性。