【AI词典】梯度消失 - 神经网络训练中的梯度衰减问题

AI词典2026-04-23 17:24:00

梯度消失:定义

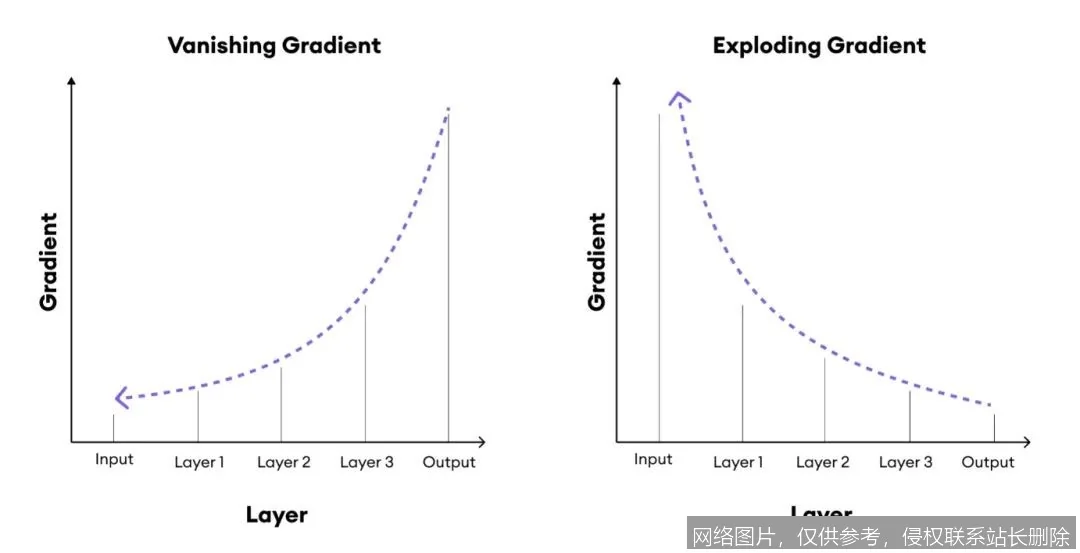

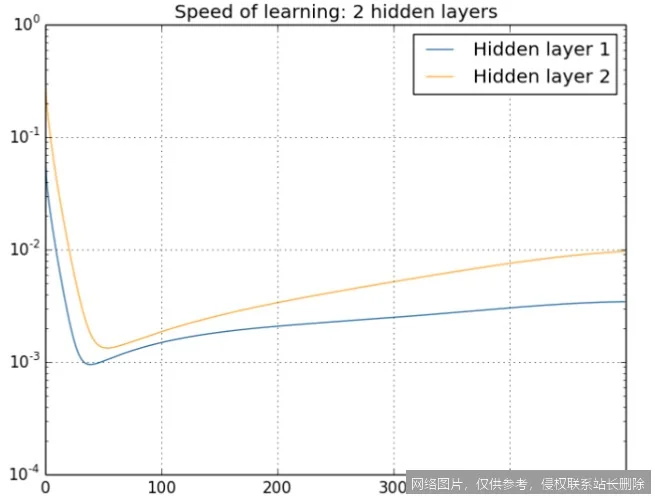

梯度消失是指在深度神经网络的反向传播训练过程中,误差梯度从输出层向输入层逐层传递时,其数值(范数)指数级衰减至接近于零的现象。这导致网络前部的层(尤其是靠近输入的层)的参数更新极其缓慢甚至停滞,从而严重阻碍网络的深度学习和性能提升。

梯度消失的原理

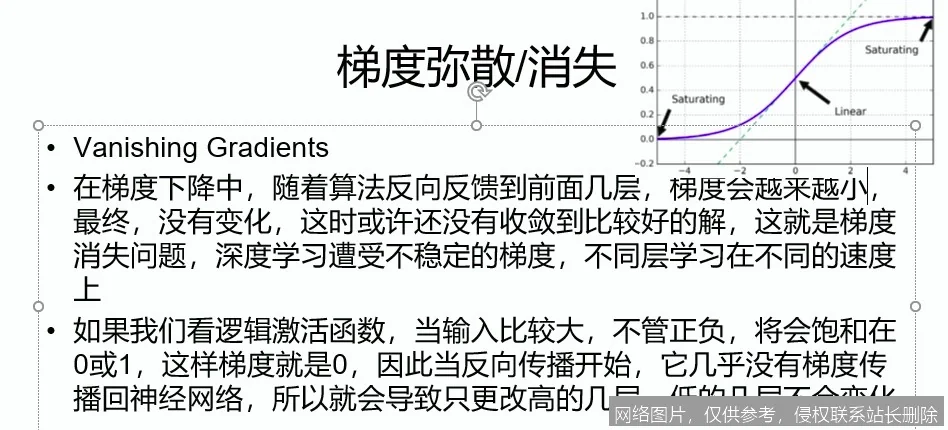

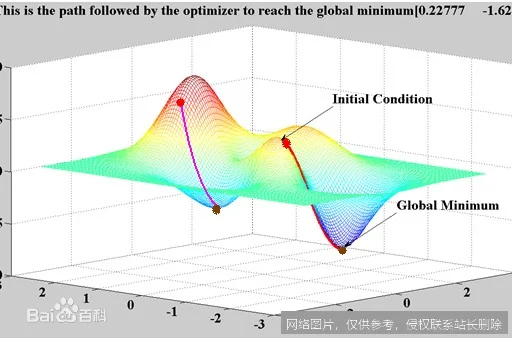

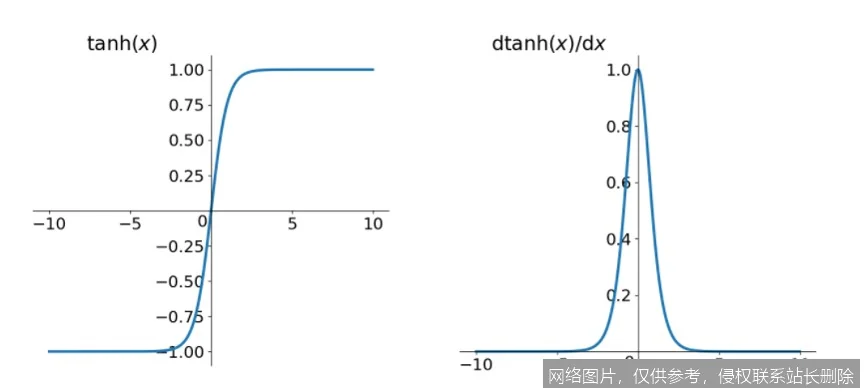

要理解梯度消失,可以将其想象成一条信息传递的链条。在反向传播中,网络通过链式法则计算每一层参数的梯度。这个计算过程是逐层连乘的。当神经网络使用如Sigmoid或Tanh等饱和激活函数时,其导数值域被压缩在(0, 1] 的较小范围内。经过多层连续的连乘,多个小于1的数相乘,最终的乘积会迅速趋近于零。这就好比在多人传话游戏中,每经过一个人,信息就被削弱一点,传到最前面的人时,信息已经微乎其微,无法据此做出有效调整。因此,网络前部的权重几乎得不到有意义的更新,学习效率低下。

梯度消失的应用场景

梯度消失问题深刻影响了神经网络架构的设计与选择,在以下场景中尤为关键:

- 早期深度前馈网络与循环神经网络的训练:在引入残差连接和现代激活函数之前,训练超过几层的网络极为困难。在循环神经网络中处理长序列时,梯度需要在时间步上反向传播,梯度消失会导致网络“遗忘”远距离的依赖关系,无法有效学习长期模式。

- 自然语言处理中的序列建模:在机器翻译、文本生成等任务中,模型需要关联句子开头与结尾的信息。梯度消失会使模型过于关注近期词汇,而忽略句子早期的关键语境,影响生成质量。

- 自动编码器与生成模型的深度架构:在构建深层的编码器-解码器结构(如变分自动编码器)时,梯度消失会导致编码部分难以学习到输入数据有效的深层抽象表示,从而限制模型的生成和重构能力。

相关术语

理解梯度消失,通常需要关联以下核心概念:反向传播、链式法则、激活函数、梯度爆炸、残差网络、长短期记忆网络、权重初始化。

延伸阅读

若想深入了解梯度消失问题的解决方案及其演变,建议从以下方向入手:首先,研读关于ReLU及其变体如何缓解梯度消失的文献;其次,理解残差连接和门控机制如何构建“梯度高速公路”,是攻克深度训练难题的关键;最后,通过对比不同权重初始化方法对训练初期梯度流动的影响,可以建立更全面的优化视角。