【AI词典】反向传播 - 神经网络训练的核心算法

AI词典2026-04-23 18:48:00

反向传播:神经网络训练的核心算法

反向传播是一种通过计算损失函数对神经网络中所有权重参数的梯度,并利用梯度下降法迭代更新这些参数,从而使网络输出逼近预期目标的监督学习算法。 它是现代深度学习得以高效训练的基石,常被简称为“Backprop”或BP算法。

原理:误差的逆向分配与调整

可以将反向传播的工作原理类比为一份工作成果的复盘与责任追溯。假设一个团队(神经网络)共同完成一个项目(处理输入数据),最终产出结果(预测输出)与理想目标(真实标签)存在差距(损失函数)。

反向传播的过程分为两大阶段:

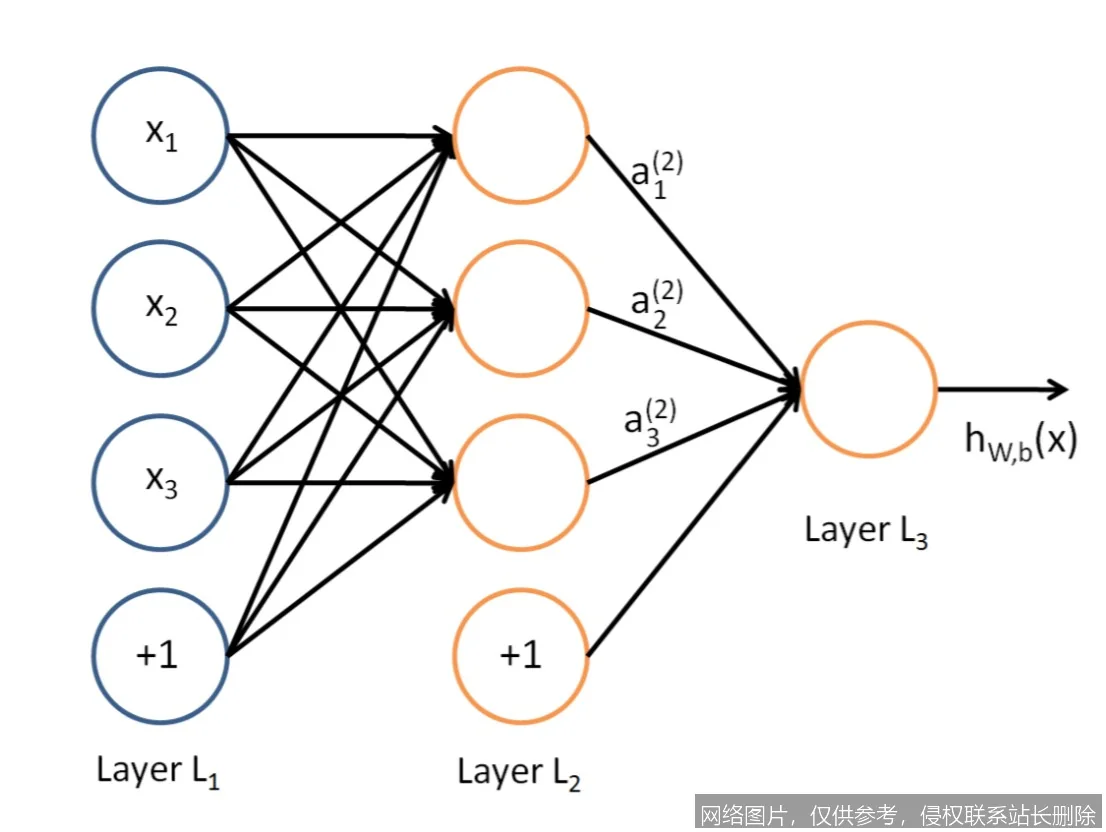

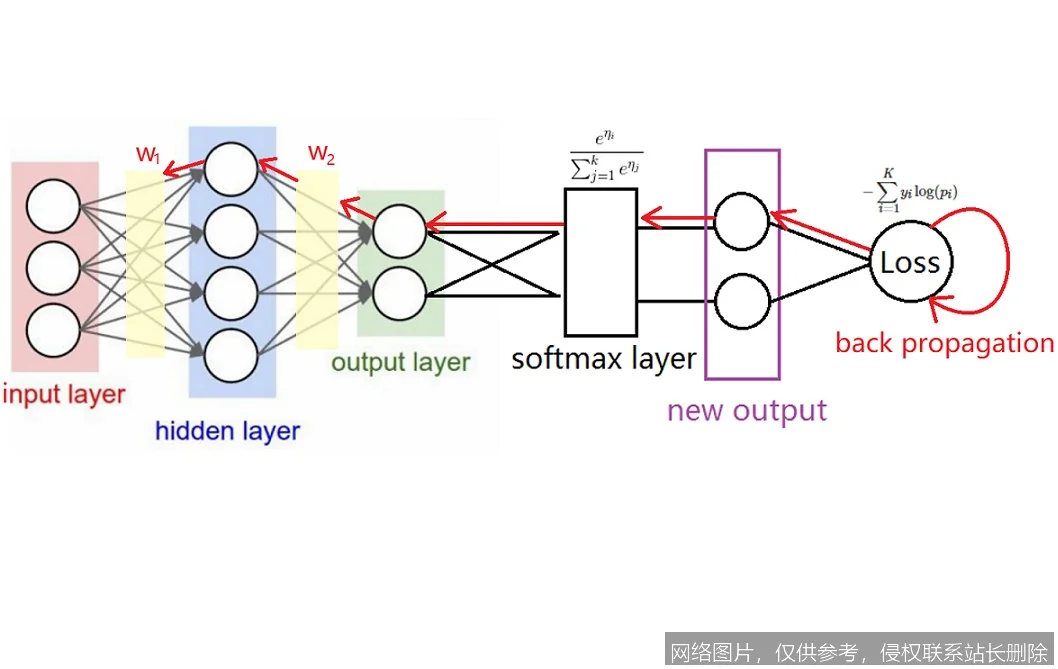

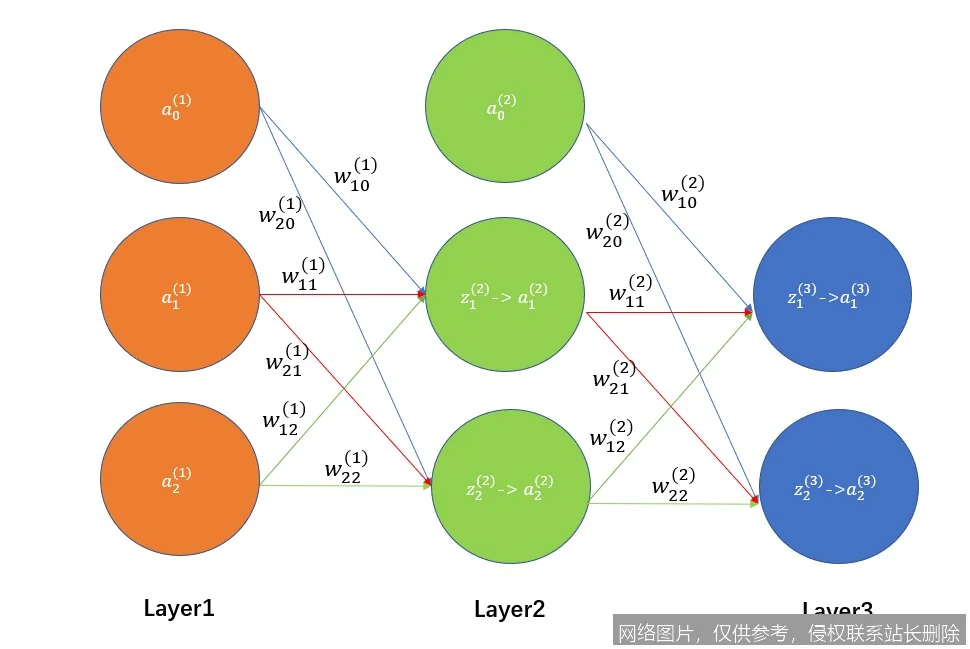

- 正向传播:输入数据从网络第一层逐层向前计算,经过各层的加权求和与非线性激活,最终得到预测值。此过程如同团队按流程执行任务。

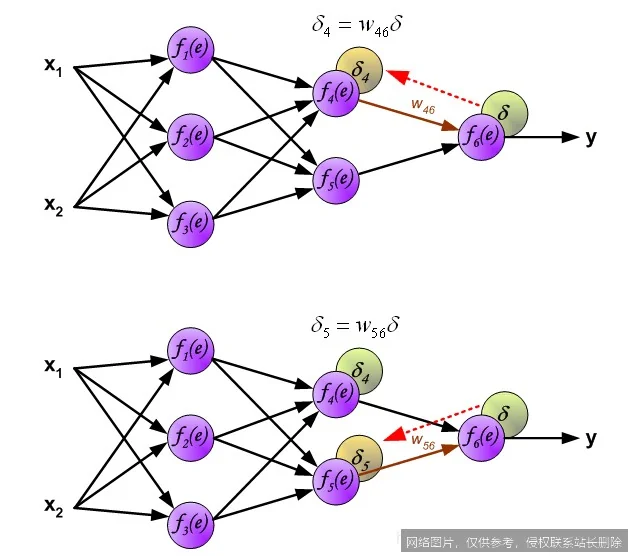

- 反向传播:计算最终误差,然后从输出层开始,逆向逐层计算每个神经元对总误差的“贡献度”(即梯度)。核心数学工具是链式求导法则,它能够将总误差精确地分解并分配给网络中每一个可调节的权重和偏置。得到梯度后,优化器(如随机梯度下降)便会按梯度相反方向微调所有参数,以降低下一次的误差。

这个过程反复进行,如同根据成品瑕疵逆向检查每个生产环节的责任,并针对性改进工艺,从而使最终成品质量不断提升。

应用场景

作为神经网络训练的通用优化框架,反向传播的应用几乎覆盖所有深度学习领域:

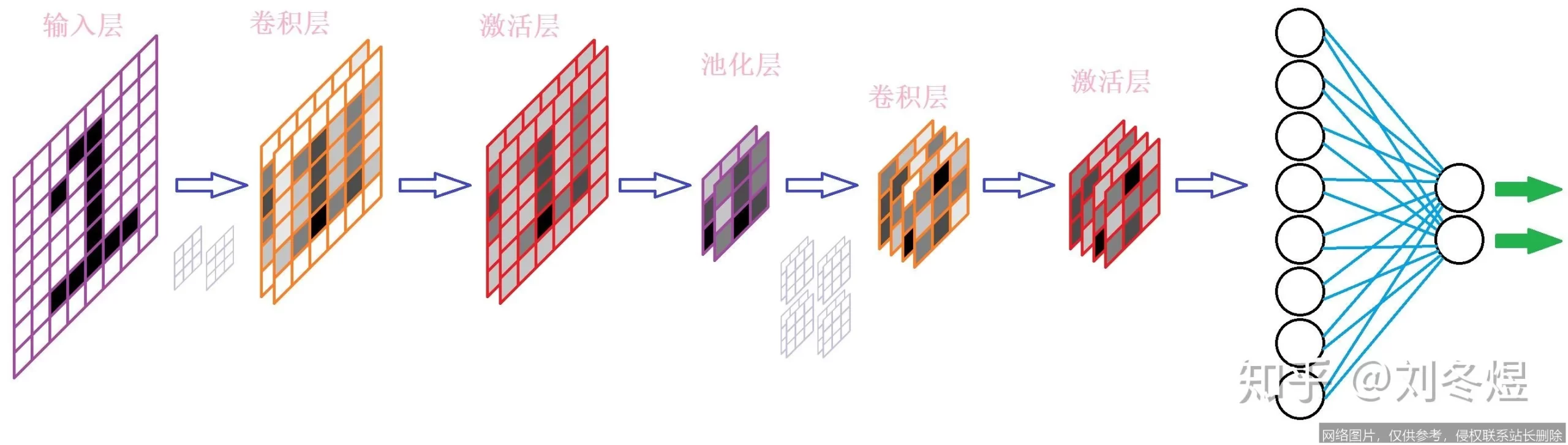

- 计算机视觉:在图像分类、目标检测等任务中,用于训练卷积神经网络(CNN),调整滤波器权重以精准识别图像特征。

- 自然语言处理:用于训练循环神经网络(RNN)和Transformer模型,优化词嵌入和注意力机制中的参数,以提升机器翻译、文本生成的准确性。

- 自动驾驶:训练感知系统识别行人、车辆和交通标志,通过持续反向传播误差来提升模型在复杂环境中的判断可靠性。

相关术语

理解反向传播,常需关联以下概念:梯度下降、链式法则、损失函数、优化器、正向传播以及计算图。

延伸阅读

若想深入理解其数学本质,推荐阅读Ian Goodfellow等人所著的《深度学习》(“Deep Learning”)教材中关于反向传播的章节。此外,观看关于“计算图”和“自动微分”的专题讲解视频,能帮助直观理解梯度是如何被自动且高效地计算出来的。