【AI词典】LSTM长短期记忆 - 一种用于处理序列数据的循环神经网络

LSTM长短期记忆:定义

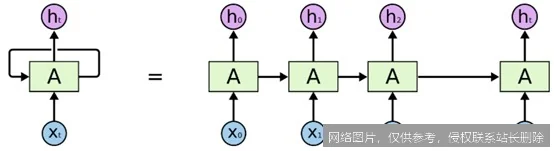

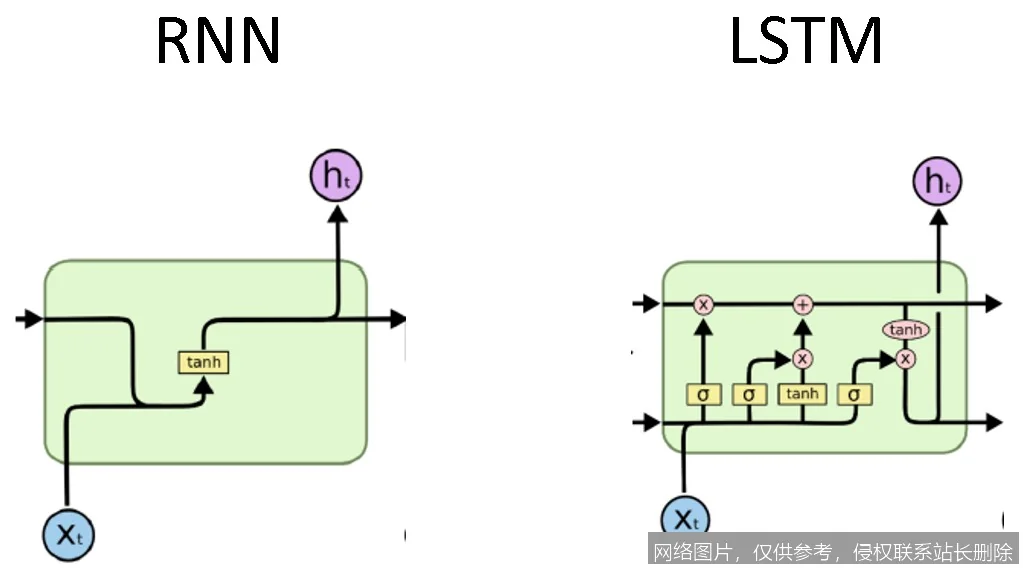

LSTM(长短期记忆网络)是一种特殊的循环神经网络(RNN)架构,专门设计用于高效学习、处理和预测序列数据中的长期依赖关系。它通过引入精妙的“门控”机制,解决了传统RNN在处理长序列时容易出现的梯度消失或爆炸问题,成为时序数据分析领域的基石性技术。

LSTM的工作原理

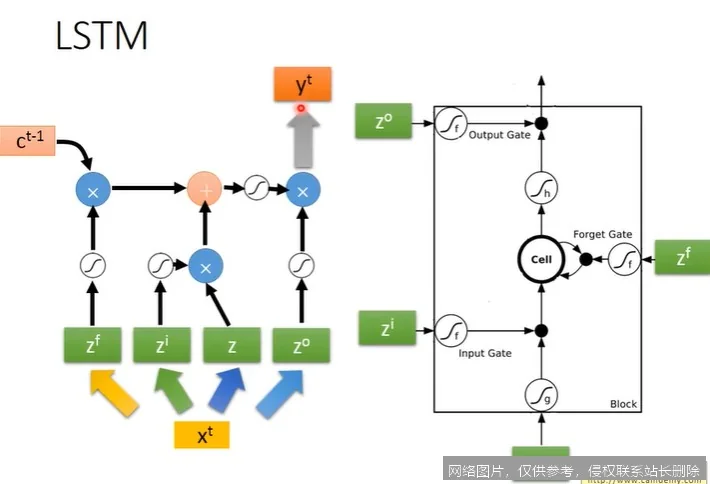

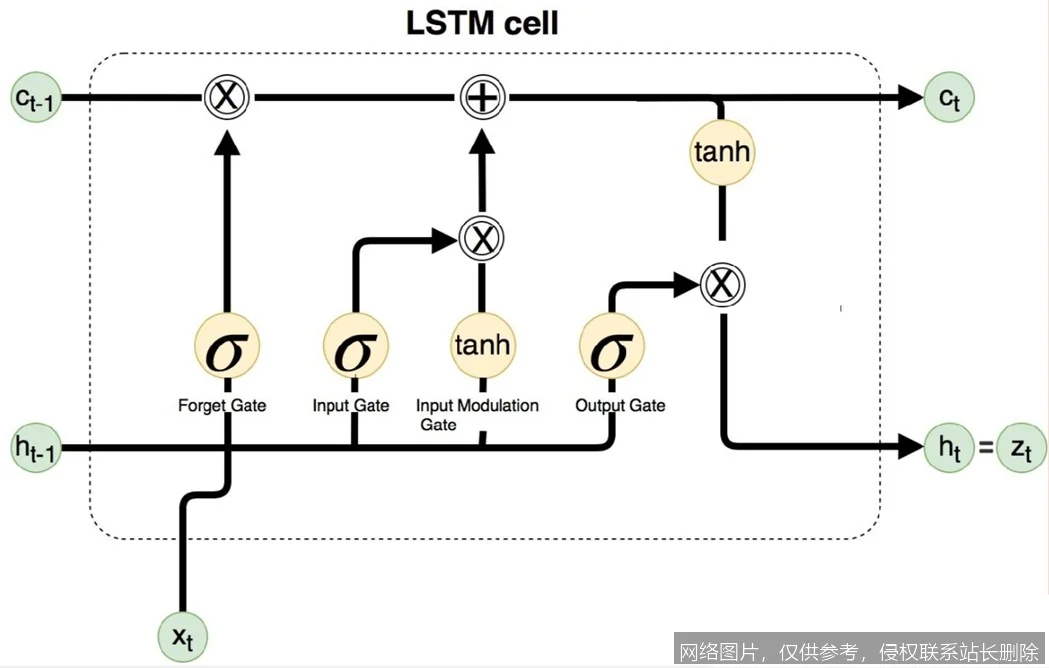

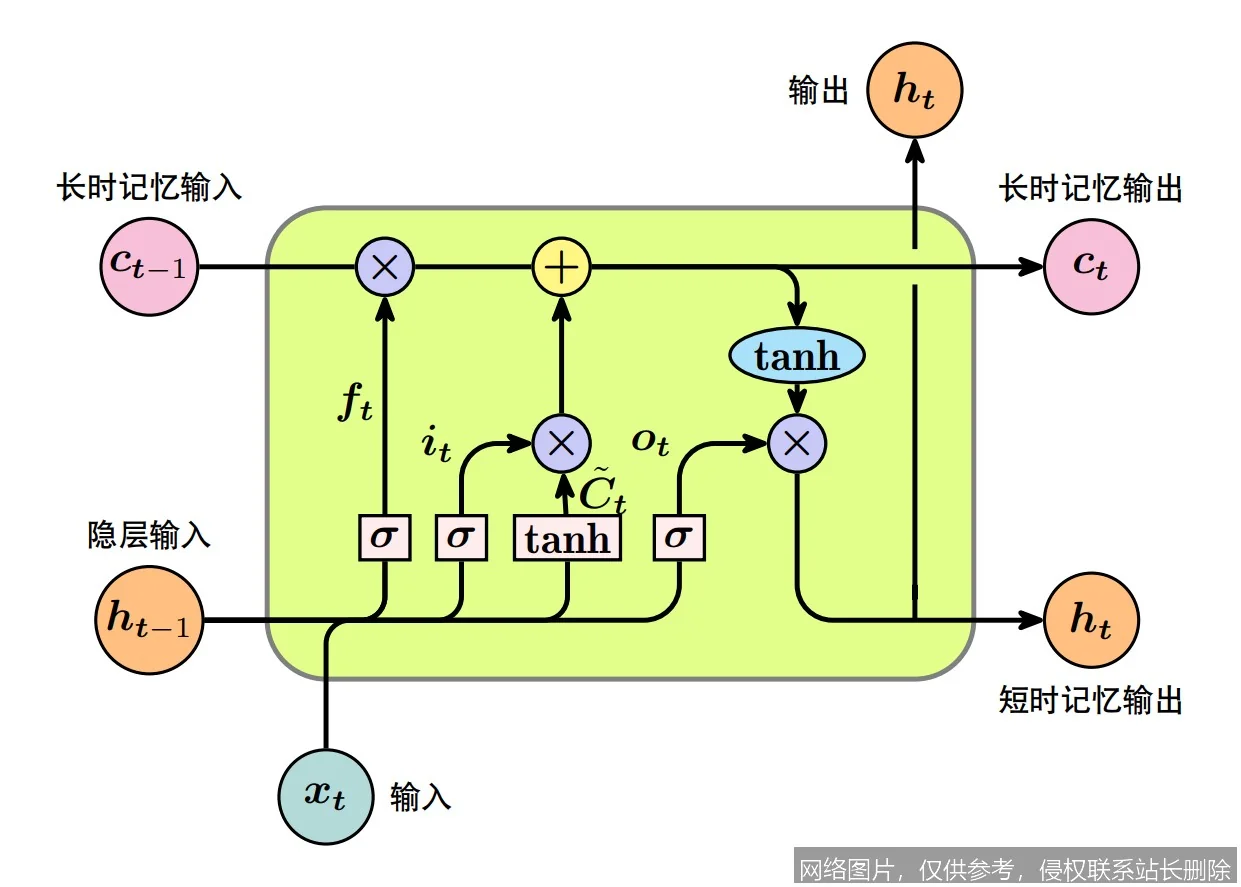

可以将LSTM单元想象成一个具备“记忆管理”能力的智能信息传送带。其核心是一个贯穿时间的“细胞状态”(Cell State),如同一条传送带,主要负责承载和传递需要长期保留的信息。围绕这条传送带,LSTM设置了三个关键的门控结构,共同决定信息的去留:

遗忘门:首先决定从上一时刻的细胞状态中丢弃哪些旧信息。它查看当前输入和上一时刻的隐藏状态,并输出一个0到1之间的数给细胞状态中的每个部分,0代表“完全遗忘”,1代表“完全保留”。

输入门:接着决定将哪些新的信息存入细胞状态。它包含两个部分:一个“门”决定更新哪些值,一个“候选值”层生成新的候选值,这些信息将被添加到细胞状态中。

输出门:最后,基于更新后的细胞状态,决定输出什么信息到当前的隐藏状态,这个隐藏状态将用于当前预测并传递给下一个时间步。

通过这三个门的协同工作,LSTM能够有选择地记住重要的长期信息、忘记无关的细节,并输出对当前任务最有用的信息,从而实现对长序列的精准建模。

LSTM的应用场景

- 自然语言处理:在机器翻译、文本生成、情感分析中,LSTM能够有效理解句子前后文的语义关联。例如,在翻译时,它能记住句子开头的主语信息,确保与句子末尾的谓语正确对应。

- 时序预测与金融分析:用于股票价格趋势预测、设备故障预警、能源消耗预测等。LSTM可以分析历史数据序列中的复杂模式和周期性变化,做出更准确的未来推断。

- 语音识别与合成:将音频信号作为时间序列处理,LSTM能够建模语音的前后依赖关系,显著提升语音转文字的准确率,并生成更自然流畅的合成语音。

相关术语

理解LSTM,可关联以下概念:循环神经网络(RNN)、门控循环单元(GRU)、梯度消失问题、序列到序列模型(Seq2Seq)、注意力机制(Attention Mechanism)。

延伸阅读

若想深入了解LSTM,建议从经典论文《Long Short-Term Memory》(Hochreiter & Schmidhuber, 1997)入手。同时,Christopher Olah的博客文章《理解LSTM网络》以精美的图示和清晰的逻辑,被公认为理解该原理的最佳入门材料之一。在实践中,可通过TensorFlow或PyTorch深度学习框架的官方教程,动手构建一个LSTM模型来加深理解。