【AI词典】循环神经网络RNN - 具有时序记忆能力的神经网络

AI词典2026-04-22 20:12:00

循环神经网络(RNN)的定义

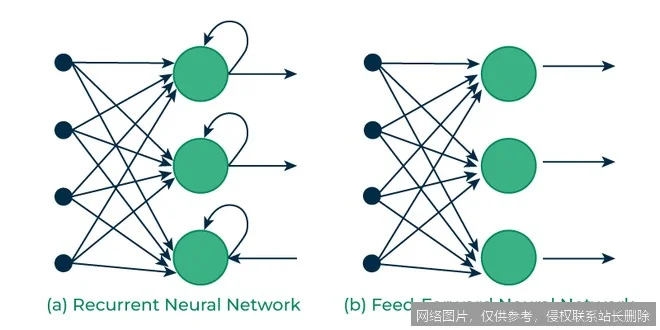

循环神经网络(Recurrent Neural Network,简称RNN)是一种专门设计用于处理序列数据的神经网络,其核心特点是网络单元之间存在循环连接,使其能够保留对先前输入信息的“记忆”,从而理解数据中的时序依赖关系。

循环神经网络(RNN)的工作原理

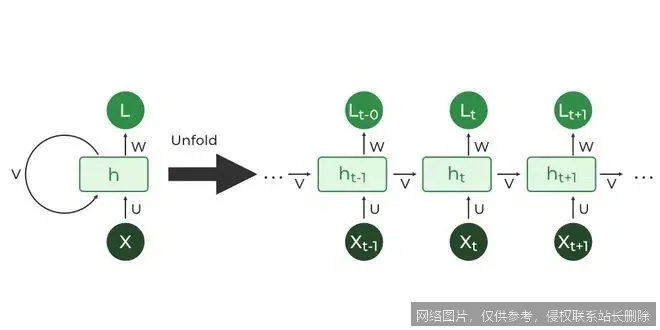

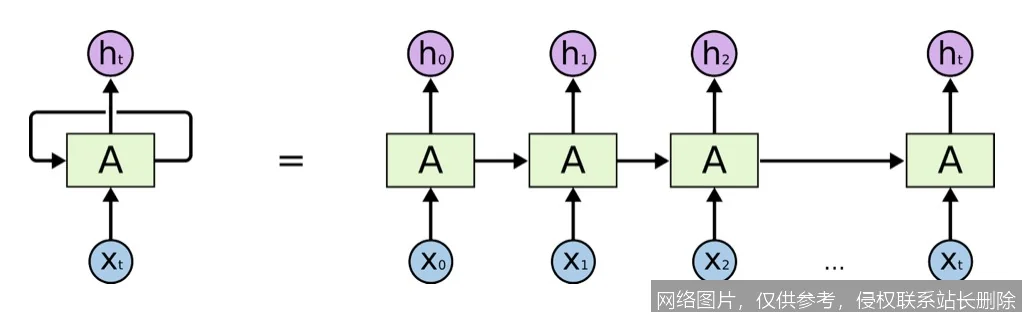

可以将RNN想象成一个拥有“工作备忘录”的智能助理。当它处理一系列信息(如一句话中的连续词语)时,它不仅分析当前接收到的信息,还会查阅“备忘录”中记录的、关于之前所有已处理信息的摘要。这个“备忘录”在技术上称为“隐藏状态”。每处理一个新的输入,RNN都会结合当前输入和上一时刻的“隐藏状态”,生成一个新的“隐藏状态”并输出结果。这个更新后的“隐藏状态”随即被传递到下一步,继续参与计算。这种循环递进的机制,使得信息能够在网络内部随时间流动,赋予了RNN捕捉上下文和时序模式的能力。

循环神经网络(RNN)的应用场景

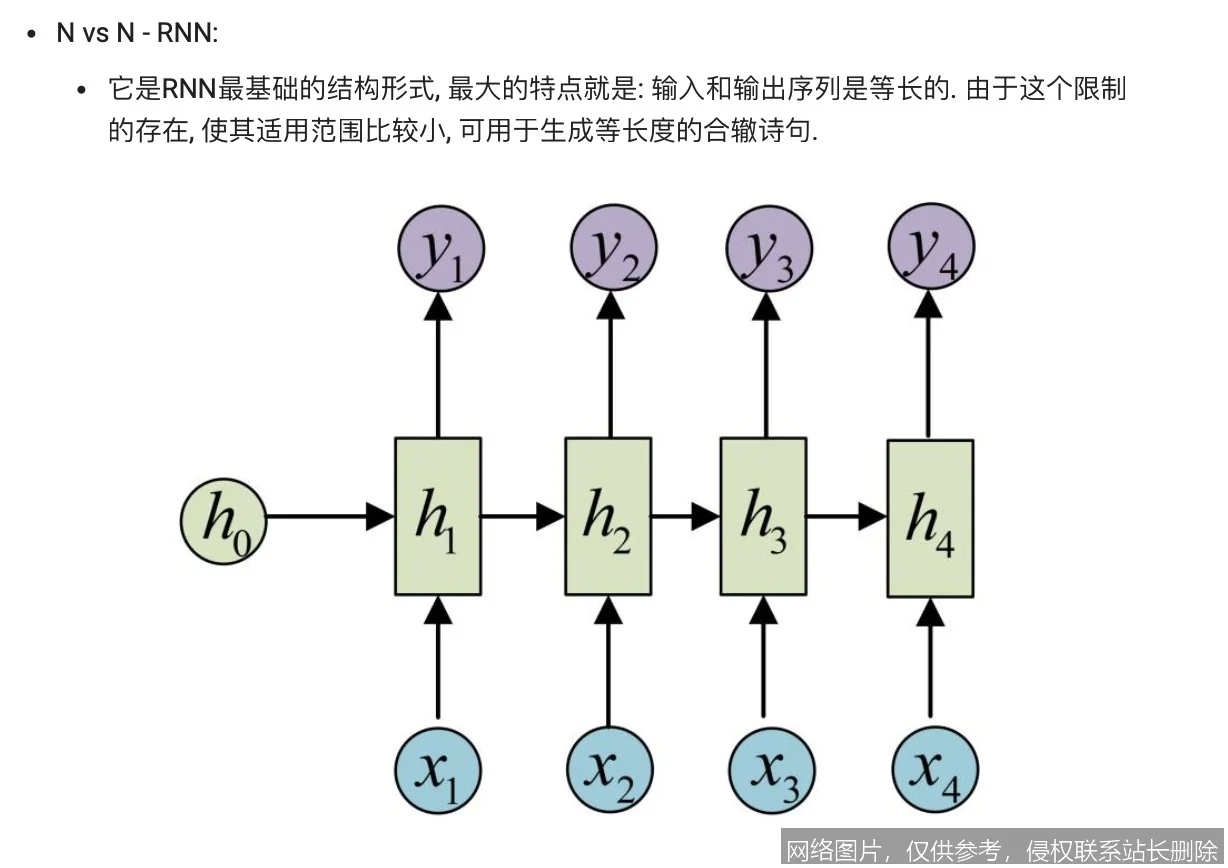

- 自然语言处理:RNN是早期处理语言任务的基石,广泛应用于机器翻译(理解源语言序列并生成目标语言序列)、文本生成(如诗歌或故事创作)以及情感分析(根据上下文判断语句情感倾向)。

- 语音识别与合成:将声音信号转换为随时间变化的序列,RNN能够有效建模音频帧之间的前后依赖,从而实现更准确的语音转文字,或将文字序列转化为流畅自然的语音。

- 时间序列预测:在金融(股票价格预测)、气象(天气变化预测)、工业(设备故障预警)等领域,RNN可以分析历史数据序列,挖掘其变化规律,并对未来的趋势进行预测。

与循环神经网络(RNN)相关的术语

要深入理解RNN,可以关联以下概念:长短期记忆网络(LSTM)、门控循环单元(GRU)、序列到序列模型(Seq2Seq)、注意力机制(Attention Mechanism)以及Transformer。

关于循环神经网络(RNN)的延伸阅读

若希望系统学习RNN及其演进,建议从经典论文《Learning Phrase Representations using RNN Encoder-Decoder for Statistical Machine Translation》入手,了解RNN编码器-解码器框架。同时,可以参阅深度学习教科书(如《Deep Learning》)中关于序列建模的章节,并通过在线课程平台(如Coursera, DeepLearning.AI)的专项课程进行实践,亲手搭建和训练简单的RNN模型,以巩固理解。

相关推荐

- 【AI词典】LSTM长短期记忆 - 一种用于处理序列数据的循环神经网络

- 【AI词典】循环神经网络RNN - 具有时序记忆能力的神经网络

- 【AI词典】卷积神经网络CNN - 一种用于图像处理的深度学习模型

- 【AI词典】深度学习 - 基于神经网络的机器学习方法

- 【AI词典】神经网络 - 受生物启发的计算模型

- 对齐税:AI时代,你的每一次选择都在支付“校准成本”

- 【AI词典】知识图谱 - 结构化语义知识库

- Tensor Core 是什么:2026 混合精度计算原理与 AI 应用全面解析

- 【AI词典】向量数据库 - 专为向量化数据设计的高效存储检索系统

- 【AI词典】PEFT参数高效微调 - 高效调整大模型参数的微调技术