【AI词典】学习率 - 控制模型参数更新步长的超参数

AI词典2026-04-23 23:00:00

学习率:定义

学习率是机器学习与深度学习中的一项关键超参数,它定量地控制着模型在每次参数更新时的调整步长,直接决定了模型在优化过程中收敛的速度与最终性能的优劣。

学习率的工作原理

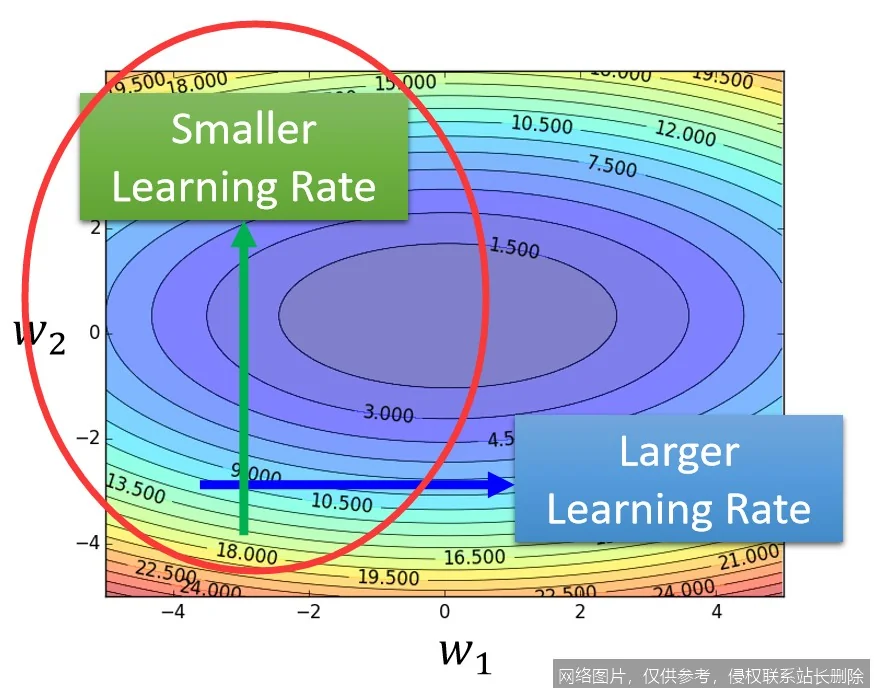

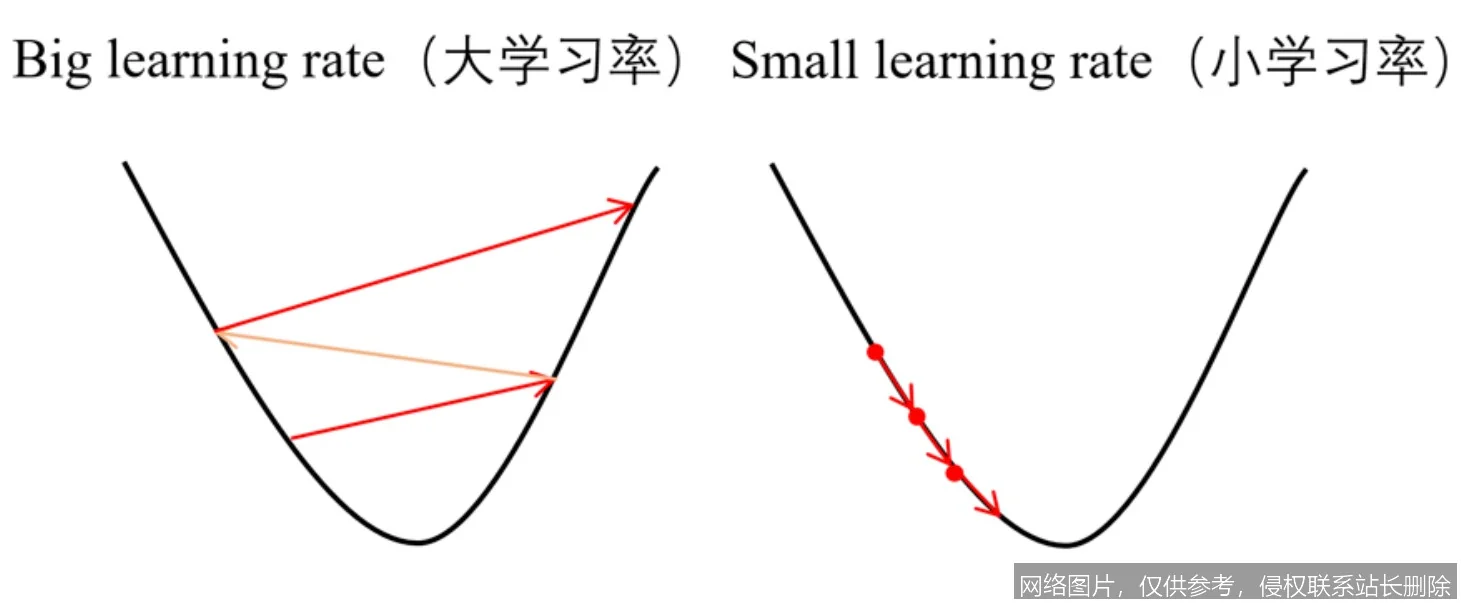

我们可以将模型训练过程想象成一个人在山谷中寻找最低点(即损失函数的最小值)。这个人每走一步,就相当于模型根据当前计算的梯度(山坡最陡的方向)更新一次参数。学习率,正是这一步迈出的“长度”。

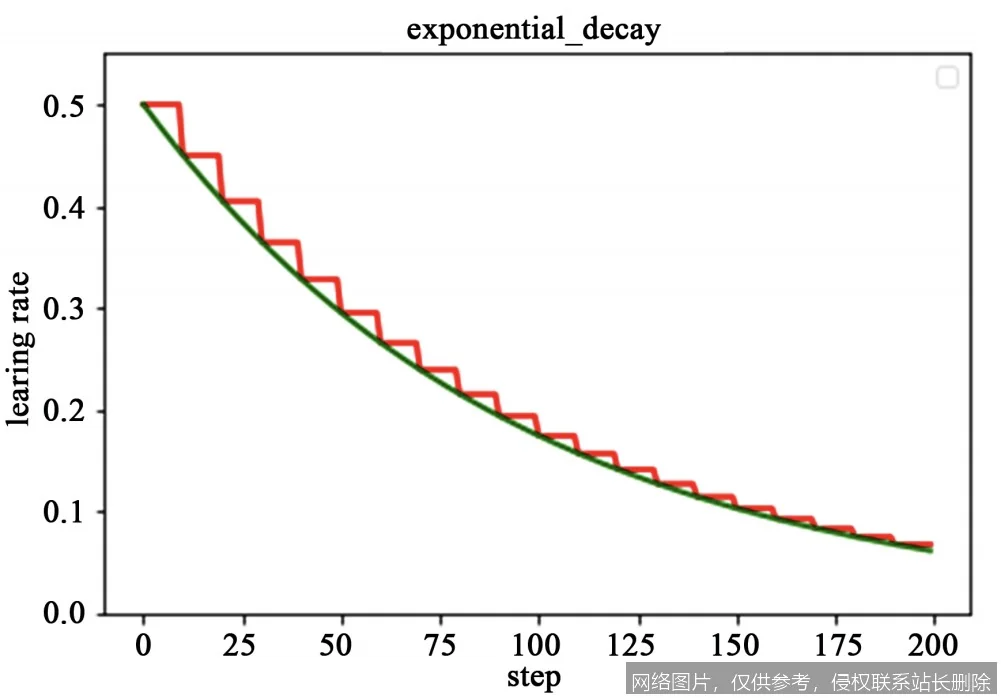

如果学习率设置得过高(步子迈得太大),可能会在最低点附近来回跨越,甚至导致损失值不降反增,模型无法收敛,这种现象称为“振荡”或“发散”。反之,如果学习率设置得过低(步子迈得太小),虽然走向稳定,但寻找最低点的过程会异常缓慢,消耗大量计算资源,并且可能陷入局部最优解而无法找到更好的解。因此,选择一个合适的学习率,或在训练过程中动态调整它,是优化算法的核心任务之一。

学习率的应用场景

- 图像分类模型训练:在训练卷积神经网络(CNN)识别猫狗图片时,初始阶段通常使用较大的学习率进行快速“粗调”,使模型快速靠近最优解区域;在训练后期则切换为较小的学习率进行“微调”,精细地调整参数,以提升模型的最终准确率。

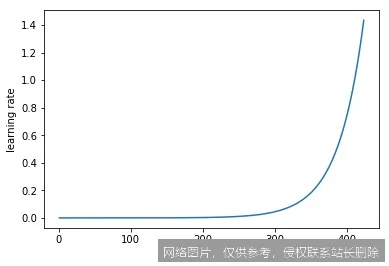

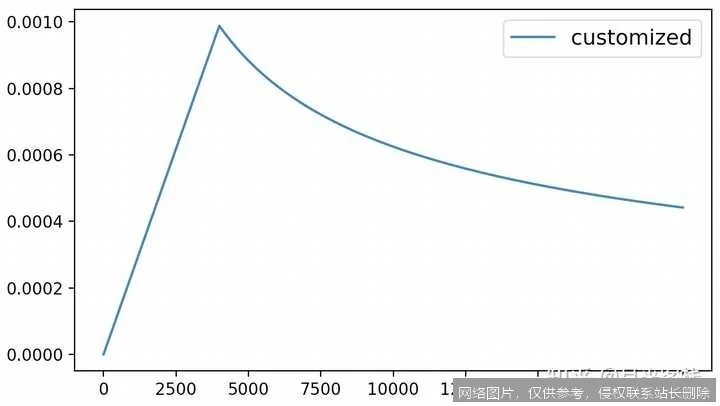

- 自然语言处理预训练:在训练如BERT、GPT等大型语言模型时,研究者会采用复杂的学习率调度策略,例如“热身”阶段,即先从一个很小的学习率开始线性增加,让模型在训练初期稳定适应数据,然后再按余弦或阶梯方式衰减,这是稳定训练超大规模模型的关键技术之一。

- 推荐系统优化:在利用深度学习模型进行点击率预测时,工程师需要根据数据规模和模型结构精心调整学习率。过高的学习率会使模型对用户行为模式的捕捉变得不稳定,而过低的学习率则无法快速响应实时变化的数据流,影响推荐结果的时效性。

相关术语

与学习率紧密相关的概念包括:梯度下降、优化器(如Adam、SGD)、学习率调度器、超参数调优、损失函数以及过拟合。

延伸阅读

若想深入了解学习率的精妙之处,建议阅读深度学习经典教材中关于优化算法的章节,并动手实践不同学习率对简单模型(如线性回归)训练过程的影响。此外,研究论文《Cyclical Learning Rates for Training Neural Networks》中提出的周期性学习率方法,以及现代深度学习框架(如PyTorch、TensorFlow)官方文档中关于学习率调度器的使用,都是极佳的学习资源。