【AI词典】基础模型 - 基于海量数据预训练的大规模人工智能模型

AI词典2026-04-24 16:00:00

基础模型:定义

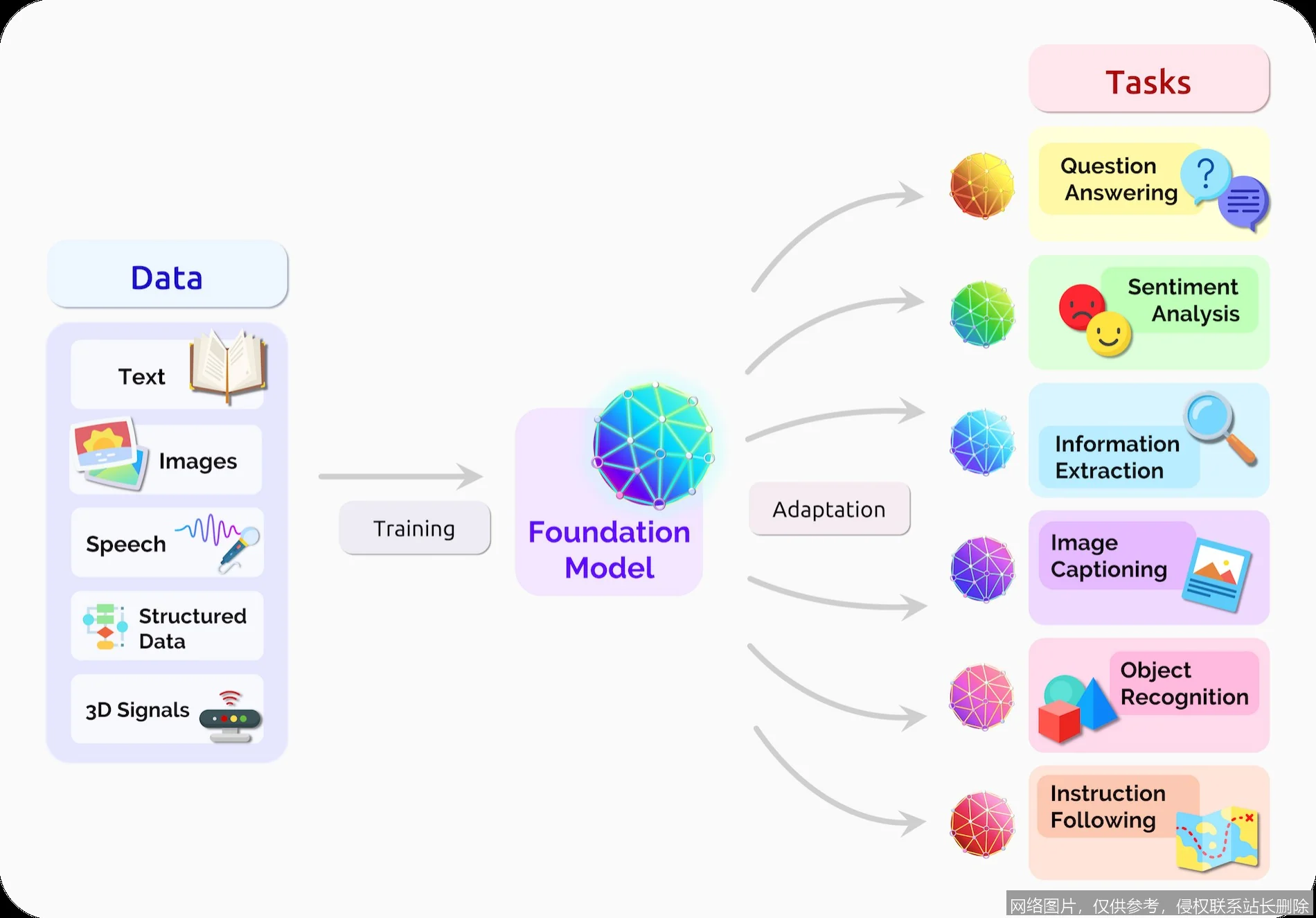

基础模型(Foundation Model)是指在海量、广泛的通用数据上进行预训练,从而获得通用知识表征能力的大规模人工智能模型。其核心特征在于“预训练”与“微调”的范式分离,即先通过无监督或自监督学习构建一个通用的“知识底座”,再针对特定下游任务进行高效适配。

基础模型的工作原理

理解基础模型的工作原理,可以将其想象为一位在图书馆中博览群书的“通才学者”。首先,模型(如Transformer架构)会“阅读”互联网规模的文本、图像或代码数据,通过预测被掩盖的词语、判断句子关系或生成下一段内容等方式进行自我训练。这个过程不针对任何具体任务,目标是学习数据中蕴含的通用模式、语法规则、事实知识和逻辑关联。训练完成后,模型便成为一个具备广泛理解力的“基础”。当需要解决具体问题时,开发者只需用少量特定领域的标注数据对这个“通才学者”进行“点拨式”的微调,它就能迅速将通用知识迁移到新任务上,例如从通用对话转向客服问答,或从理解图片转向医疗影像分析。

基础模型的应用场景

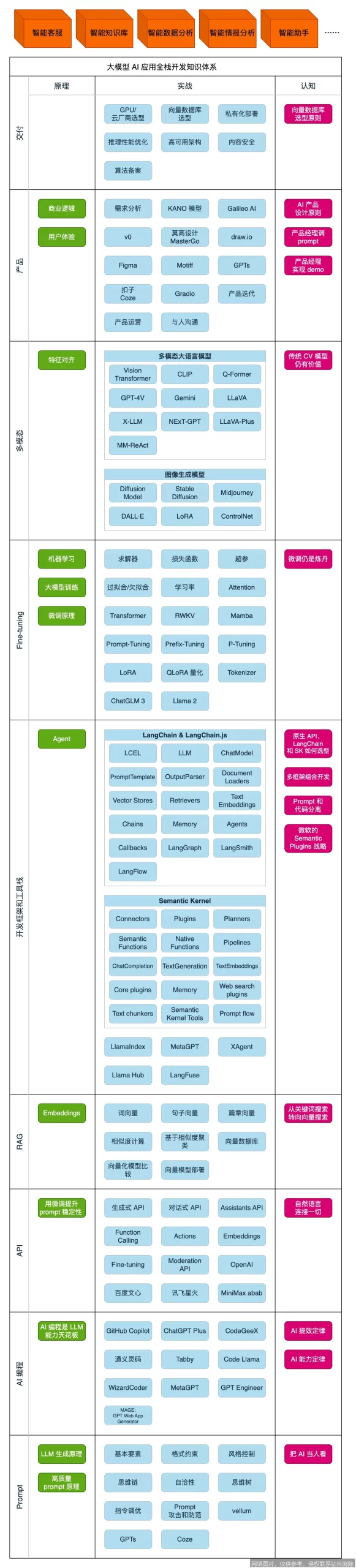

- 智能内容生成与交互:以GPT系列、文心一言等大型语言模型为代表,直接驱动聊天机器人、辅助写作、代码生成、多轮对话等应用,成为AIGC(人工智能生成内容)的核心引擎。

- 跨模态理解与生成:如CLIP(连接文本与图像)、Stable Diffusion等模型,能够理解文字描述并生成对应图像,或对图像进行基于语义的搜索与编辑,推动创意设计、媒体制作等领域变革。

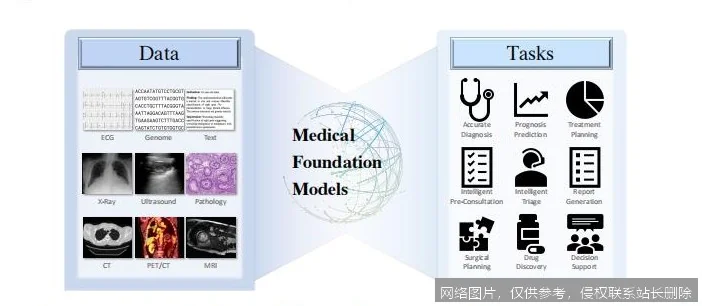

- 专业领域赋能:在金融、法律、生物医药等领域,基于通用基础模型进行领域数据微调,快速构建智能研报分析、法律文书审阅、蛋白质结构预测等专业工具,大幅降低领域AI的开发门槛与成本。

相关术语

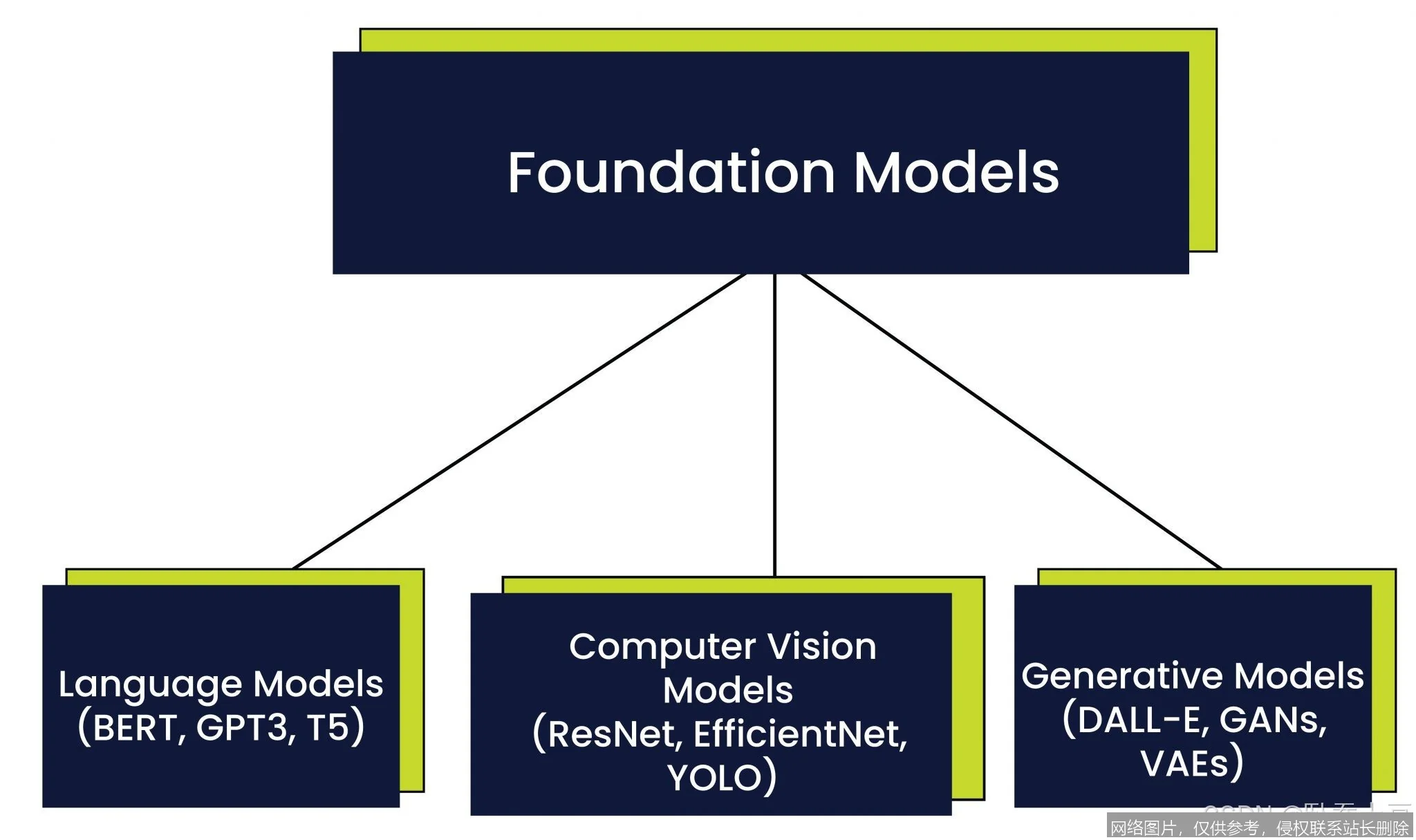

理解基础模型,常需关联以下概念:其核心训练范式预训练与微调;支撑其实现的主流架构Transformer;其训练所依赖的自监督学习;以及由其能力衍生出的大语言模型和生成式人工智能等具体方向。

延伸阅读

若想深入了解基础模型,建议从斯坦福大学基础模型研究中心(CRFM)发布的《基础模型:机遇与风险》报告入手,该报告系统阐述了其技术原理、能力与社会影响。同时,关注如BERT、GPT系列、DALL-E等标志性模型的原始论文,能帮助理解技术演进的脉络。对于开发者,Hugging Face等开源平台提供了实践这些模型的丰富教程与工具。