【AI词典】随机梯度下降SGD - 一种高效的优化算法

随机梯度下降SGD:定义

随机梯度下降(Stochastic Gradient Descent, SGD)是一种用于优化机器学习模型参数的迭代算法,其核心思想是通过每次随机选取一个(或一小批)训练样本来计算梯度并更新模型参数,从而高效地逼近损失函数的最小值。

随机梯度下降SGD的工作原理

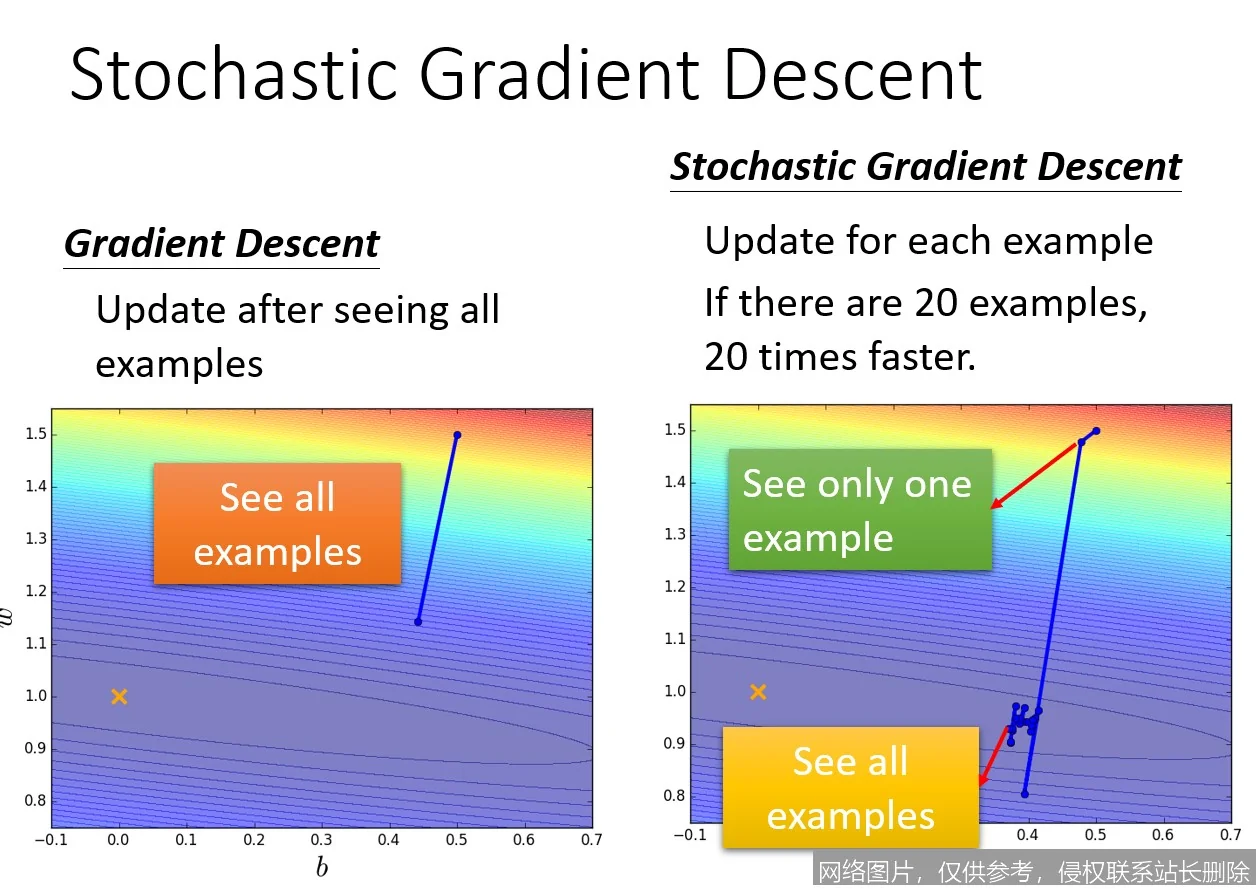

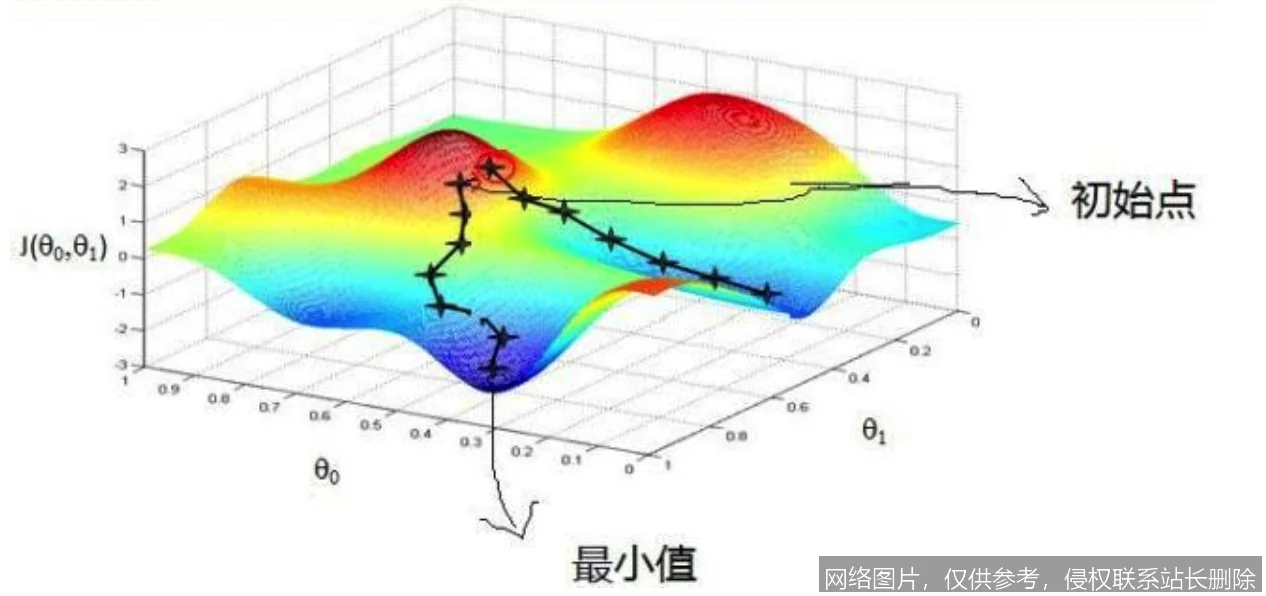

想象你身处一片多山多谷的复杂地形(代表模型的损失函数),目标是找到最低的谷底(最优参数)。最“笨”但最稳的方法是梯度下降:你环顾四周,精确测量出整个地形最陡的下坡方向(基于全部数据计算梯度),然后走一步。这非常准确,但每次测量都耗时巨大。

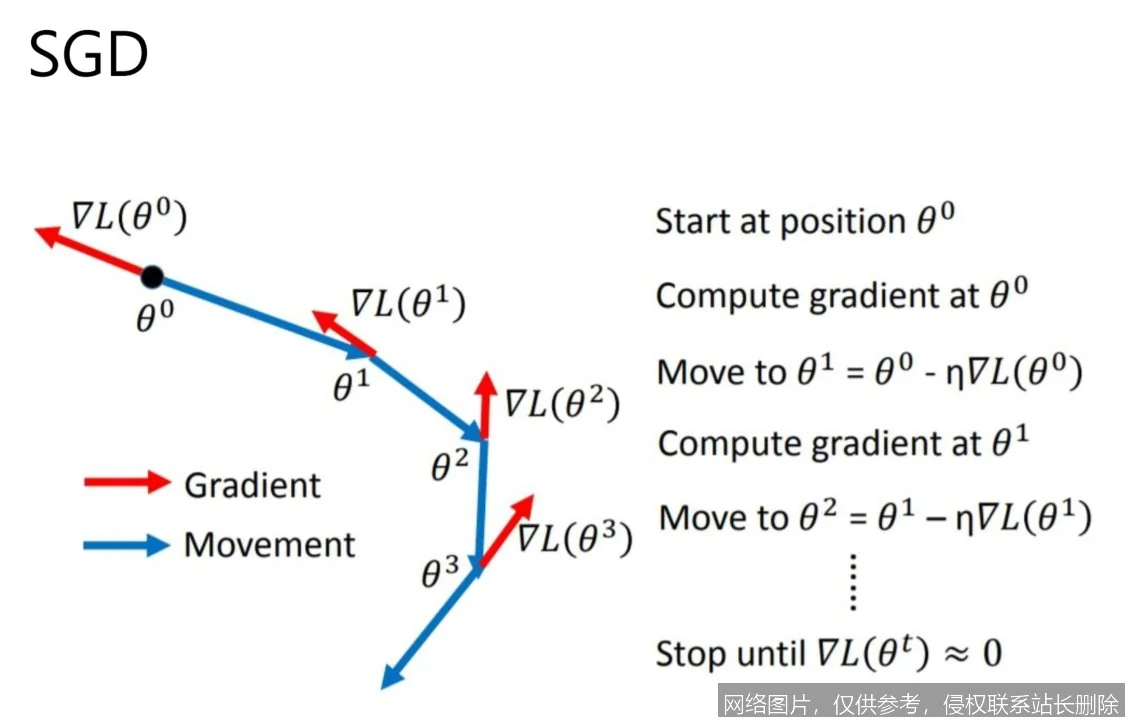

随机梯度下降SGD则采用了更灵活的策略:你不再每次都测量整个地形,而是随机捡起脚边的一块石头(一个随机样本),仅根据这块石头所在位置的坡度(单个样本的梯度)来决定前进方向。虽然单次方向可能不准、有噪声,甚至偶尔指向错误的上坡,但通过大量、快速的随机尝试,整体上你依然能以极高的效率蜿蜒向下,最终抵达谷底附近。为了控制步幅的震荡并最终稳定收敛,算法通常会配合使用学习率衰减策略。

随机梯度下降SGD的应用场景

- 大规模深度学习模型训练:在训练拥有数百万甚至数十亿参数的深度神经网络时,使用全部数据计算梯度(批量梯度下降)在计算和内存上都是不可行的。SGD及其变体(如小批量SGD)成为事实上的标准,它允许模型在海量数据上通过频繁的、低成本的参数更新进行学习。

- 在线学习与流式数据处理:对于电商推荐系统或新闻排序模型,数据以流的形式实时产生。SGD能够在新数据到达时立即基于单个或少量新样本更新模型,使模型快速适应最新的用户行为和趋势,实现真正的在线增量学习。

- 支持向量机与逻辑回归优化:在传统的机器学习模型中,SGD因其简单高效,常被用作求解凸优化问题(如SVM的铰链损失、逻辑回归的对数损失)的利器,特别是在数据维度高、样本量大的场景下,其速度优势明显。

与随机梯度下降SGD相关的术语

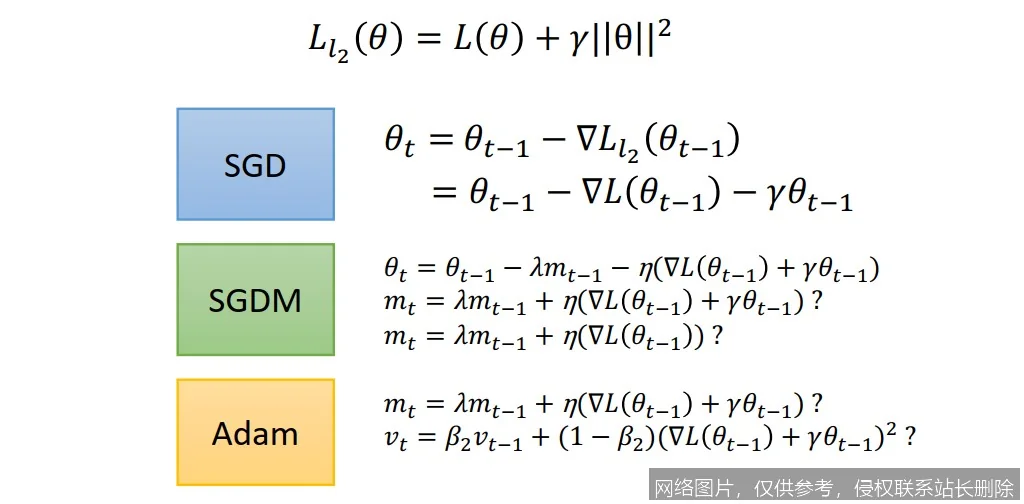

理解SGD有助于串联以下核心概念:其基础版本为梯度下降;每次使用一小批样本的折中方法称为小批量梯度下降;为应对其更新方向噪声大、收敛慢的问题,衍生出了动量法、AdaGrad、RMSProp以及目前广泛使用的Adam等优化器;其优化的目标函数通常称为损失函数;控制更新步长的关键参数是学习率。

延伸阅读建议

若想深入理解SGD,建议从经典的机器学习教材(如《Pattern Recognition and Machine Learning》)中学习其数学基础与收敛性分析。同时,通过动手实践,在TensorFlow或PyTorch等框架中对比SGD与其变体在不同任务(如图像分类、自然语言处理)上的训练曲线和最终性能,能获得最直观的认知。研究论文《On the importance of initialization and momentum in deep learning》对SGD与动量的深刻见解也极具启发性。