【AI词典】预训练模型 - 基于海量数据预先训练的通用模型

AI词典2026-04-24 04:36:00

预训练模型:定义

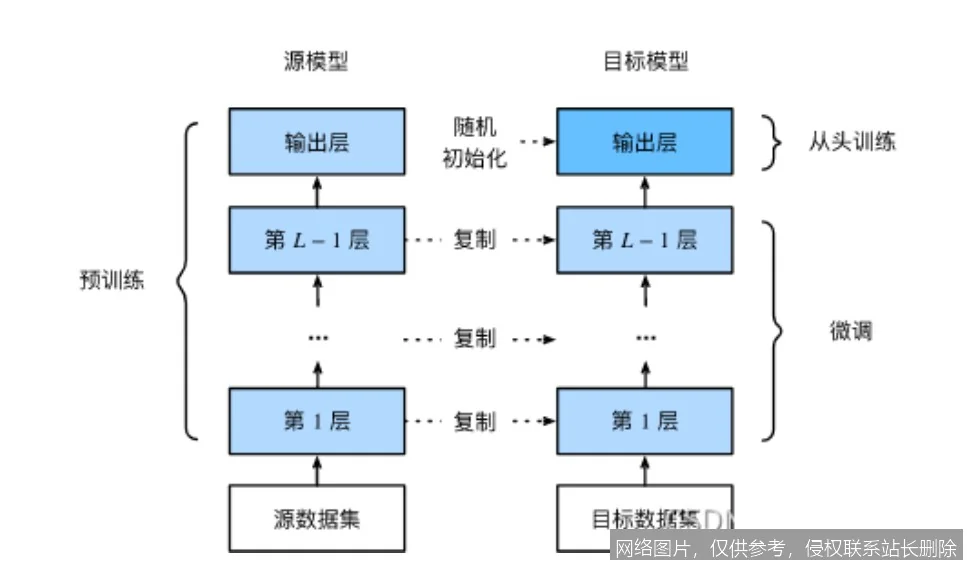

预训练模型(Pre-trained Model)是一种在特定任务之前,利用海量无标注或通用标注数据预先训练出通用知识表征的机器学习模型。其核心价值在于将学习到的通用知识(如语言规律、视觉特征)作为基础,通过微调高效适配下游任务。

预训练模型的工作原理

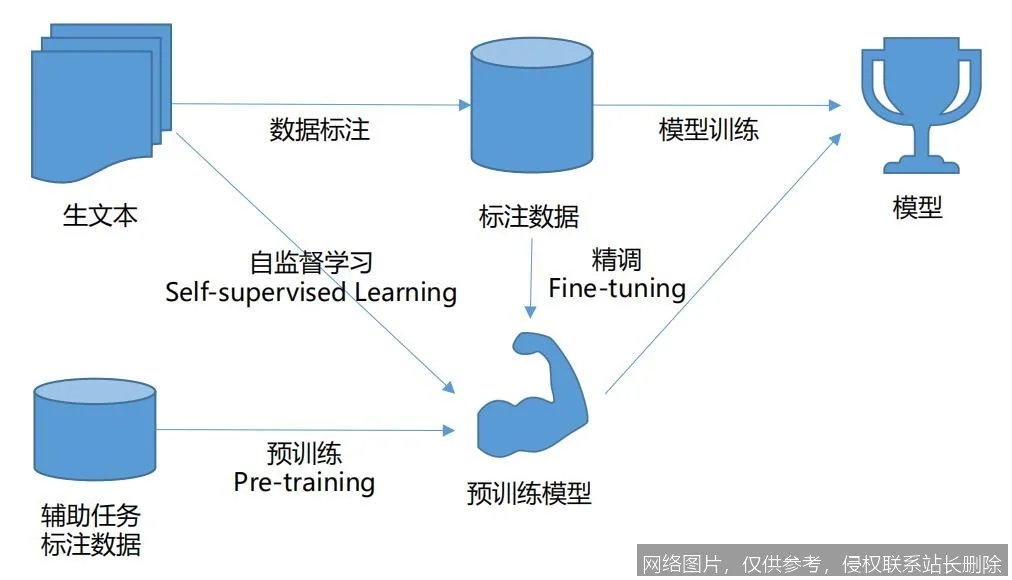

理解预训练模型,可以将其比作一位在“通识大学”完成基础教育的毕业生。在“预训练”阶段,模型通过自监督学习等方式,在庞大的文本、图像或语音数据中学习最基础、最通用的模式和规律。例如,语言模型通过预测被掩盖的词语来理解语法和语义,视觉模型通过判断图像片段是否属于同一张图片来识别物体结构。这个过程不针对任何具体工作,但让模型获得了深厚的“知识底蕴”。当面临具体的“下游任务”(如情感分析、医学影像诊断)时,只需像对毕业生进行短期“岗位培训”(即微调),用少量任务特定数据调整模型参数,即可使其快速胜任新工作,极大节省了从零开始训练所需的数据、算力和时间。

预训练模型的应用场景

- 自然语言处理(NLP):以BERT、GPT系列为代表的大语言模型已成为NLP的基石。它们被微调后广泛应用于智能客服对话系统、文本摘要与翻译、代码自动生成以及情感分析等领域,显著提升了语言理解和生成的智能化水平。

- 计算机视觉(CV):在ImageNet等数据集上预训练的视觉模型(如ResNet、ViT),是图像识别、目标检测、自动驾驶感知等任务的强大起点。工程师可以基于这些模型,利用特定领域的图像数据(如工业缺陷图片)进行微调,快速构建高精度视觉系统。

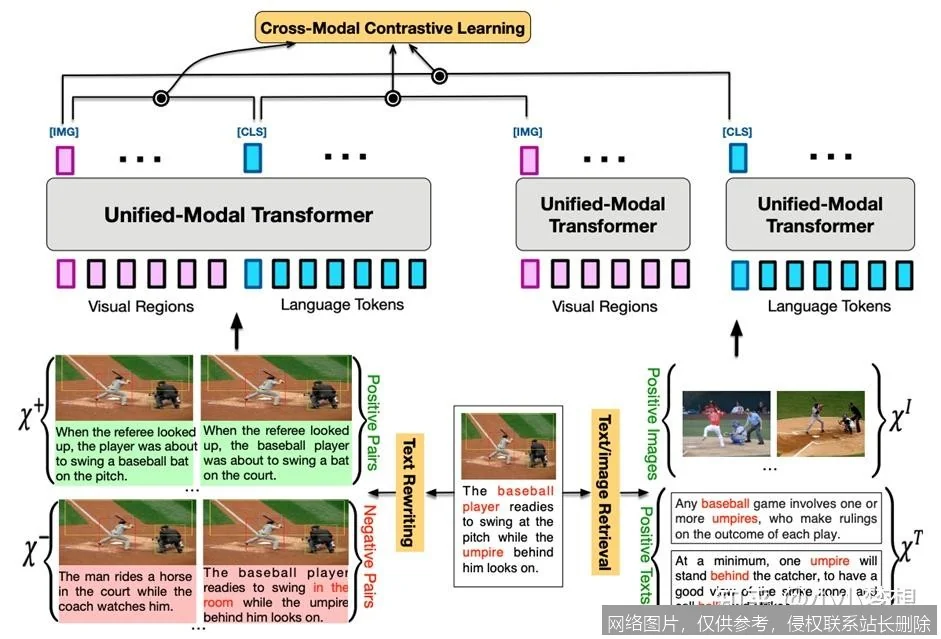

- 跨模态智能:如CLIP等模型,通过在图文对数据上预训练,学会了图像与文本的关联。这直接赋能了以文搜图、图像内容描述、跨模态内容审核等创新应用,推动了多模态人工智能的发展。

相关术语

与预训练模型紧密相关的概念包括:微调、大语言模型、自监督学习、基础模型、迁移学习以及Transformer架构。

延伸阅读

若想深入了解预训练模型的技术演进,可重点研究Transformer架构的原始论文《Attention Is All You Need》,以及BERT、GPT-3等里程碑模型的论文。对于行业应用动态,关注各大AI研究机构(如OpenAI、Google AI、智源研究院)发布的技术报告和博客是很好的途径。

下一篇

已是最新文章