【AI词典】Embedding - 将数据映射为低维向量的技术

AI词典2026-04-19 03:12:00

Embedding是什么?

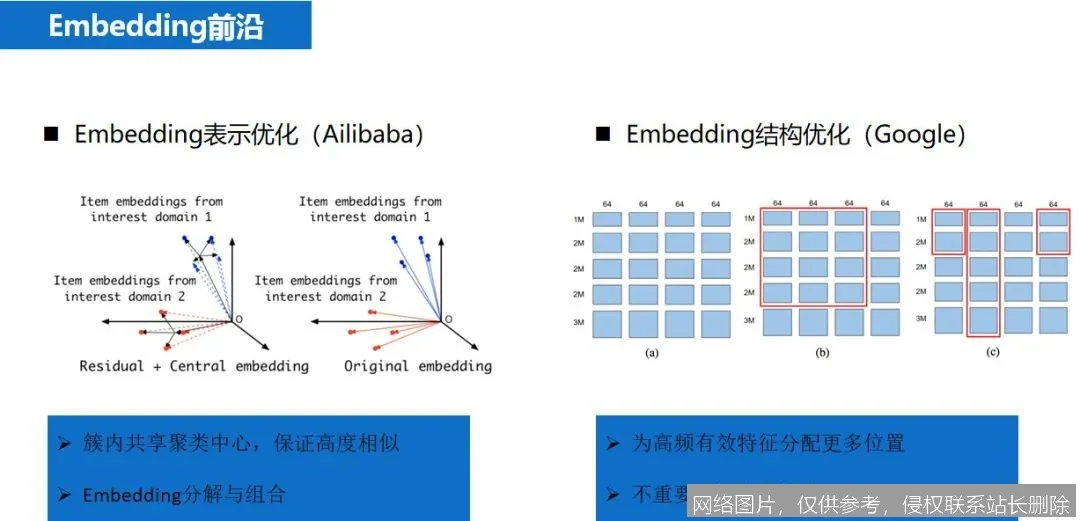

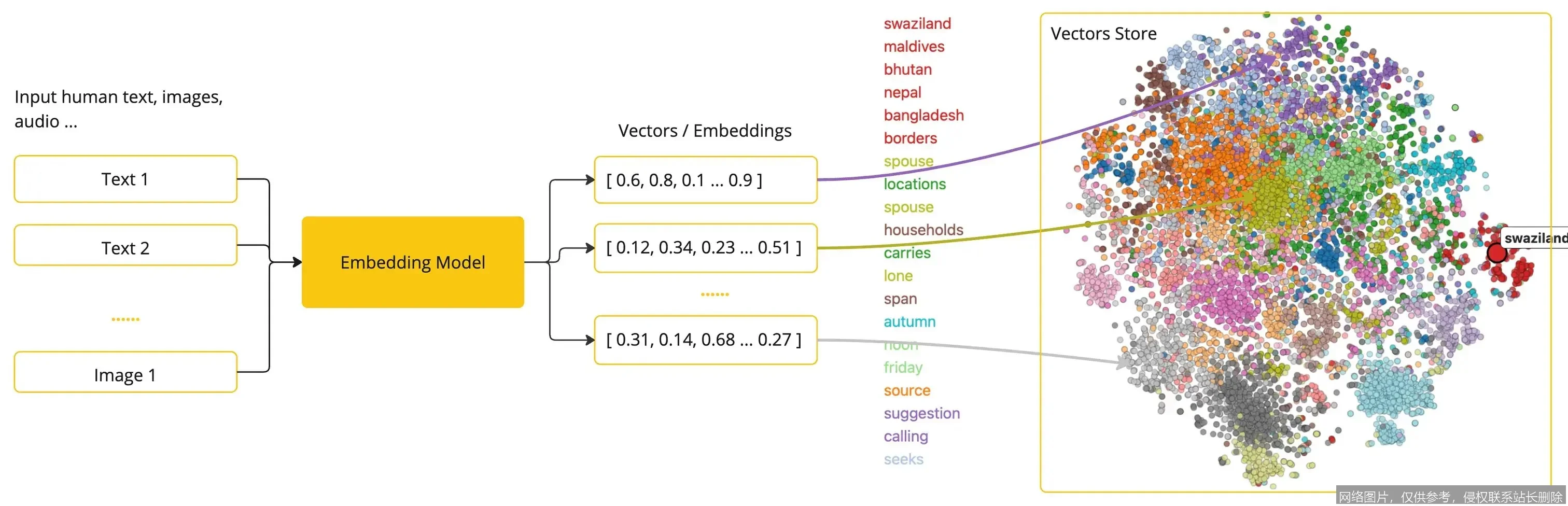

Embedding(嵌入)是一种将高维、离散或非结构化的数据对象(如词语、图像、用户ID)映射为低维、连续的实数向量的核心技术。 这个生成的向量,即“嵌入向量”,能够在一个稠密的向量空间中捕捉和表征原始数据的本质特征与语义关系。

Embedding的工作原理

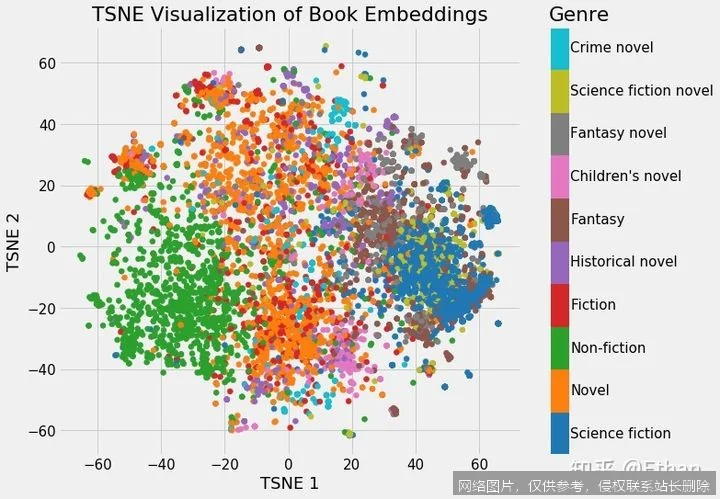

想象一下,你需要为图书馆的所有书籍安排座位。如果按书名首字母排序,语义上相关的书(如《机器学习导论》和《深度学习实战》)可能相距甚远。Embedding技术则像一个智能的图书管理员,它通过分析书籍的内容(共现关系、上下文),将主题、领域相似的书籍安排在向量空间里彼此靠近的位置。

具体而言,以词嵌入为例,模型(如Word2Vec)通过让一个词语在大量文本中“观察”其周围的邻居词语来学习。经过训练后,语义相近的词(如“国王”和“王后”)或具有特定关联的词(如“巴黎”和“法国”)其对应的向量在空间中的方向与距离会非常接近。这种“相近性”可以通过向量运算来体现,例如经典的“国王 - 男人 + 女人 ≈ 王后”。

Embedding的主要应用场景

- 自然语言处理: 这是Embedding的起源和核心应用领域。词嵌入或句子嵌入为机器理解语言提供了数学基础,被广泛应用于语义搜索(匹配用户查询与文档的深层含义)、文本分类、智能问答以及大语言模型的底层表示中。

- 推荐系统: 将用户和物品(商品、电影、新闻)分别表示为嵌入向量。系统通过计算用户向量与物品向量之间的相似度(如余弦相似度)来预测用户可能感兴趣的物品,从而实现“物以类聚、人以群分”的个性化推荐。

- 计算机视觉: 图像嵌入技术可以将图片转换为特征向量。这使得以图搜图、图像聚类和视觉内容推荐成为可能。例如,系统能识别出向量空间里靠近的图片,可能都是“海滩日落”或“卡通猫”的主题。

相关术语

理解Embedding时,常会关联以下概念:向量空间模型、Word2Vec、相似度计算、特征学习、降维以及大语言模型。

延伸阅读

若想深入了解Embedding,可以从经典的Word2Vec论文《Efficient Estimation of Word Representations in Vector Space》入手。同时,学习注意力机制和Transformer架构如何生成更动态的上下文嵌入,是理解现代AI模型(如BERT、GPT系列)的关键进阶路径。

相关推荐

- 【AI词典】Fine-tuning微调 - 预训练模型的针对性优化

- 【AI词典】Embedding - 将数据映射为低维向量的技术

- 【AI词典】Token - 文本处理的基本语义单元

- 【AI词典】BERT - 谷歌预训练语言理解模型

- 【AI词典】GPT - 生成式预训练Transformer模型

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型