【AI词典】Token - 文本处理的基本语义单元

AI词典2026-04-19 01:48:00

Token是什么:AI理解文本的基石

在人工智能(AI)和自然语言处理(NLP)领域,Token是文本被分割后的最小语义处理单元,它是大语言模型(LLM)理解和生成语言的基础“砖块”。 它可以是单词、子词、单个字符甚至标点符号,其具体形态取决于模型所使用的分词算法。

Token的工作原理:从文本到数字的桥梁

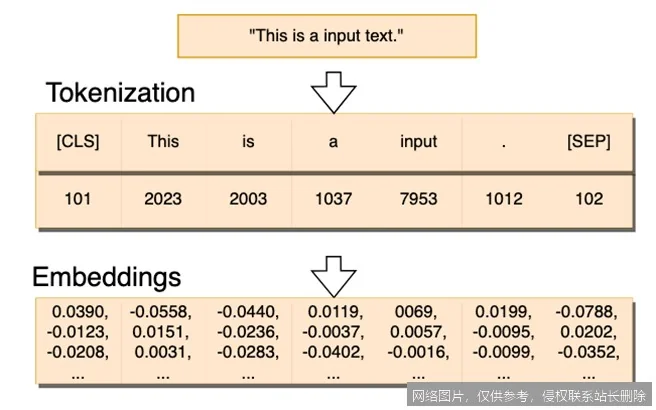

你可以将Token的生成过程理解为一种智能的“切分”与“编码”。首先,分词器(Tokenizer)根据预设规则将原始文本(如一个句子)切割成一个个Token。这个过程并非简单的按空格分割,例如,“ChatGPT”可能被切分为“Chat”和“GPT”两个子词Token,而中文“人工智能”可能被整体作为一个Token,也可能被切分为“人工”和“智能”。随后,每个唯一的Token都会被分配一个唯一的数字ID,形成一个庞大的“词汇表”。最终,一段文本在模型中就被转换为一串数字序列(Token ID序列),模型的所有计算都基于这些数字进行。这就像为每个概念或语言片段建立了一个专属身份证,方便计算机高效处理。

Token的核心应用场景

- 模型训练与上下文长度限制:大语言模型的训练和推理都以Token数量为计量单位。模型的“上下文窗口”(如128K Tokens)直接决定了其单次能处理多长的文本。计算API调用成本时,也通常按输入和输出的总Token数计费。

- 文本生成与内容控制:模型以Token为单位进行“思考”和输出。通过控制生成的最大Token数,可以限制回答的长度。在内容安全领域,对特定Token序列的过滤是防止模型生成有害内容的关键技术之一。

- 跨语言与代码处理:统一的Token化方案使模型能够处理多种语言和编程代码。无论是英文单词、中文汉字,还是Python代码中的“def”关键字,都会被转化为Token,使模型具备多任务处理能力。

相关术语

理解Token有助于串联以下核心概念:负责切割文本的分词器;Token在数字世界中的身份标识Token ID;模型单次处理Token的总数上限上下文窗口;以及衡量文本长度的Token计数。

延伸阅读

若想深入了解Token的实践影响,建议探索不同模型(如GPT系列与开源模型)所采用的分词策略差异(如Byte-Pair Encoding, WordPiece),并实际使用在线Token计数器分析中英文混合文本的切割结果,这能直观揭示分词如何影响模型对语义的理解边界。

相关推荐

- 【AI词典】Embedding - 将数据映射为低维向量的技术

- 【AI词典】Token - 文本处理的基本语义单元

- 【AI词典】BERT - 谷歌预训练语言理解模型

- 【AI词典】GPT - 生成式预训练Transformer模型

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型

- 什么是 A100?2026 最新定义、架构原理与数据中心实战详解