【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型

AI词典2026-04-18 17:24:00

大语言模型定义

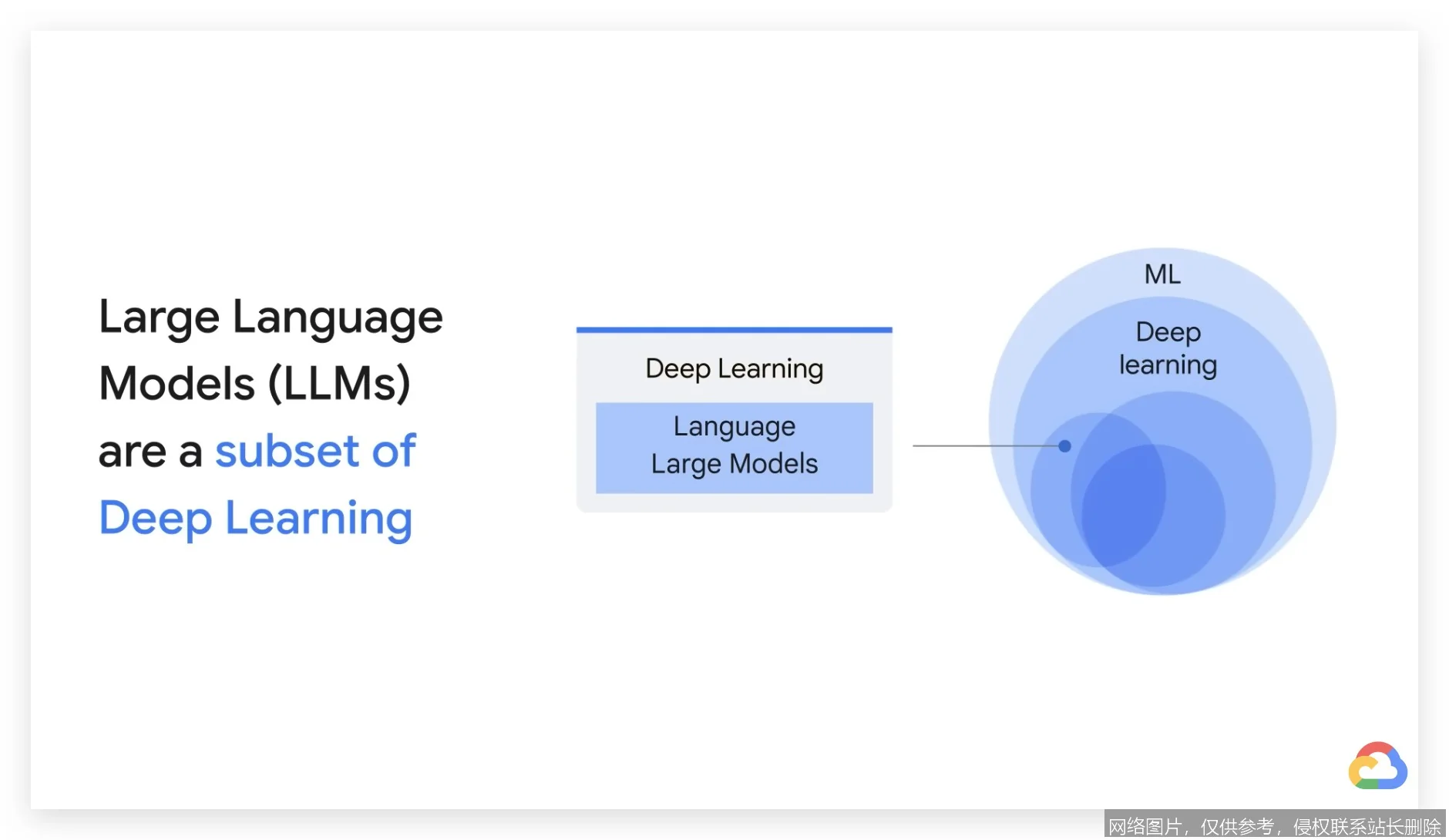

大语言模型是一种基于海量文本数据训练、拥有巨量参数规模的人工智能模型,其核心能力在于理解、生成和推理人类自然语言。它通过捕捉语言中的统计规律和深层语义关联,能够执行多样化的语言任务,而无需为每个任务进行专门编程。

大语言模型的工作原理

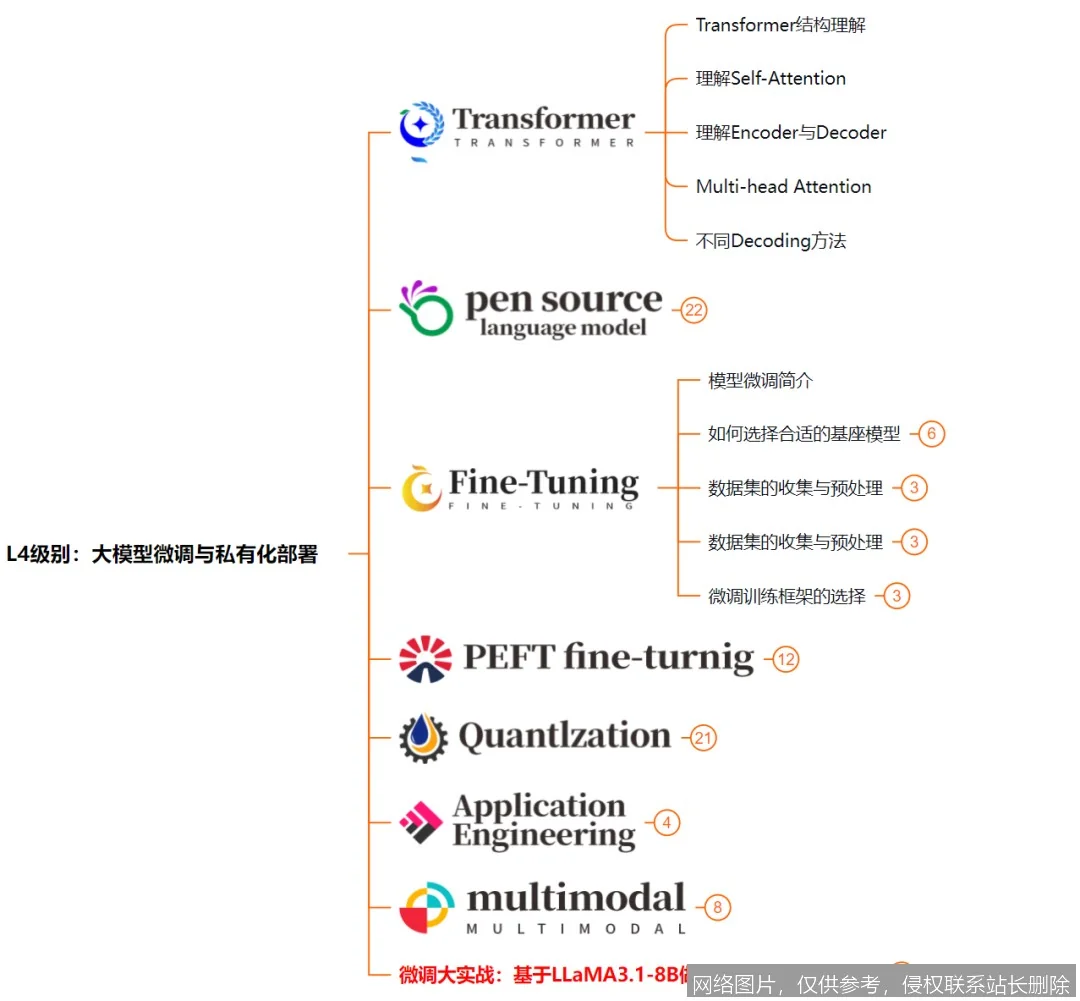

大语言模型的工作原理可以类比为一个博览群书、记忆力超群的“语言学徒”。其训练分为两个关键阶段:首先,在“预训练”阶段,模型“阅读”互联网规模的文本数据(如网页、书籍、文章),学习预测句子中被掩盖的词语或下一个词是什么。这个过程使其掌握了词汇、语法、事实知识乃至一定的逻辑推理模式,所有学到的知识以“参数”(即模型中可调整的数字权重)的形式存储。随后,在“微调”或“对齐”阶段,模型通过指令学习和人类反馈强化学习等技术进行优化,使其输出更符合人类指令、更有用且更安全。当用户输入一个提示时,模型便基于其参数中编码的“知识”,计算出最可能的下一个词序列,从而生成连贯的回复。

大语言模型的应用场景

- 智能内容创作与辅助:协助用户撰写邮件、报告、营销文案、代码或诗歌小说,提供创意灵感、语法润色和风格调整,显著提升写作效率。

- 知识问答与信息整合:充当强大的交互式知识库,能够快速解答复杂问题、总结长篇文档、翻译不同语言,并从海量信息中提取关键要点。

- 个性化AI助手与对话系统:作为聊天机器人、智能客服或私人助理的核心引擎,提供高度拟人化的对话体验,完成任务规划、学习辅导、情感陪伴等复杂交互。

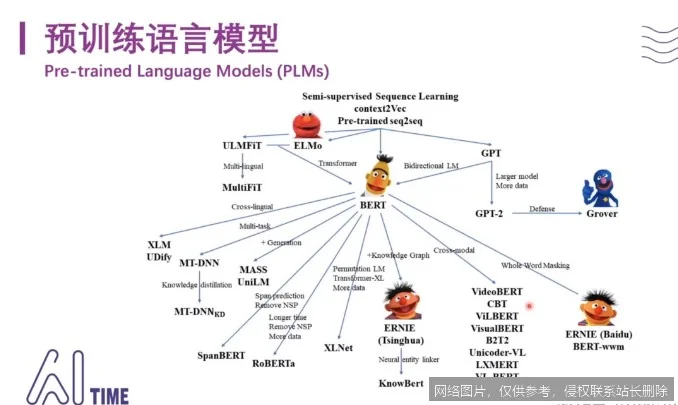

相关术语

理解大语言模型,常涉及以下概念:其基础架构通常为Transformer;训练过程涉及预训练与微调;其涌现的复杂推理能力与思维链提示密切相关;而确保其行为符合人类价值观的关键技术是人类反馈强化学习。

延伸阅读

若想深入了解大语言模型的技术演进,可阅读关于Transformer架构的原始论文《Attention Is All You Need》。对于其能力边界与社会影响的探讨,推荐关注AI伦理研究机构发布的相关报告,例如对模型“幻觉”现象及缓解策略的分析。此外,通过实践使用主流的开源或商业大语言模型API,是直观理解其能力与局限的最佳途径。

相关推荐

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型

- 什么是 A100?2026 最新定义、架构原理与数据中心实战详解

- vLLM:解锁大语言模型推理速度的终极武器

- Diffusers 是什么?2026 扩散模型原理、应用与实战全面解析

- 什么是 Azure Text to Speech?2026 年神经语音合成原理与应用全解析

- 开源协议是什么:2026 年最新定义、核心原理与商业应用全解析

- Streamlit 是什么:2026 数据应用开发原理、实战与全面解析

- 激活函数是什么:2026 最新定义、核心原理与深度应用全面解析