【AI词典】Fine-tuning微调 - 预训练模型的针对性优化

AI词典2026-04-19 04:36:00

Fine-tuning微调:定义

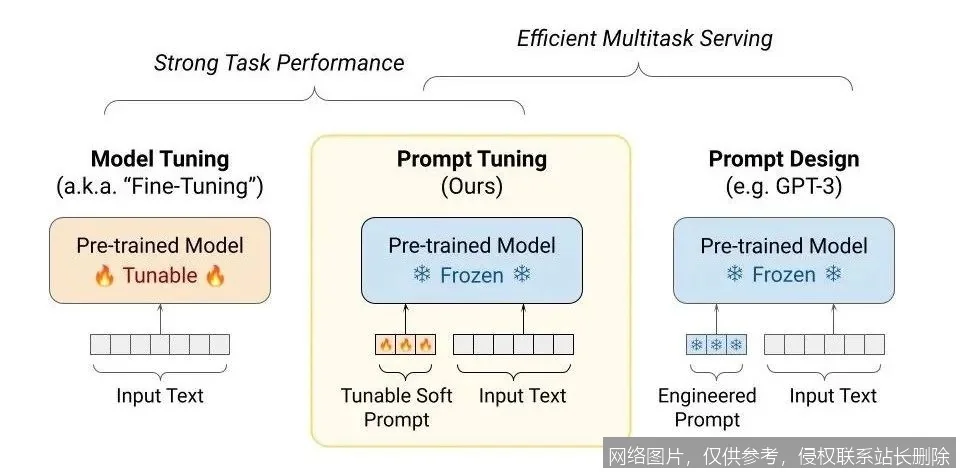

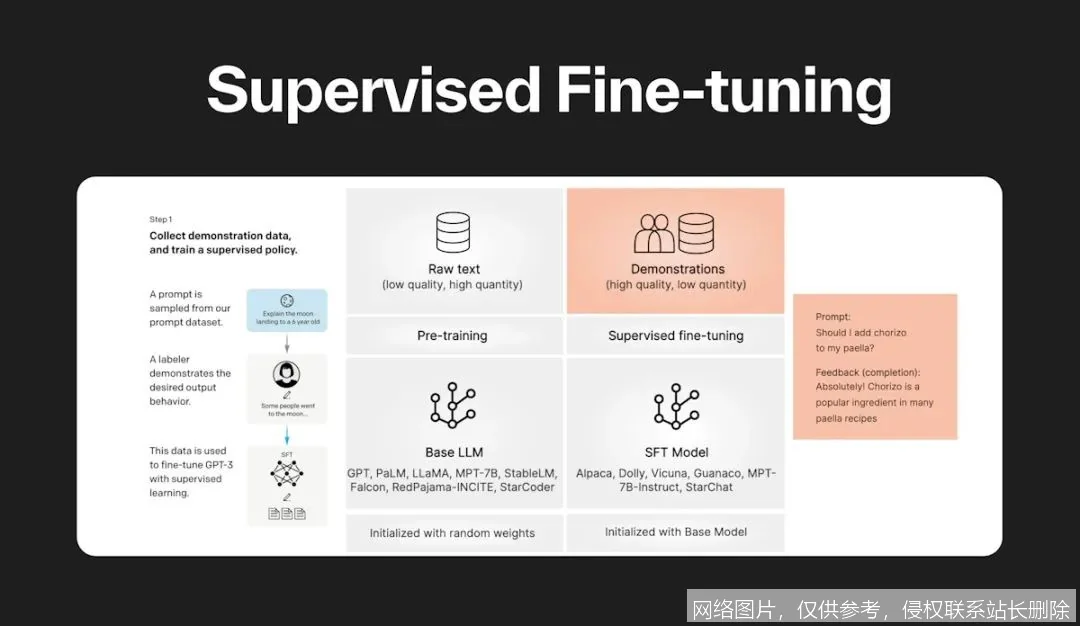

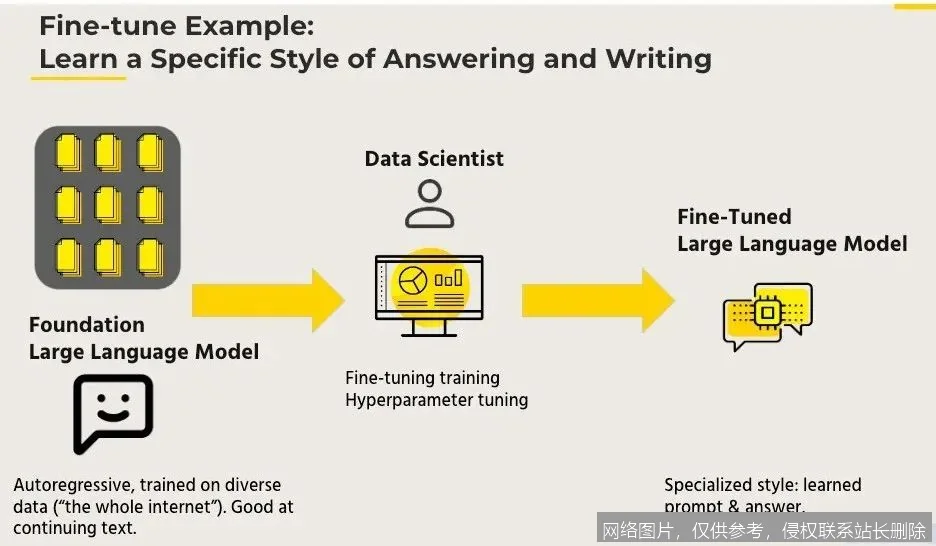

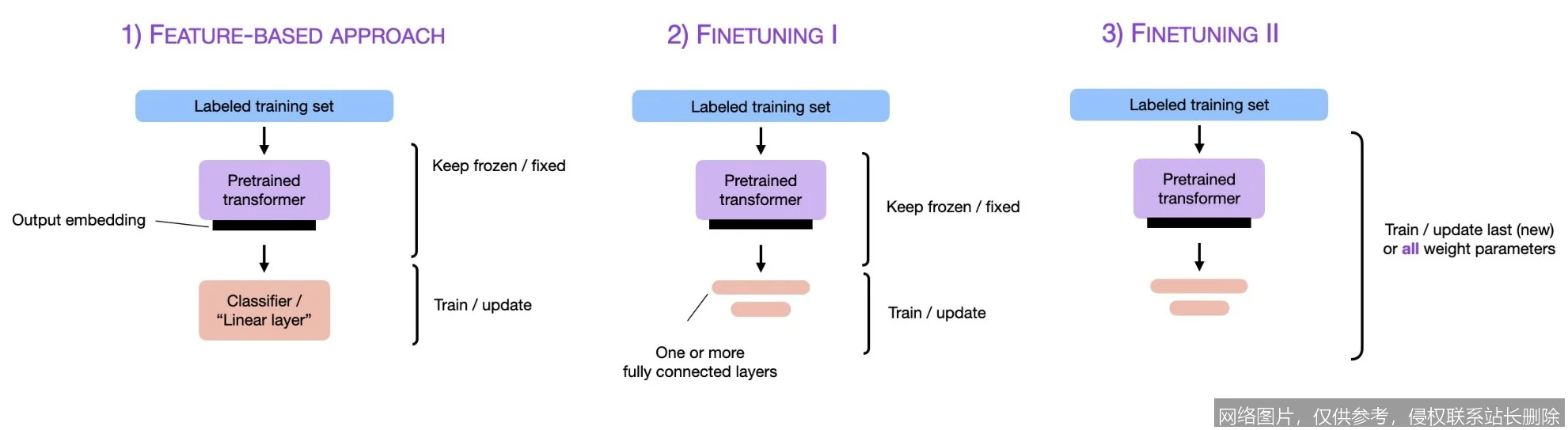

Fine-tuning(微调)是一种迁移学习技术,指在通用预训练模型的基础上,使用特定领域或任务的较小规模数据集进行额外训练,从而使其适应新任务、提升性能并节省计算资源。

Fine-tuning微调的工作原理

理解微调原理的一个经典类比是“专家再深造”。想象一个在广泛学科(如数学、文学、科学)上知识渊博的通才(即预训练模型,如大语言模型或视觉基础模型)。当需要他成为一名出色的法律顾问时,我们不会让他从零开始重学所有知识。相反,我们会让他集中、深入地研读大量的法律条文和案例(特定领域数据),在此过程中,他原有的逻辑推理、语言理解等通用能力得到保留和强化,同时将知识结构精细地调整到法律领域,最终成为该领域的专家。

从技术层面看,微调通常不会改变预训练模型的整体架构。训练过程涉及加载预训练权重作为起点,然后在目标数据集上以较低的学习率继续训练全部或部分网络层。通过这种方式,模型既能继承从海量数据中学到的通用特征和模式,又能将参数向新数据的分布进行细微调整,实现“举一反三”。

Fine-tuning微调的应用场景

- 垂直领域智能客服:将通用对话模型(如ChatGPT的基座模型)使用某公司的产品手册、历史客服问答记录进行微调,使模型能精准理解行业术语、熟悉公司政策,提供高度专业和准确的客户服务。

- 医学影像辅助诊断:在ImageNet等通用数据集上预训练的视觉模型,通过使用大量标注的肺部X光片或皮肤病变图像进行微调,可以学会识别特定的医学病理特征,辅助医生进行筛查和诊断。

- 个性化内容生成:创作者或企业可以使用自己独特的文案、风格指南微调一个文本生成模型,使其能够模仿特定的写作风格、语气或品牌声音,用于自动生成营销文案、社交媒体内容等。

相关术语

与Fine-tuning微调紧密相关的概念包括:预训练模型、迁移学习、提示工程、参数高效微调(如LoRA)、领域适应以及基础模型。

延伸阅读

若想深入了解微调的技术细节与最新进展,可关注“参数高效微调”方法(如LoRA, QLoRA),这些技术旨在以极小的参数量达到接近全参数微调的效果。同时,研究“指令微调”如何将预训练模型转化为遵循人类指令的对话助手,也是理解当前大模型应用的关键。相关的学术论文通常发表于NeurIPS、ICLR等顶级机器学习会议。

下一篇

已是最新文章

相关推荐

- 【AI词典】Fine-tuning微调 - 预训练模型的针对性优化

- 【AI词典】Embedding - 将数据映射为低维向量的技术

- 【AI词典】Token - 文本处理的基本语义单元

- 【AI词典】BERT - 谷歌预训练语言理解模型

- 【AI词典】GPT - 生成式预训练Transformer模型

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型