【AI词典】BERT - 谷歌预训练语言理解模型

BERT是什么?定义

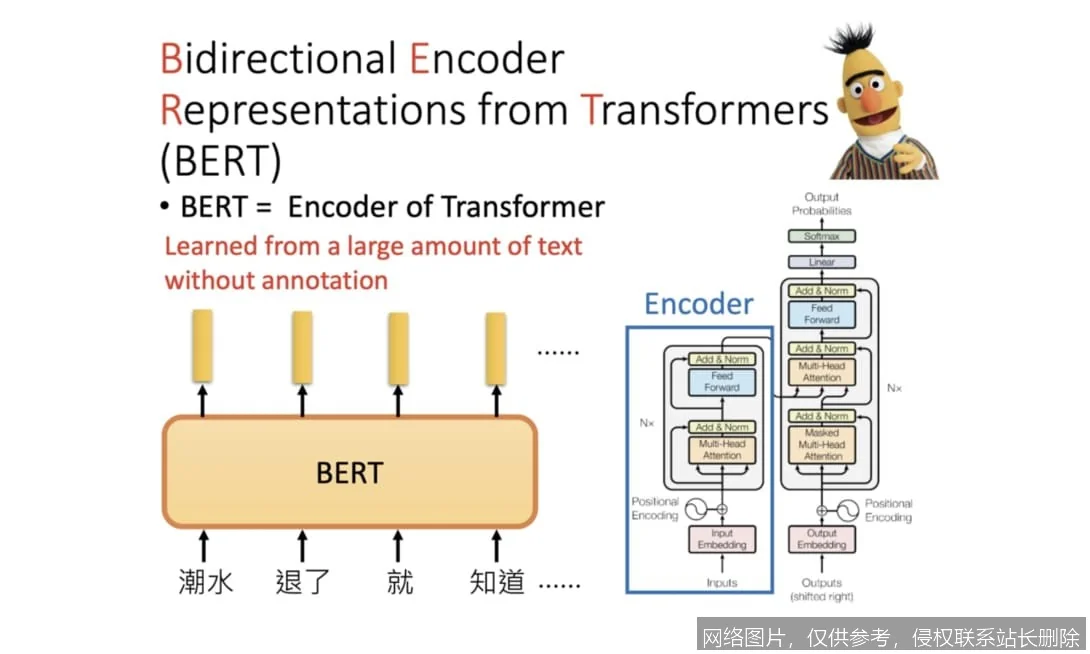

BERT(Bidirectional Encoder Representations from Transformers)是谷歌于2018年发布的一种基于Transformer架构的预训练语言理解模型,其核心创新在于通过“双向”上下文训练,使模型能够更深刻地理解词语在句子中的真实含义。

BERT的工作原理

传统语言模型(如GPT)在训练时通常只从左到右或从右到左单向地预测下一个词,这限制了模型对上下文的全盘理解。BERT的突破在于其“双向”训练策略。想象一下,在玩“完形填空”游戏时,你不是只根据前面的文字,而是可以同时参考空白处前后的所有信息来猜测缺失的词语,这会使你的判断准确得多。BERT正是如此,它在预训练阶段使用了两个关键任务:

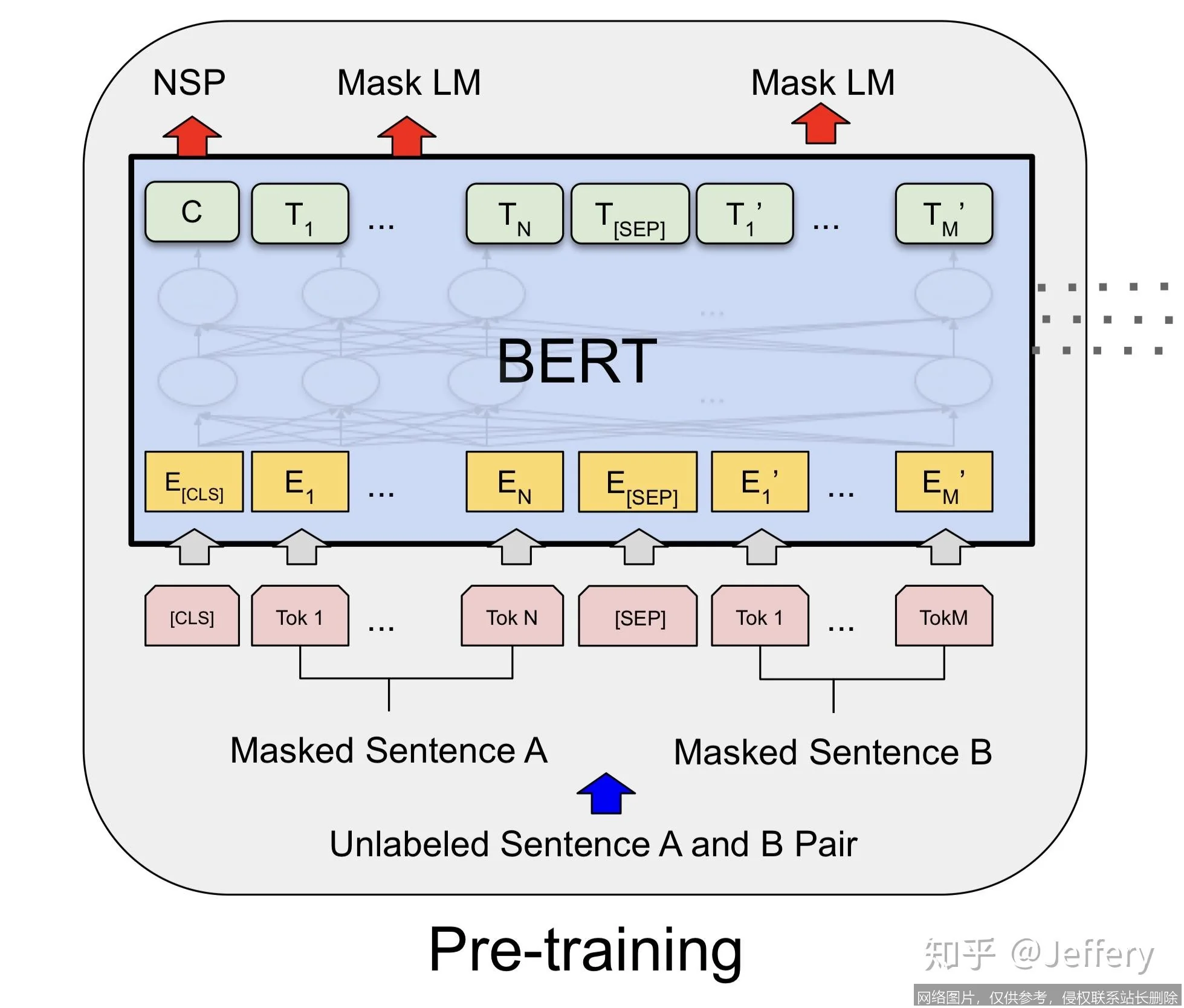

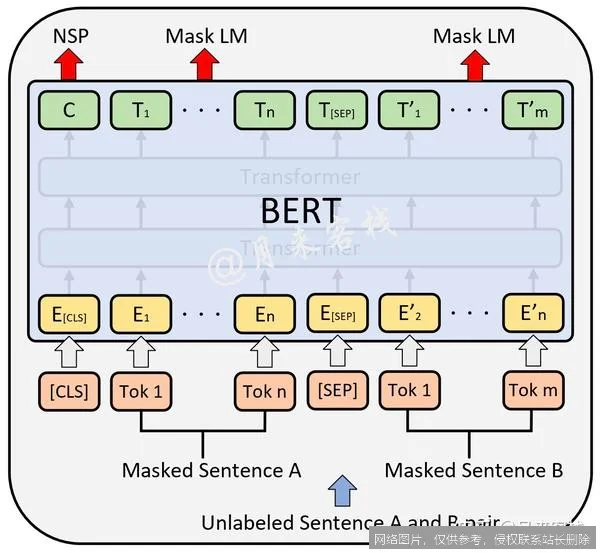

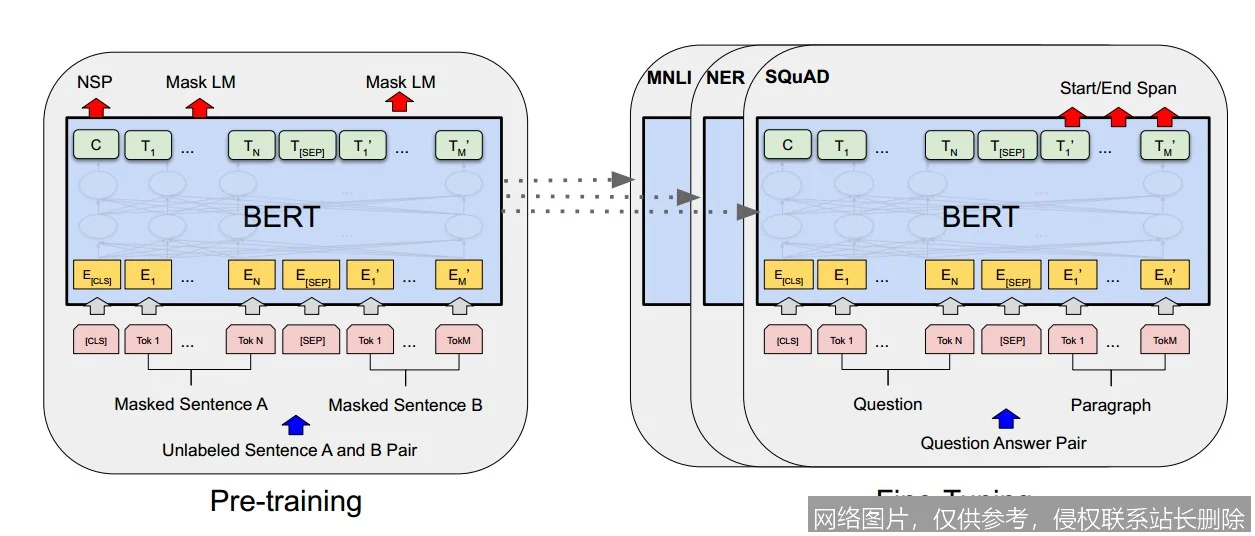

第一是“掩码语言模型”(MLM),随机遮盖句子中15%的词语,让模型根据所有未被遮盖的上下文(包括左右两侧)来预测被遮盖的词。第二是“下一句预测”(NSP),让模型判断两个句子是否在原文中连续出现,从而学习句子间的关系。通过在海量文本上完成这些任务,BERT学会了丰富的语言规律,成为一个强大的“语言基础模型”。用户可在此基础上,用特定领域的数据进行微调,即可高效适配各种下游任务。

BERT的应用场景

- 智能搜索与问答系统:BERT能精准理解用户查询的真实意图,而非简单匹配关键词。例如,对于查询“2020年后中国航天成就”,它能理解“后”的时间范围,并关联“嫦娥五号”、“天问一号”等具体事件,返回更相关的答案。

- 文本情感分析与内容审核:通过理解上下文中的细微差别,BERT能更准确地判断评论的情感极性(正面、负面、中性)或识别文本中隐含的违规、有害信息,广泛应用于社交媒体监控和客户反馈分析。

- 机器翻译与智能客服:凭借其深厚的语言理解能力,BERT能够提升机器翻译的流畅度和准确性,同时也使聊天机器人能更好地理解用户提问的语境,生成更自然、贴切的回复。

相关术语

Transformer、

预训练模型、

微调、

GPT、

自然语言处理、

注意力机制

延伸阅读

若想深入了解BERT,建议从阅读其原始论文《BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding》开始。此外,谷歌研究院的官方博客介绍、Hugging Face Transformers库的实践教程,以及关于“预训练-微调”范式的综述文章,都是极佳的学习资源,可以帮助您从理论到实践全面掌握这一里程碑式模型。