【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

AI词典2026-04-18 20:12:00

Transformer架构:定义

Transformer架构是一种完全基于自注意力机制的深度学习模型架构,它摒弃了传统的循环或卷积结构,通过并行处理序列数据,实现了对长距离依赖关系的高效建模,已成为现代人工智能,尤其是自然语言处理领域的基石性模型。

Transformer架构的工作原理

可以将Transformer理解为一个高度协同的“多专家会议”系统。其核心是“自注意力机制”,它允许序列中的每个元素(如一个单词)直接与序列中所有其他元素进行交互和“沟通”,从而动态地评估彼此之间的关联重要性。例如,在处理句子“苹果公司发布了新款手机”时,“苹果”这个词会同时关注“公司”和“手机”,并自动赋予“公司”更高的关联权重,从而明确此处指的是科技企业而非水果。

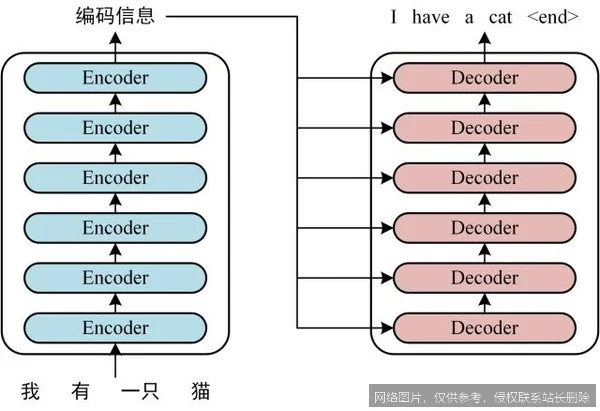

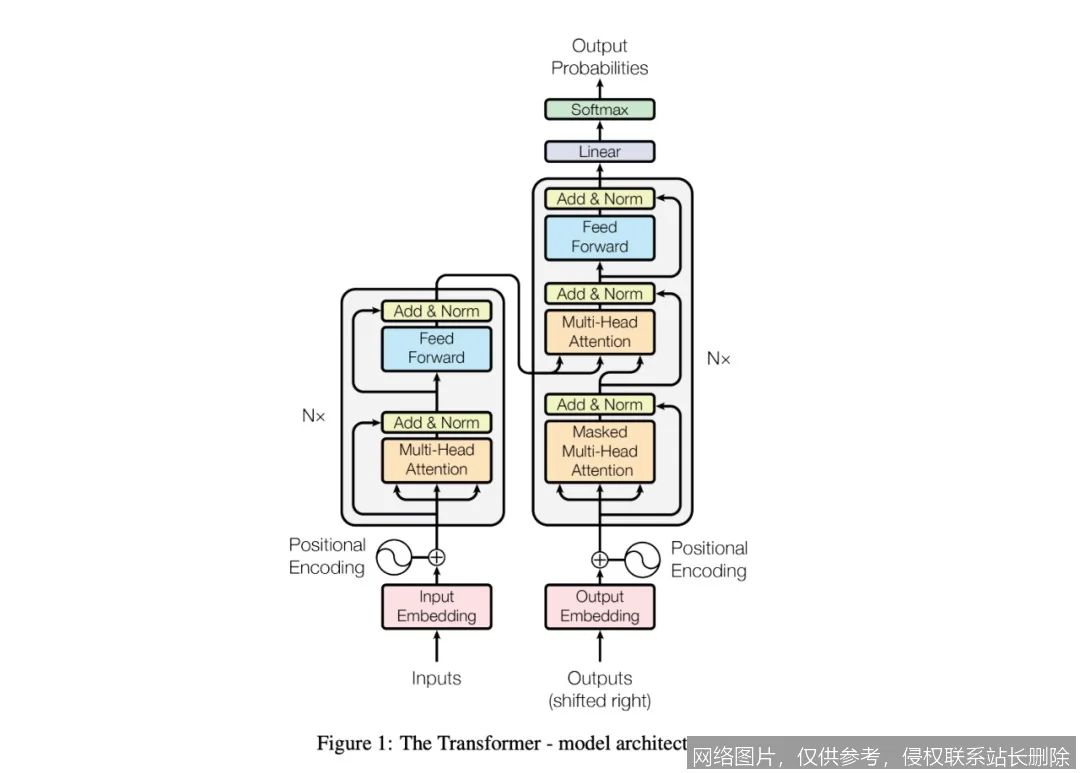

模型通过“多头注意力”并行运行多个这样的自注意力过程,就像多个专家小组从不同角度(如语法、语义、语境)同时分析同一段信息,最后综合所有见解。此外,架构中的“前馈神经网络”层负责对每个位置的特征进行独立转换,“残差连接”和“层归一化”则确保了训练过程的稳定与高效。编码器-解码器的经典设计,使得Transformer既能理解输入信息(编码),也能生成目标序列(解码)。

Transformer架构的应用场景

- 大规模语言模型:如GPT系列、BERT等,它们基于Transformer构建,在文本生成、阅读理解、情感分析等任务上表现出色,是ChatGPT等智能对话系统的技术核心。

- 机器翻译与多模态AI:Transformer彻底革新了机器翻译的质量。其变体(如Vision Transformer)还将该架构成功应用于计算机视觉领域,实现图像分类、目标检测,并催生了能同时处理文本、图像的跨模态大模型。

- 代码生成与生物信息学:基于Transformer的模型(如Codex)能够理解和生成编程代码,辅助软件开发。在生物领域,它被用于预测蛋白质结构(如AlphaFold2的关键组件),分析基因序列。

相关术语

自注意力机制、

多头注意力、

编码器-解码器结构、

位置编码、

BERT模型、

GPT模型、

Vision Transformer (ViT)

延伸阅读

若想深入了解,建议从原始论文《Attention Is All You Need》入手。同时,可以关注对Transformer各组件(如层归一化、前馈网络)的深入解析文章,以及探讨其计算效率优化(如稀疏注意力、线性注意力)的前沿研究,这些有助于理解其演进与挑战。

相关推荐

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型

- 什么是 A100?2026 最新定义、架构原理与数据中心实战详解

- vLLM:解锁大语言模型推理速度的终极武器

- Diffusers 是什么?2026 扩散模型原理、应用与实战全面解析

- 什么是 Azure Text to Speech?2026 年神经语音合成原理与应用全解析

- 开源协议是什么:2026 年最新定义、核心原理与商业应用全解析