【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

Attention机制:定义

Attention机制(注意力机制)是深度学习模型中的一种核心计算组件,它通过动态分配权重,使模型能够有选择地聚焦于输入数据中最相关的部分,从而提升信息处理的效率和准确性。其核心思想是模仿人类的注意力行为,即从海量信息中快速筛选出关键线索。

Attention机制的工作原理

可以将Attention机制的工作原理类比于阅读一篇文章后回答特定问题。假设问题是“文章主角在哪里工作?”,你会本能地忽略描述天气或次要人物的段落,而将“注意力”集中在提及公司名称和职业的句子上。在神经网络中,这一过程通过三个核心步骤实现:

首先,模型计算当前需要处理的元素(如目标词)与输入序列中所有元素(如源句子中的所有词)之间的相关性或“匹配度”,这被称为计算注意力得分。其次,通过Softmax函数将这些得分转化为权重分布,确保权重总和为1,相关性高的部分获得更高权重。最后,将这些权重作为系数,对输入信息进行加权求和,生成一个浓缩了关键信息的“上下文向量”,供模型后续决策使用。这种“软性”聚焦方式,使得模型能够捕捉复杂的依赖关系,而非简单地硬性选择某一部分。

Attention机制的主要应用场景

- 机器翻译:在序列到序列模型中,Attention机制允许解码器在生成每一个目标语言词汇时,动态地“查看”源语言句子中所有词汇的编码信息,并重点关注当前最相关的源词汇。这有效解决了长距离依赖和信息瓶颈问题,显著提升了翻译质量,尤其是在处理长句时。

- 自然语言理解与生成:在文本摘要任务中,模型利用Attention机制识别原文中的核心句子和关键词以生成摘要。在问答系统中,模型通过Attention将问题与文档的不同部分进行对齐,从而定位答案所在的具体位置。

- 计算机视觉:Attention机制被广泛应用于图像分类、目标检测和图像描述生成。例如,在图像描述任务中,模型生成描述词时,可以动态地将视觉注意力聚焦于图像中不同的区域(如“鸟”、“树枝”、“天空”),从而实现更精准的描述。

相关术语

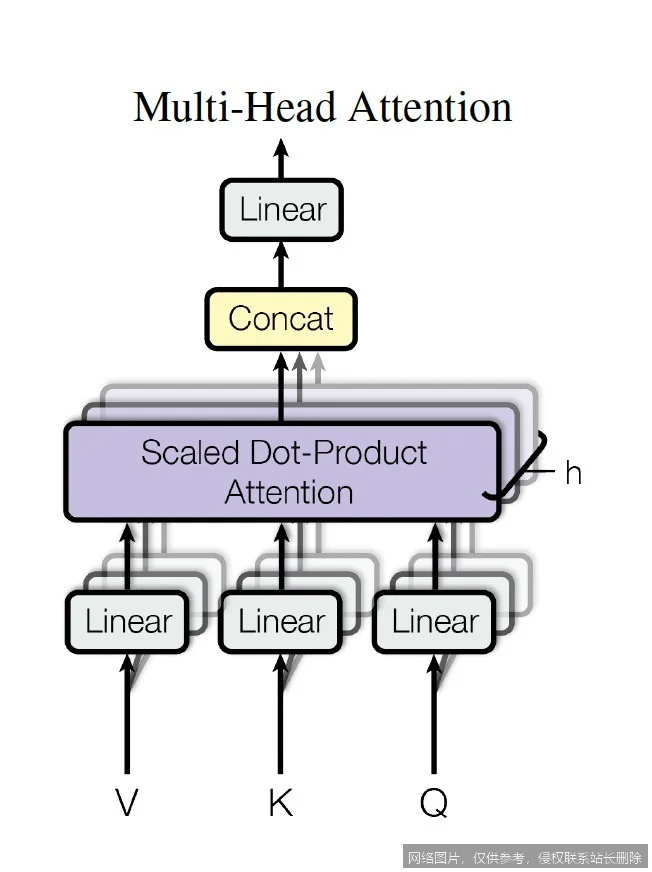

理解Attention机制,通常需要关联以下概念:Transformer模型(一种完全基于Attention机制构建的里程碑式架构)、自注意力(Self-Attention)(Attention机制的一种特殊形式,用于计算序列内部元素之间的关系)、多头注意力(Multi-Head Attention)(允许模型同时从不同表示子空间关注不同位置的信息)、序列到序列模型(Seq2Seq)(Attention机制最初被成功应用的框架)。

延伸阅读

若想深入了解,建议从经典论文《Attention Is All You Need》入手,该论文提出了Transformer架构。此外,可以查阅关于BERT、GPT等预训练模型的资料,它们都是基于Attention机制的强大实例。在线课程平台如Coursera上也有许多深度学习专项课程,其中包含对Attention机制的详细讲解与可视化演示。

相关推荐

- 【AI词典】GPT - 生成式预训练Transformer模型

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型

- 什么是 A100?2026 最新定义、架构原理与数据中心实战详解

- vLLM:解锁大语言模型推理速度的终极武器

- Diffusers 是什么?2026 扩散模型原理、应用与实战全面解析

- 什么是 Azure Text to Speech?2026 年神经语音合成原理与应用全解析