Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

一句话定义

Decoder(解码器)是一种仅利用自注意力机制,通过因果掩码按序生成序列数据的神经网络架构,是大语言模型的核心引擎。

技术原理:从“翻译官”到“创作者”的进化

要真正理解 Decoder 是什么,我们需要穿越回 Transformer 架构诞生的 2017 年。在最初的《Attention Is All You Need》论文中,Transformer 被设计为一个完整的“编码器 - 解码器”(Encoder-Decoder)结构,主要用于机器翻译任务。那时的 Decoder 像是一个严谨的翻译官:它必须先看一眼原文(由 Encoder 处理过的信息),然后才能开始逐字逐句地译出目标语言。

然而,随着人工智能进入大模型时代,Decoder 的角色发生了根本性的转变。今天的 Decoder-only 架构(纯解码器架构),不再依赖外部的 Encoder 输入,而是成为了一个全能的“创作者”。它的工作原理可以概括为:基于过去,预测未来。

核心工作机制:因果自注意力与自回归

Decoder 的核心灵魂在于两个关键机制的结合:因果自注意力机制(Causal Self-Attention)与自回归生成(Autoregressive Generation)。

想象一下你在玩一个填词游戏,规则是每写下一个字,只能参考你之前已经写下的所有字,绝对不能偷看后面的答案。这就是 Decoder 的工作方式。

1. **因果掩码(Causal Masking)**:

在标准的自注意力机制中,序列中的每个位置都可以“看到”序列中的所有其他位置。但在 Decoder 中,为了防止模型在训练时“作弊”(即直接看到它需要预测的下一个词),工程师引入了一种叫做“因果掩码”的技术。这就像给矩阵加了一个三角形的遮罩,强制模型在处理第 $t$ 个时刻的词时,只能关注 $0$ 到 $t-1$ 时刻的词。这种单向的信息流动,保证了生成的逻辑符合时间因果律。

2. **自回归生成过程**:

Decoder 的推理过程是一个典型的循环迭代:

* **输入**:接收当前的文本序列(例如:“今天天气真”)。

* **计算**:通过多层神经网络计算,输出下一个词的概率分布(例如:“好”的概率是 80%,“坏”的概率是 15%)。

* **采样**:根据概率分布选择一个词(如“好”)。

* **追加**:将选中的词拼接到原序列后面(变成:“今天天气真好”)。

* **重复**:将新序列再次输入,预测再下一个词,直到生成结束符(EOS, End of Sequence)。

这种“走一步看一步”的模式,虽然串行计算导致速度受限,但它赋予了模型极强的逻辑连贯性和长程规划能力。

关键技术组件解析

一个标准的 Decoder 块(Block)通常包含以下精密组件,它们协同工作以提取和整合信息:

* **掩码多头自注意力层(Masked Multi-Head Self-Attention)**:这是 Decoder 的“眼睛”。它不仅限制了视野(只能看前面),还通过“多头”(Multi-Head)机制,让模型同时从多个子空间关注信息的不同方面。比如,一个头关注语法结构,另一个头关注语义关联,还有一个头关注实体指代。

* **前馈神经网络(Feed-Forward Network, FFN)**:这是 Decoder 的“大脑皮层”。在注意力机制提取了上下文关系后,FFN 负责对每个位置的表示进行独立的非线性变换和特征提炼,增加模型的表达能力。

* **残差连接(Residual Connection)与层归一化(Layer Normalization)**:这是保证深层网络不崩塌的“骨架”。随着模型层数加深(现在的模型动辄几十甚至上百层),梯度消失是个大问题。残差连接允许信息直接跨层传输,而层归一化则稳定了数据分布,使得训练更加顺畅。

* **位置编码(Positional Embedding)**:由于 Transformer 本身不具备处理序列顺序的能力(它把句子看作一个集合),必须人为地注入位置信息。Decoder 依靠这些编码知道“我”在句子的第几个位置,从而理解语序。

与传统方法的对比:为何 Decoder 胜出?

在 Decoder 统治大模型之前,业界曾长期争论是选用 RNN(循环神经网络)、Encoder-Decoder 还是 Pure Decoder。

* **对比 RNN/LSTM**:传统的 RNN 像是一个只能单线程工作的工人,必须读完上一个词才能处理下一个词,无法并行计算,且难以记忆长距离的信息(遗忘症)。Decoder 利用自注意力机制,实现了并行训练(在已知上下文的条件下),并且能够直接建立首尾词的联系,完美解决了长依赖问题。

* **对比 Encoder-Decoder**:早期的 BERT 是 Encoder-only,擅长理解(如分类、填空),但不擅长生成;原始的 Transformer 是 Encoder-Decoder,适合有明确源输入的任务(如翻译)。但到了 2026 年的视角回顾,我们发现绝大多数通用任务(写作、编程、对话、推理)本质上都是“根据上文生成下文”。因此,去掉 Encoder,将一切输入都转化为 Prompt(提示词)交给 Decoder 处理,成为了最高效、最通用的范式。GPT 系列的成功证明了:**只要数据足够多,一个强大的 Decoder 就能学会理解世界,而不需要专门的 Encoder 来辅助。**

核心概念:构建认知图谱

深入理解 Decoder 是什么,需要厘清一系列紧密相关的术语。这些概念构成了现代大语言模型(LLM)的理论基石。

关键术语解释

1. **自回归(Autoregression, AR)**:

这是 Decoder 的生成策略。指当前输出的变量依赖于之前的输出变量。在统计学中,这意味着 $P(x_t | x_{1:t-1})$。在 LLM 中,这意味着模型是通过不断预测“下一个 token"来构建整个回答的。

2. **Token(词元)**:

Decoder 并不直接处理单词或汉字,而是处理 Token。Token 是文本的最小处理单元,可以是单词的一部分(如 "ing")、一个完整的单词,或者一个标点符号。中文里,一个字通常对应一个或多个 Token。Decoder 的输出本质上是词汇表(Vocabulary)上的一个概率分布。

3. **温度采样(Temperature Sampling)**:

控制 Decoder 生成随机性的旋钮。当温度 $T=0$ 时,模型总是选择概率最高的词(贪婪解码),结果确定但可能枯燥;当 $T>1$ 时,低概率词被选中的机会增加,生成的文本更具创造性和多样性,但也更容易胡言乱语。

4. **KV Cache(键值缓存)**:

这是提升 Decoder 推理速度的关键技术。在自回归生成中,每一步都需要重新计算之前所有词的注意力键(Key)和值(Value)。KV Cache 允许模型将这些中间结果缓存起来,新生成的步骤只需计算当前 token 的 KV 值,极大地减少了重复计算量,使得长文本生成成为可能。

5. **Next Token Prediction(下一词预测)**:

这是 Decoder 训练的终极目标函数。模型在海量的文本数据上,不断地尝试预测下一个词,通过最小化预测误差(交叉熵损失),隐式地学习了语法、事实、逻辑甚至推理能力。

概念关系图谱

如果把大模型比作一座大厦:

* **Transformer** 是建筑蓝图。

* **Decoder** 是这座大厦的主体结构(在 LLM 时代)。

* **Self-Attention** 是连接各个房间的走廊,决定了信息如何流动。

* **Causal Mask** 是走廊里的单向门,确保时间不可逆流。

* **Weights(权重)** 是装修材料,存储了从训练数据中学到的知识。

* **Inference(推理)** 是人们在大厦中行走的过程,即生成文本的过程。

常见误解澄清

* **误解一:"Decoder 只能用于生成,不能用于理解。”**

* 澄清:这是一个过时的观点。虽然 Decoder 的设计初衷是生成,但研究表明,大规模的 Decoder-only 模型(如 GPT-4)通过“下一词预测”这一代理任务,已经涌现出了惊人的理解能力。为了预测下一个词,它必须深刻理解前文的语境、逻辑和隐含意义。因此,现代 Decoder 既是最好的生成器,也是顶尖的理解器。

* **误解二:"Decoder 是一次性生成整段话的。”**

* 澄清:完全错误。Decoder 是严格串行的,一次只能吐出一个 Token。我们感觉到的“流畅输出”,是因为计算机生成速度极快(每秒数十个词),加上流式传输(Streaming)技术,让我们误以为它是瞬间完成的。这也解释了为什么修改前面的话,后面的内容往往会全部重算。

* **误解三:"Decoder 架构已经固定不变了。”**

* 澄清:Decoder 一直在演进。从最初的 vanilla Transformer Decoder,到 GPT-2 的层归一化前置(Pre-LN),再到 LLaMA 采用的旋转位置编码(RoPE)和 SwiGLU 激活函数,以及 2024-2026 年间流行的混合注意力机制(Hybrid Attention,结合稀疏注意力),Decoder 的内部结构一直在为了更高效、更长上下文而优化。

实际应用:2026 年大模型生态全景

站在 2026 年的时间节点回望,Decoder 架构已经渗透到数字生活的方方面面。它不再仅仅是一个学术概念,而是驱动智能社会的底层操作系统。

典型应用场景

1. **通用对话与智能助手(Conversational AI)**:

这是 Decoder 最直观的应用。从个人的生活助理到企业的客服机器人,基于 Decoder 的模型能够维持多轮对话的上下文,理解用户的意图,并生成自然、拟人化的回复。2026 年的助手不仅能聊天,还能主动规划任务、调用工具。

2. **代码生成与软件工程(Code Generation)**:

代码本质上是一种逻辑严密的特殊语言,非常适合 Decoder 的自回归特性。GitHub Copilot 及其后继者,能够根据注释生成整段函数,甚至重构整个项目。开发者只需描述需求,Decoder 即可输出可运行的 Python、C++ 或 Rust 代码,并进行自动调试。

3. **长文档分析与知识检索(Long-Context Understanding)**:

得益于稀疏注意力机制和高效的 KV Cache 优化,2026 年的 Decoder 模型原生支持百万级(1M+)的上下文窗口。用户可以上传整本法律卷宗、全套医疗病历或长达数小时的会议转录稿,Decoder 能精准定位细节,总结摘要,并回答复杂的问题,而无需传统的向量数据库切片检索(RAG)作为唯一手段。

4. **多模态内容创作(Multimodal Creation)**:

虽然 Decoder 起源于文本,但其架构已被推广到图像、音频和视频生成。通过将图像 Patch 化或音频帧序列化,Decoder 可以像生成文字一样“生成”像素或声波。例如,输入一段剧情描述,Decoder 架构的多模态模型可以直接生成连贯的短视频片段。

5. **科学发现与推理(Scientific Reasoning)**:

在生物制药、材料科学领域,Decoder 被用来预测蛋白质折叠序列、生成新的分子结构公式。它将科学问题转化为序列生成问题,极大地加速了研发周期。

代表性产品与技术栈

* **GPT 系列(OpenAI)**:Decoder-only 架构的奠基者与集大成者,定义了行业标准。

* **Llama 系列(Meta)**:开源界的标杆,证明了高性能 Decoder 模型可以公开获取,推动了全球应用爆发。

* **Claude 系列(Anthropic)**:在长上下文和安全对齐方面表现卓越的 Decoder 变体。

* **国产大模型(如通义千问、文心一言等)**:针对中文语境优化,并在垂直行业落地的 Decoder 巨构。

在 2026 年,这些模型的底层依然是 Decoder,但外围生态已极大丰富。出现了专门针对移动端优化的微型 Decoder(Small Language Models, SLMs),以及针对特定行业微调的专用 Decoder。

使用门槛与条件

尽管 Decoder 功能强大,但要高效使用它仍有一定门槛:

1. **算力资源**:

训练一个千亿参数的 Decoder 模型需要成千上万张 GPU 集群,成本高达数千万美元。对于普通开发者,直接使用 API 或部署量化后的开源模型(如 7B、14B 参数版本)是更现实的选择。推理阶段虽然比训练轻量,但在高并发场景下仍需昂贵的显存带宽支持。

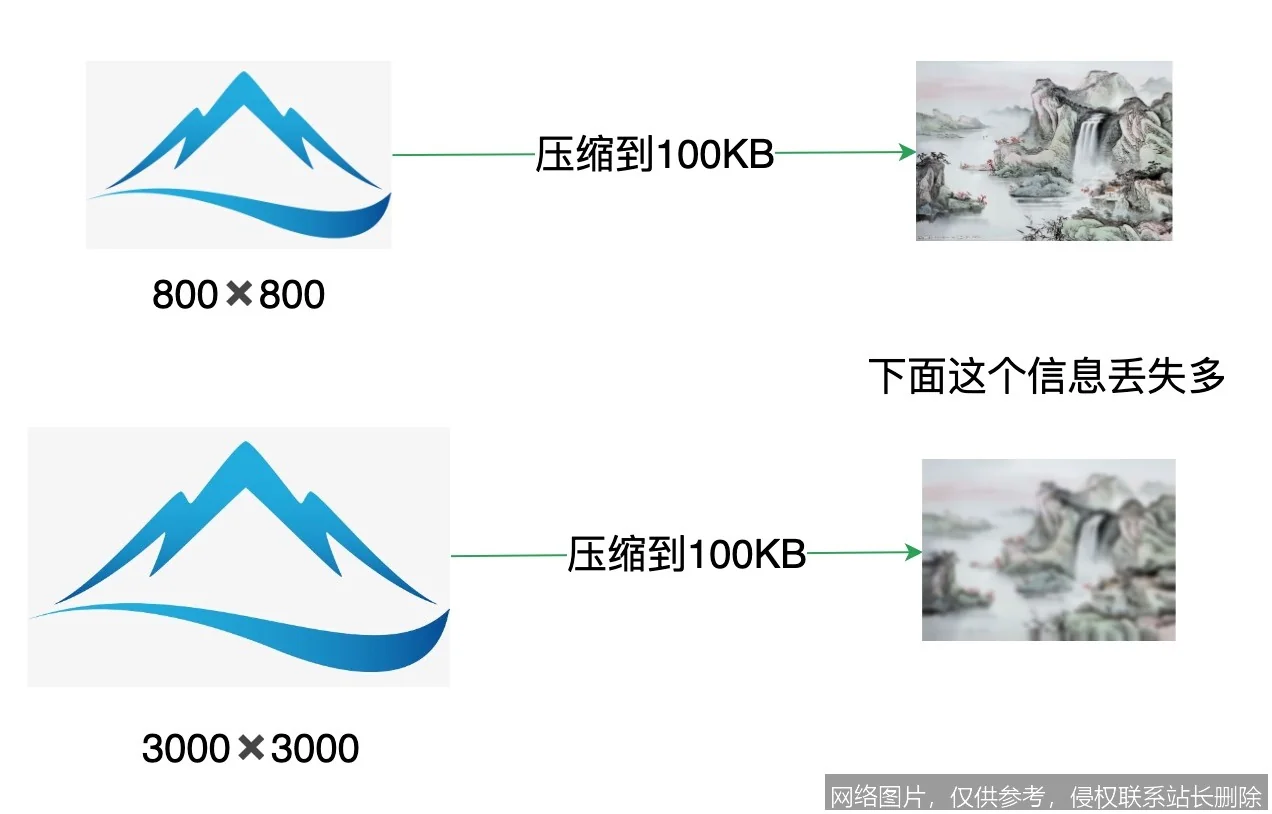

2. **提示工程(Prompt Engineering)**:

Decoder 的表现高度依赖输入的质量。用户需要掌握如何清晰地表述指令、提供少样本(Few-shot)示例、设定角色约束,才能激发模型的最佳性能。“垃圾进,垃圾出”(Garbage In, Garbage Out)在 Decoder 时代依然适用。

3. **幻觉问题(Hallucination)**:

由于 Decoder 的本质是“预测下一个最可能的词”,而非“检索真理”,它可能会一本正经地胡说八道。在医疗、法律等高风险领域,必须配合外部知识库验证、人类反馈强化学习(RLHF)或思维链(Chain-of-Thought)校验机制来降低风险。

4. **延迟与成本平衡**:

自回归生成的串行特性决定了其延迟随生成长度线性增加。在实时交互场景中,需要在模型大小、响应速度和生成质量之间做精细的权衡。

延伸阅读:通往专家之路

如果你希望从入门走向精通,系统掌握 Decoder 是什么及其背后的深意,以下路径和资源将为你提供指引。

相关概念推荐

* **Transformer Architecture**:Decoder 的父集,理解整体架构有助于局部突破。

* **Reinforcement Learning from Human Feedback (RLHF)**:了解如何让原本只会预测下一个词的 Decoder 变得听话、有用且安全。

* **Mixture of Experts (MoE)**:下一代 Decoder 的主流架构,通过稀疏激活大幅扩展模型容量。

* **Speculative Decoding(投机采样)**:一种加速 Decoder 推理的前沿技术,利用小模型草稿、大模型验证来打破串行瓶颈。

* **World Models**:关于 Decoder 是否在学习世界模型的哲学与技术探讨。

进阶学习路径

1. **基础阶段**:

* 阅读原始论文《Attention Is All You Need》(Vaswani et al., 2017),重点精读 Decoder 部分。

* 观看 Andrej Karpathy 的 "Let's build GPT" 视频教程,从零手写一个微型 Decoder。

* 学习 PyTorch 或 JAX 框架,复现基础的自注意力模块。

2. **进阶阶段**:

* 研读 GPT-1/2/3 的技术报告,观察 Decoder 如何随着规模扩大而涌现能力。

* 深入学习位置编码的演变:从 Absolute PE 到 RoPE (Rotary Positional Embeddings)。

* 研究推理优化技术:PagedAttention (vLLM), KV Cache 管理,量化(Quantization)。

3. **前沿阶段**:

* 关注 NeurIPS, ICML, ICLR 等顶会的最新论文,特别是关于非自回归解码(Non-Autoregressive Decoding)的尝试,看学界如何试图打破串行的诅咒。

* 探索多模态 Decoder 的统一架构(如 Chameleon, Show-o 等)。

推荐资源与文献

* **经典论文**:

* *Attention Is All You Need* (Google Brain, 2017) - 开山之作。

* *Language Models are Few-Shot Learners* (GPT-3 Paper, 2020) - 规模化定律的验证。

* *RoFormer: Enhanced Transformer with Rotary Position Embedding* - 现代 Decoder 的位置编码标准。

* **在线课程**:

* Coursera: "Natural Language Processing Specialization" by deeplearning.ai.

* Hugging Face Course: 免费的 NLP 与大模型实战课程,包含大量 Decoder 代码示例。

* Stanford CS224N: Natural Language Processing with Deep Learning.

* **工具库**:

* **Hugging Face Transformers**:业界标准的库,一行代码即可加载各种预训练的 Decoder 模型。

* **vLLM**:高性能推理服务库,理解其内部实现有助于掌握 Decoder 的工程优化。

* **NanoGPT**:Andrej Karpathy 提供的极简 GPT 实现代码,是理解原理的最佳入口。

综上所述,Decoder 不仅仅是一个神经网络模块,它是当前人工智能智慧的载体。从理解其因果掩码的微观机制,到把握其在 2026 年宏大应用生态中的宏观地位,掌握 Decoder 是什么,就是掌握了开启未来智能大门的钥匙。在这个由概率和序列构建的数字宇宙中,Decoder 正以前所未有的速度,书写着人类文明的新篇章。

已是最新文章

相关推荐

- Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

- 【AI词典】上下文窗口 - 模型单次处理的最大文本长度

- 【AI词典】幻觉Hallucination - 生成模型输出不实或虚构内容的现象

- 【AI词典】Multi-Agent多智能体 - 多个自主智能体协同工作的系统

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体

- 【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术

- 【AI词典】Chain-of-Thought思维链 - 分步推理的提示方法

- 【AI词典】Zero-shot学习 - 无需样本即可识别新类别的机器学习方法

- 生成式AI:颠覆内容创作的智能革命与未来展望

- 【AI词典】Few-shot学习 - 小样本快速适应新任务