【AI词典】上下文窗口 - 模型单次处理的最大文本长度

AI词典2026-04-20 04:36:00

定义:什么是上下文窗口?

上下文窗口(Context Window),指大型语言模型在单次推理过程中,能够接收并处理的输入文本(包括用户提示词、系统指令及历史对话等)的最大长度限制,通常以令牌(Token)数量来衡量。

原理:上下文窗口如何工作?

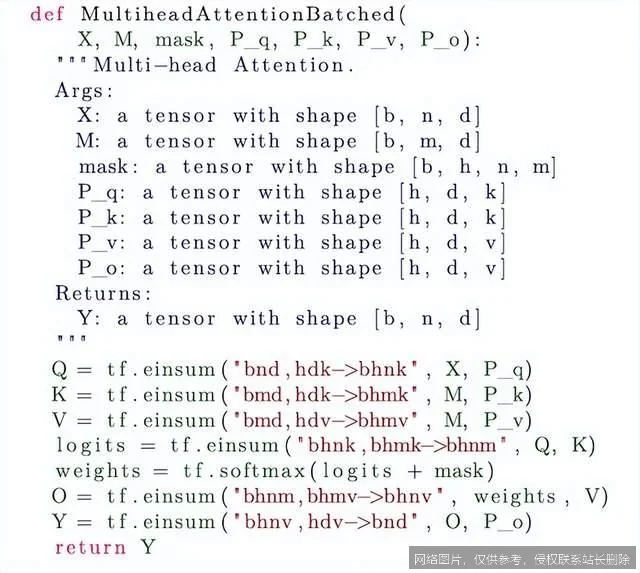

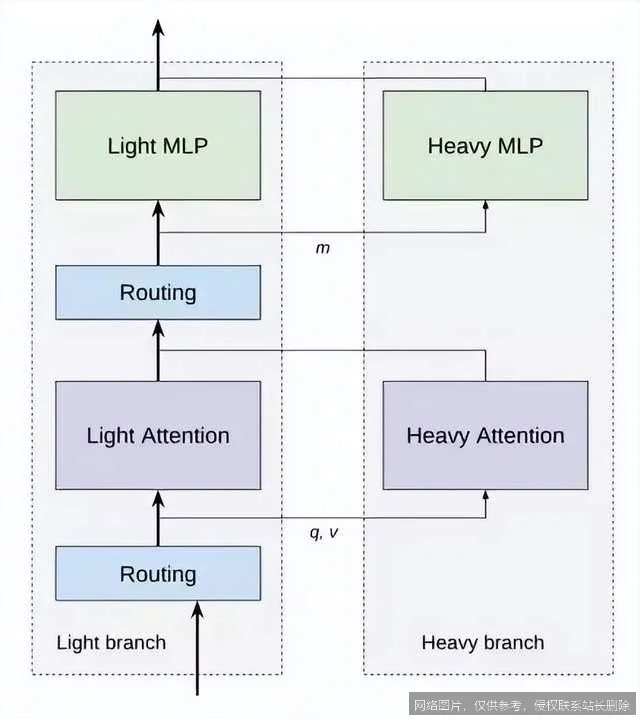

您可以将上下文窗口想象成一个“工作记忆白板”。当您向AI提问时,您提供的所有文字信息都会被转换成令牌(对于英文,一个词或词的一部分可能是一个令牌;对于中文,一个字或词通常是一个令牌),并放置在这个白板上。模型只能“看到”并基于这块白板上的内容进行思考和生成回答。白板的大小是固定的,一旦输入内容超出其容量,最早进入的信息就会被“擦除”,模型将无法再参考这部分内容。其技术核心通常基于Transformer架构中的注意力机制,该机制需要计算输入序列中每个令牌与其他所有令牌的关联度,计算量随序列长度呈平方级增长,因此设置上限是平衡性能与成本的关键。

应用场景:上下文窗口的实际用途

- 长文档分析与总结:用户可以将一篇冗长的研究报告、法律合同或书籍章节输入模型,要求其提炼核心观点、撰写摘要或回答基于全文的细节问题。足够大的上下文窗口是确保模型理解全文逻辑连贯性的基础。

- 复杂多轮对话:在客服、创意写作或深度技术咨询场景中,对话可能持续数十甚至上百轮。一个宽广的上下文窗口能够确保AI牢记整个对话历史、用户偏好及已达成的一致,从而避免前后矛盾,实现真正连贯的个性化交流。

- 代码生成与调试:开发者可以向AI提交一个包含多个关联文件片段或长达数百行的代码文件,请求其解释功能、生成新代码或查找错误。模型需要同时“看到”足够多的上下文代码,才能理解数据结构、函数调用关系并给出准确建议。

相关术语

理解上下文窗口,常需关联以下概念:

令牌(Token)、

注意力机制(Attention Mechanism)、

Transformer架构、

提示词工程(Prompt Engineering)、

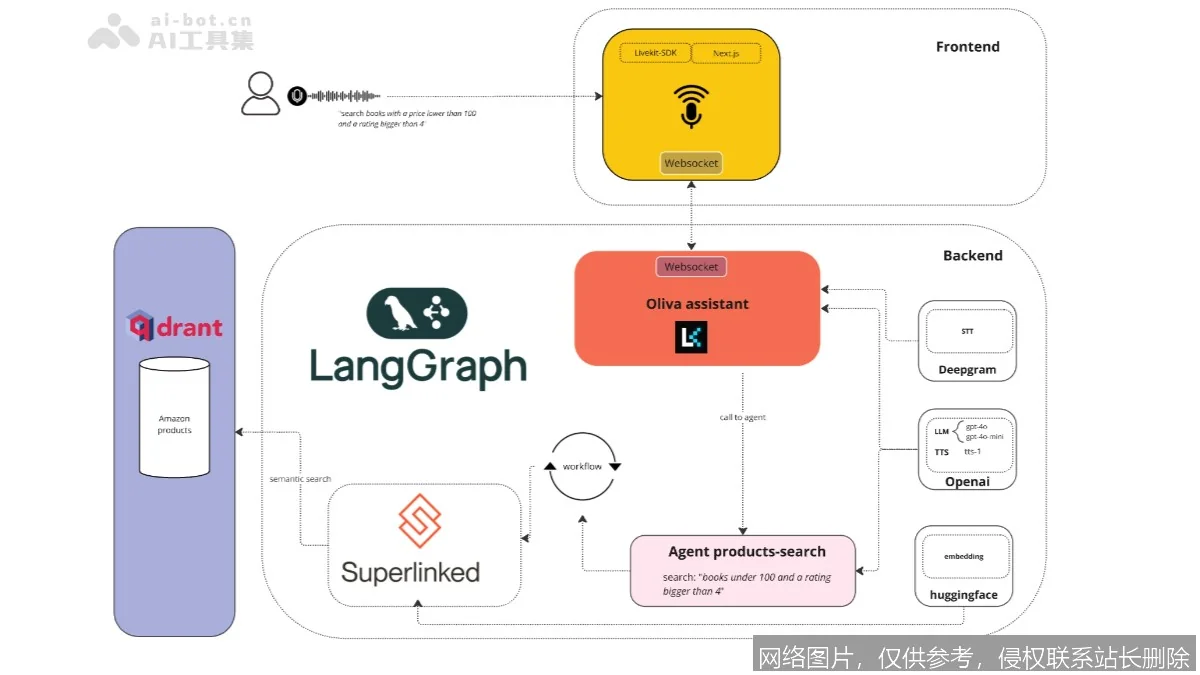

检索增强生成(RAG)。

延伸阅读

若想深入了解上下文窗口的技术演进与挑战,可以关注关于“Transformer位置编码”、“KV缓存优化”以及“长文本处理技术(如滑动窗口注意力、层次化注意力)”的学术论文或技术博客。同时,理解检索增强生成(RAG)如何作为一项关键技术,通过外部知识库突破固定上下文窗口的限制,也具有重要实践意义。

相关推荐

- Decoder 是什么:原理、演进与 2026 年大模型应用全面解析

- 【AI词典】上下文窗口 - 模型单次处理的最大文本长度

- 【AI词典】幻觉Hallucination - 生成模型输出不实或虚构内容的现象

- 【AI词典】Multi-Agent多智能体 - 多个自主智能体协同工作的系统

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体

- 【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术

- 【AI词典】Chain-of-Thought思维链 - 分步推理的提示方法

- 【AI词典】Zero-shot学习 - 无需样本即可识别新类别的机器学习方法

- 生成式AI:颠覆内容创作的智能革命与未来展望

- 【AI词典】Few-shot学习 - 小样本快速适应新任务