Diffusion 是什么:扩散模型原理、2026 应用进展与实战详解

一句话定义

Diffusion(扩散模型)是一种通过模拟物理“去噪”过程,将随机高斯噪声逐步还原为清晰数据的生成式人工智能架构。

技术原理:从混沌到秩序的逆向工程

要理解 Diffusion Model(扩散模型),我们首先需要打破对传统生成模型的固有认知。在 GAN(生成对抗网络)统治的时代,生成图像被视作一场“伪造者”与“鉴定师”的博弈;而在 Diffusion 的范式下,生成过程被重构为一场精密的“雕塑”或“显影”过程。其核心逻辑并不复杂,却蕴含着深刻的数学美感。

1. 核心工作机制:前向扩散与逆向重构

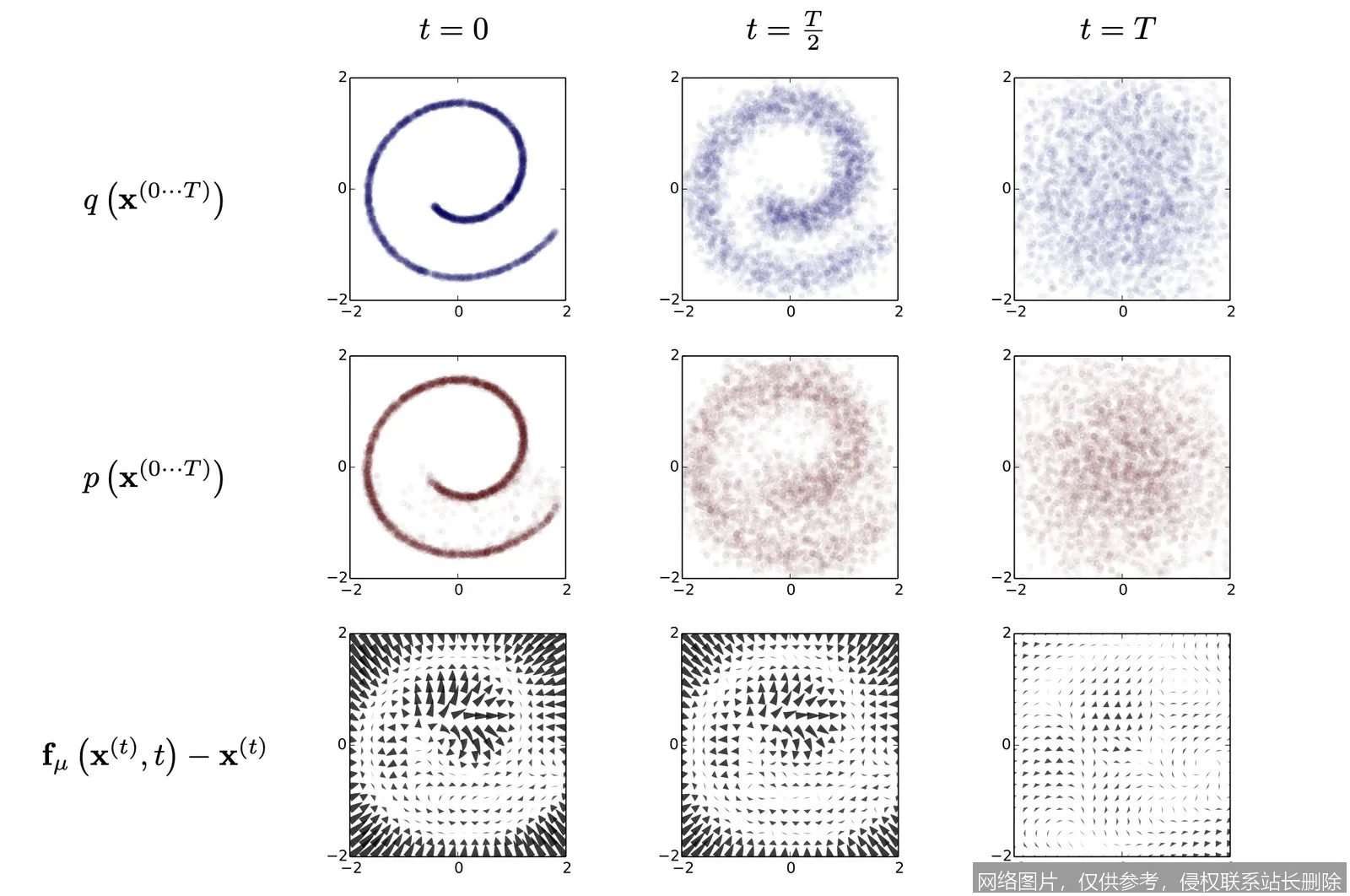

Diffusion 模型的运作机制灵感直接来源于非平衡热力学中的扩散过程。想象一滴墨水滴入清水中,随着时间推移,墨水分子会无规则地运动,最终均匀分布在整个水体中,原本清晰的图像信息彻底消失,变成了一团均匀的噪声。这个过程在数学上被称为前向扩散过程(Forward Diffusion Process)。

在算法层面,前向过程是固定的、无需学习的。系统向一张原始图片 $x_0$ 逐步添加高斯噪声(Gaussian Noise),经过 $T$ 个时间步后,图片 $x_T$ 变成了纯随机噪声,其分布近似于标准正态分布 $\mathcal{N}(0, I)$。这一步相对简单,因为加噪的公式是预先定义好的。

真正的魔法发生在逆向过程(Reverse Process)。如果我们能够训练一个神经网络,让它学会如何“逆转”上述过程——即给定任意时刻 $t$ 的含噪图像 $x_t$,预测出其中包含的噪声 $\epsilon$ 或者直接预测上一时刻的图像 $x_{t-1}$——那么我们就可以从纯随机噪声 $x_T$ 开始,一步步减去预测的噪声,最终“雕刻”出一张全新的、高质量的图像 $x_0$。

这个逆向过程就是模型训练的目标。模型(通常是 U-Net 架构)通过学习大量数据,掌握了从噪声中提取语义信息的规律。当用户输入一段文本提示(Prompt)时,模型便依据文本引导,在去噪的每一步中调整方向,确保生成的图像符合描述。

2. 关键技术组件解析

一个标准的 Latent Diffusion Model(潜在扩散模型,如 Stable Diffusion 的核心)由三个关键组件协同工作:

- 变分自编码器(VAE, Variational Autoencoder):直接在像素空间进行扩散计算量极其巨大。VAE 的作用是将高维的像素图像压缩到低维的“潜在空间”(Latent Space)。在这个压缩空间中,图像保留了核心语义特征但数据量大幅减少,使得扩散过程可以在消费级显卡上高效运行。生成完成后,再由 VAE 的解码器将潜在变量还原为像素图像。

- U-Net 去噪网络:这是扩散模型的大脑。它是一个具有跳跃连接(Skip Connections)的卷积神经网络,负责在每一个时间步预测噪声。为了理解文本指令,U-Net 通常会集成交叉注意力机制(Cross-Attention),将文本编码器的输出注入到图像生成的过程中,实现“文生图”的条件控制。

- 调度器(Scheduler/Sampler):它决定了去噪的步伐和策略。常见的如 DDIM、DPM-Solver 等。调度器不仅影响生成速度(需要多少步才能完成去噪),还直接影响图像的多样性和质量。不同的采样算法就像不同的“画笔”,有的追求速度,有的追求细节。

3. 与传统方法的对比:为何 Diffusion 胜出?

在 Diffusion 崛起之前,主流的生成模型是 GAN(Generative Adversarial Networks)。GAN 的训练极不稳定,容易出现“模式崩溃”(Mode Collapse),即模型只会生成几种固定的样本,缺乏多样性。此外,GAN 很难处理高分辨率图像的生成任务。

相比之下,Diffusion 模型具有显著优势:

- 训练稳定性:由于目标明确(预测噪声),其损失函数收敛更加平稳,不易崩溃。

- 覆盖率高:Diffusion 能更好地覆盖数据分布的全貌,生成的样本多样性远超 GAN。

- 可控性强:通过 Classifier-Free Guidance 等技术,可以精确控制生成内容与条件(如文本、边缘图)的契合度。

类比理解:如果把生成图像比作在黑暗中摸索大象的形状。GAN 像是在黑暗中直接捏泥人,全凭直觉,容易捏歪或者只捏出几种固定姿态;而 Diffusion 像是先在大象周围充满迷雾(加噪),然后训练一个人学会“拨开迷雾”(去噪)。只要这个人学会了如何拨开迷雾看到大象,无论初始的迷雾(随机噪声)如何分布,他都能一步步拨开,最终呈现出清晰的大象。

核心概念:构建认知的知识图谱

深入掌握 Diffusion 技术,必须厘清一系列专业术语及其相互关系。这些概念构成了该领域的通用语言。

1. 关键术语解释

- DDPM (Denoising Diffusion Probabilistic Models):扩散概率去噪模型,是奠定现代扩散模型基础的开山之作。它严格定义了前向加噪和逆向去噪的概率分布框架。

- Latent Space (潜在空间):一个低维度的连续向量空间。在这个空间中,语义相似的图像距离更近。Stable Diffusion 之所以快,就是因为它在潜在空间而非像素空间进行操作。

- Prompt Engineering (提示词工程):在文生图场景中,用户输入的文本描述。由于模型对自然语言的理解基于训练数据的统计规律,精心设计的提示词(包括权重语法、负面提示词 Negative Prompt)能显著提升生成质量。

- CFG Scale (Classifier-Free Guidance Scale):一个超参数,用于控制生成结果在多大程度上遵循提示词。数值越高,图像越贴合提示词但可能牺牲多样性;数值越低,图像越自由但可能偏离主题。

- Inpainting & Outpainting:分别指“局部重绘”和“向外扩展”。Inpainting 允许用户遮罩图像的某一部分并重新生成;Outpainting 则是在原图边界外继续生成内容,扩展画面视野。

2. 概念关系图谱

我们可以将这些概念构建成一个层级结构:

基础理论层:马尔可夫链 (Markov Chain) -> 高斯分布 -> 变分推断 (Variational Inference)。

模型架构层:DDPM (理论基础) -> Latent Diffusion (效率优化) -> ControlNet (空间控制)。

应用交互层:Text Encoder (CLIP/T5) -> Prompt (用户输入) -> Sampler (采样策略) -> Image Output。

在这个链条中,Text Encoder 将人类的语言翻译成机器理解的向量,注入到 Latent Diffusion 的去噪过程中,ControlNet 则进一步引入边缘、深度图等空间约束,最终通过 Sampler 的输出得到结果。

3. 常见误解澄清

误解一:“扩散模型只是不断地模糊图片直到清晰。”

澄清:恰恰相反。它是从完全无序的随机噪声开始,通过去除噪声来“揭示”结构。它不是在修复一张模糊的照片,而是在无中生有地创造细节。每一次生成的细节都是模型根据概率“幻想”出来的,这也是为什么同一提示词每次生成的图像都不同。

误解二:"Step(步数)越多,图片质量一定越好。”

澄清:在一定范围内(如 20-30 步),增加步数确实能提升细节丰富度。但超过某个阈值后,收益递减,甚至可能因为过度拟合噪声而导致画面出现伪影。高效的采样器(如 DPM-Solver++)往往能在 10-15 步内达到极佳效果。

误解三:"Diffusion 只能生成图片。”

澄清:虽然图像生成最出名,但扩散原理同样适用于音频(如音乐生成)、视频(如 Sora 背后的技术逻辑)、3D 模型甚至分子结构发现。任何可以表示为序列或网格的数据,理论上都可以应用扩散模型。

实际应用:从创意工具到工业引擎

截至 2026 年,Diffusion 模型已不再仅仅是实验室里的玩具,而是深深嵌入了数字内容创作、科学研究和工业设计的各个环节。其应用广度与深度均发生了质的飞跃。

1. 典型应用场景

- AIGC 内容创作:这是最直观的应用。设计师利用 Midjourney、Stable Diffusion 等工具快速生成概念图、插画、广告素材。2026 年的工作流已演变为“人机协作”:人类提供创意草图和意图,AI 负责渲染细节、光影和材质,将创作效率提升了数十倍。

- 视频生成与编辑:基于扩散的视频模型(如 Sora 类技术的普及版)实现了长镜头、高一致性的视频生成。不仅能“文生视频”,还能实现“视频风格迁移”(将实拍视频瞬间转化为动漫风格)和“视频修复”(去除水印、补全缺失帧)。

- 药物研发与材料科学:在生物医药领域,扩散模型被用于生成全新的蛋白质结构或分子式。科学家设定目标功能(如“结合某种病毒蛋白”),模型即可在巨大的化学空间中搜索并生成满足条件的候选分子,大幅缩短新药研发周期。

- 3D 资产生成:游戏和元宇宙开发中,通过单张图片或多视角扩散模型,可以直接生成带有纹理的 3D 模型(.obj/.glb 格式),自动化构建虚拟世界的环境资产。

2. 代表性产品与项目案例(2026 视角)

- Stable Diffusion XL (SDXL) 及后续迭代版本:作为开源界的标杆,它允许用户在本地部署,拥有庞大的社区插件生态(如 ControlNet, LoRA)。2026 年,其推理速度已在端侧设备(手机、平板)上实现实时化。

- Midjourney v7+:以审美卓越著称的商业闭源模型。它在艺术风格的理解、光影的物理准确性上达到了照片级真实感,成为电影概念设计和时尚行业的首选工具。

- Adobe Firefly (集成于 Photoshop):将扩散模型无缝嵌入专业工作流。设计师可以使用“生成式填充”一键扩充背景、替换物体,且生成的内容在版权上经过清洗,可供商业安全使用。

- Sora / Gen-3 类视频模型:标志着视频生成进入“逻辑连贯”时代。不仅能生成视觉逼真的片段,还能理解简单的物理规律(如物体碰撞、流体运动),被广泛用于广告预告片制作和短视频创作。

3. 使用门槛与现实条件

尽管技术进步巨大,但要高质量地应用 Diffusion 模型,仍需考虑以下条件:

- 算力需求:虽然量化技术和蒸馏模型降低了门槛,但训练大型模型仍需昂贵的 GPU 集群(如 H100/A100)。对于个人用户,本地运行高分辨率生成仍建议配备至少 12GB 显存的显卡,或使用云端推理服务。

- 数据版权与伦理:2026 年的法律环境对训练数据的版权有了更严格的界定。商业使用时,必须确认模型是否经过合规数据训练,避免侵权风险。同时,防止生成深伪(Deepfake)内容的技术过滤机制已成为标配。

- Prompt 能力:虽然自然语言理解在进步,但要精准控制构图、色调和细节,用户仍需掌握一定的提示词技巧,或学会使用节点式工作流(如 ComfyUI)进行精细化控制。

延伸阅读:通往专家之路

Diffusion 领域日新月异,保持持续学习是掌握该技术的关键。以下资源旨在帮助读者从入门走向精通。

1. 相关概念推荐

若想构建完整的知识体系,建议在掌握 Diffusion 后,进一步研究以下关联领域:

- Transformer Architecture:理解现代 AI 的基石,尤其是 Vision Transformer (ViT) 如何与 Diffusion 结合(如 DiT 架构)。

- Reinforcement Learning from Human Feedback (RLHF):了解如何通过人类反馈微调模型,使其生成结果更符合人类审美和价值观。

- Neural Radiance Fields (NeRF) & 3D Gaussian Splatting:探索扩散模型与 3D 重建技术的融合,这是未来空间计算的核心。

- Consistency Models:一种新兴的生成模型,试图在保留扩散模型质量的同时,实现单步生成,解决推理速度慢的问题。

2. 进阶学习路径

- 数学基础夯实:复习概率论(贝叶斯定理、高斯分布)、随机过程和微积分。推荐阅读《Deep Learning》(Ian Goodfellow) 中的生成模型章节。

- 论文精读:

- 奠基之作:"Denoising Diffusion Probabilistic Models" (Ho et al., 2020)

- 效率革命:"High-Resolution Image Synthesis with Latent Diffusion Models" (Rombach et al., 2022) (Stable Diffusion 原文)

- 控制增强:"Adding Conditional Control to Text-to-Image Diffusion Models" (Zhang et al., 2023) (ControlNet)

- 代码实战:不要只做旁观者。使用 PyTorch 框架,尝试从头复现一个简单的 DDPM;接着学习使用 Hugging Face 的

diffusers库加载预训练模型;最后尝试训练自己的 LoRA 模型以适应特定风格。

3. 推荐资源与文献

- 在线课程:Coursera 上的 "Generative AI with Large Language Models" 专项课程;Hugging Face 官方提供的 NLP 和 Computer Vision 免费教程。

- 社区与论坛:Hugging Face Papers(追踪最新论文);GitHub 上的 Awesome-Diffusion-Models 仓库;Civitai(查看模型效果与分享 Prompt)。

- 书籍:《Generative Deep Learning》(David Foster),该书第二版专门增加了关于 Diffusion Models 的详细章节,理论与实践并重。

Diffusion 模型不仅仅是一项技术突破,它代表了人工智能从“判别”走向“创造”的范式转移。从理解其背后的噪声消除原理,到掌握其在 2026 年的多样化应用,我们正处于一个创造力被空前释放的时代。希望本文能为你打开通往这一迷人领域的大门,让你在 AI 的浪潮中,不仅是观察者,更是驾驭者。

相关推荐

- 【AI词典】Embedding - 将数据映射为低维向量的技术

- 【AI词典】Token - 文本处理的基本语义单元

- 【AI词典】BERT - 谷歌预训练语言理解模型

- 【AI词典】GPT - 生成式预训练Transformer模型

- 【AI词典】Attention机制 - 模拟人类注意力的神经网络核心组件

- 【AI词典】Transformer架构 - 基于自注意力机制的深度学习模型架构

- LangChain:解锁大语言模型潜力的新一代AI应用框架

- 【AI词典】LLM - 大型语言模型

- 【AI词典】大语言模型 - 基于海量数据训练的大型自然语言处理模型

- 什么是 A100?2026 最新定义、架构原理与数据中心实战详解