【AI词典】专家混合MoE - 稀疏激活的模型扩展方法

专家混合MoE:稀疏激活的模型扩展方法

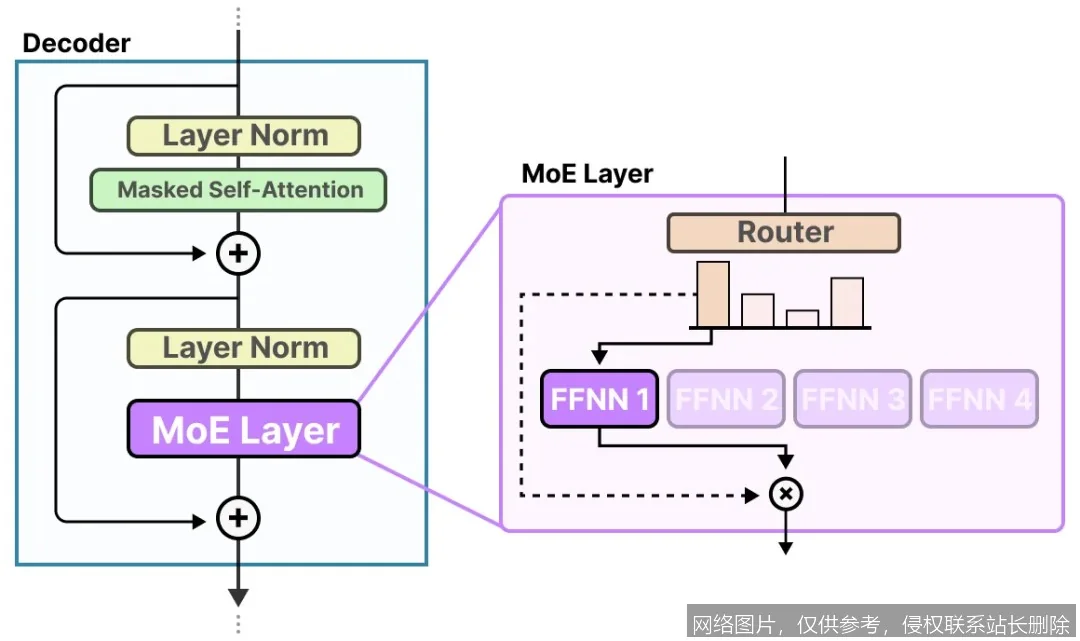

专家混合(Mixture of Experts,简称MoE)是一种通过稀疏激活机制来高效扩展模型容量的神经网络架构范式,其核心思想是“分而治之”,即针对不同的输入,动态地选择并激活一小部分最相关的“专家”子网络进行计算,而非使用整个庞大模型。

原理:从“全科医生”到“专科会诊”

想象一个传统的巨型神经网络如同一位试图精通所有领域的“全科医生”,处理任何问题都需要动用其全部知识(参数),这导致训练和推理成本极高。MoE架构则不同,它将这个大网络分解为多个相对独立、各有所长的“专科医生”(即专家网络)。

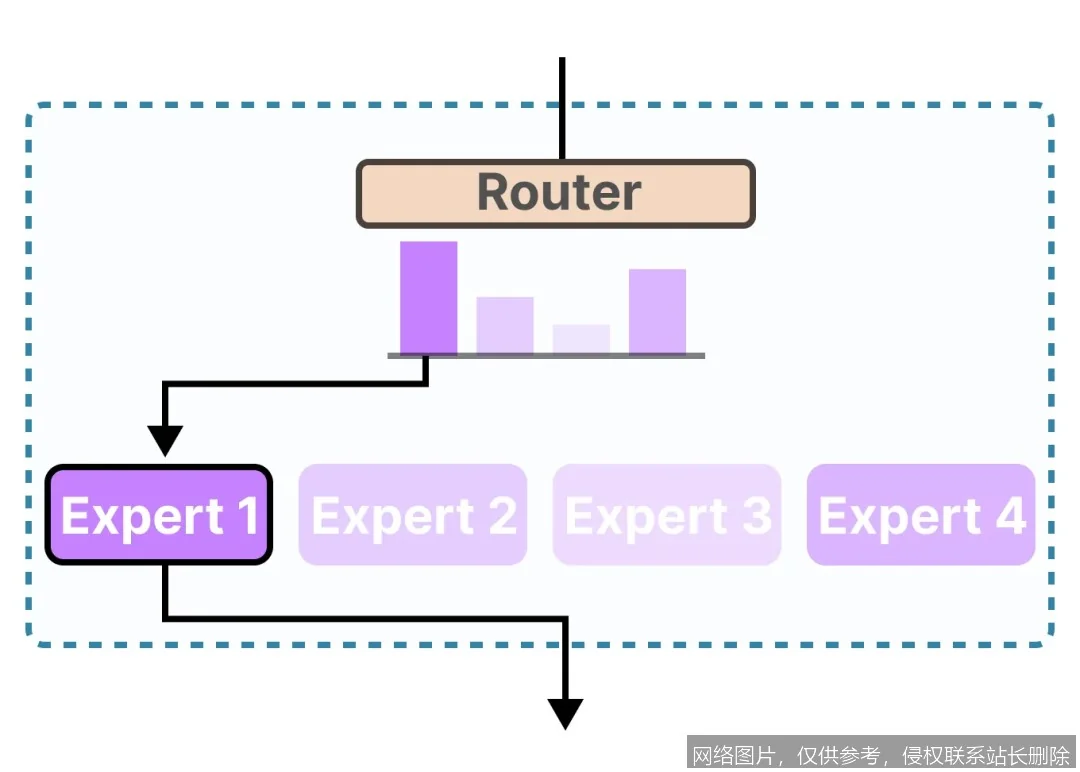

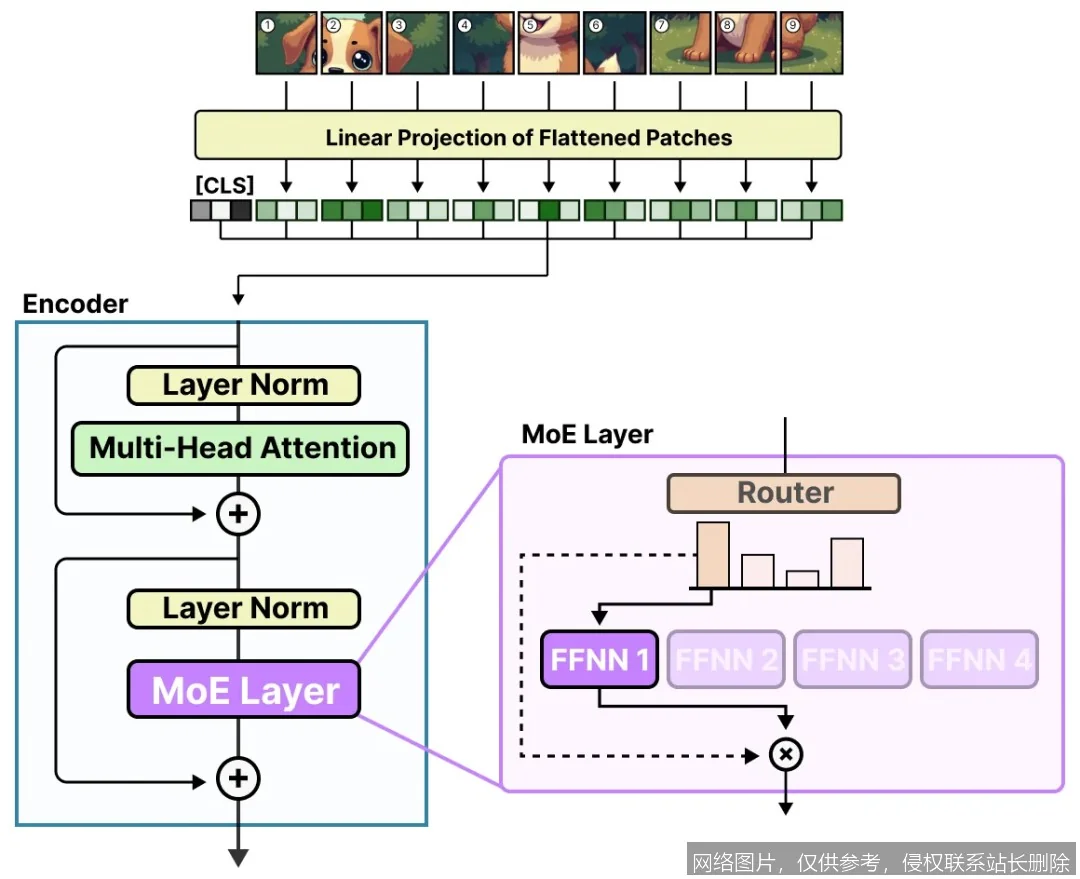

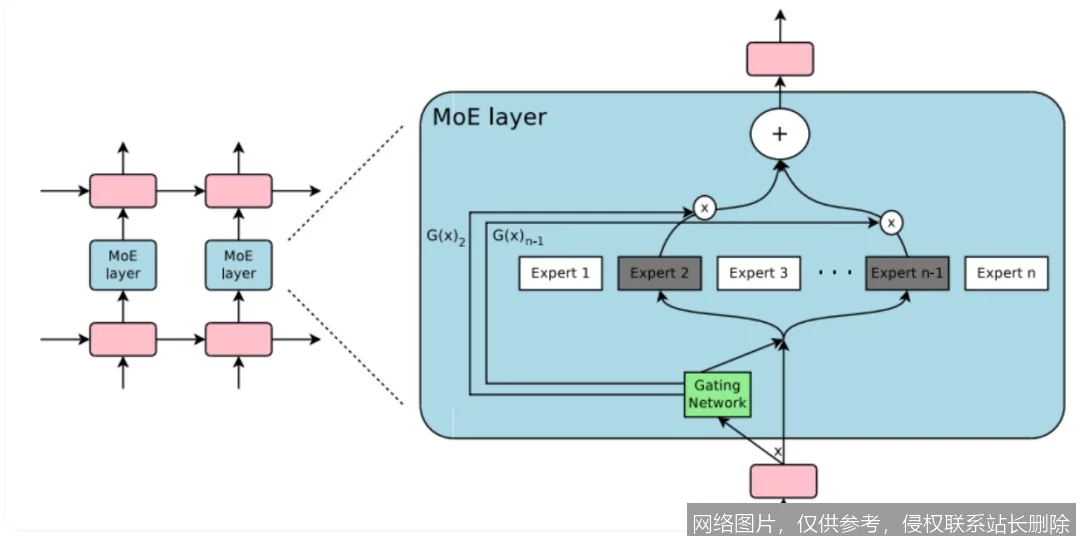

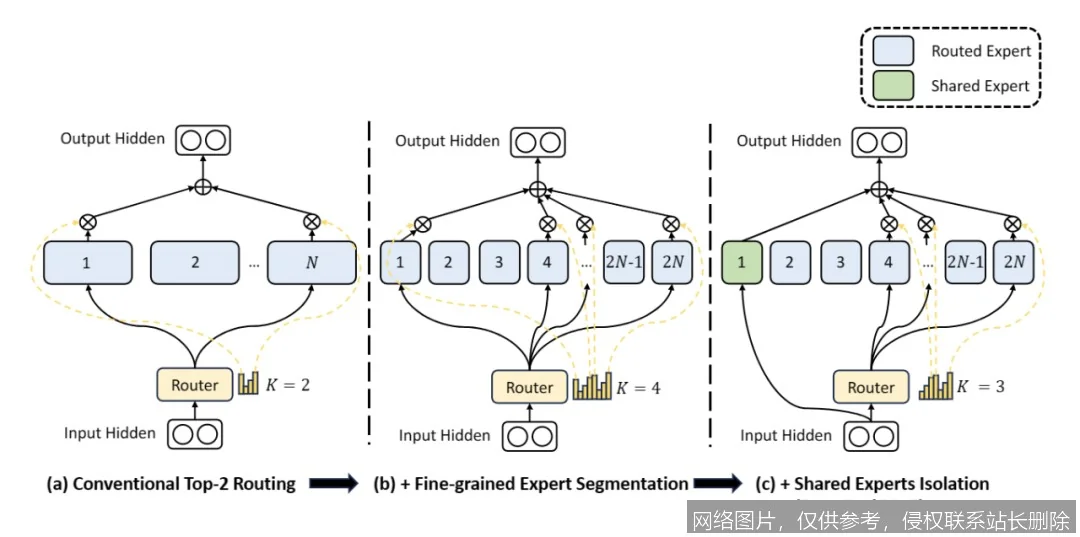

其工作流程可概括为:首先,一个可学习的门控网络(Router)对输入数据进行分析,判断其特性(例如,这是一个关于编程的问题,还是一个关于绘画的问题)。然后,门控网络从众多“专家”中,选出最匹配当前任务的Top-K个(通常K很小,如1或2)。最后,只有这少数几个被选中的专家被激活来处理输入,它们的输出经过加权组合后形成最终结果。这种“按需调用、稀疏激活”的特性,使得模型总参数量可以极大增加(达到千亿甚至万亿级别),而每次计算成本(FLOPs)却只与激活的专家参数相关,从而实现了在可控计算开销下的模型容量飞跃。

应用场景

- 超大规模语言模型:这是MoE最著名的应用领域。例如,Google的Switch Transformer和GLaM模型,以及开源的Mixtral 8x7B模型,都采用了MoE架构。它们通过集成数百乃至数千个专家,构建了参数规模巨大但推理高效的模型,在文本生成、理解等任务上表现出色。

- 多模态学习:在处理融合了文本、图像、音频等多种信息的数据时,不同的专家可以专门化于处理特定模态的特征。门控网络能够根据输入数据的模态构成,灵活地组合视觉专家、语言专家等,实现更高效精准的多模态理解和生成。

- 个性化推荐系统:在推荐场景中,不同的专家可以专注于不同用户群体或物品类别(如电影、书籍、音乐)。系统根据当前用户和物品的特征,稀疏地激活相关专家进行预测,从而实现更精细、个性化的推荐,同时控制计算负载。

相关术语

理解MoE,可关联以下概念:稀疏激活、门控网络、条件计算、Transformer架构、模型并行、负载均衡。

延伸阅读

若想深入了解,建议从研究论文《Outrageously Large Neural Networks: The Sparsely-Gated Mixture-of-Experts Layer》和《Switch Transformers: Scaling to Trillion Parameter Models with Simple and Efficient Sparsity》入手。同时,分析开源MoE模型(如Mixtral)的架构实现代码,是理解其工程细节的最佳途径。