【AI词典】数据集 - 用于训练与评估模型的样本集合

AI词典2026-04-25 20:12:00

数据集:定义与核心

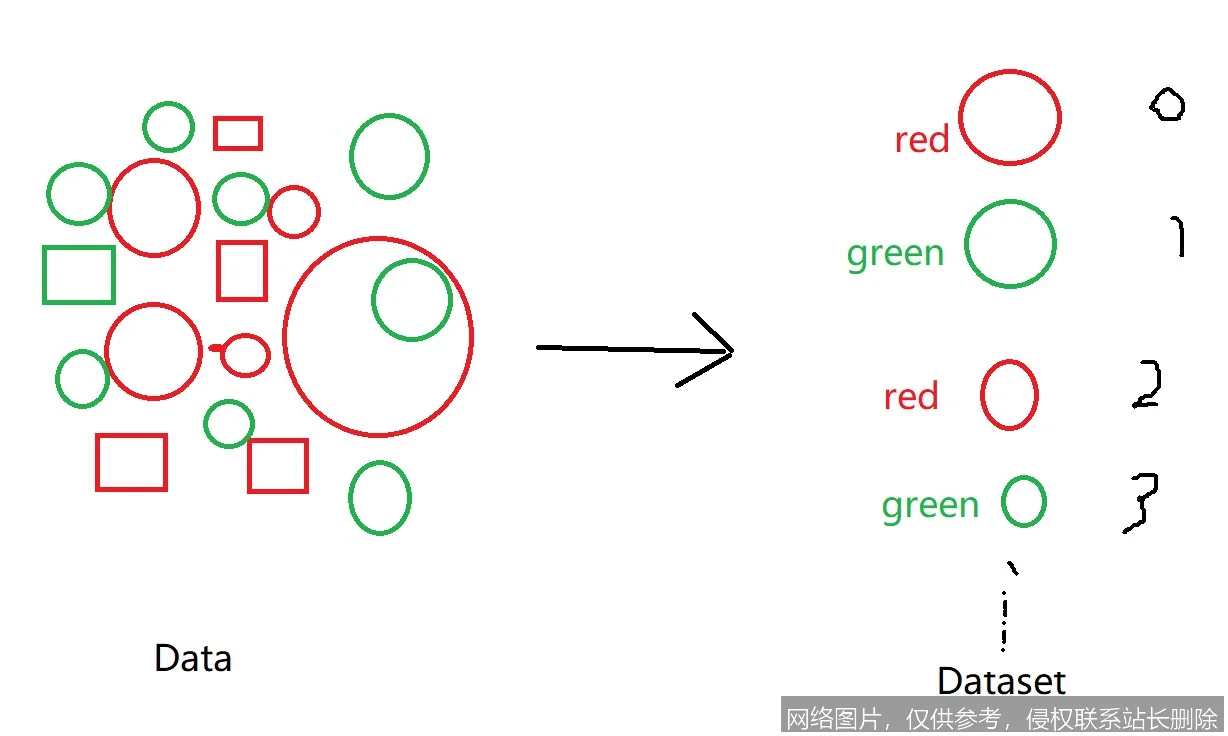

数据集(Dataset)是经过系统化组织、标注和管理的样本集合,是人工智能模型进行训练、验证和测试的基石。它如同模型的“教材”与“考卷”,直接决定了模型的知识边界与性能上限。

数据集的工作原理

数据集的工作原理可以类比为人类的学习过程。模型并非直接理解世界,而是通过分析数据集中海量的“示例”来发现规律。例如,一个用于图像识别的数据集包含成千上万张带有“猫”、“狗”标签的图片。模型在训练阶段反复“阅读”这些样本,逐步调整内部参数,学习区分猫与狗的特征(如耳朵形状、面部轮廓)。数据集通常被划分为三个独立部分:训练集用于教授模型,验证集用于在训练中微调模型超参数,测试集则作为最终、独立的考试,评估模型的真实泛化能力。高质量的数据集要求样本具有代表性、标注准确且分布均衡,避免模型学到偏见或无关噪声。

数据集的应用场景

- 计算机视觉:在自动驾驶领域,数据集包含数百万张标注了行人、车辆、交通标志的街景图像和视频序列,用于训练感知系统精准识别环境。在医疗影像分析中,由专业医师标注的CT、MRI扫描图数据集,帮助AI模型辅助诊断疾病。

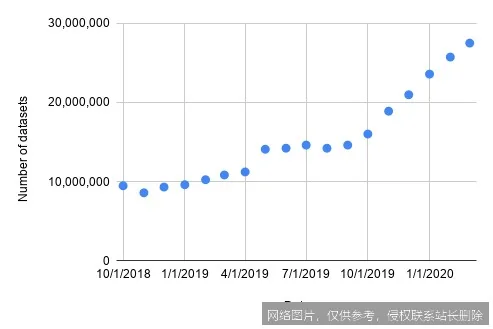

- 自然语言处理:大规模文本数据集(如网页文章、对话记录)是训练大语言模型的基础。通过分析这些语料,模型学会生成文本、翻译语言或理解情感。例如,客服聊天机器人依赖高质量的对话数据集来学习如何有效回应用户查询。

- 推荐系统:电商或流媒体平台利用用户行为数据集(如点击、购买、观看历史),训练模型挖掘用户偏好与物品特征之间的复杂关联,从而实现个性化的商品或内容推荐。

相关术语

延伸阅读

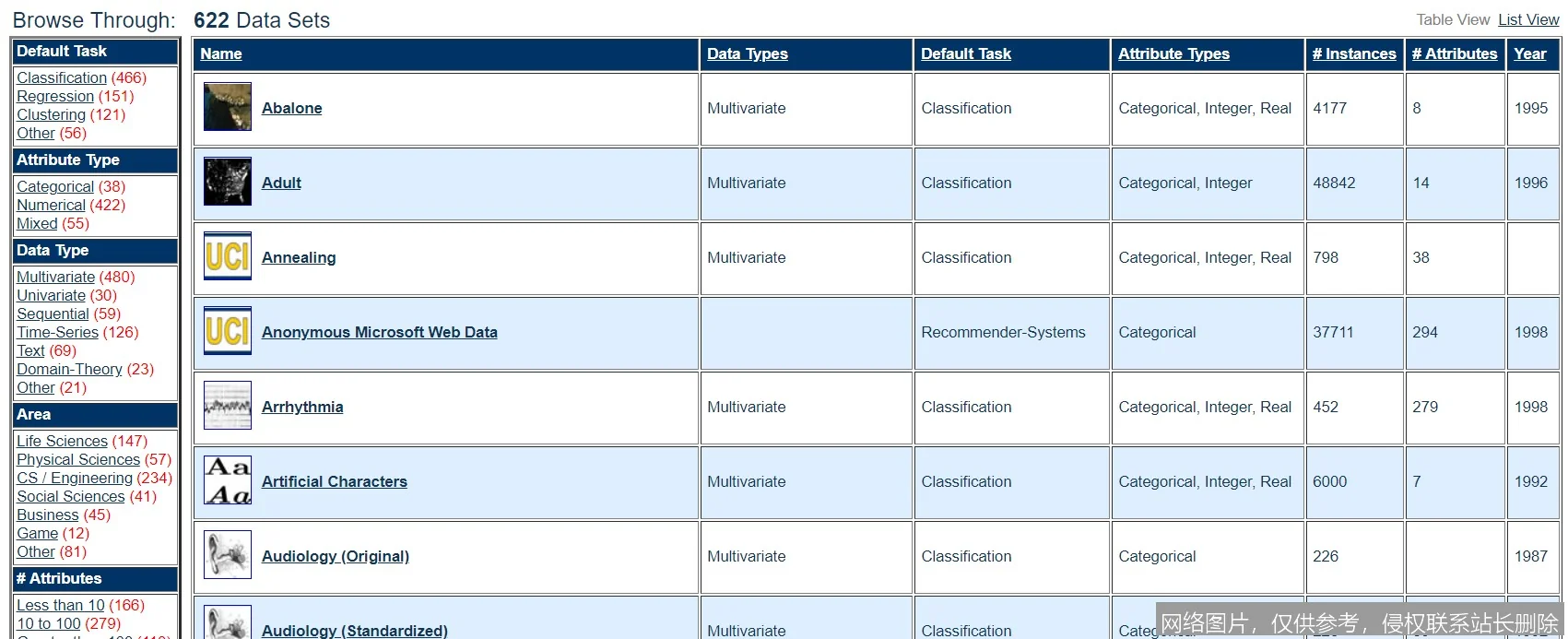

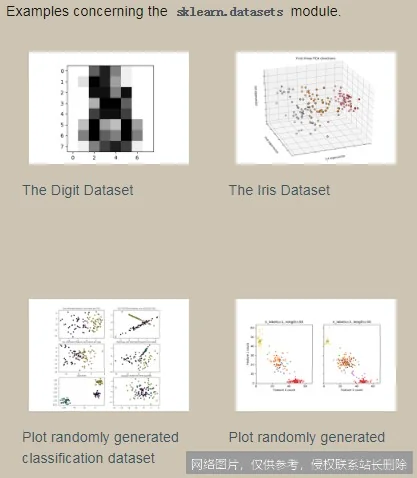

若想深入了解数据集的构建与挑战,可关注“数据偏差”与“数据隐私”相关研究。经典资源如吴恩达(Andrew Ng)的《机器学习》课程中,对数据集的划分与处理有系统阐述。实践中,可探索公开数据集平台(如Kaggle、天池)以接触真实项目数据。