【AI词典】模型合并 - 融合多个AI模型参数的技术

AI词典2026-04-26 00:24:00

模型合并:融合多个AI模型参数的技术

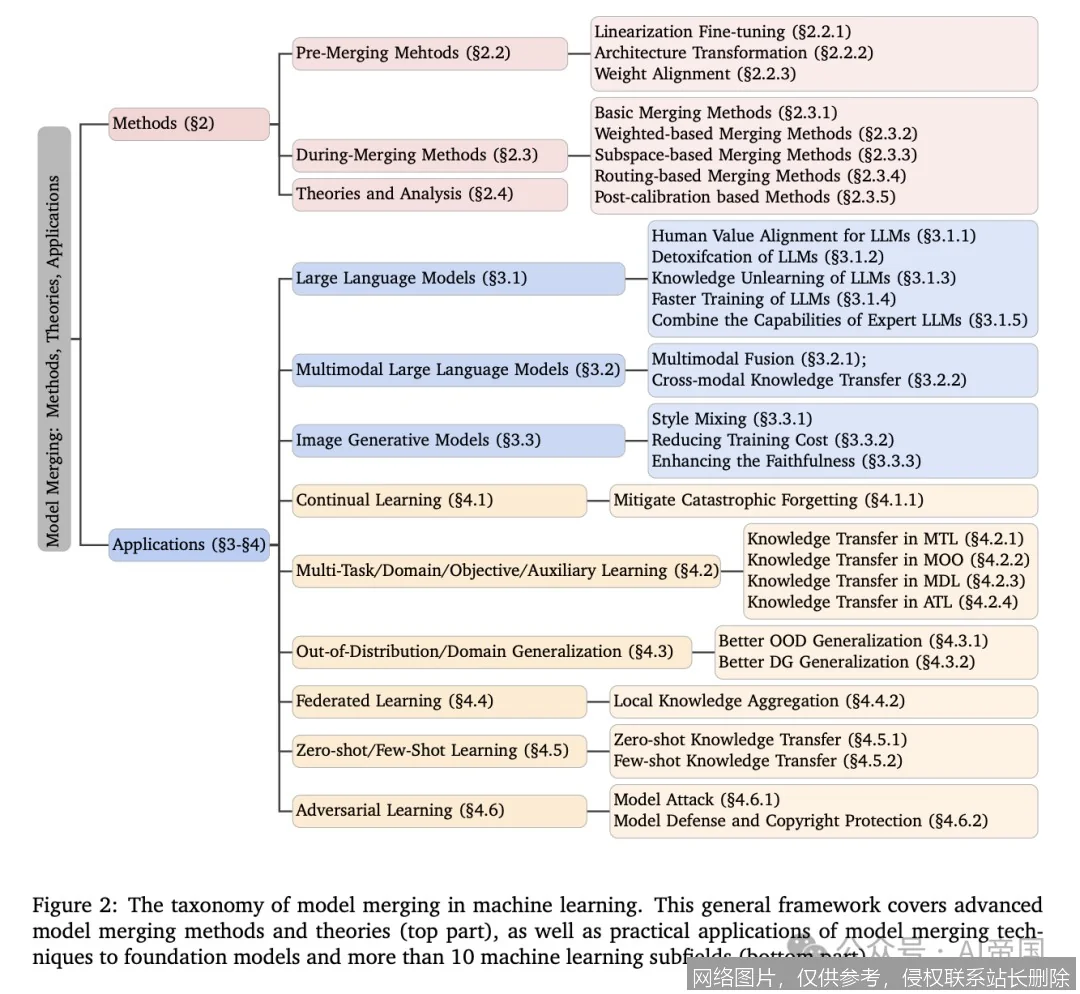

模型合并(Model Merge)是一种将多个预训练人工智能模型的参数进行融合,以创造出一个具备综合能力或新能力单一模型的技术。其核心目标并非重新训练,而是通过算法直接组合现有模型的“知识”。

原理:模型知识的“调和”与“平均”

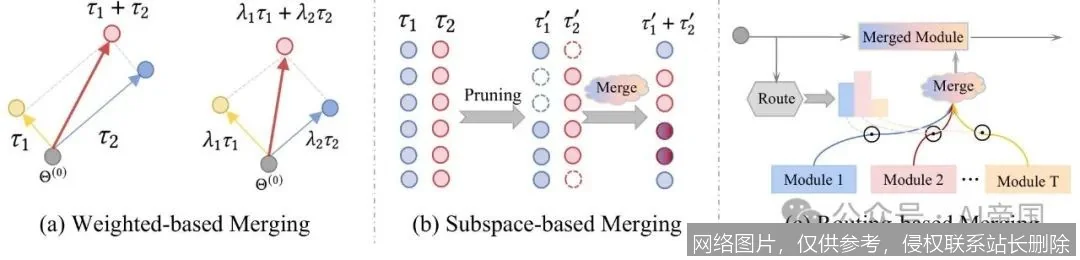

模型合并的工作原理,可以类比为调和多位专家的意见以形成共识。每个预训练模型都像一位在特定数据上学习过的专家,拥有自己的参数(即“知识记忆”)。模型合并技术通过数学运算,将这些不同专家的参数空间进行对齐与融合。

主流方法如模型参数平均(如 Task Arithmetic),直接对多个模型的权重进行线性插值,如同计算几位专家意见的加权平均值。更精细的方法如 TIES-Merging,会先修剪各模型中的冗余或冲突参数,再对一致的重要参数进行合并,从而减少知识冲突,提升合并后模型的性能。整个过程通常在模型完成训练后进行,无需原始训练数据,计算效率远低于从头训练。

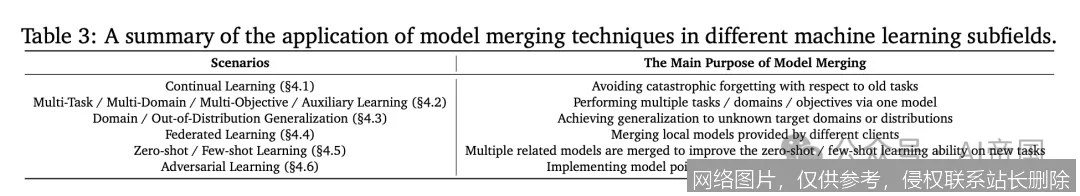

应用场景

模型合并在以下实际场景中展现出巨大价值:

- 能力集成:将精通不同语言翻译的多个模型合并,创建一个支持多语种翻译的统一模型;或将擅长代码生成的模型与擅长自然语言对话的模型合并,尝试构建兼具两者能力的助手。

- 性能提升与鲁棒性增强:将多个在同一任务上、但不同数据子集或初始化条件下训练的模型合并,往往能集成其优点,获得比任一单一模型更优、更稳定的性能,这类似于机器学习中的集成学习思想。

- 高效定制化:社区常发布针对特定技能(如角色扮演、数学推理)微调的小型模型。用户可通过模型合并技术,将这些“技能插件”模块化地融合到基础大模型中,快速定制个性化AI,而无需庞大的计算资源进行全参数微调。

相关术语

理解模型合并,可关联以下概念:微调、参数高效微调、集成学习、模型权重、知识蒸馏。

延伸阅读

若想深入了解,可研究论文《Model Soup: Averaging Weights of Multiple Fine-tuned Models Improves Accuracy》和《TIES-Merging: Resolving Interference When Merging Models》,它们分别阐述了模型平均的基础思想和先进的冲突消解合并技术。开源项目如 `mergekit` 提供了实践这些算法的工具。