【AI词典】灾难性遗忘 - 神经网络在学习新任务时丢失旧知识的现象

AI词典2026-04-25 18:48:00

灾难性遗忘:定义

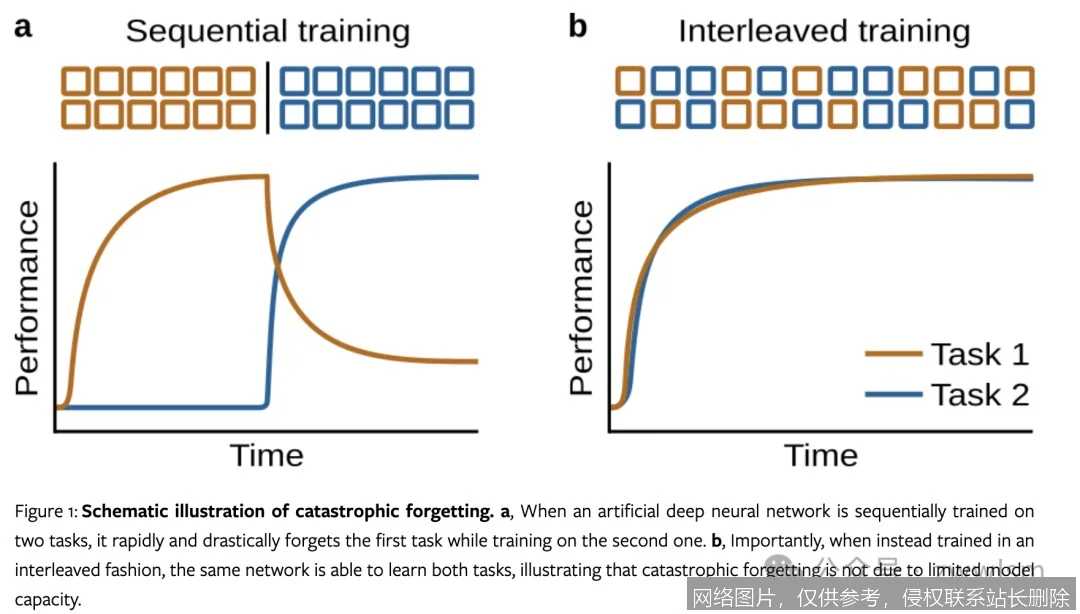

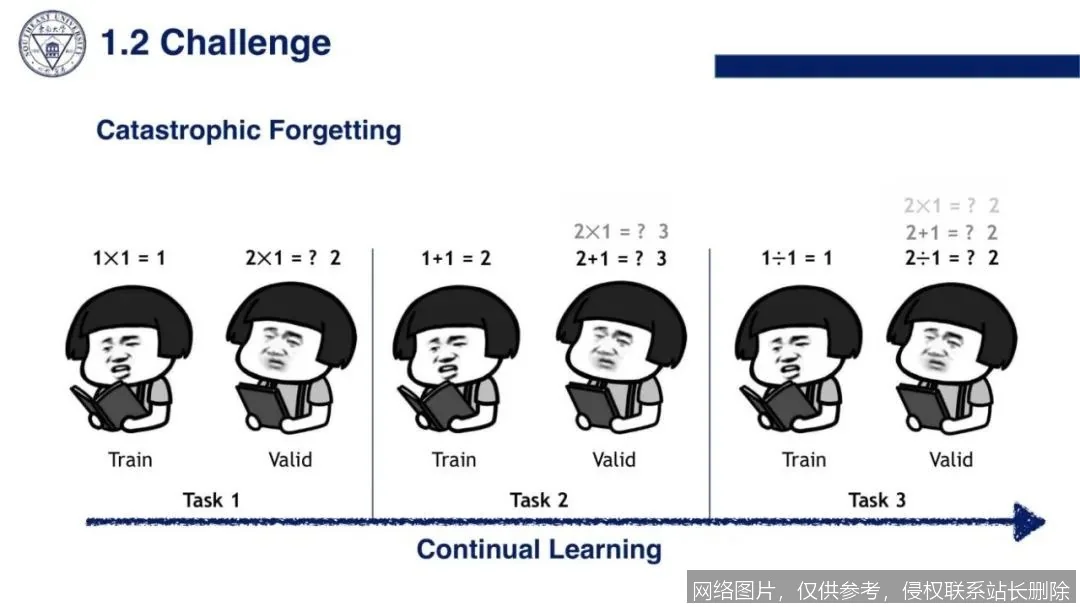

灾难性遗忘,亦称灾难性干扰,是人工神经网络在持续学习新任务或新数据时,其性能在先前已掌握的任务上发生急剧、灾难性下降的现象。 这本质上是模型在学习新知识的过程中,覆盖或丢失了旧知识的表征,导致“学了新的,忘了旧的”。

灾难性遗忘的原理

可以将一个训练好的神经网络想象成一片精心塑造的沙雕(代表旧任务的知识)。当需要在这片沙雕上添加新内容(学习新任务)时,如果直接大刀阔斧地修改,原有的沙雕结构很容易被破坏殆尽。在技术层面,这是因为神经网络通常使用基于梯度的优化算法(如反向传播)来更新其连接权重。当用新任务的数据进行训练时,权重会朝着优化新任务的方向大幅调整,而这些调整方向往往与维持旧任务性能所需的最优权重配置相冲突。由于网络参数是共享的,对权重的大幅度、无约束的更新,就相当于用新信息“覆盖”了旧信息在权重中留下的印记,从而导致了旧知识的遗忘。

灾难性遗忘的应用场景

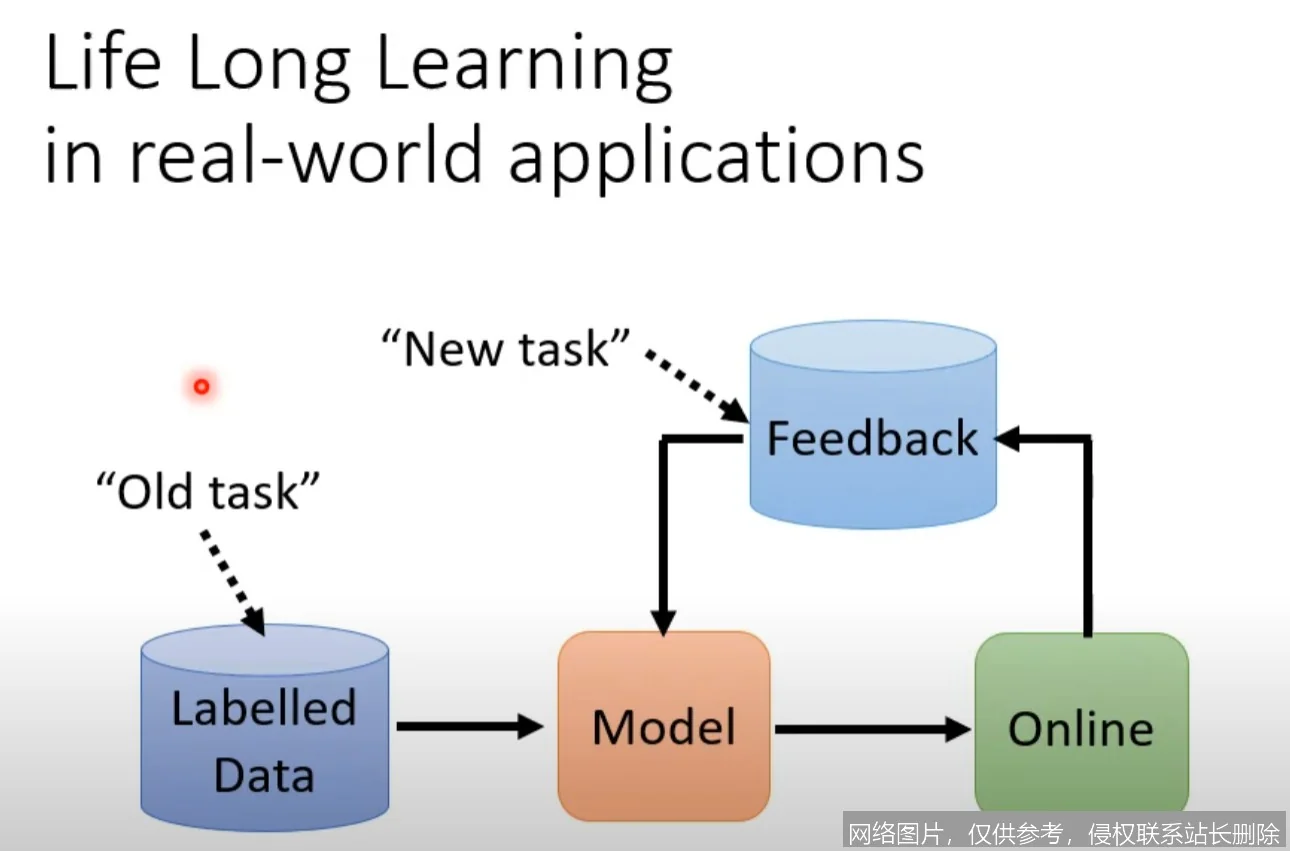

理解并克服灾难性遗忘对于构建实用、高效的持续学习系统至关重要,其应用场景广泛:

- 个性化AI助手:一个能持续学习用户个人偏好和习惯的智能助手,需要在学习新指令或了解用户新兴趣的同时,牢牢记住用户的核心习惯和过往指令。若发生灾难性遗忘,助手可能会变得“六亲不认”,忘记用户的基本设定。

- 自动驾驶系统的持续升级:自动驾驶模型需要不断学习新的道路规则、识别新车型或适应不同城市的路况。在更新模型以应对新场景时,必须确保其不会忘记如何安全处理常见的标准驾驶场景(如识别红绿灯、行人),否则将带来巨大风险。

- 医疗诊断模型的迭代:一个用于医学影像分析的AI模型,最初擅长识别疾病A。当引入疾病B的新数据对其进行增强训练时,模型不应在疾病A的诊断准确率上出现显著下滑,否则其临床实用价值将大打折扣。

相关术语

要深入理解灾难性遗忘,可以关联以下概念:持续学习、弹性权重巩固、梯度下降、过拟合、多任务学习以及神经网络稳定性-可塑性困境。

延伸阅读

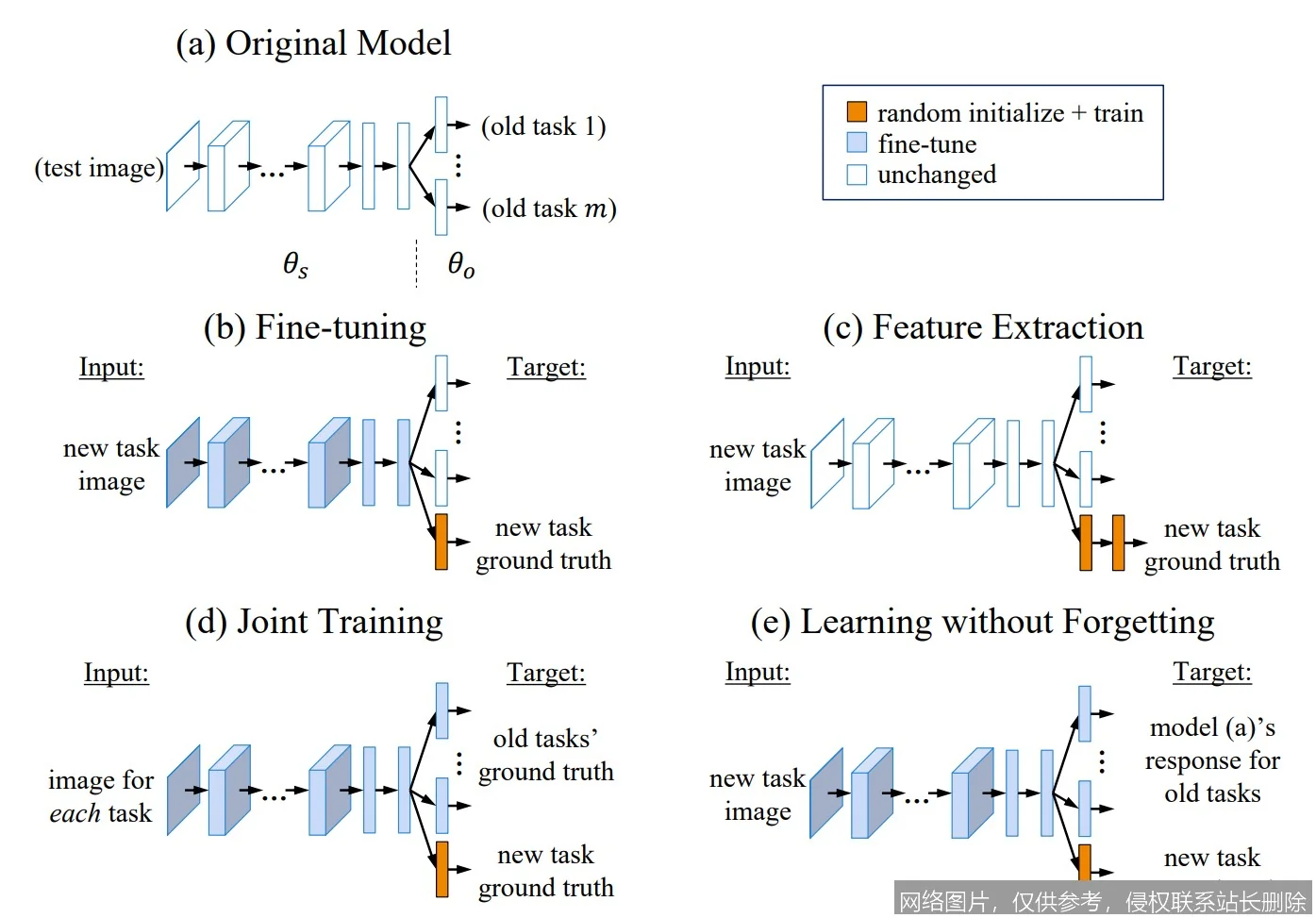

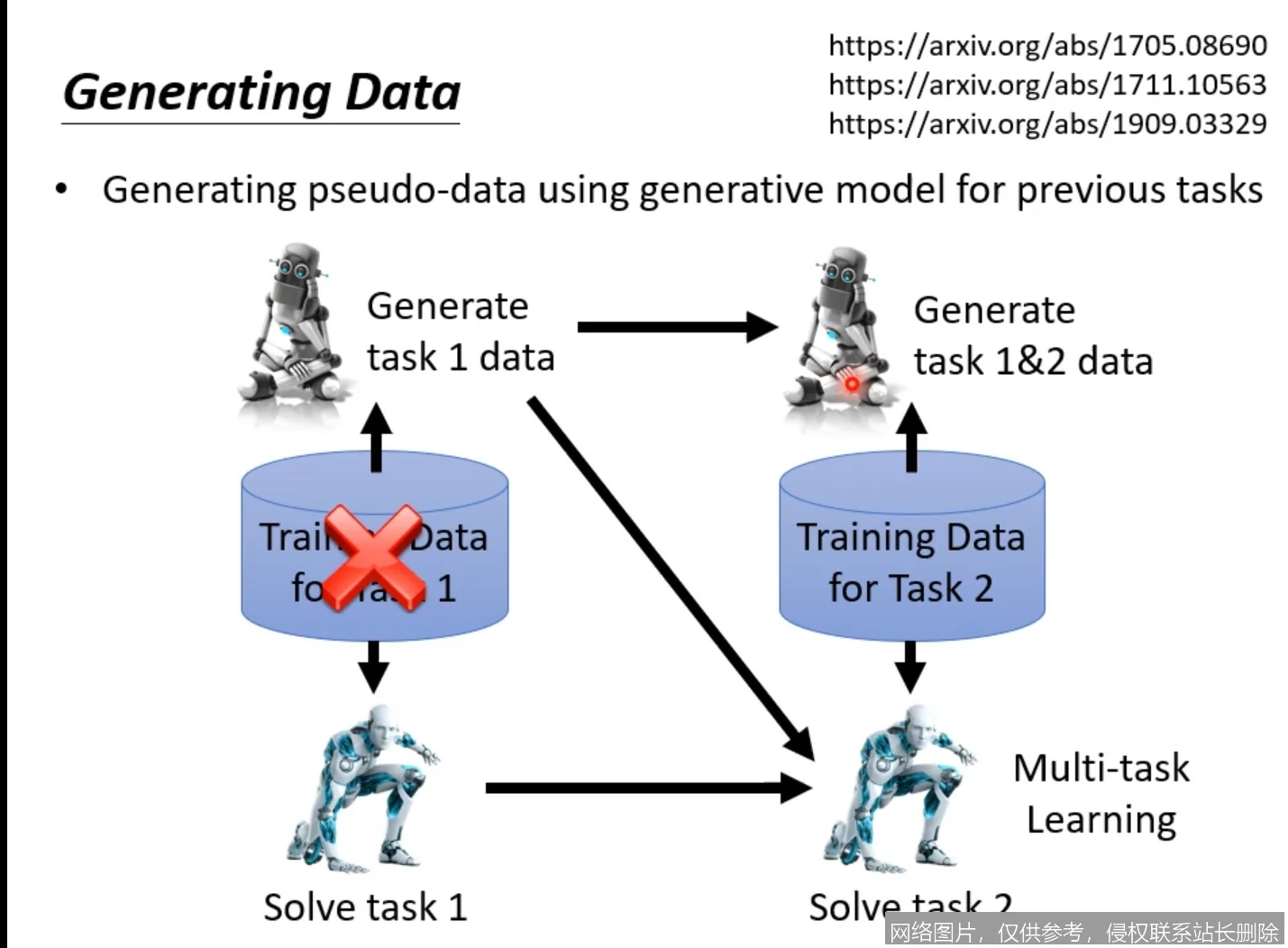

若希望深入了解克服灾难性遗忘的技术,可以搜索“持续学习综述”、“弹性权重巩固算法”或“渐进式神经网络”等主题。研究论文通常会探讨如何通过正则化约束、动态扩展网络结构或保留部分旧数据(经验回放)等策略来缓解这一根本性挑战。