【AI词典】多头注意力 - 并行处理不同表示子空间的注意力机制

多头注意力:定义

多头注意力(Multi-Head Attention)是一种核心的神经网络机制,它通过并行运行多组独立的注意力计算,使模型能够同时关注输入信息在不同表示子空间中的不同方面,从而显著增强模型的表征和泛化能力。

多头注意力的工作原理

要理解多头注意力,可以将其想象成一个高效的专家团队协作分析一份复杂文件。首先,团队会将这份文件(输入序列)复制成多份。然后,每位专家(一个“注意力头”)被赋予不同的分析视角和侧重点——例如,一位专注于语法结构,另一位挖掘情感色彩,第三位留意关键词实体。他们各自独立、并行地工作,在自己的“子空间”里分析文件各部分之间的关联强度,并生成一份独立的分析摘要。

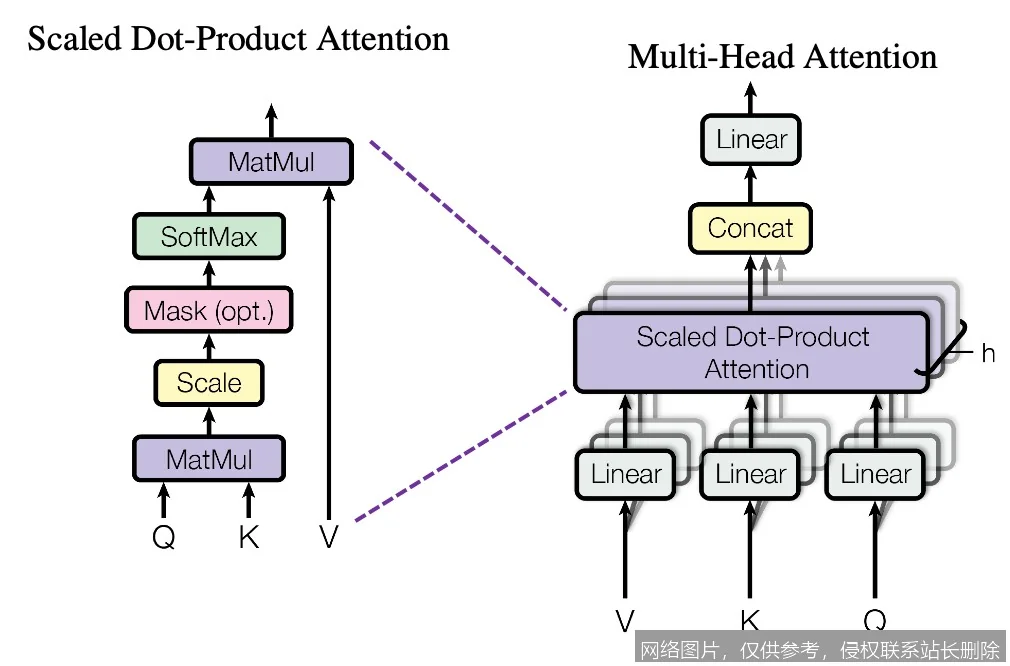

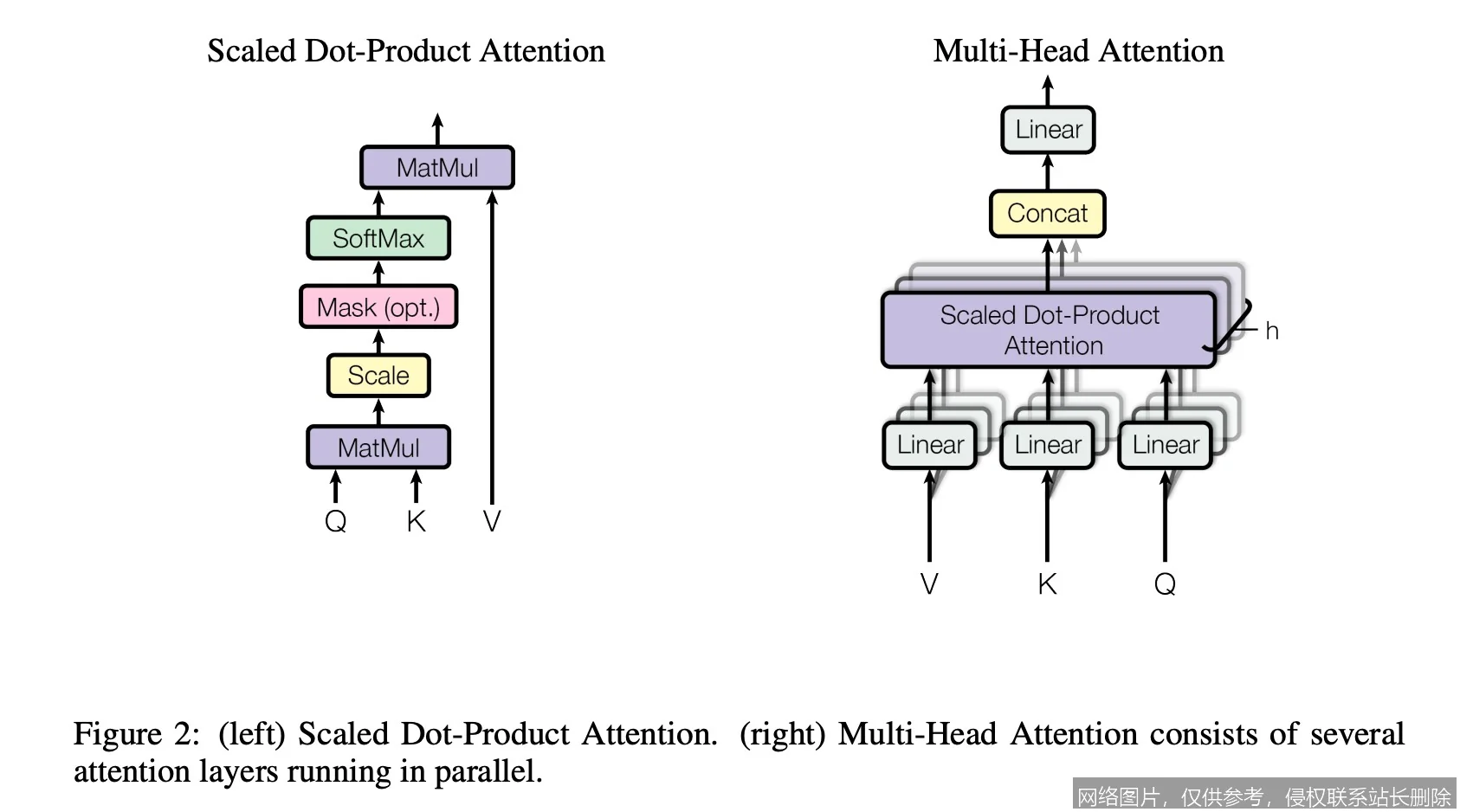

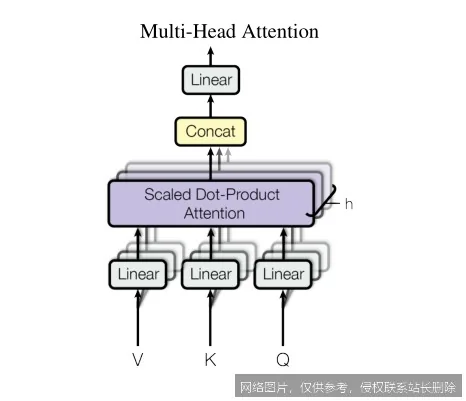

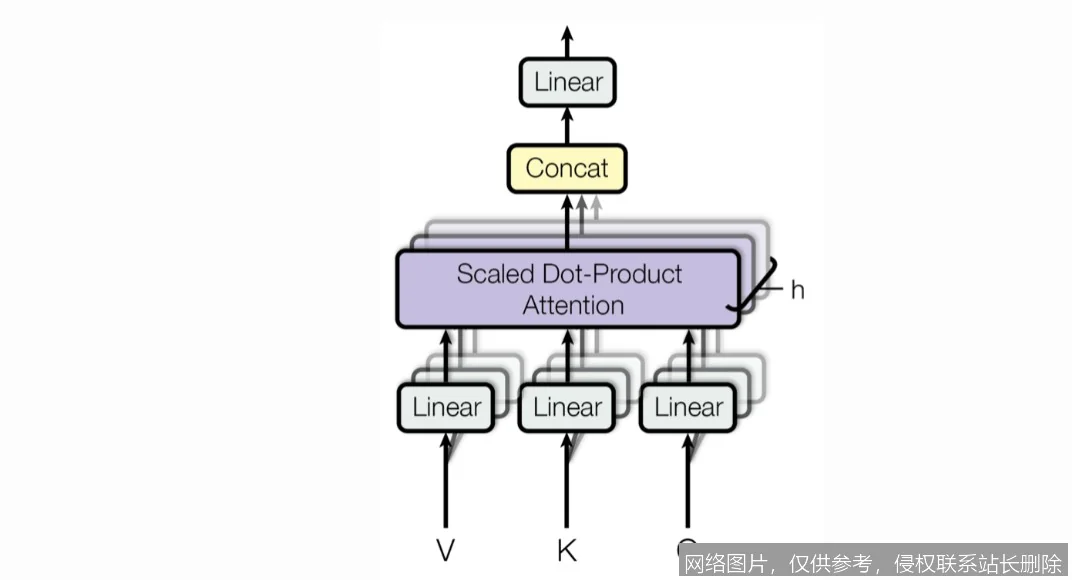

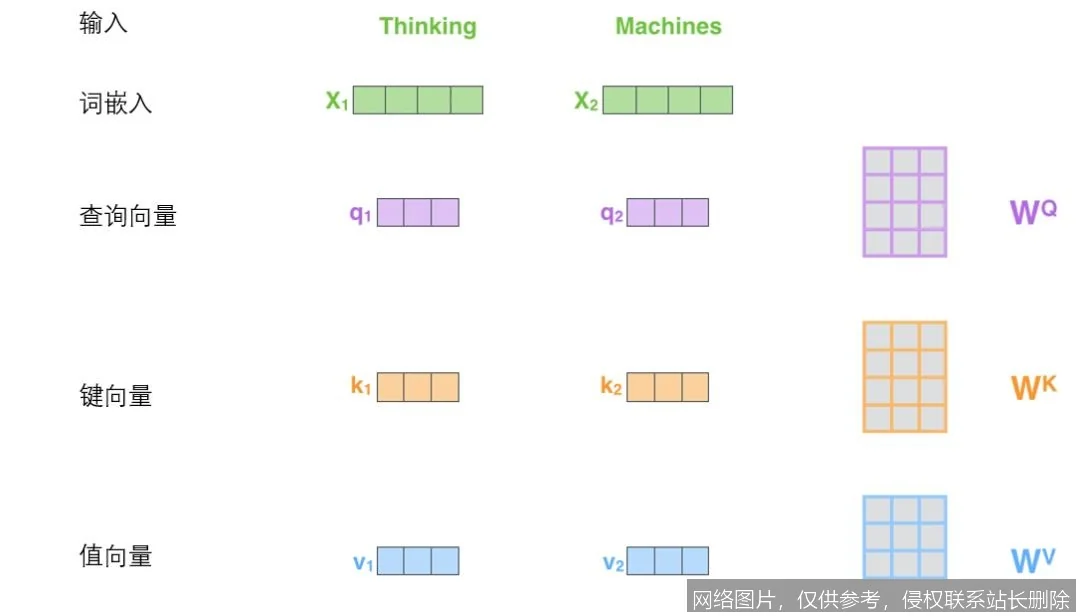

在技术实现上,模型首先将输入嵌入向量通过不同的线性投影矩阵,分别映射到多个维度更低的查询、键、值子空间。每个“头”在这些子空间上执行标准的缩放点积注意力(Scaled Dot-Product Attention)计算。最后,所有头产生的输出被拼接起来,再通过一个最终的线性投影层进行融合与整合,形成最终的上下文感知表示。这种设计允许模型在不同的投影空间中学习多样化的依赖关系。

多头注意力的应用场景

- 机器翻译与文本生成:在Transformer模型中,编码器的多头注意力帮助理解源语言句子内部单词的复杂关系(如指代、修饰),而解码器的多头注意力则同时关注已生成的部分和编码器的输出,确保翻译的准确性与流畅性。

- 大型语言模型(LLM):如GPT、BERT等模型的核心组件。多头注意力机制使模型能够从海量文本中并行捕捉词汇之间在语义、语法、语境等多个层面的远距离依赖,这是其实现强大理解和生成能力的关键。

- 多模态AI系统:在视觉-语言模型中,多头注意力被用来对齐图像区域与文本描述。不同的头可以分别关注物体的颜色、形状、空间位置等不同视觉属性与文本单词的对应关系,实现跨模态的精细理解。

相关术语

理解多头注意力,通常需要关联以下概念:自注意力(Self-Attention)、Transformer架构、缩放点积注意力、位置编码(Positional Encoding)、交叉注意力(Cross-Attention)以及表征学习(Representation Learning)。

延伸阅读

若想深入了解,建议从谷歌2017年的开创性论文《Attention Is All You Need》入手,这是多头注意力机制的首个权威定义。此外,可以查阅关于Transformer架构的图解指南(如“The Illustrated Transformer”),以及深入分析注意力头具体学习到了什么的可视化研究论文,这些资源能帮助建立从理论到实践的完整认知。