LLaVA 是什么:2026 多模态大模型原理、演进与实战全面解析

一句话定义

LLaVA(Large Language-and-Vision Assistant)是一种开源的多模态大模型,通过视觉编码器将图像转化为语言模型可理解的指令,实现像人类一样“看图说话”的深度交互能力。

技术原理:从“盲人”到“全知”的进化之路

要理解 LLaVA 是什么,我们首先需要拆解其背后的技术架构。在 2026 年的今天,回顾 LLaVA 的诞生,它被视为多模态人工智能(Multimodal AI)领域的里程碑式作品。它的核心魅力在于用极其简洁的架构,解决了长期以来困扰业界的“视觉 - 语言对齐”难题。

### 1. 核心工作机制:三剑客的完美协奏

LLaVA 并非从零开始训练一个庞大的新模型,而是巧妙地集成了三个现有的成熟组件,形成了一套高效的协作机制。我们可以将其比作一个高效的翻译团队:

* **视觉编码器(Vision Encoder):敏锐的“眼睛”**

通常采用预训练的 CLIP(Contrastive Language-Image Pre-training)模型中的 ViT(Vision Transformer)部分。它的任务是将输入的像素图像转化为高维的特征向量(Visual Features)。这就好比团队中负责观察世界的摄影师,它不负责思考,只负责精准地捕捉图像中的物体、颜色和空间关系,并将其编码成一种机器可读的“视觉语言”。

* **大型语言模型(Large Language Model, LLM):博学的“大脑”**

这是 LLaVA 的核心推理引擎,通常基于 Llama、Vicuna 或后续更先进的开源基座模型。它拥有海量的世界知识和强大的逻辑推理能力,但原本它是“盲”的,只能处理文本。在 LLaVA 架构中,它负责接收经过处理的视觉信息,并结合上下文进行推理、生成回答。

* **投影层(Projection Layer):神奇的“翻译官”**

这是 LLaVA 最具创新性的部分,通常是一个简单的线性层(Linear Layer)或多层感知机(MLP)。由于“眼睛”看到的视觉特征和“大脑”理解的文本嵌入(Text Embeddings)处于完全不同的数学空间,直接沟通如同鸡同鸭讲。投影层的作用就是将视觉特征映射到语言模型的文本嵌入空间中。经过这个转换,图像特征对于语言模型来说,就变成了一段特殊的“伪文本令牌(Visual Tokens)”,使得语言模型能够像处理单词一样处理图像内容。

**工作流程简述:**

当用户输入一张图片和一个问题时,图片首先通过视觉编码器提取特征;接着,投影层将这些特征转换为语言模型能听懂的向量;最后,这些向量与用户的文本问题拼接在一起,送入大型语言模型。语言模型基于其预训练的知识库,结合眼前的“视觉描述”,生成自然的语言回答。

### 2. 关键技术组件解析:两阶段训练法

LLaVA 之所以能以较小的数据量实现卓越的性能,归功于其独特的两阶段训练策略(Two-Stage Training Strategy),这也是理解其原理的关键。

* **第一阶段:特征对齐预训练(Feature Alignment Pre-training)**

在这个阶段,冻结视觉编码器和语言模型的参数,仅训练投影层。使用的数据集是大规模的“图像 - 文本对”(如 LAION 等),目的是让投影层学会如何将视觉信号准确地“翻译”成语言模型能理解的形式。这就好比让翻译官先熟悉两种语言的词汇对应关系,而不需要改变摄影师的观察方式或大脑的思考逻辑。

* **第二阶段:指令微调(Instruction Tuning)**

这是 LLaVA 变得“聪明”且“听话”的关键。在此阶段,解冻语言模型和投影层(或部分解冻),使用高质量的“多模态指令跟随数据集”(LLaVA-Instruct)进行训练。这些数据不仅包含“图 + 文”,还包含复杂的问答、推理链条和多轮对话。通过这一阶段,模型学会了如何根据用户的指令去关注图像的特定细节,如何进行逻辑推理,以及如何以人类的口吻进行交流。

### 3. 与传统方法的对比:为何 LLaVA 是革命性的?

在 LLaVA 出现之前,多模态模型主要走两条路:

* **传统专用模型路线:** 针对特定任务(如图像描述、视觉问答 VQA)训练独立的模型。缺点是泛化性差,无法进行开放式的对话,且每个任务都需要单独部署一套系统。

* **早期端到端大模型路线:** 尝试从头训练一个巨大的多模态模型。缺点是算力消耗天文数字,数据需求极大,且往往牺牲了语言模型原有的强大推理能力。

**LLaVA 的突破在于“模块化”与“复用”:**

它没有重新发明轮子,而是站在巨人的肩膀上。它保留了最强开源语言模型的推理能力,复用了最强大的视觉编码器的感知能力,仅用一个轻量级的投影层将它们连接。这种设计使得 LLaVA 具有以下优势:

1. **数据效率高:** 不需要亿级的图文对就能达到优异效果。

2. **灵活性强:** 可以随时更换更强的语言模型基座或视觉编码器,即插即用。

3. **零样本迁移能力:** 得益于强大的语言基座,它在未见过的任务上也表现出惊人的泛化能力。

如果用建筑来类比,传统方法像是在每一块空地上重新打地基盖房子;而 LLaVA 则是利用已经建好的坚固大楼(LLM)和精密仪器(Vision Encoder),通过一条智能走廊(Projector)将它们连通,瞬间形成了一座功能完备的摩天大厦。

核心概念:构建多模态认知的基石

深入理解 LLaVA 是什么,必须掌握以下几个核心概念。这些术语构成了多模态大模型的知识图谱。

### 1. 关键术语解释

* **多模态(Multimodal):**

指模型能够同时处理和关联多种类型的数据输入,如文本、图像、音频甚至视频。在 LLaVA 的语境下,特指“视觉 + 语言”的双模态融合。这不仅仅是简单的并列处理,而是深度的语义对齐。

* **视觉令牌(Visual Tokens):**

这是 LLaVA 内部运作的一个抽象概念。经过投影层处理后,图像被切分成若干个网格(Patch),每个网格的特征向量被转化为类似于文本中的"Token"。对于语言模型而言,这些 Visual Tokens 就是句子中的“形容词”或“名词”,描述了图像的内容。

* **指令跟随(Instruction Following):**

指模型能够准确理解并执行用户发出的复杂指令,而不仅仅是完成固定的分类或生成任务。例如,用户说“请找出图中穿红衣服的人并描述他在做什么”,模型需要识别对象、属性、动作并组织语言回答,这就是指令跟随能力的体现。

* **幻觉(Hallucination):**

多模态模型常见的缺陷,指模型生成的描述中包含图像中不存在的物体或错误的事实。虽然 LLaVA 大幅减少了幻觉,但在复杂场景下仍可能发生。理解这一点对于实际应用中的风险控制至关重要。

* **高分辨率感知(High-Resolution Perception):**

早期 LLaVA 版本受限于输入尺寸,难以看清小字或细节。2024-2026 年间演进的版本引入了动态分辨率机制(如 AnyRes),允许模型处理任意比例的超高清图像,这是其走向实用的关键技术点。

### 2. 概念关系图谱

为了理清这些概念,我们可以构建如下的逻辑关系:

* **基础层:** 视觉编码器(提取特征) + 语言模型(提供推理)。

* **连接层:** 投影层(实现模态对齐,生成视觉令牌)。

* **训练层:** 特征对齐预训练(建立连接) -> 指令微调(赋予智能)。

* **表现层:** 多模态对话、视觉推理、OCR 识别、代码生成。

* **约束层:** 幻觉抑制、分辨率限制、上下文窗口大小。

在这个图谱中,**投影层**是枢纽,**指令微调**是灵魂,**视觉令牌**是载体。

### 3. 常见误解澄清

* **误解一:"LLaVA 是自己‘看’懂了图片。”**

*真相:* 严格来说,LLaVA 的语言模型部分并没有真正的视觉皮层。它看到的是由投影层转化而来的数学向量。它是在利用语言模型中已有的世界知识,去“脑补”和推理这些向量所代表的含义。这是一种统计意义上的“理解”,而非生物意义上的视觉感知。

* **误解二:"LLaVA 只能做图像描述。”**

*真相:* 这是一个巨大的低估。得益于强大的语言基座,LLaVA 可以进行逻辑推理(如数数、比较大小)、解答数学题(结合图表)、编写代码(根据界面截图生成前端代码),甚至进行情感分析。它是一个通用的多模态助手,而非单一的识图工具。

* **误解三:“开源的 LLaVA 性能不如闭源模型。”**

*真相:* 在 2026 年的视角看,随着 LLaVA-NeXT 及后续版本的迭代,其在多项基准测试(Benchmark)上已经逼近甚至在特定领域超越了早期的闭源商用模型。开源社区的创新速度使得 LLaVA 生态成为了多模态技术的试验田和加速器。

实际应用:从实验室走向千家万户

LLaVA 的出现降低了多模态 AI 的使用门槛,使其迅速渗透到各个行业。以下是其在 2026 年背景下的典型应用场景与实战案例。

### 1. 典型应用场景列举

* **智能教育与个性化辅导:**

学生只需拍摄一道复杂的几何题或化学实验图上传,LLaVA 不仅能给出答案,还能像真人老师一样,逐步解析解题思路,指出图中的关键条件,甚至模拟苏格拉底式的提问引导学生思考。它解决了传统搜题软件只能给结果无法给过程的痛点。

* **无障碍辅助与生活助手:**

对于视障人士,LLaVA 可以作为实时的“电子导盲犬”。通过手机摄像头,它能详细描述周围环境:“前方三米有一张空长椅,左侧有一只流浪猫”,或者阅读药品说明书上的微小字体并播报注意事项。其细粒度的描述能力极大地提升了特殊群体的生活质量。

* **企业文档分析与自动化办公:**

在金融和法律领域,面对堆积如山的报表、合同扫描件和图表,LLaVA 可以快速提取关键数据,总结趋势,甚至发现数据异常。员工可以用自然语言询问:“对比这两张季度的营收图表,哪个部门的增长率最高?”模型即刻给出分析结果,大幅提升了信息检索效率。

* **电商与零售体验升级:**

用户上传一张家居照片,询问“如果在这里放一张北欧风格的沙发会合适吗?推荐几款?”LLaVA 可以分析空间布局、色调风格,并结合商品库给出建议。此外,它还支持“以图搜图”的进阶版——“以图问货”,直接理解用户的审美意图。

* **工业质检与远程运维:**

一线工人拍摄设备仪表盘或故障部位的照片,LLaVA 能识别读数是否正常,判断故障类型,并直接从维修手册中调取相应的解决步骤推送给工人。这在偏远地区或高危环境中具有极高的应用价值。

### 2. 代表性产品/项目案例

* **LLaVA-Online / LLaVA-Interactive:**

这是基于 LLaVA 架构开发的实时交互系统,支持视频流输入。用户可以在直播或视频会议中,让 AI 实时分析画面内容,生成字幕、摘要或即时翻译,广泛应用于会议记录和在线教育直播。

* **医疗影像助手(Med-LLaVA 变体):**

经过医学数据微调的 LLaVA 变体,能够辅助医生初步阅片。它可以标注 X 光片或 CT 扫描中的异常阴影,并生成初步的诊断报告草案,供医生复核。虽然不能替代医生,但显著减少了重复劳动。

* **个人桌面助理(Desktop Agent):**

集成在操作系统层面的 LLaVA 应用,能够“看懂”用户的屏幕内容。用户可以指令:“把当前网页上的表格整理成 Excel 发给我”,或者“帮我检查这段代码有没有明显的语法错误”。它实现了从“命令行交互”到“屏幕语义交互”的跨越。

### 3. 使用门槛和条件

尽管 LLaVA 功能强大,但在实际部署中仍需考虑以下条件:

* **算力要求:**

运行一个 7B(70 亿参数)版本的 LLaVA,通常需要至少 16GB-24GB 显存的 GPU(如 RTX 3090/4090)才能实现流畅的推理。对于更大参数版本(如 34B 或 72B),则需要多卡并行或云端部署。不过,随着量化技术(Quantization,如 INT4)的成熟,如今在消费级显卡甚至高端手机上运行精简版 LLaVA 已成为可能。

* **数据隐私与安全:**

由于模型需要处理图像和文本,涉及敏感的隐私数据。在企业应用中,通常建议本地化部署(On-premise),避免数据上传至公有云。同时,需防范“提示词注入攻击”,防止恶意图片诱导模型输出有害内容。

* **领域适应性:**

通用的 LLaVA 在专业领域(如法律、医疗、精密制造)可能存在知识盲区。实际落地前,通常需要使用特定领域的私有数据进行二次微调(Fine-tuning),以确保输出的准确性和合规性。

延伸阅读:通往多模态未来的阶梯

LLaVA 只是多模态人工智能宏大叙事中的一个精彩章节。想要更全面地掌握这一领域,建议从以下几个维度进行深入探索。

### 1. 相关概念推荐

* **GPT-4V / GPT-4o:** 了解闭源商业模型在多模态领域的天花板,对比其与开源 LLaVA 在性能、成本和可控性上的差异。

* **Diffusion Models(扩散模型):** 如果说 LLaVA 是“看懂”世界,扩散模型(如 Stable Diffusion, Midjourney)则是“创造”世界。理解两者的结合(如生成 - 理解闭环)是未来 AGI 的关键。

* **Agent(智能体):** 学习如何让 LLaVA 不仅会回答问题,还能调用工具、执行操作(如点击按钮、搜索网络),成为真正自主的智能体。

* **World Models(世界模型):** 探索下一代 AI 如何通过视频预测来理解物理世界的因果律,这是超越当前静态图像理解的下一步。

### 2. 进阶学习路径

* **入门阶段:**

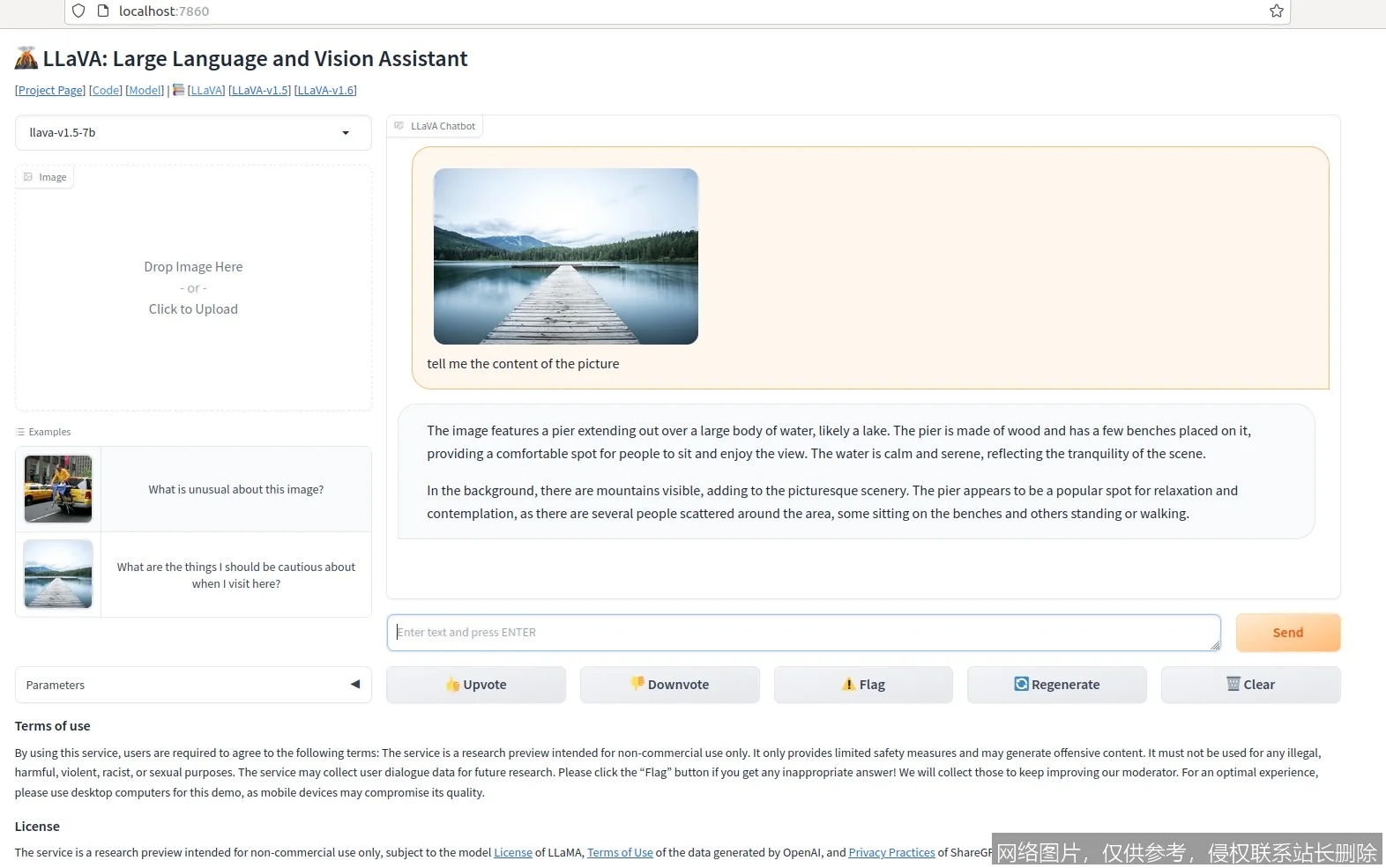

阅读 LLaVA 的原始论文《Visual Instruction Tuning》,并在 Hugging Face 上尝试运行开源的 LLaVA-1.5 或 LLaVA-NeXT 模型,体验基础的图文对话。

* **进阶阶段:**

深入研究投影层的设计演变(从 Linear 到 Q-Former 再到 Perceiver Resampler),尝试使用 LoRA(Low-Rank Adaptation)技术对 LLaVA 进行特定数据集的微调。

* **专家阶段:**

关注多模态大模型的评估基准(如 MME, MM-Bench, SEED-Bench),参与开源社区的架构优化讨论,探索长上下文视频理解(Long-context Video Understanding)的前沿方向。

### 3. 推荐资源和文献

* **核心论文:**

* *LLaVA: Large Language and Vision Assistant* (Liu et al., 2023) - 开山之作。

* *Improved Baselines with Visual Instruction Tuning* (LLaVA-1.5) - 性能提升的关键。

* *LLaVA-NeXT: Stronger LLMs Supercharge Multimodal Capabilities* - 高分辨率与多尺度支持的演进。

* **代码仓库:**

* GitHub: `haotian-liu/LLaVA` - 官方维护的代码库,包含详细的训练和推理教程。

* **社区与论坛:**

* Hugging Face Spaces - 体验各类基于 LLaVA 的演示应用。

* Reddit r/MachineLearning & Twitter/X AI Community - 获取最新的行业动态和技术讨论。

* **在线课程:**

* Coursera 或 DeepLearning.AI 推出的多模态大模型专项课程,通常涵盖从 Transformer 原理到 LLaVA 实战的全流程。

在 2026 年的今天,当我们回望 LLaVA,它不仅仅是一个模型,更是一种范式转移的证明:通过巧妙的架构设计和开源协作,机器正在以前所未有的速度学会“看”懂我们的世界。对于每一位 AI 学习者而言,理解 LLaVA 是什么,就是握住了开启多模态智能大门的钥匙。

已是最新文章