【AI词典】模型崩溃 - 生成模型性能退化现象

模型崩溃:定义

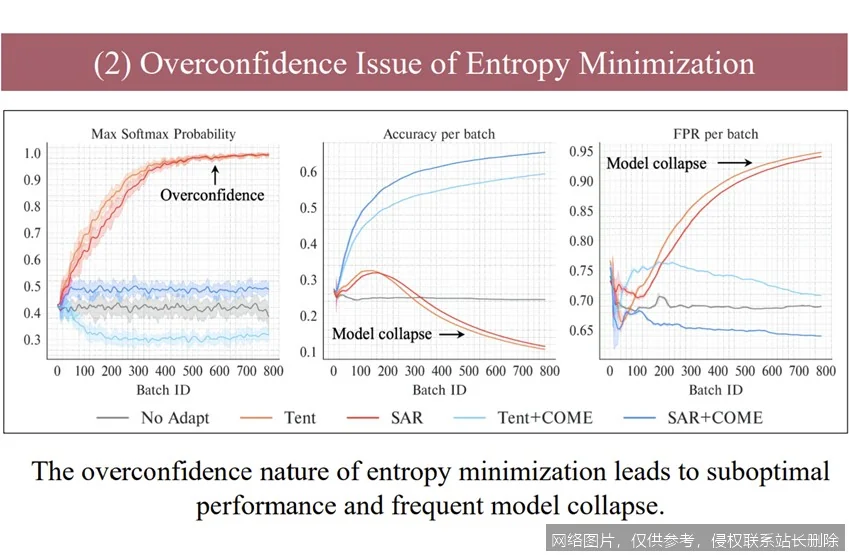

模型崩溃,特指生成式人工智能在持续使用自身生成的数据进行训练时,所引发的性能不可逆退化现象。其核心表现为模型输出多样性急剧丧失、错误模式被固化放大,最终导致生成内容质量显著下降甚至完全失真。

模型崩溃的原理

我们可以用一个“谣言传播”的类比来理解模型崩溃。想象一个房间里有100个人,他们通过传话复述一个复杂的故事。最初的故事是真实、丰富且准确的(代表原始高质量训练数据)。第一轮复述可能丢失一些细节。如果我们将第一轮复述的版本记录下来,作为第二轮复述的唯一依据,那么丢失的细节将永远无法找回。每一轮复述都基于上一轮不完美的版本,错误会被累积,细节会持续丢失。几轮之后,最初的故事可能只剩下一个扭曲、简单化甚至完全错误的骨架。

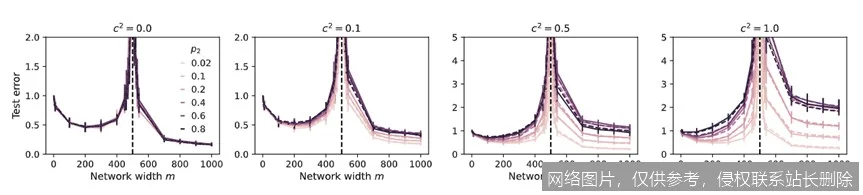

在技术层面,生成模型(如大语言模型或扩散模型)在训练时,会学习真实数据分布中的复杂模式和细微差别。当模型开始生成数据,并将这些生成数据与真实数据混合,作为下一代模型的训练集时,问题便产生了。生成数据本质上是模型对真实数据分布的“近似估计”,其中已包含了模型自身的认知偏差和误差。用这种“有偏估计”反复训练新模型,会像“近亲繁殖”一样,导致模型对真实世界分布的认知逐渐漂移、窄化,最终“遗忘”真实数据的样貌,陷入输出同质化、荒谬化或错误化的崩溃状态。

模型崩溃的应用场景与关注领域

模型崩溃并非一个期望的应用,而是一个需要警惕和缓解的风险现象。它在以下场景中尤为值得关注:

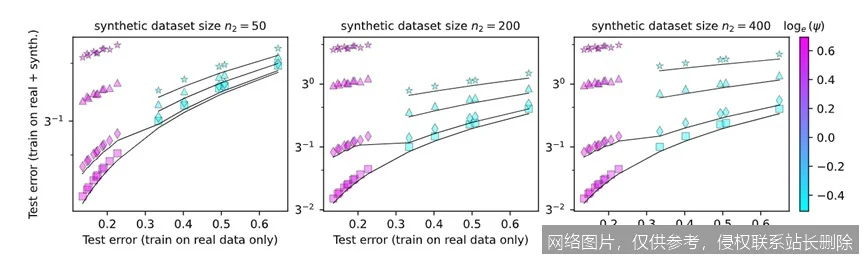

- 生成式AI的持续迭代训练:当开发机构缺乏新的高质量人类创作数据,转而大量使用模型自身生成的“合成数据”来训练下一代模型时,是模型崩溃风险最高的场景。

- 在线学习与反馈循环:在社交平台或内容社区,若AI生成内容被大量发布,并与人类内容混合,后续抓取这些混合数据训练的模型可能陷入崩溃循环。

- 特定垂直领域的模型微调:在数据稀缺的专业领域,若过度依赖有限初始数据生成的合成数据进行扩增和再训练,可能迅速导致模型在该领域内输出僵化或错误。

相关术语

理解模型崩溃,可关联以下概念:生成式人工智能、训练数据污染、数据分布漂移、模式坍塌(Mode Collapse,特指生成对抗网络中的类似现象)、灾难性遗忘。

延伸阅读

若想深入了解模型崩溃的数学机理与实证研究,可查阅关于“递归训练误差累积”及“数据分布退化理论”的学术论文。业界缓解该现象的主要思路包括:严格把控训练数据中合成数据的比例与质量、开发数据过滤与净化技术、以及构建可持续的高质量人类数据供给生态。