vLLM:解锁大语言模型推理速度的终极武器

vLLM:大模型推理的“涡轮增压器”

在人工智能浪潮席卷全球的今天,大语言模型(LLM)已成为推动技术革新的核心引擎。然而,随着模型参数规模飙升至千亿甚至万亿级别,一个严峻的挑战横亘在开发者面前:如何实现高效、低成本且实时的模型推理?传统的推理框架在内存管理和请求调度上捉襟见肘,严重制约了大模型的落地应用。此时,一个名为vLLM的开源项目横空出世,凭借其革命性的核心技术,迅速成为解锁大语言模型推理速度的“终极武器”。

传统推理的瓶颈:内存的隐形浪费

要理解vLLM的强大,首先需看清它解决了什么问题。在传统的大模型推理中,内存是最大的瓶颈。当多个用户同时发起请求时,系统需要为每个请求的输入序列(即用户的提问)和输出序列(即模型的回答)在显存中分配独立的空间。问题在于,这些序列中的大部分内容——尤其是模型在生成下一个词(Token)时已经计算过的历史信息——会被重复存储,造成巨大的内存浪费。这种浪费直接导致:

- 批处理大小受限:无法同时处理太多用户请求,吞吐量低下。

- 高昂的运营成本:需要部署更多GPU来满足并发需求。

- 响应延迟:用户等待时间变长,体验下降。

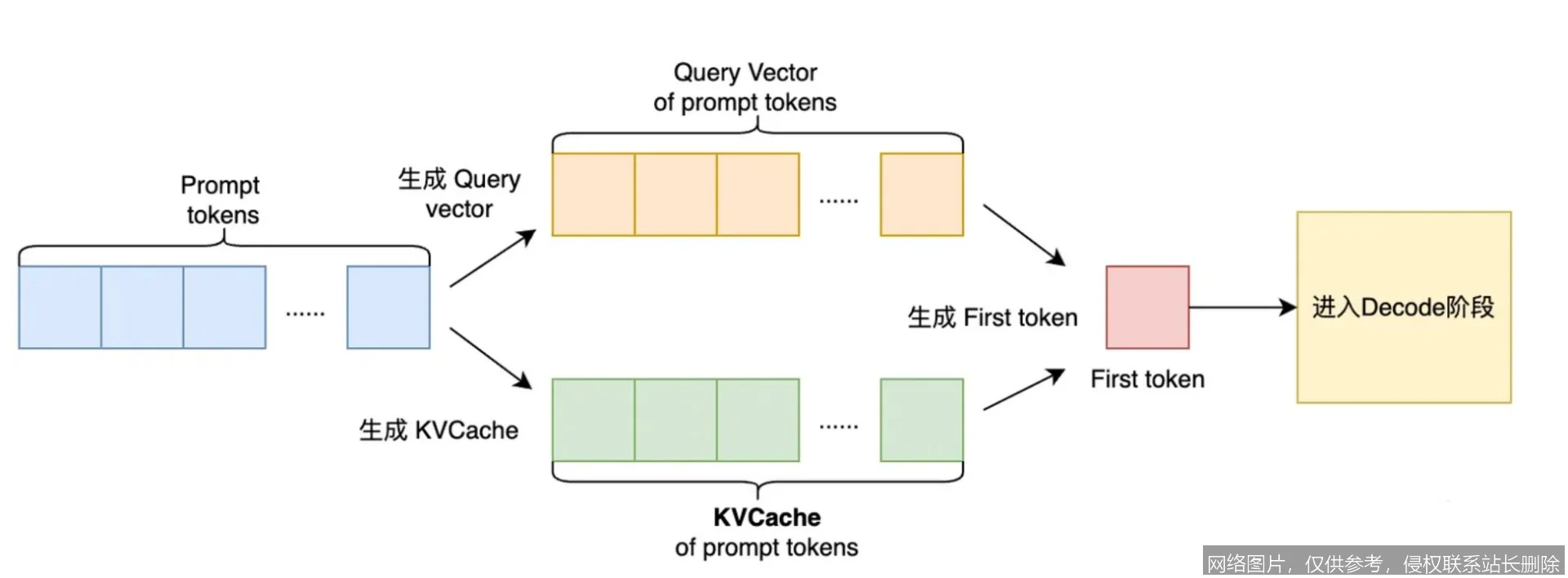

PagedAttention:灵感源自操作系统的内存革命

vLLM的核心突破在于其创新的注意力算法——PagedAttention。该设计的灵感直接来源于计算机操作系统中成熟的内存分页管理机制。

在操作系统中,物理内存被划分为固定大小的“页”,应用程序的虚拟内存地址通过页表映射到这些物理页上,从而高效、灵活地管理内存。vLLM创造性地将这一思想应用于大模型的注意力键值(KV)缓存管理。它将每个请求序列的KV缓存也分割成固定大小的“块”,这些块在物理显存中可以不连续存储,并通过一个类似页表的“块表”进行逻辑管理。

这一设计带来了颠覆性的优势:

- 近乎零浪费的内存使用:不同序列可以共享物理块(例如相同的系统提示词),碎片化的显存空间被充分利用,内存浪费从之前的60%-80%降至不足4%。

- 高效的内存共享:对于采用相同提示词的并行采样(如集束搜索),其KV缓存可以完全共享,极大节省空间。

- 灵活的调度能力:像操作系统交换内存页一样,未来甚至可以将不活跃的KV缓存块临时交换到CPU内存,以服务更长的序列。

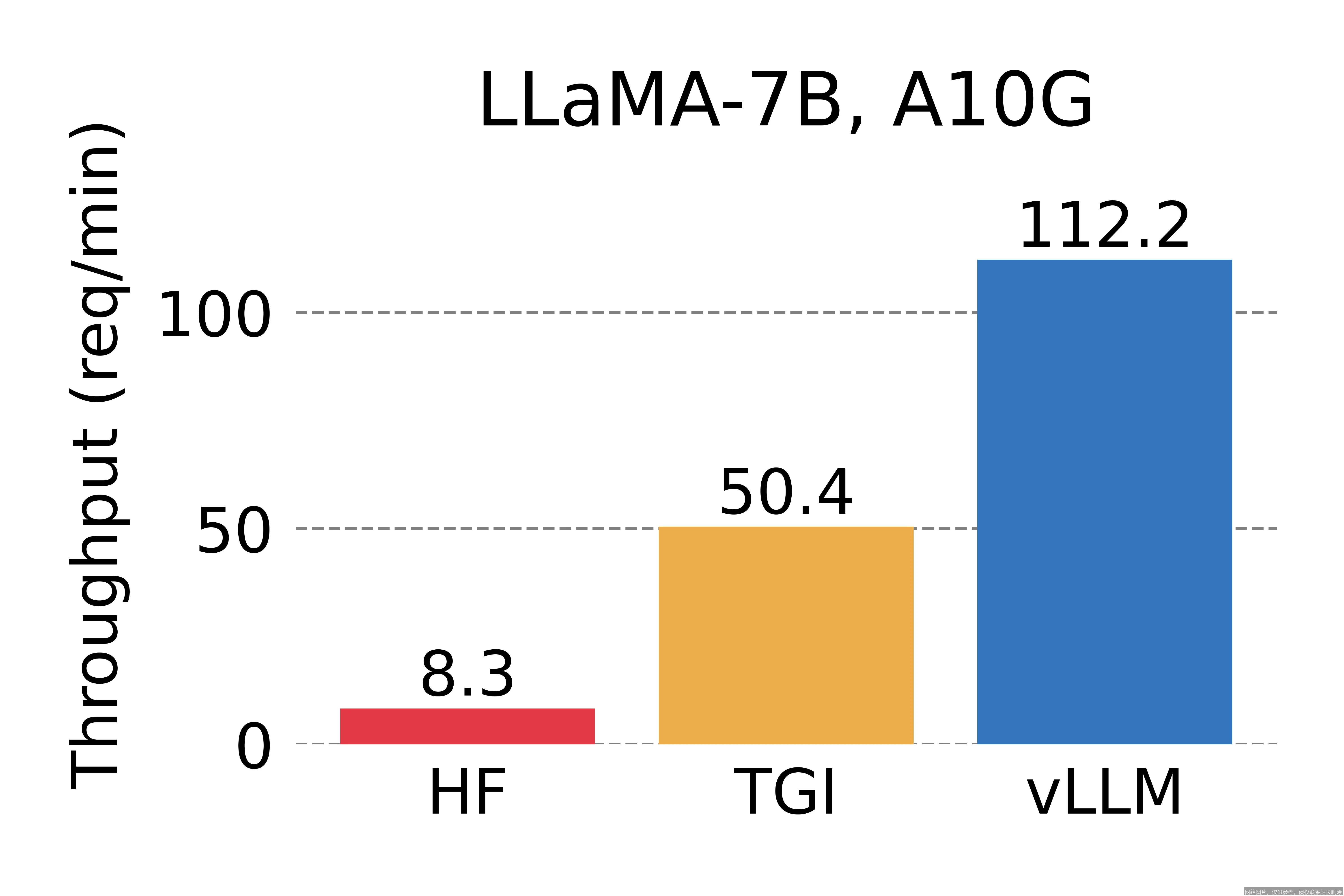

vLLM带来的性能飞跃与生态影响

得益于PagedAttention技术,vLLM在实际部署中实现了令人瞩目的性能提升。测试表明,在相同的硬件条件下,相比之前的推理系统,vLLM的吞吐量可以提升数倍甚至数十倍。这意味着,同一个GPU服务器现在可以同时服务数十倍的用户请求,或将响应延迟大幅降低。

更重要的是,vLLM并非一个封闭的系统。它具有极佳的易用性和兼容性:

- 无缝集成:与Hugging Face模型生态完美兼容,开发者通常只需修改几行代码即可将现有模型切换到vLLM后端。

- 支持广泛:全面支持从Llama、GPT到ChatGLM等主流开源大模型架构。

- 生产就绪:提供了高性能的离线批处理和在线API服务(兼容OpenAI API格式),便于直接投入生产环境。

因此,vLLM迅速获得了从学术研究机构到大型科技公司的青睐,成为部署大模型服务的事实标准之一。

展望未来:推理优化的新起点

vLLM的成功不仅仅在于其技术本身,更在于它为大模型推理优化开辟了一条全新的道路。它证明,通过系统级的、跨层的协同设计(结合算法与系统),可以释放出硬件巨大的潜在性能。

展望未来,vLLM的进化仍在继续,其团队正致力于支持更长的上下文、更复杂的采样方法,并进一步优化多GPU分布式推理。可以预见,以vLLM为代表的先进推理框架,将持续降低大模型的应用门槛,加速AI技术普惠的进程,让强大的人工智能能力能够更快速、更经济地服务于千行百业。

对于任何关心大模型落地和应用的人来说,深入理解并善用vLLM,无疑是在激烈的技术竞争中抢占先机的关键一步。

已是最新文章

相关推荐

- vLLM:解锁大语言模型推理速度的终极武器

- Diffusers 是什么?2026 扩散模型原理、应用与实战全面解析

- 什么是 Azure Text to Speech?2026 年神经语音合成原理与应用全解析

- 开源协议是什么:2026 年最新定义、核心原理与商业应用全解析

- Streamlit 是什么:2026 数据应用开发原理、实战与全面解析

- 激活函数是什么:2026 最新定义、核心原理与深度应用全面解析

- MIT 协议是什么?2026 最新定义、核心原理与商用实战全解析

- 什么是半监督学习?2026 原理、应用与实战全面解析

- 什么是重排序?2026 最新原理、技术演进与实战应用全解析

- 什么是推理引擎?2026 最新定义、核心原理与大模型应用全解析