【AI词典】指令微调 - 基于指令优化大语言模型的方法

AI词典2026-04-28 16:00:00

指令微调:定义

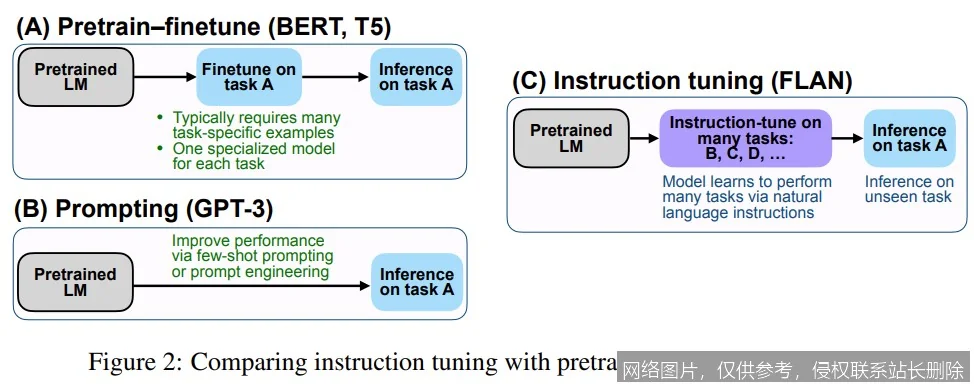

指令微调(Instruction Tuning)是一种通过使用大量自然语言指令及其对应期望输出的数据集,对预训练大语言模型进行有监督的进一步训练,从而显著提升模型理解并遵循人类指令能力的关键技术。

指令微调的工作原理

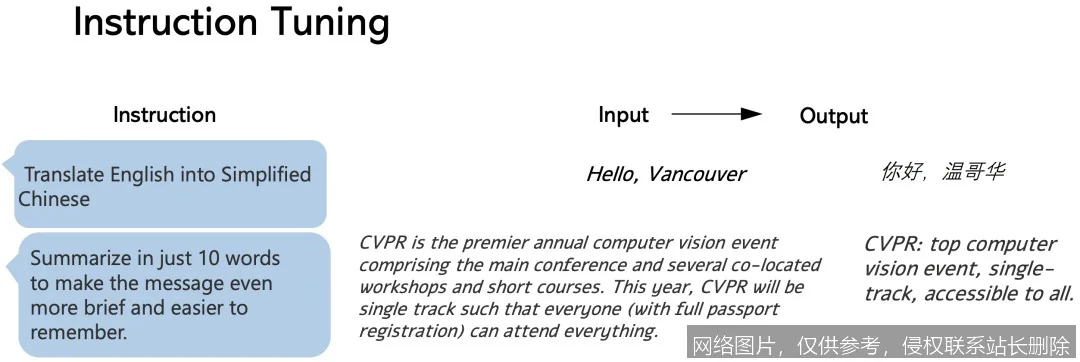

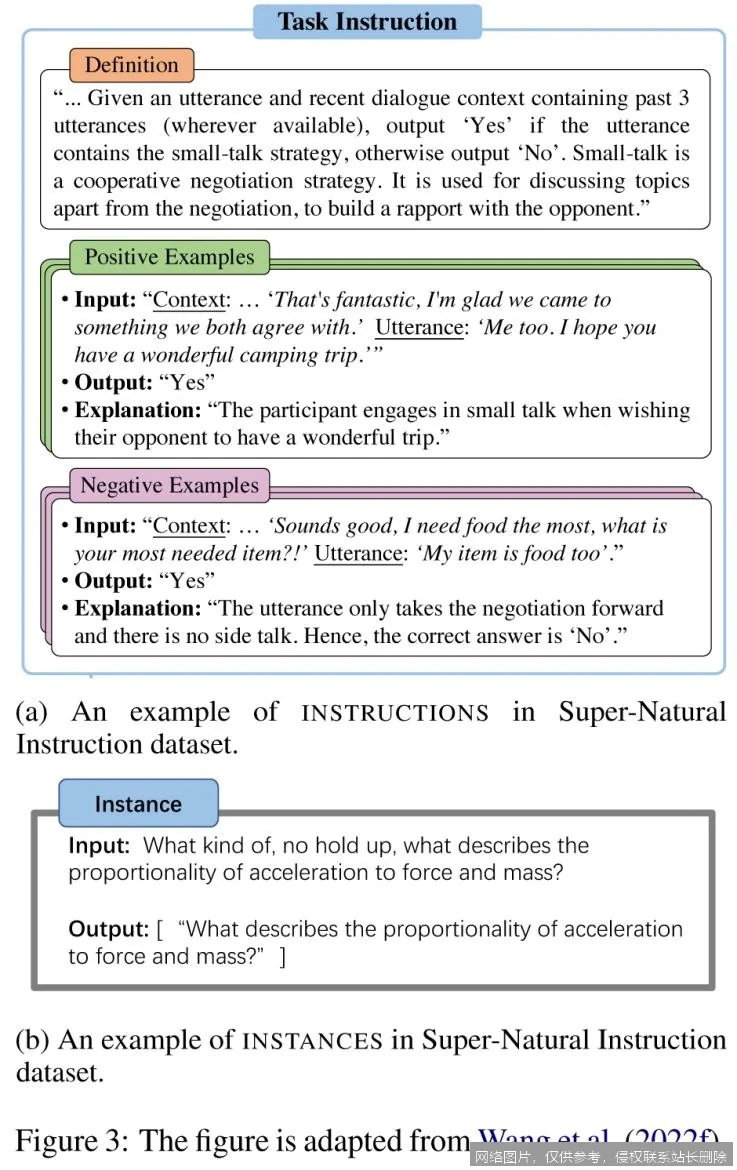

可以将指令微调理解为对一位“知识渊博但未经训练”的学者进行“职业化”培训。预训练大语言模型在庞大数据集上学习,掌握了丰富的语言知识和世界知识,但它并不清楚用户具体希望它以何种方式、何种格式来运用这些知识。指令微调则提供了明确的“岗位培训”:它向模型展示成千上万对“指令-示范”样例,例如“总结以下文章:”配以一篇总结,或“将这句话翻译成法语:”配以翻译结果。通过这个过程,模型学习到两个核心能力:一是准确解析用户指令的意图(是总结、翻译、创作还是推理),二是生成符合指令要求的、格式规范的输出。其本质是激发并引导模型在预训练阶段已具备的潜在能力,使其行为与人类期望对齐。

指令微调的应用场景

- 智能助手与聊天机器人:通过指令微调,模型能更可靠地理解用户以多样化方式提出的请求(如“帮我写一封邮件”或“用表格列出优缺点”),并生成有帮助、相关且无害的回应,这是构建实用AI助手的基础。

- 内容生成与格式化输出:在营销、创作等领域,模型可根据“以活泼风格写一篇产品介绍”、“将会议要点整理为清单”等具体指令,生成风格、格式均符合要求的文本,极大提升内容生产效率。

- 代码生成与解释:针对“用Python写一个快速排序函数”或“解释这段代码的作用”等指令,经过代码相关数据微调的模型能生成可运行代码或提供清晰解释,成为开发者的有力工具。

相关术语

预训练(Pre-training) |

监督微调(Supervised Fine-Tuning, SFT) |

提示工程(Prompt Engineering) |

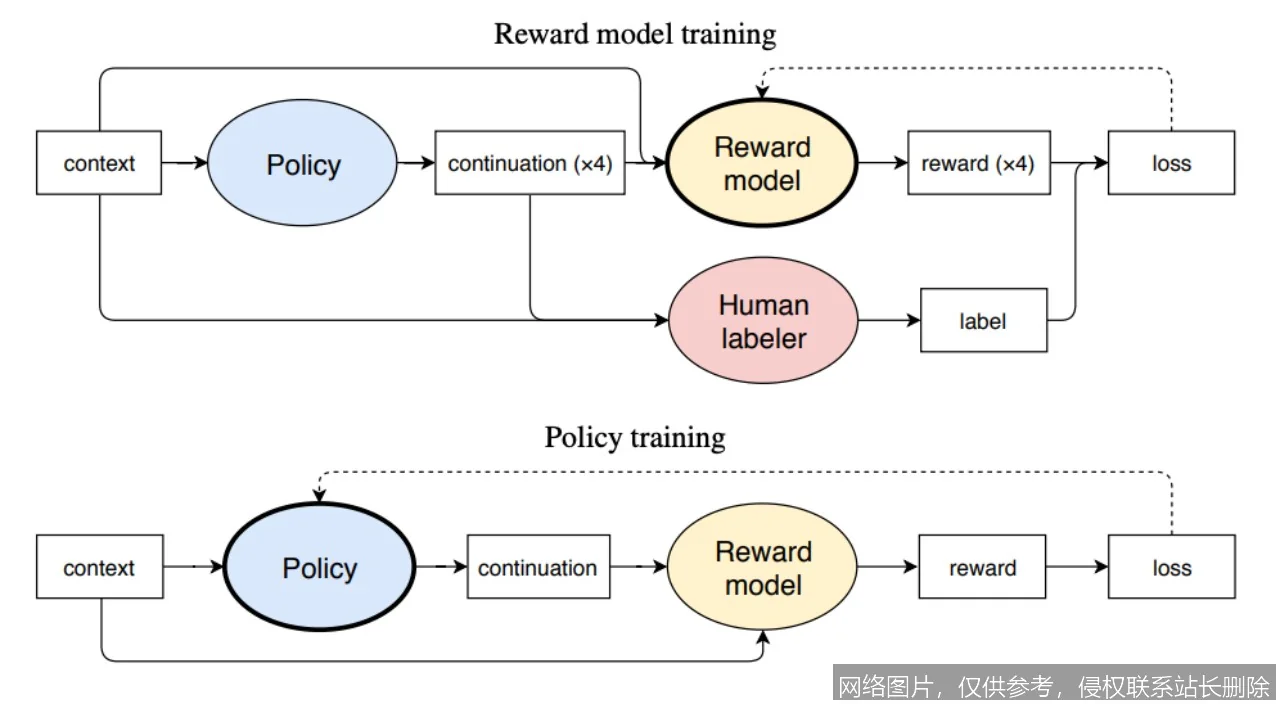

人类反馈强化学习(RLHF) |

对齐(Alignment)

延伸阅读

若想深入了解指令微调,可关注其里程碑式的研究论文《Finetuned Language Models Are Zero-Shot Learners》。该论文提出的“FLAN”模型系列首次系统性地展示了指令微调如何赋予模型强大的零样本任务泛化能力。此外,探索如“Alpaca”、“Vicuna”等开源指令微调项目及其数据集,能帮助理解实践中的具体方法与挑战。