【AI词典】模型幻觉 - 模型生成不真实或错误内容的现象

AI词典2026-04-27 21:36:00

模型幻觉的定义

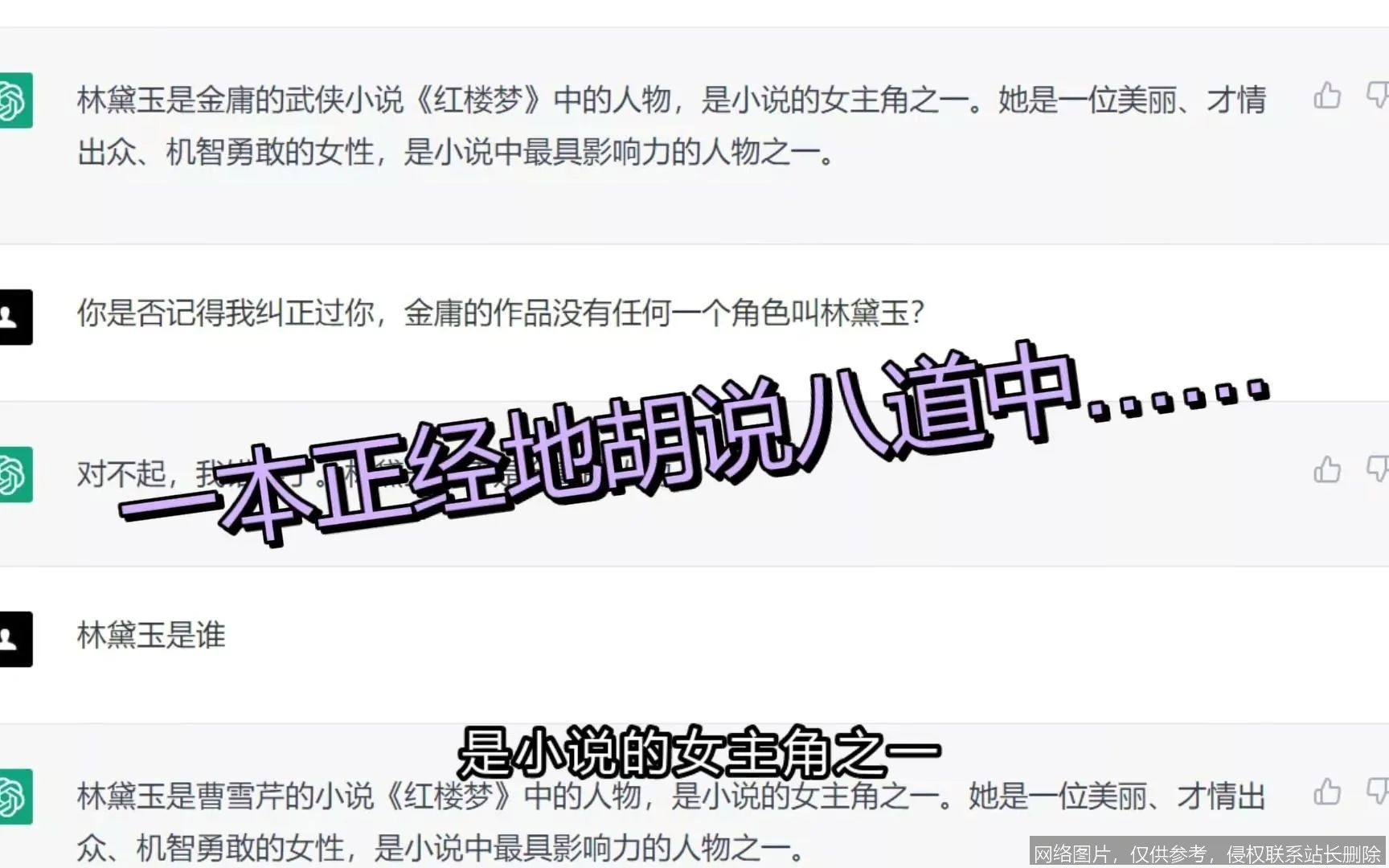

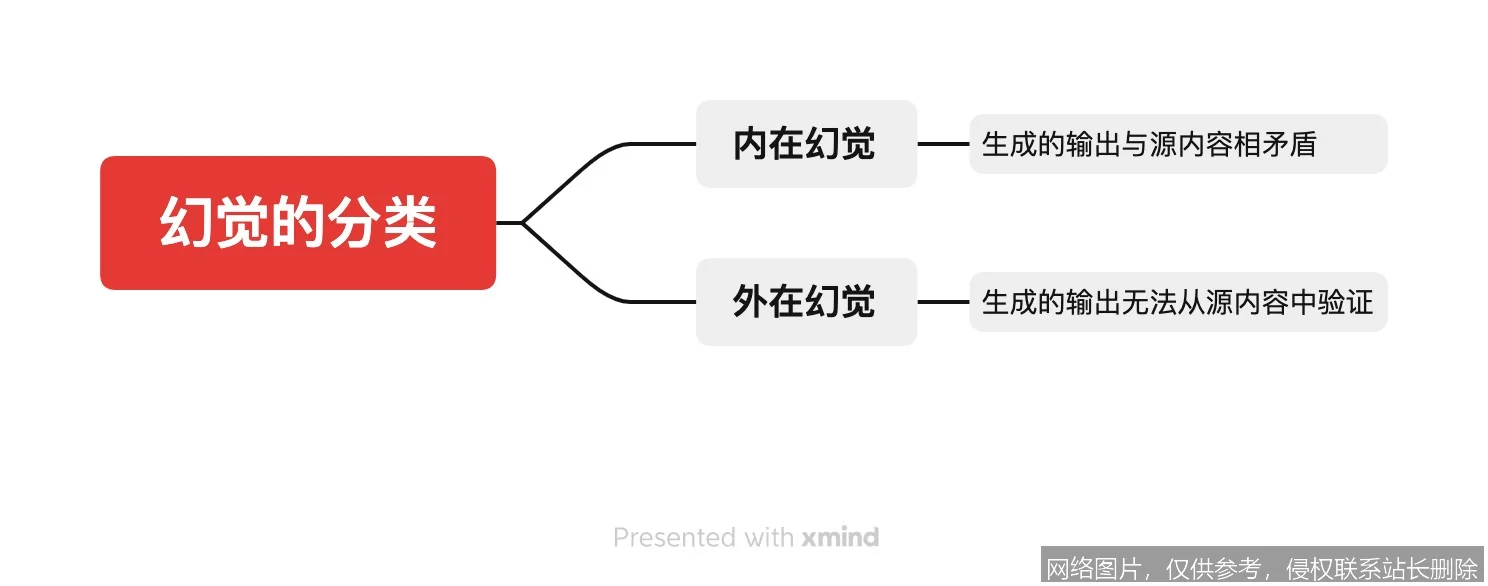

模型幻觉,在人工智能领域,特指大型语言模型或其他生成式AI模型在输出内容时,生成看似合理但事实上不真实、不符合客观事实或缺乏可靠依据的信息的现象。这种现象并非模型有意“欺骗”,而是其基于概率的生成机制在特定条件下产生的逻辑偏差或事实性错误。

模型幻觉的工作原理

模型幻觉的根源在于当前生成式AI的核心工作方式。模型并非一个存储事实的数据库,而是一个基于海量文本数据训练出的“模式匹配与续写引擎”。它通过学习训练数据中词汇、短语和概念之间的统计关联性来生成文本。当模型遇到知识盲区、模糊指令或内部训练数据存在矛盾时,它会倾向于根据最可能的“语言模式”或“上下文逻辑”进行生成,而非验证事实真伪。这好比一个博览群书但缺乏现实经验的学生,在考试中遇到不会的题目时,会根据对题目风格和所学知识的“感觉”,编造出一个语法正确、结构完整但答案错误的论述。

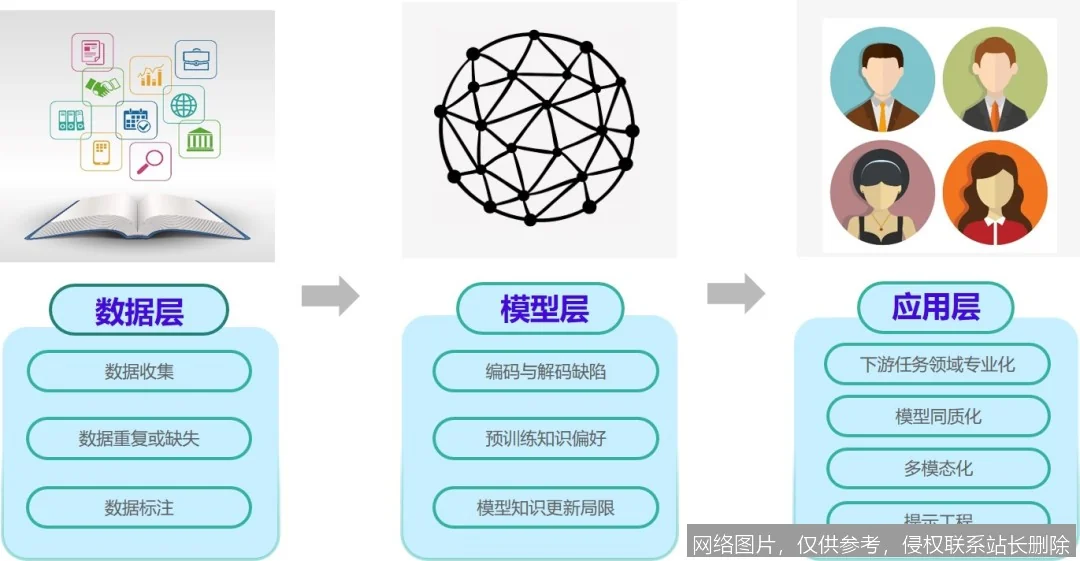

幻觉的产生通常与以下因素有关:训练数据本身包含错误或偏见;模型在推理过程中过度泛化所学模式;提示词(Prompt)引导性过强或过于模糊;以及模型缺乏对自身知识边界的认知和校准能力。

模型幻觉的典型应用场景

- 事实性问答与研究辅助:当用户询问某个冷门历史事件的细节或某个新兴科学概念的具体数据时,模型可能生成包含错误日期、虚构人物或编造统计数字的回答,这些内容往往以高度自信的口吻呈现,极具误导性。

- 创意写作与内容生成:在撰写小说、营销文案或技术报告时,模型可能“发明”出不存在的产品功能、学术引用或法律条款。例如,为一款护肤品生成看似专业的“科学原理”描述,其中掺杂了虚构的生化术语和未经证实的功效宣称。

- 代码生成与逻辑推理:在编程任务中,模型可能生成语法正确但逻辑有误、或调用了不存在的API函数的代码。在解决数学或逻辑问题时,它可能推导出步骤合理但最终答案错误的结论。

相关术语

理解模型幻觉,可关联以下概念:过度拟合(模型过度适应训练数据中的噪声)、知识截止日期(模型无法获取训练数据之后的新知识)、提示工程(通过优化指令来减轻幻觉)、AI对齐(使AI系统的目标与人类价值观和事实一致)以及检索增强生成(通过引入外部知识源来提升生成内容的真实性)。

延伸阅读

若希望深入了解模型幻觉的成因与缓解策略,可关注人工智能顶会(如NeurIPS, ICLR)中关于“大型语言模型的可靠性与评估”、“事实一致性”等主题的研究论文。行业报告如斯坦福大学的《人工智能指数报告》也会涉及对该现象的讨论。在实践中,掌握有效的提示词技巧和采用“人在环路”的审核流程,是当前应对模型幻觉的实用方法。