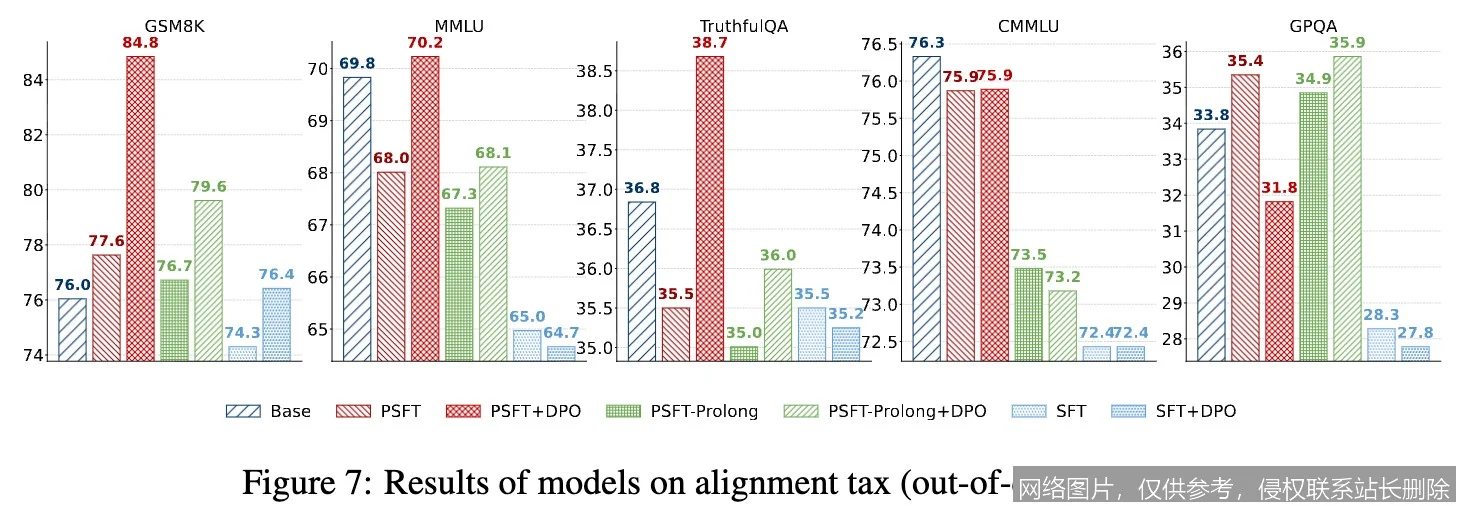

【AI词典】对齐税 - 为模型对齐付出的性能代价

AI词典2026-04-28 00:24:00

对齐税:定义与核心内涵

对齐税(Alignment Tax)是指在人工智能模型开发过程中,为使模型行为与人类价值观、伦理准则及特定安全目标保持一致(即“对齐”),而不得不付出的模型性能或能力上的代价。这种代价通常表现为模型在原始任务上的准确率、效率或通用性的降低。

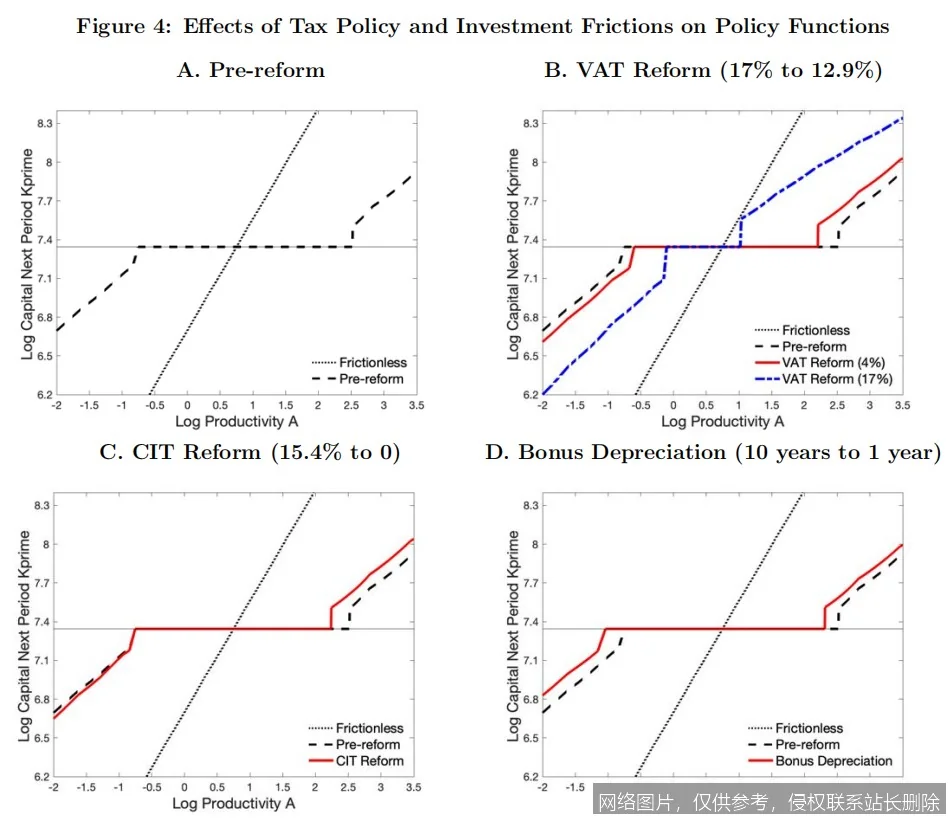

对齐税的工作原理

可以将AI模型想象成一个天赋异禀但缺乏社会规范的学生。它的原始目标是纯粹在考试(如标准基准测试)中取得最高分。为了让它遵守规则、不作弊、不输出有害内容,我们需要对其进行约束和引导。这些约束,例如添加安全过滤器、用符合伦理的数据进行微调、或引入复杂的规则检查,就像给这个学生戴上了“规范紧箍咒”。虽然这使其行为更安全、更可靠,但同时也可能限制其思维的灵活性与反应速度,导致其在某些纯粹的知识答题上速度变慢或得分略降。这部分损失的性能,就是为“对齐”所支付的“税”。

对齐税的应用场景

- 内容安全过滤:大型语言模型在开放域生成时,需集成内容安全过滤器以屏蔽暴力、仇恨等有害信息。此过程可能“误伤”部分合理但敏感的上下文,或增加计算开销,导致生成速度下降或部分合法查询的回复质量波动,这是最常见的一种对齐税。

- 价值观对齐微调:通过基于人类反馈的强化学习等技术使模型输出更无害、有帮助。这可能导致模型在追求“绝对安全”时变得过于保守,拒绝回答某些边缘但合理的专业问题(例如,关于历史冲突的客观分析),牺牲了部分实用性和信息完整性。

- 特定领域合规性约束:在医疗、法律等高风险领域部署AI时,需强制加入事实核查、免责声明或严格的推理链展示。这些为确保安全合规而增加的步骤,往往会降低模型的交互流畅度和响应效率,构成显著的性能代价。

相关术语

理解对齐税,可关联以下概念:AI对齐、基于人类反馈的强化学习、模型稳健性、性能-安全权衡、红队测试。

延伸阅读

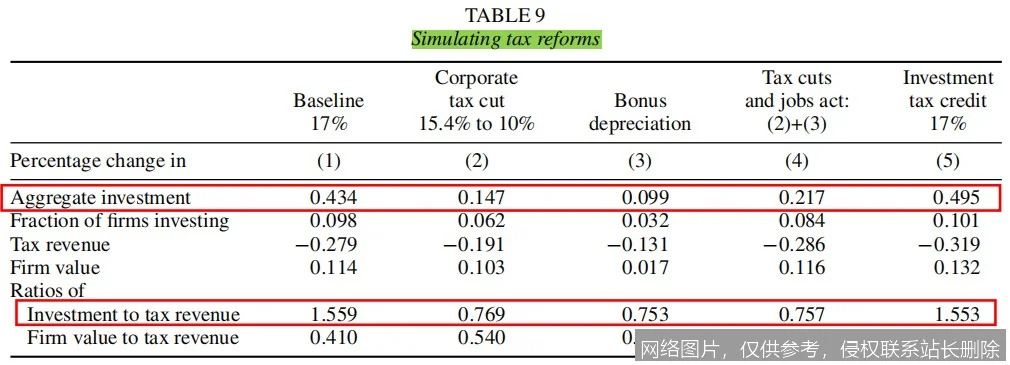

对齐税的概念深刻体现了AI发展中的核心矛盾——能力与安全的平衡。当前研究前沿正致力于开发“负税”或“低税”的对齐方法,例如通过改进训练架构或算法,力求最小化对齐带来的性能损失。读者可关注相关学术会议中关于“scalable oversight”(可扩展监督)和“constitutional AI”(宪法AI)的最新论文,以了解如何更高效地支付这份“必要之税”。