【AI词典】涌现能力 - 模型规模扩大时产生的新能力

AI词典2026-04-27 23:00:00

涌现能力:定义与核心

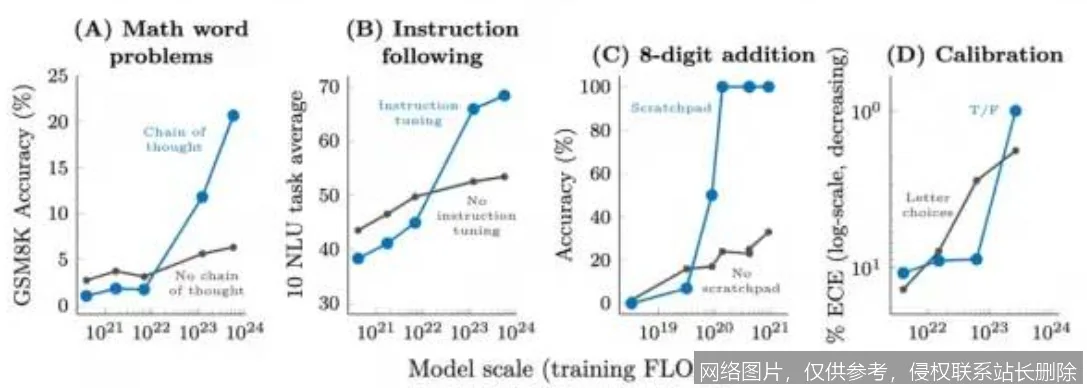

涌现能力(Emergent Abilities)指人工智能模型(尤其是大语言模型)在参数规模、数据量或计算量跨越特定阈值时,突然显现出在较小规模模型中完全不存在或表现极差的新能力。这些能力并非通过特定编程获得,而是模型规模扩大后“自发”产生。

涌现能力的原理

可以将大语言模型想象成一个由海量神经元(参数)构成的复杂网络。当这个网络规模较小时,其行为相对简单、可预测,只能完成基础任务(如单词补全)。然而,当网络规模(参数、数据)持续扩大并超过某个临界点后,其内部结构会变得极其复杂,各部分之间产生难以事先设计的、非线性的相互作用。这种高复杂度催生了新的“系统级”行为模式,即涌现能力。它类似于无数简单水分子通过复杂互动“涌现”出波浪的形态与力量,这种宏观属性无法从单个水分子的特性中直接推导。

涌现能力的典型应用场景

- 复杂推理与分步解题:小模型通常只能进行简单关联,而具备涌现能力的大模型可以展示出多步骤逻辑推理、数学演算或代码调试能力。例如,用户输入一道高中物理题,模型能自动分解为受力分析、公式选择、数值计算等步骤并给出解答。

- 跨模态指令跟随与生成:模型能够理解并执行隐含复杂意图的指令。例如,根据“生成一张体现城市孤独感的黑白照片描述,并据此写一首俳句”这样的复合指令,模型能协调视觉概念与诗歌创作两种不同模态的任务。

- 上下文学习:仅通过提供几个示例(少样本学习),模型就能快速理解新任务模式并执行,而无需更新其参数。这体现了模型从上下文信息中抽象出规则和模式的涌现能力。

相关术语

理解涌现能力,可关联以下概念:

缩放定律、

大语言模型、

智能突现、

分布式表示、

少样本学习。

延伸阅读

若想深入了解涌现能力的实证研究与理论探讨,可关注学术论文中关于模型“缩放定律”的研究,以及探讨“量变引起质变”在复杂系统中的哲学与科学论述。相关研究通常发表在机器学习顶级会议(如NeurIPS, ICML)上,重点关注大模型能力边界的基准测试报告。