【AI词典】上下文学习 - 通过提示示例引导模型输出的学习方法

AI词典2026-04-28 04:36:00

上下文学习的定义

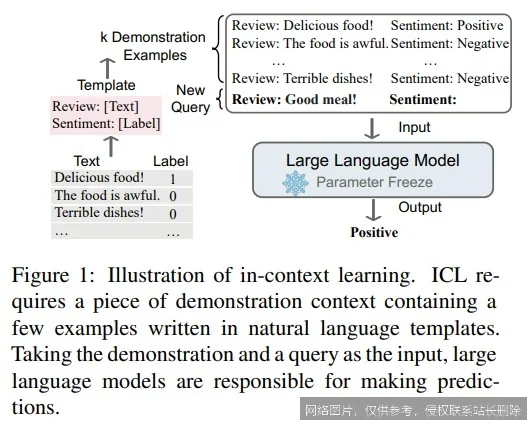

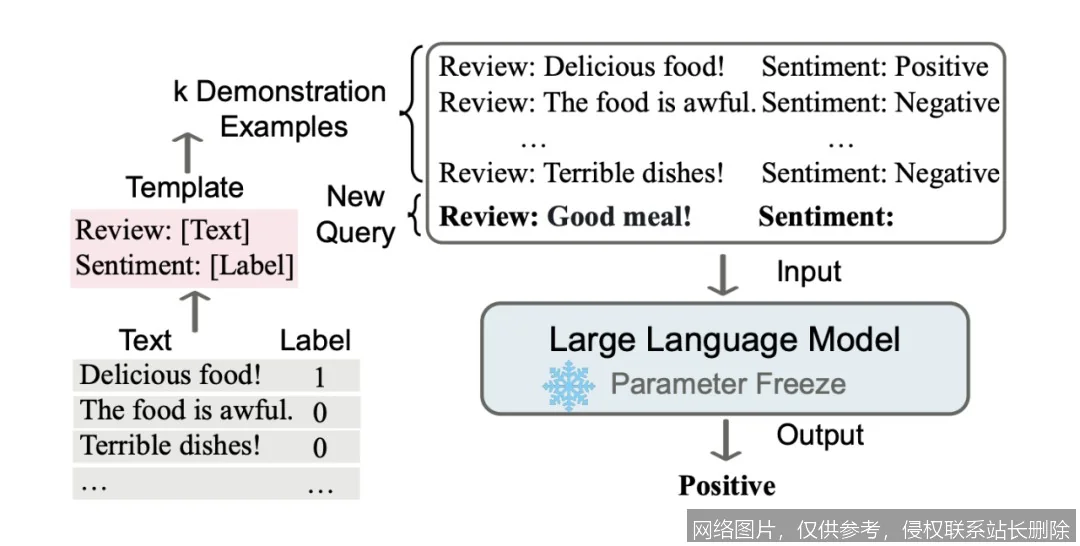

上下文学习(In-Context Learning, ICL)是一种大型语言模型的核心能力,指模型无需更新其内部参数,仅通过分析输入提示中提供的少量示例(即“上下文”),就能理解任务指令并生成符合要求输出的学习方法。

上下文学习的原理

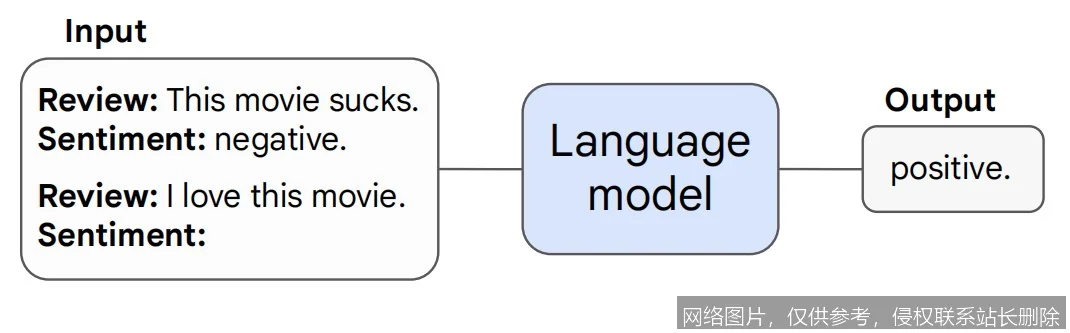

你可以将上下文学习理解为一种“即时模仿”。想象一下,你正在教一个极其聪明但从未见过特定任务(例如将中文翻译成英文)的学生。你并不对他进行长期培训,而是直接在考卷的顶部写下几个“示例题”和“标准答案”。这个学生通过快速分析这些示例,瞬间领悟了题目要求和答题格式,并成功解答了考卷上后续的新题目。

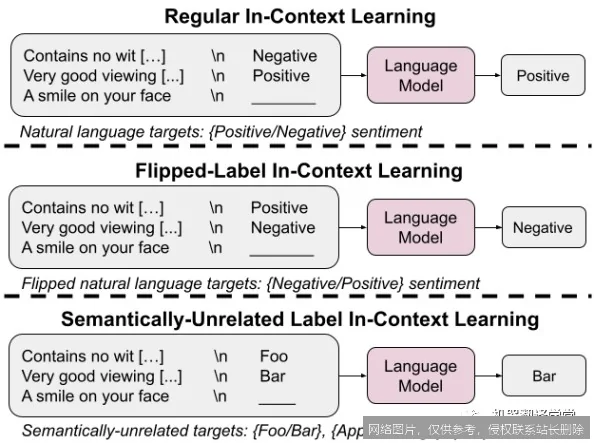

对于模型而言,这个过程类似:用户输入的提示(Prompt)通常由“任务描述”、“少数几个输入-输出示例”(即少样本示例)和最终的“新问题”组成。模型基于其海量预训练数据中获得的基础语言和推理模式,将提示中的示例作为临时“参考指南”,从中抽象出任务模式(如翻译、分类、风格转换),并将此模式应用到待解决的新问题上,从而生成正确答案。整个过程模型的权重并未改变,它只是巧妙地利用了上下文信息作为推理的“脚手架”。

上下文学习的应用场景

- 快速任务适配与原型开发:开发者或研究者无需微调模型,仅通过精心设计提示中的示例,即可让通用大模型快速胜任文本分类、信息抽取、代码生成等新任务,极大降低了尝试和部署成本。

- 个性化交互与内容生成:在对话系统中,通过将用户的历史对话或偏好示例置于当前对话的上下文中,可以引导模型生成更符合用户风格和需求的回复、邮件或创意文案。

- 复杂推理与分步解答:在数学解题或逻辑推理任务中,通过在上下文中提供几个展示了完整推理链条的示例(即思维链示例),可以显著激发模型的分步推理能力,使其在解答新问题时也能“模仿”出清晰的推理过程。

相关术语

理解上下文学习,可以关联以下概念:作为其实现基础的提示工程;与之对比、需要更新模型参数的微调;一种特殊的上下文学习形式——零样本学习;以及激发模型推理的关键技术——思维链。

延伸阅读

若想深入了解上下文学习的机制与边界,建议阅读OpenAI关于GPT-3的原始研究论文,其中首次系统性地阐述了这一现象。同时,可以关注后续关于“元学习”视角解释ICL、以及其性能如何受示例选择、顺序和格式影响的相关研究文献,这些研究揭示了上下文学习不仅仅是简单的模式匹配,其背后蕴含着更深刻的基于推理的任务推断过程。

相关推荐

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析

- 什么是推理?2026 年原生智能原理、技术演进与应用全景解析

- 【AI词典】思维链 - 分步推理的思维拓展方法

- 【AI词典】指令微调 - 基于指令优化大语言模型的方法

- 什么是 Artificial Analysis?2026 原理、应用与实战全面解析

- 【AI词典】上下文学习 - 通过提示示例引导模型输出的学习方法

- 【AI词典】提示注入 - 恶意指令操控AI输出的攻击手段

- 【AI词典】越狱Jailbreak - 突破AI安全限制的行为

- 【AI词典】对齐税 - 为模型对齐付出的性能代价