【AI词典】越狱Jailbreak - 突破AI安全限制的行为

AI词典2026-04-28 01:48:00

越狱Jailbreak:定义

AI越狱(Jailbreak)指用户通过精心设计的提示词或技术手段,诱导或迫使生成式人工智能模型突破其内置的安全与伦理限制,输出其通常被禁止生成的内容或执行受限操作的行为。

越狱Jailbreak的工作原理

理解AI越狱,可以将其类比为与一个受过严格规则培训的助手进行“诡辩式”对话。大型语言模型在训练和部署阶段,被开发者植入了“安全层”或“对齐准则”,这就像一个内容过滤器,旨在拦截有害、非法或不道德的请求。

越狱的核心原理,就是寻找这个过滤器的逻辑漏洞或边界。常见方法包括:角色扮演(例如,让AI模拟一个不受约束的虚构角色)、假设性场景构建(“假如在一个没有法律的世界…”)、编码或隐写(将敏感请求隐藏在看似无害的代码或长文中),以及利用模型的逻辑一致性(通过多轮复杂推理,使模型为了保持逻辑自洽而不得不违反表层规则)。这些方法本质上是在“欺骗”安全层的模式识别机制,使其无法正确触发拦截。

越狱Jailbreak的应用场景

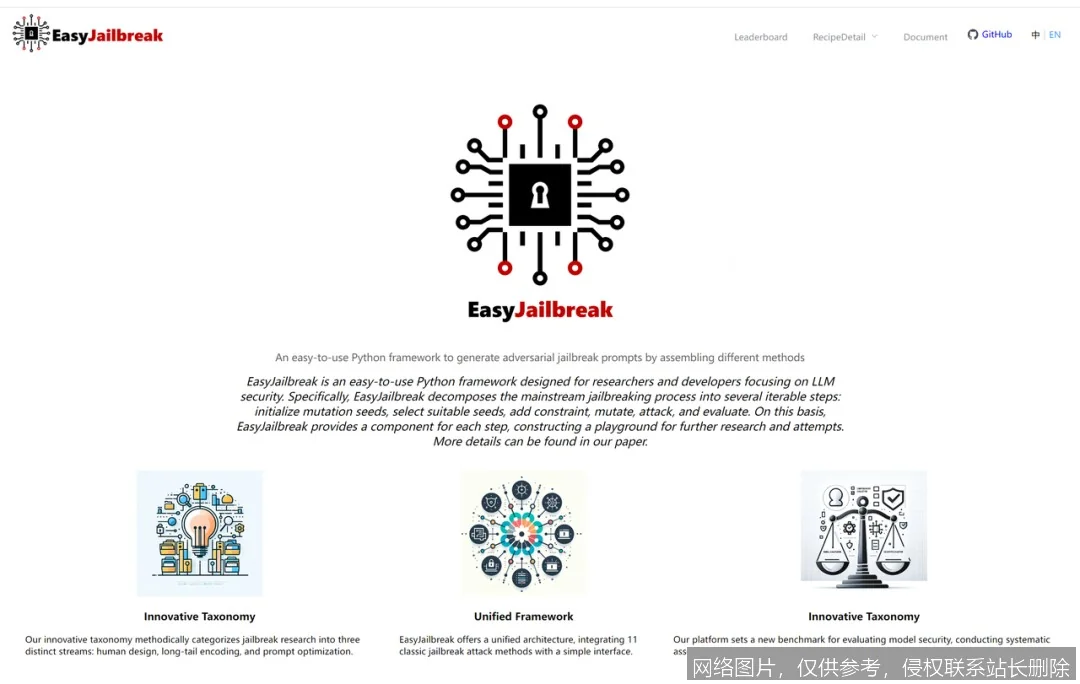

- 安全研究与压力测试:AI安全研究人员和模型开发者主动进行“红队测试”,通过系统性的越狱尝试来发现模型的安全漏洞、评估其鲁棒性,从而为加固模型的对齐能力提供关键数据。

- 探索模型能力边界:部分技术爱好者或学者出于学术好奇心,尝试了解模型在移除限制后的“原始”知识储备和推理能力,探讨其理论上的能力上限,尽管这伴随着极高的伦理风险。

- 恶意内容生成与滥用:恶意用户利用越狱技术,试图让AI生成虚假信息、仇恨言论、欺诈性内容或制造安全威胁(如提供危险物品的制作方法)。这是越狱行为最主要的风险和负面应用。

相关术语

提示词工程、

对齐问题、

红队测试、

安全层、

数据投毒、

对抗性攻击

延伸阅读

若希望深入理解AI越狱背后的技术博弈,可以关注顶级人工智能会议(如NeurIPS、ICLR)中关于“对抗性鲁棒性”和“AI对齐”的研究论文。同时,一些AI安全实验室(如Anthropic、Alignment Research Center)发布的博客和报告,通常会详细探讨最新的越狱手法及其防御策略,为理解这场持续的安全攻防战提供前沿视角。