【AI词典】困惑度 - 语言模型性能评估指标

AI词典2026-04-25 00:24:00

困惑度:语言模型性能评估指标

困惑度(Perplexity,简称PPL)是评估语言模型性能的核心指标,它衡量模型对一组测试数据(通常是文本序列)的预测不确定性或“困惑”程度。 直观上,困惑度越低,表明语言模型对数据的建模越准确,其预测能力越强。

原理:如何理解“困惑”程度

我们可以将语言模型想象成一个在陌生城市中导航的旅行者。这个城市由无数可能的“词”或“句子”路径构成。一个优秀的导航(模型)能清晰指出最可能的前进方向,让旅行者感到确定、不困惑。困惑度正是量化这种“确定感”的指标。

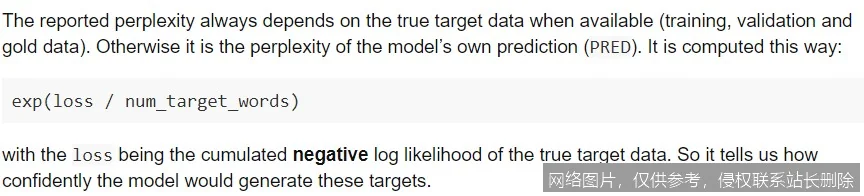

从数学角度看,困惑度与语言模型赋予测试数据集的概率密切相关。它本质上是模型预测分布与真实数据分布之间差异的一种度量。具体计算公式基于每个词预测概率的几何平均的倒数。简单来说,模型对下一个词预测的概率越高,其困惑度值就越低。例如,一个困惑度为20的模型,平均在“猜测”下一个词时,其不确定性的程度大约相当于在20个等概率的候选词中随机选择。

应用场景

困惑度作为一项内在评估指标,在语言模型的研发和比较中扮演着关键角色:

- 模型训练监控与选择:在训练神经网络语言模型时,研究人员会在一个独立的验证集上定期计算困惑度。随着训练进行,验证集困惑度下降是模型学习有效的标志。训练终止时,通常会选择在验证集上取得最低困惑度的模型版本,以避免过拟合。

- 不同模型架构对比:当比较不同的语言模型(如RNN、LSTM、Transformer等)或同一模型的不同超参数设置时,在相同的数据集上计算困惑度提供了一个客观、量化的性能基准。较低的困惑度通常意味着模型具有更强的语言建模能力。

- 领域适应性评估:当将一个通用语言模型应用于特定领域(如医学、法律)时,可以计算模型在该领域专业文本上的困惑度。困惑度的显著降低或升高,能够直观反映模型对该领域语言的适应程度,指导进一步的领域微调。

相关术语

理解困惑度,通常需要关联以下概念:

交叉熵损失、

语言模型、

信息熵、

比特每字符、

生成式人工智能评估。

延伸阅读

若希望深入理解困惑度的理论基础,建议从信息论中的熵(Entropy)概念入手,它是困惑度度量的直接来源。同时,可以查阅经典的自然语言处理教材中关于语言模型评估的章节,其中通常会详细推导困惑度与交叉熵的关系,并讨论其在 N-gram模型 和神经网络模型中的具体计算与局限性。值得注意的是,困惑度虽重要,但它主要衡量模型的预测一致性,并不能完全等同于模型在最终下游任务(如对话、翻译)上的表现,因此常需与 BLEU、ROUGE 等外在评估指标结合使用。